RaycastGrasp: Eye-Gaze Interaction with Wearable Devices for Robotic Manipulation

作者: Zitiantao Lin, Yongpeng Sang, Yang Ye

分类: cs.RO, cs.HC

发布日期: 2025-10-25

备注: 5 pages, 5 figures; Accepted to: 2025 IEEE 4th International Conference on Intelligent Reality (ICIR 2025); Zitiantao Lin and Yongpeng Sang contributed equally to this work (co-first authors). Corresponding author: Yang Ye (y.ye@northeastern.edu)

💡 一句话要点

RaycastGrasp:基于眼动追踪和可穿戴设备的机器人操作交互

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 眼动追踪 机器人操作 混合现实 人机交互 辅助机器人 意图识别 可穿戴设备

📋 核心要点

- 现有基于操纵杆的机器人控制界面精度要求高,参考系不直观,对行动不便人士构成挑战。

- 该论文提出一种以人为中心的眼动引导机器人操作界面,利用可穿戴MR头显实现自然交互。

- 实验结果表明,该方法显著提升了操作精度,降低了延迟,并实现了较高的意图和物体识别准确率。

📝 摘要(中文)

本文提出了一种基于第一人称视角的眼动引导机器人操作界面,利用可穿戴混合现实(MR)头显辅助行动不便的人进行物体抓取。该系统使用户能够通过自然的眼动注视与真实世界的物体进行无缝交互,同时提供增强的视觉提示以确认意图,并利用预训练的视觉模型和机械臂进行意图识别和物体操作。实验结果表明,该方法显著提高了操作精度,降低了系统延迟,并在多个真实场景中实现了超过88%的单次意图和物体识别准确率。这些结果证明了该系统在增强直观性和可访问性方面的有效性,突显了其在辅助机器人应用中的实际意义。

🔬 方法详解

问题定义:现有机器人操作界面,特别是针对行动不便人士的辅助操作,主要依赖操纵杆等控制方式。这些方式存在精度要求高、参考系不直观等问题,导致操作困难,用户体验不佳。此外,一些新兴的人机交互方法依赖外部屏幕或限制性的控制方案,降低了直观性和可访问性。

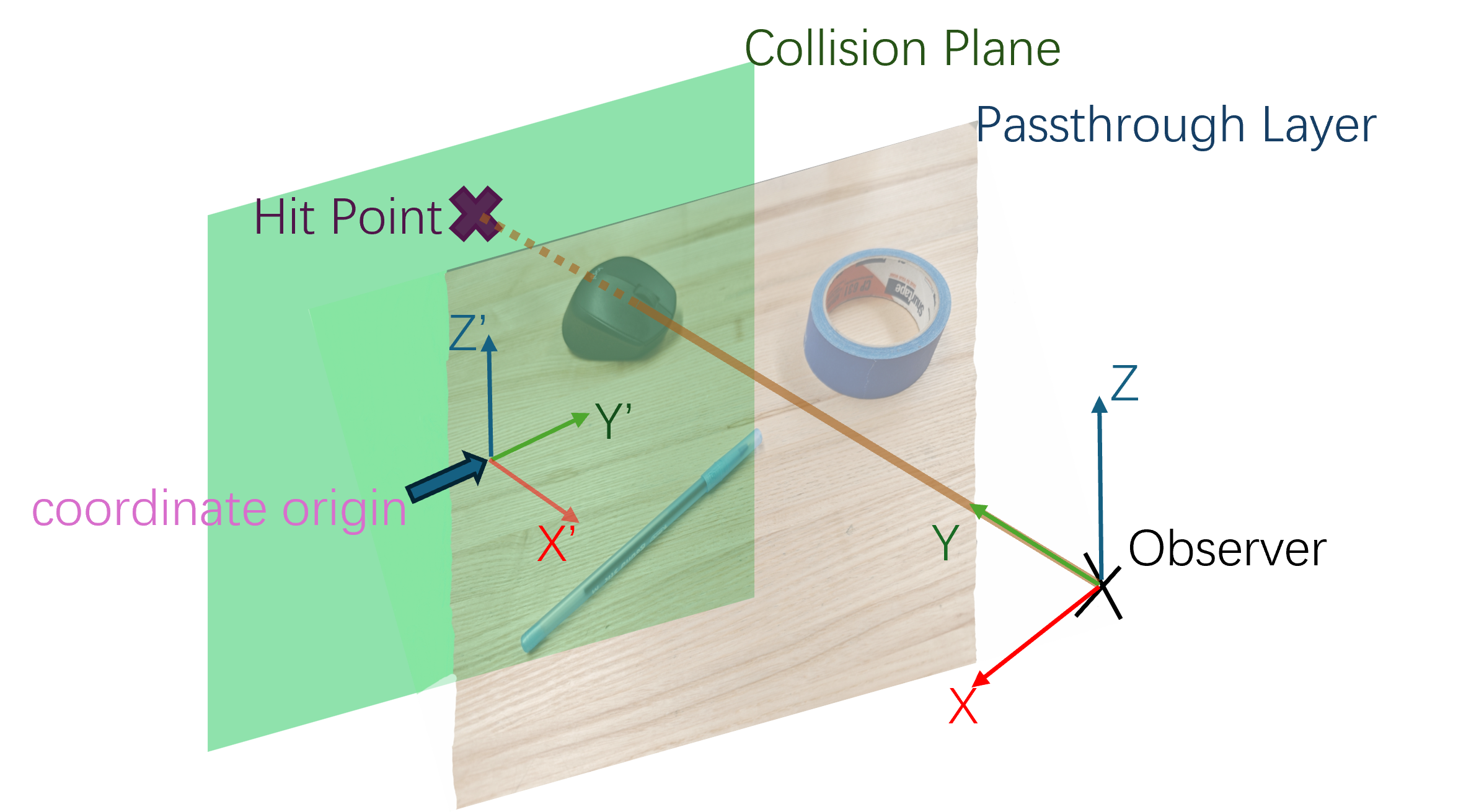

核心思路:该论文的核心思路是利用眼动追踪技术,结合可穿戴MR设备,构建一个以用户为中心的、直观的机器人操作界面。通过捕捉用户的眼动注视点,系统能够理解用户的操作意图,并控制机器人执行相应的动作。这种方式模拟了人类自然的操作方式,降低了学习成本,提高了操作效率。

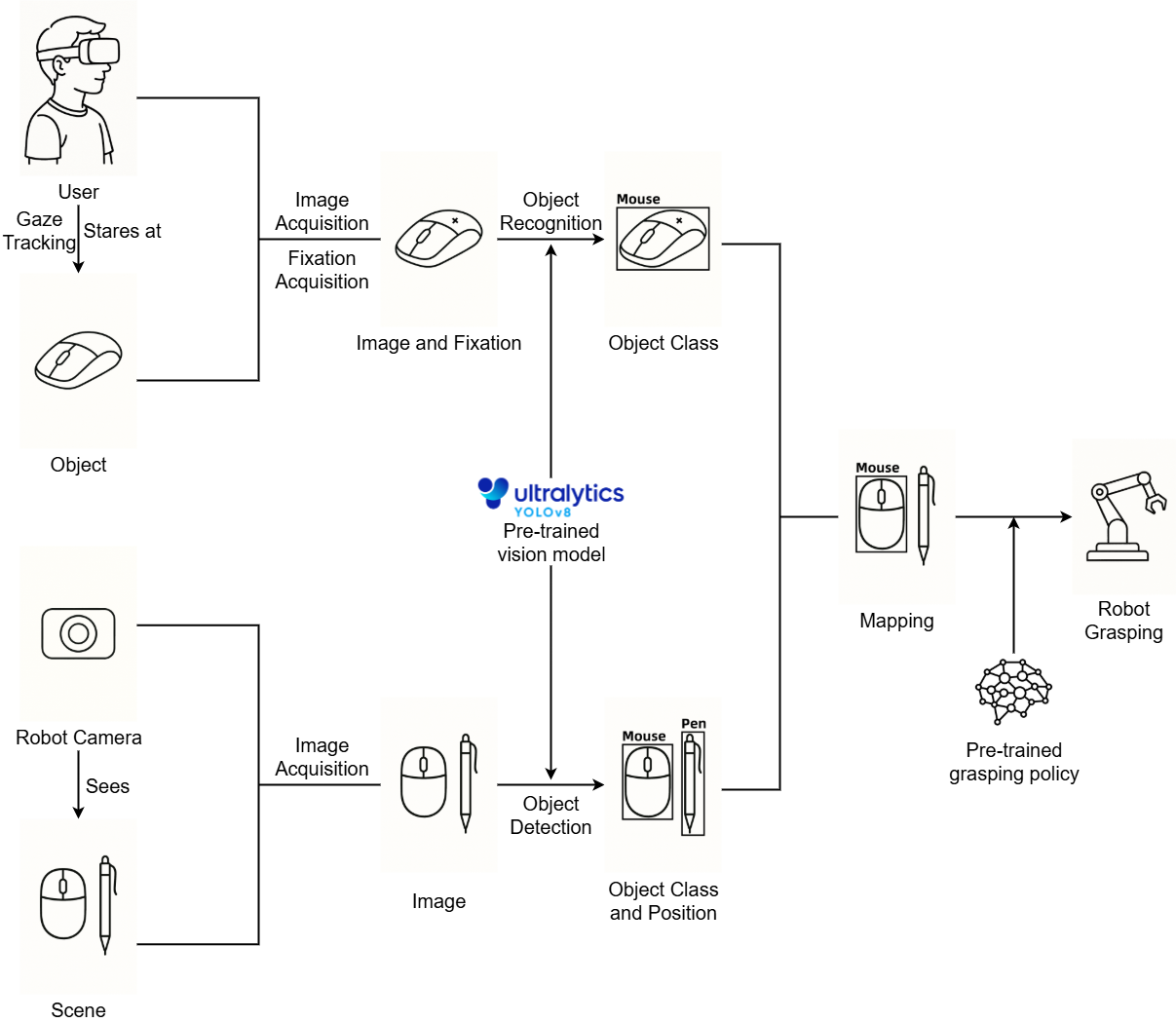

技术框架:该系统的整体架构包含以下几个主要模块:1) 眼动追踪模块:利用MR头显内置的眼动追踪传感器,捕捉用户的眼动数据。2) 意图识别模块:基于眼动数据和预训练的视觉模型,识别用户的操作意图,例如抓取哪个物体。3) 机器人控制模块:根据识别出的意图,控制机械臂执行相应的动作,例如移动到目标物体的位置,执行抓取动作。4) 视觉反馈模块:通过MR头显,向用户提供增强的视觉反馈,例如目标物体的轮廓、抓取路径等,帮助用户更好地理解和控制机器人。

关键创新:该论文最重要的技术创新点在于将眼动追踪技术与可穿戴MR设备相结合,构建了一个以人为中心的、直观的机器人操作界面。与传统的控制方式相比,该方法更加自然、直观,降低了学习成本,提高了操作效率。此外,该系统还利用预训练的视觉模型进行意图识别,提高了识别的准确性和鲁棒性。

关键设计:在眼动追踪方面,论文可能采用了卡尔曼滤波等算法来平滑眼动数据,提高追踪的精度。在意图识别方面,预训练的视觉模型可能采用了卷积神经网络(CNN)等结构,用于提取图像特征,并结合眼动数据进行意图分类。在机器人控制方面,可能采用了逆运动学等算法,将目标位置转换为机械臂的关节角度。具体的损失函数和网络结构等技术细节未知。

🖼️ 关键图片

📊 实验亮点

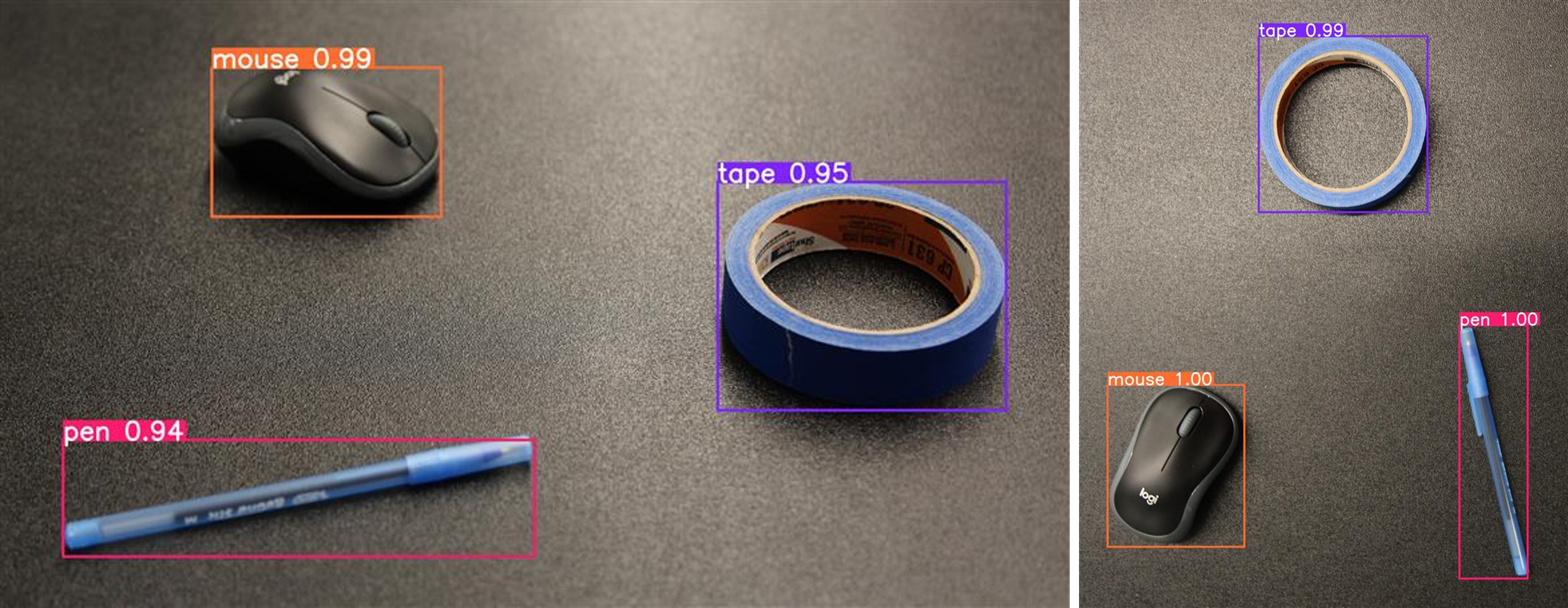

实验结果表明,该方法显著提高了操作精度,降低了系统延迟。在多个真实场景中,该系统实现了超过88%的单次意图和物体识别准确率。这些结果表明,该系统在增强直观性和可访问性方面具有显著优势,为辅助机器人应用提供了新的解决方案。

🎯 应用场景

该研究成果可广泛应用于辅助机器人领域,例如帮助行动不便人士进行日常物品的抓取和操作,提高他们的生活质量。此外,该技术还可以应用于工业机器人领域,例如在复杂环境中进行精细操作,提高生产效率和安全性。未来,该技术有望与更先进的AI技术相结合,实现更智能、更自主的机器人操作。

📄 摘要(原文)

Robotic manipulators are increasingly used to assist individuals with mobility impairments in object retrieval. However, the predominant joystick-based control interfaces can be challenging due to high precision requirements and unintuitive reference frames. Recent advances in human-robot interaction have explored alternative modalities, yet many solutions still rely on external screens or restrictive control schemes, limiting their intuitiveness and accessibility. To address these challenges, we present an egocentric, gaze-guided robotic manipulation interface that leverages a wearable Mixed Reality (MR) headset. Our system enables users to interact seamlessly with real-world objects using natural gaze fixation from a first-person perspective, while providing augmented visual cues to confirm intent and leveraging a pretrained vision model and robotic arm for intent recognition and object manipulation. Experimental results demonstrate that our approach significantly improves manipulation accuracy, reduces system latency, and achieves single-pass intention and object recognition accuracy greater than 88% across multiple real-world scenarios. These results demonstrate the system's effectiveness in enhancing intuitiveness and accessibility, underscoring its practical significance for assistive robotics applications.