Two-Steps Diffusion Policy for Robotic Manipulation via Genetic Denoising

作者: Mateo Clemente, Leo Brunswic, Rui Heng Yang, Xuan Zhao, Yasser Khalil, Haoyu Lei, Amir Rasouli, Yinchuan Li

分类: cs.RO, cs.AI

发布日期: 2025-10-24

备注: 16 pages, 11 figure, 2 tables, accepted at Neurips 2025

💡 一句话要点

提出基于遗传去噪的两步扩散策略,高效解决机器人操作任务。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 扩散策略 机器人操作 遗传算法 去噪过程 具身智能

📋 核心要点

- 现有扩散策略在机器人操作中直接沿用图像生成推理策略,忽略了动作分布的低维结构特性。

- 论文提出遗传去噪方法,通过种群采样选择低分布外风险的去噪轨迹,提升性能和稳定性。

- 实验结果表明,该方法仅需少量神经函数评估即可在多个机器人操作任务中取得显著性能提升。

📝 摘要(中文)

扩散模型,如扩散策略,通过模仿专家演示在机器人操作领域取得了最先进的结果。虽然扩散模型最初是为图像和视频生成等视觉任务开发的,但它们的许多推理策略都被直接转移到控制领域,而没有进行调整。本文表明,通过针对具身人工智能任务的特定特征(特别是动作分布的结构化、低维性质)定制去噪过程,扩散策略可以有效地运行,只需少量神经函数评估(NFE)。基于这一洞察,我们提出了一种基于种群的采样策略,即遗传去噪,通过选择具有低分布外风险的去噪轨迹来提高性能和稳定性。我们的方法仅用2个NFE即可解决具有挑战性的任务,同时提高或匹配性能。我们在来自D4RL和Robomimic的14个机器人操作任务中评估了我们的方法,涵盖了多个动作范围和推理预算。在超过200万次的评估中,我们的方法始终优于标准的基于扩散的策略,在显著减少推理步骤的同时,实现了高达20%的性能提升。

🔬 方法详解

问题定义:现有扩散策略在机器人操作任务中,直接套用图像生成领域的推理方法,忽略了机器人动作空间通常是低维且结构化的这一特点。这导致了计算效率低下,需要大量的神经函数评估(NFE)才能获得较好的性能。此外,直接应用扩散模型还可能导致分布外风险,影响策略的稳定性和泛化能力。

核心思路:论文的核心思路是针对机器人操作任务的特性,定制扩散模型的去噪过程。具体来说,利用动作分布的低维结构,设计更高效的采样策略,减少所需的NFE数量。同时,通过引入基于种群的采样方法(遗传去噪),选择具有较低分布外风险的轨迹,提高策略的鲁棒性和性能。

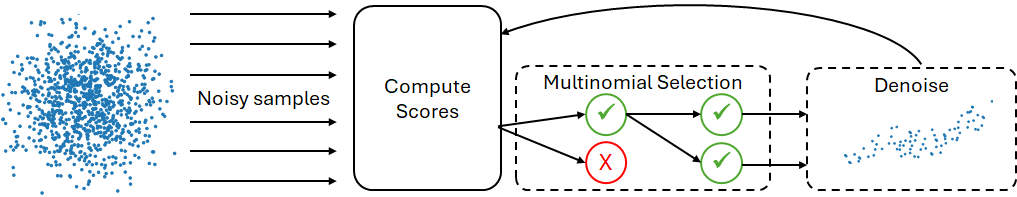

技术框架:该方法主要包含两个步骤:首先,利用扩散模型生成多个候选的去噪轨迹,形成一个种群。然后,使用遗传算法的思想,评估每个轨迹的质量,并选择具有较低分布外风险的轨迹作为最终的动作序列。整体流程可以概括为:扩散采样 -> 种群评估 -> 轨迹选择。

关键创新:最重要的技术创新点在于遗传去噪策略。与传统的扩散策略不同,该方法不是简单地执行固定的去噪步骤,而是通过种群采样和选择,动态地调整去噪过程。这种方法能够更好地适应机器人操作任务的特性,提高采样效率和策略的鲁棒性。

关键设计:在种群评估阶段,需要设计合适的指标来衡量轨迹的质量和分布外风险。论文可能采用了例如轨迹的平滑度、与专家演示的相似度、以及环境交互的合理性等指标。此外,遗传算法的选择策略(例如轮盘赌选择、锦标赛选择等)也会影响最终的性能。具体的网络结构和损失函数的设计细节需要在论文中进一步查找。

🖼️ 关键图片

📊 实验亮点

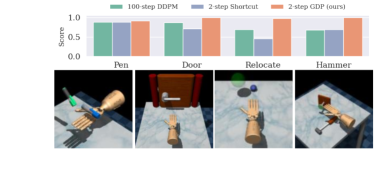

实验结果表明,该方法在D4RL和Robomimic的14个机器人操作任务中,仅使用2个NFE即可达到甚至超过标准扩散策略的性能,并且在某些任务中实现了高达20%的性能提升。在超过200万次的评估中,该方法始终优于基线方法,证明了其在提高采样效率和策略鲁棒性方面的有效性。

🎯 应用场景

该研究成果可广泛应用于各种机器人操作任务,例如物体抓取、装配、导航等。通过提高采样效率和策略鲁棒性,可以降低机器人部署的计算成本,并提高其在复杂环境中的适应能力。未来,该方法有望应用于更广泛的具身智能领域,例如自动驾驶、虚拟现实等。

📄 摘要(原文)

Diffusion models, such as diffusion policy, have achieved state-of-the-art results in robotic manipulation by imitating expert demonstrations. While diffusion models were originally developed for vision tasks like image and video generation, many of their inference strategies have been directly transferred to control domains without adaptation. In this work, we show that by tailoring the denoising process to the specific characteristics of embodied AI tasks -- particularly structured, low-dimensional nature of action distributions -- diffusion policies can operate effectively with as few as 5 neural function evaluations (NFE). Building on this insight, we propose a population-based sampling strategy, genetic denoising, which enhances both performance and stability by selecting denoising trajectories with low out-of-distribution risk. Our method solves challenging tasks with only 2 NFE while improving or matching performance. We evaluate our approach across 14 robotic manipulation tasks from D4RL and Robomimic, spanning multiple action horizons and inference budgets. In over 2 million evaluations, our method consistently outperforms standard diffusion-based policies, achieving up to 20\% performance gains with significantly fewer inference steps.