Butter-Bench: Evaluating LLM Controlled Robots for Practical Intelligence

作者: Callum Sharrock, Lukas Petersson, Hanna Petersson, Axel Backlund, Axel Wennström, Kristoffer Nordström, Elias Aronsson

分类: cs.RO, cs.AI

发布日期: 2025-10-23

💡 一句话要点

Butter-Bench:评估LLM控制机器人的实用智能水平

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人控制 大型语言模型 实用智能 基准测试 具身推理 空间规划 社交理解

📋 核心要点

- 现有机器人系统依赖LLM进行高层推理,但缺乏针对物理世界实用智能的专门评估。

- Butter-Bench通过隔离评估LLM在多步骤规划和社交理解等任务中的表现来衡量实用智能。

- 实验表明,即使是最先进的LLM在Butter-Bench上的表现也远低于人类,凸显了LLM在实用智能方面的不足。

📝 摘要(中文)

本文提出了Butter-Bench,一个用于评估大型语言模型(LLM)控制机器人在现实物理世界中实用智能的基准。目前最先进的机器人系统采用分层架构,其中LLM负责高层推理,而视觉语言动作(VLA)模型负责低层控制。Butter-Bench将LLM部分与VLA隔离进行评估。尽管LLM在需要分析智能的评估中多次超越人类,但我们发现人类在Butter-Bench上的表现仍然优于LLM。最佳LLM在Butter-Bench上的得分仅为40%,而人类的平均得分则为95%。LLM在多步骤空间规划和社交理解方面表现最差。我们还评估了针对具身推理进行微调的LLM,并得出结论,这种训练并没有提高它们在Butter-Bench上的得分。

🔬 方法详解

问题定义:现有机器人系统通常采用分层架构,LLM负责高层决策,VLA模型负责底层控制。然而,缺乏一个专门的基准来评估LLM在实际物理环境中的推理能力,尤其是在多步骤空间规划和社交理解方面。现有方法难以有效评估LLM在具身环境中的实用智能。

核心思路:Butter-Bench的核心思路是设计一系列任务,这些任务需要LLM具备在真实物理世界中进行推理和规划的能力。通过隔离评估LLM,可以更清晰地了解其在高层决策方面的优势和不足。该基准侧重于考察LLM在多步骤空间规划和社交理解方面的能力,这些能力对于机器人在现实世界中有效运行至关重要。

技术框架:Butter-Bench的评估流程包括:1) 定义一系列需要机器人完成的物理任务;2) 使用LLM生成完成任务的指令序列;3) 评估LLM生成的指令序列的质量,例如是否能够成功完成任务,是否符合人类的常识和期望。该框架允许研究人员独立评估LLM的性能,而无需考虑底层控制系统的影响。

关键创新:Butter-Bench的关键创新在于其专注于评估LLM在物理世界中的实用智能,而不仅仅是分析智能。它通过设计一系列需要多步骤推理和社交理解的任务,揭示了LLM在具身环境中的局限性。此外,该基准允许研究人员独立评估LLM的性能,从而更好地了解其在高层决策方面的优势和不足。

关键设计:Butter-Bench的任务设计涵盖了多步骤空间规划和社会理解。例如,一个任务可能要求机器人按照一系列指令移动物体,同时考虑到周围环境的限制。另一个任务可能要求机器人与人进行交互,并根据人的反应调整其行为。评估指标包括任务完成率、指令序列的合理性和与人类行为的相似度。具体参数设置和损失函数未知,因为该论文侧重于基准的构建和评估,而非特定模型的训练。

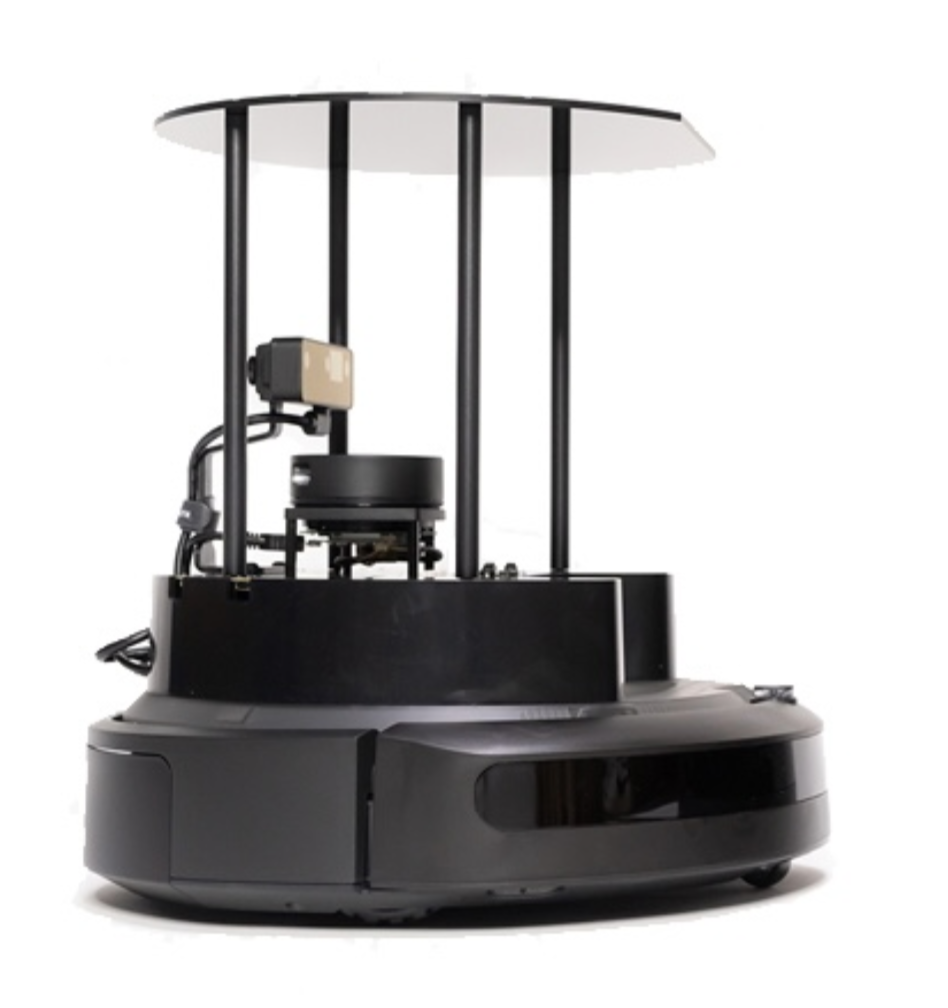

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使是最先进的LLM在Butter-Bench上的得分仅为40%,远低于人类的平均得分95%。这表明LLM在多步骤空间规划和社交理解方面存在显著差距。针对具身推理进行微调的LLM并没有在Butter-Bench上表现出明显的性能提升,暗示了现有微调方法的局限性。

🎯 应用场景

Butter-Bench可用于评估和改进LLM在机器人领域的应用,例如家庭服务机器人、工业自动化和自动驾驶。通过识别LLM在实用智能方面的不足,可以指导未来的研究方向,开发更智能、更可靠的机器人系统。该基准还有助于提高人机协作的效率和安全性。

📄 摘要(原文)

We present Butter-Bench, a benchmark evaluating large language model (LLM) controlled robots for practical intelligence, defined as the ability to navigate the messiness of the physical world. Current state-of-the-art robotic systems use a hierarchical architecture with LLMs in charge of high-level reasoning, and a Vision Language Action (VLA) model for low-level control. Butter-Bench evaluates the LLM part in isolation from the VLA. Although LLMs have repeatedly surpassed humans in evaluations requiring analytical intelligence, we find humans still outperform LLMs on Butter-Bench. The best LLMs score 40% on Butter-Bench, while the mean human score is 95%. LLMs struggled the most with multi-step spatial planning and social understanding. We also evaluate LLMs that are fine-tuned for embodied reasoning and conclude that this training does not improve their score on Butter-Bench.