HRT1: One-Shot Human-to-Robot Trajectory Transfer for Mobile Manipulation

作者: Sai Haneesh Allu, Jishnu Jaykumar P, Ninad Khargonkar, Tyler Summers, Jian Yao, Yu Xiang

分类: cs.RO

发布日期: 2025-10-23

备注: 14 pages, 11 figures and 3 tables. Project page is available at \url{https://irvlutd.github.io/HRT1/}

💡 一句话要点

HRT1:用于移动操作的单样本人-机器人轨迹迁移系统

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting)

关键词: 人-机器人交互 轨迹迁移 移动操作 单样本学习 机器人学习

📋 核心要点

- 现有机器人操作方法在泛化性和适应性方面存在挑战,难以快速适应新环境和物体摆放。

- 该论文提出一种基于单样本学习的人-机器人轨迹迁移系统,通过模仿人类演示视频实现机器人操作。

- 实验结果表明,该系统能够使移动操作机器人在不同环境中重复人类演示的操作任务,验证了其有效性。

📝 摘要(中文)

本文介绍了一种新颖的人-机器人轨迹迁移系统,该系统使机器人能够通过学习人类演示视频来操作物体。该系统包含四个模块:数据收集模块,用于使用AR头显从机器人的视角收集人类演示视频;视频理解模块,用于检测物体并从演示视频中提取3D人手轨迹;轨迹迁移模块,将人手轨迹转换为机器人末端执行器在3D空间中的参考轨迹;轨迹优化模块,利用轨迹优化算法求解机器人构型空间中的轨迹,使其能够跟随从人类演示中迁移的末端执行器轨迹。这些模块使机器人能够观看一次人类演示视频,然后在不同的环境中重复相同的移动操作任务,即使物体的放置与演示中不同。

🔬 方法详解

问题定义:现有机器人操作方法通常需要大量的训练数据或复杂的编程,难以快速适应新的环境和物体摆放。如何让机器人仅通过观看一次人类演示视频,就能学会并重复相同的移动操作任务,是本文要解决的核心问题。

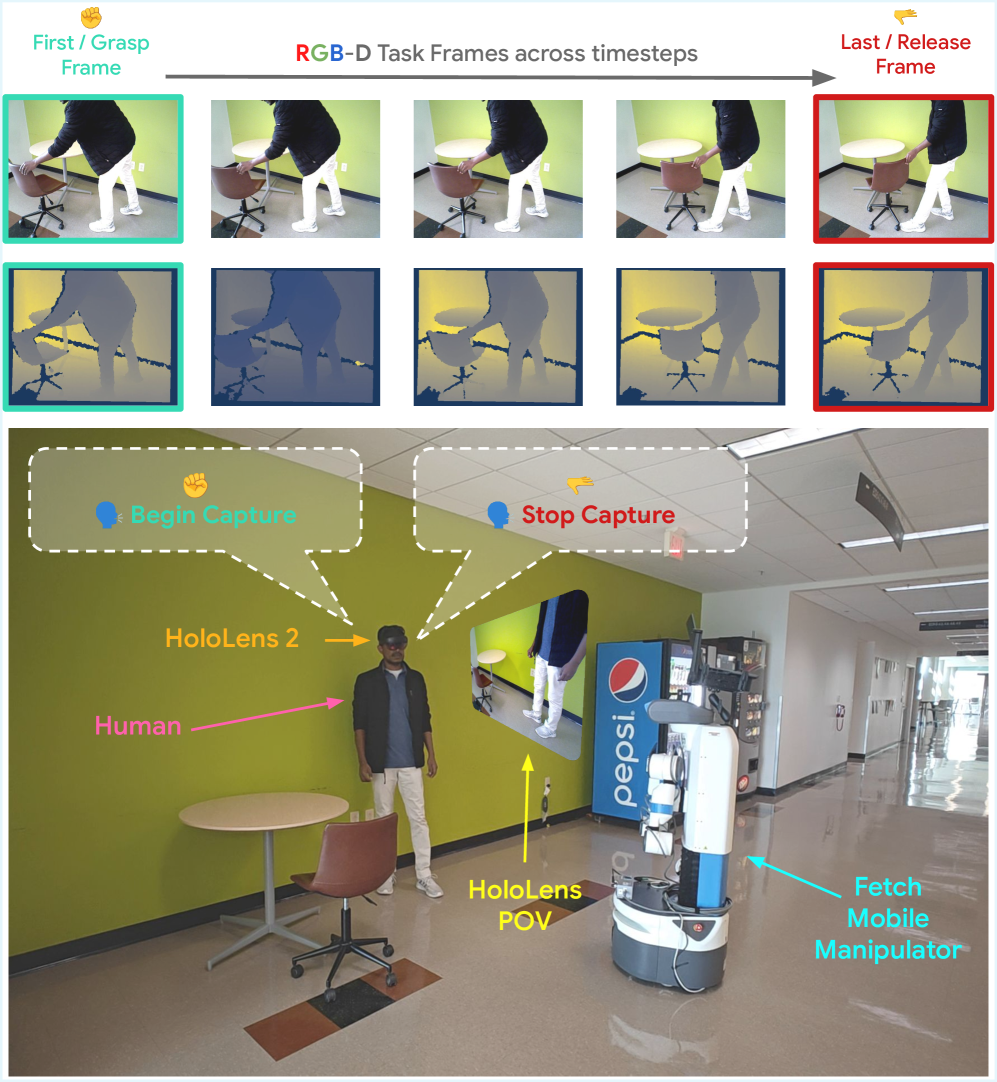

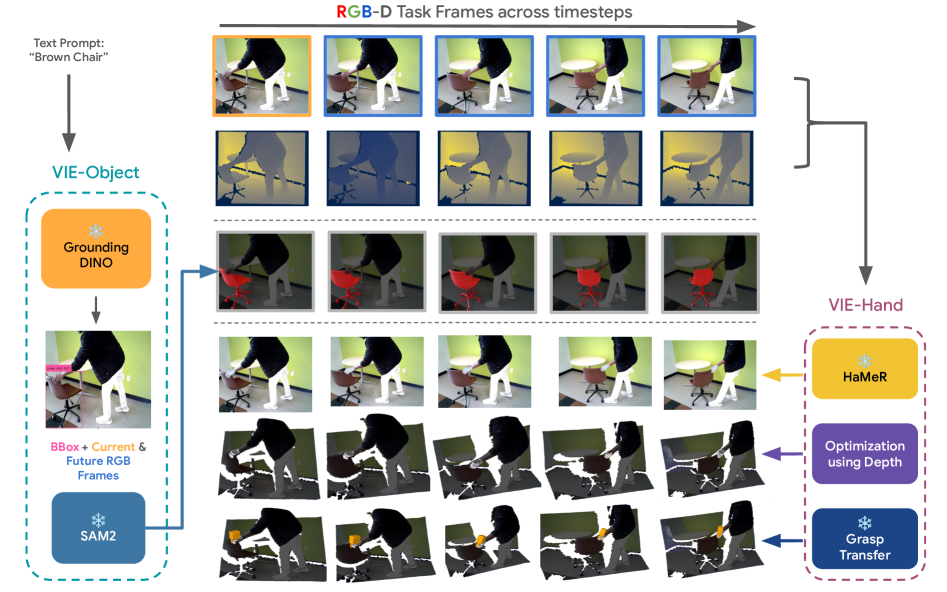

核心思路:该论文的核心思路是将人类的演示轨迹迁移到机器人上。通过AR头显获取人类操作的第一视角视频,提取人手轨迹,然后将该轨迹转换为机器人末端执行器的参考轨迹,最后通过轨迹优化算法生成机器人的运动轨迹。

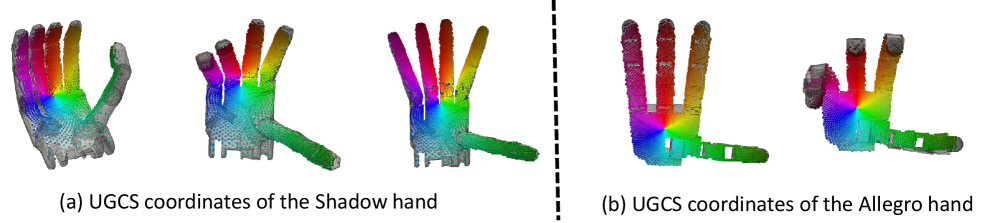

技术框架:该系统包含四个主要模块:1) 数据收集模块:使用AR头显从机器人的视角收集人类演示视频。2) 视频理解模块:检测视频中的物体,并提取3D人手轨迹。3) 轨迹迁移模块:将人手轨迹转换为机器人末端执行器的参考轨迹。4) 轨迹优化模块:利用轨迹优化算法,在机器人构型空间中生成可执行的轨迹。

关键创新:该论文的关键创新在于提出了一种单样本的人-机器人轨迹迁移方法,只需要一次人类演示,机器人就能学习并重复操作任务。此外,该系统能够处理物体位置变化的情况,提高了机器人的泛化能力。

关键设计:轨迹迁移模块的设计至关重要,需要考虑人手和机器人末端执行器的差异。轨迹优化模块需要根据机器人的运动学和动力学约束,生成平滑且可执行的轨迹。具体的参数设置、损失函数和网络结构等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

该论文通过在移动操作机器人上进行不同操作任务的实验,验证了系统的有效性。实验结果表明,该系统能够使机器人在不同的环境中重复人类演示的操作任务,即使物体的放置与演示中不同。具体的性能数据和对比基线在摘要中未提及,属于未知信息。

🎯 应用场景

该研究成果可应用于各种移动操作任务,例如家庭服务机器人、工业自动化、医疗辅助机器人等。通过模仿人类的操作,机器人可以快速学习新的任务,提高工作效率和灵活性。该技术还可以用于远程操作,使人类能够控制机器人执行危险或难以到达的任务。

📄 摘要(原文)

We introduce a novel system for human-to-robot trajectory transfer that enables robots to manipulate objects by learning from human demonstration videos. The system consists of four modules. The first module is a data collection module that is designed to collect human demonstration videos from the point of view of a robot using an AR headset. The second module is a video understanding module that detects objects and extracts 3D human-hand trajectories from demonstration videos. The third module transfers a human-hand trajectory into a reference trajectory of a robot end-effector in 3D space. The last module utilizes a trajectory optimization algorithm to solve a trajectory in the robot configuration space that can follow the end-effector trajectory transferred from the human demonstration. Consequently, these modules enable a robot to watch a human demonstration video once and then repeat the same mobile manipulation task in different environments, even when objects are placed differently from the demonstrations. Experiments of different manipulation tasks are conducted on a mobile manipulator to verify the effectiveness of our system