GRASPLAT: Enabling dexterous grasping through novel view synthesis

作者: Matteo Bortolon, Nuno Ferreira Duarte, Plinio Moreno, Fabio Poiesi, José Santos-Victor, Alessio Del Bue

分类: cs.RO, cs.CV

发布日期: 2025-10-22

备注: Accepted IROS 2025

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

GRASPLAT:通过新视角合成实现灵巧抓取的机器人方法

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱四:生成式动作 (Generative Motion)

关键词: 机器人抓取 新视角合成 3D高斯溅射 图像渲染 深度学习 灵巧操作 光度损失

📋 核心要点

- 现有机器人抓取方法依赖完整3D扫描,但在真实场景中难以获取高质量3D数据,限制了其应用。

- GRASPLAT通过合成手部抓取物体的逼真图像,并回归对应手部关节,实现仅用RGB图像训练的抓取。

- 实验结果表明,GRASPLAT在抓取成功率上显著优于现有基于图像的方法,最高提升达36.9%。

📝 摘要(中文)

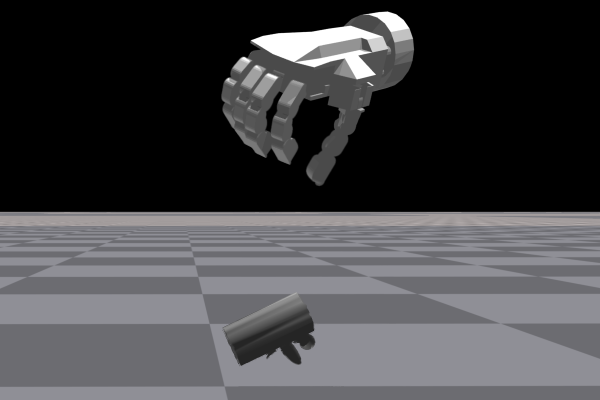

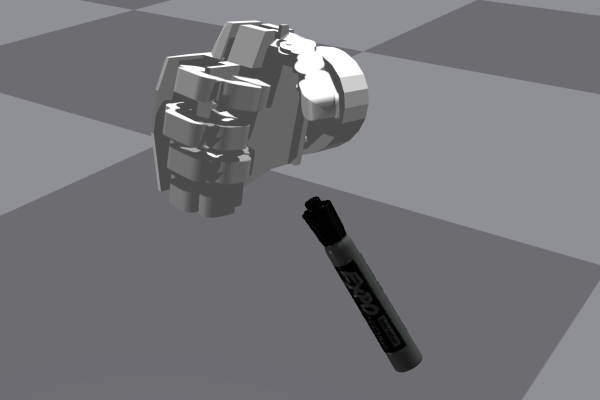

本文提出了一种名为GRASPLAT的新型抓取框架,旨在利用一致的3D信息,同时仅使用RGB图像进行训练,从而实现灵巧的机器人抓取。现有方法依赖于完整的3D扫描来预测抓取姿势,但难以在真实场景中获取高质量的3D数据。GRASPLAT的核心思想是通过合成手部抓取物体的物理上合理的图像,来回归成功抓取所需的相应手部关节。为此,我们利用3D高斯溅射生成真实手部-物体交互的高保真新视角,从而实现端到端的RGB数据训练。与现有方法不同,我们的方法包含一个光度损失,通过最小化渲染图像和真实图像之间的差异来优化抓取预测。在合成和真实抓取数据集上的大量实验表明,GRASPLAT相比现有的基于图像的方法,抓取成功率提高了高达36.9%。

🔬 方法详解

问题定义:论文旨在解决多指机械手灵巧抓取的问题。现有方法主要依赖于完整的3D扫描数据来预测抓取姿势,然而在实际应用中,获取高质量的3D数据往往面临诸多挑战,例如遮挡、光照变化等,这限制了这些方法在真实场景中的应用。

核心思路:GRASPLAT的核心思路是利用新视角合成技术,从RGB图像中学习抓取策略。通过合成手部抓取物体的逼真图像,并回归对应手部关节,从而避免了对完整3D数据的依赖。这种方法的核心在于,即使没有完整的3D信息,只要能生成足够逼真的图像,就可以训练出一个有效的抓取模型。

技术框架:GRASPLAT的整体框架包含以下几个主要步骤:1)使用RGB图像作为输入;2)利用3D高斯溅射(3D Gaussian Splatting)技术生成手部-物体交互的新视角图像;3)使用生成的新视角图像训练一个抓取预测模型,该模型可以回归成功抓取所需的相应手部关节;4)通过光度损失函数,最小化渲染图像和真实图像之间的差异,从而进一步优化抓取预测。

关键创新:GRASPLAT最重要的创新在于它将新视角合成技术与机器人抓取相结合,实现了仅使用RGB图像进行训练的抓取模型。与现有方法相比,GRASPLAT不需要完整的3D数据,因此更适用于真实场景。此外,GRASPLAT还引入了光度损失函数,通过最小化渲染图像和真实图像之间的差异来优化抓取预测,进一步提高了抓取成功率。

关键设计:GRASPLAT的关键设计包括:1)使用3D高斯溅射生成高保真新视角图像,保证了合成图像的逼真度;2)引入光度损失函数,通过最小化渲染图像和真实图像之间的差异来优化抓取预测;3)采用端到端的训练方式,使得整个模型可以联合优化。

🖼️ 关键图片

📊 实验亮点

GRASPLAT在合成和真实抓取数据集上进行了广泛的实验。在真实数据集上,GRASPLAT相比现有的基于图像的方法,抓取成功率提高了高达36.9%。实验结果表明,GRASPLAT能够有效地利用新视角合成技术来提高抓取性能,并且在真实场景中具有良好的泛化能力。

🎯 应用场景

GRASPLAT在机器人灵巧操作领域具有广泛的应用前景。它可以应用于工业自动化、家庭服务机器人、医疗机器人等领域,例如,在复杂的装配线上,机器人可以利用GRASPLAT准确抓取各种形状和大小的零件;在家庭环境中,服务机器人可以利用GRASPLAT帮助人们完成各种日常任务,如整理物品、递送物品等。该研究的未来影响在于,它有望推动机器人抓取技术的发展,使得机器人能够更好地适应真实世界的复杂环境。

📄 摘要(原文)

Achieving dexterous robotic grasping with multi-fingered hands remains a significant challenge. While existing methods rely on complete 3D scans to predict grasp poses, these approaches face limitations due to the difficulty of acquiring high-quality 3D data in real-world scenarios. In this paper, we introduce GRASPLAT, a novel grasping framework that leverages consistent 3D information while being trained solely on RGB images. Our key insight is that by synthesizing physically plausible images of a hand grasping an object, we can regress the corresponding hand joints for a successful grasp. To achieve this, we utilize 3D Gaussian Splatting to generate high-fidelity novel views of real hand-object interactions, enabling end-to-end training with RGB data. Unlike prior methods, our approach incorporates a photometric loss that refines grasp predictions by minimizing discrepancies between rendered and real images. We conduct extensive experiments on both synthetic and real-world grasping datasets, demonstrating that GRASPLAT improves grasp success rates up to 36.9% over existing image-based methods. Project page: https://mbortolon97.github.io/grasplat/