A Cross-Environment and Cross-Embodiment Path Planning Framework via a Conditional Diffusion Model

作者: Mehran Ghafarian Tamizi, Homayoun Honari, Amir Mehdi Soufi Enayati, Aleksey Nozdryn-Plotnicki, Homayoun Najjaran

分类: cs.RO, cs.AI

发布日期: 2025-10-21

备注: 20 pages, 9 figures

💡 一句话要点

提出GADGET,一种基于条件扩散模型的跨环境和机器人路径规划框架

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 路径规划 扩散模型 机器人 零样本迁移 控制屏障函数

📋 核心要点

- 传统路径规划方法计算耗时,参数调整繁琐,而现有基于学习的方法泛化能力不足,难以适应新环境和机器人。

- GADGET利用条件扩散模型,结合场景编码和控制屏障函数,在去噪过程中融入环境感知和实时避障,实现零样本迁移。

- 实验表明,GADGET在多种环境中表现出高成功率和低碰撞率,优于传统方法和学习方法,并成功迁移到不同机器人。

📝 摘要(中文)

本文提出了一种名为GADGET(Generalizable and Adaptive Diffusion-Guided Environment-aware Trajectory generation)的路径规划框架,旨在解决高维复杂环境中机器人路径规划的效率、安全性和泛化性问题。GADGET是一种基于扩散模型的规划模型,它以体素化的场景表示以及起始和目标配置为条件,生成关节空间轨迹。该框架的关键创新在于其混合双重条件机制,该机制结合了通过学习场景编码实现的无分类器引导和通过分类器引导的控制屏障函数(CBF)安全塑造,从而将环境感知与实时避障直接集成到去噪过程中。这种设计支持零样本迁移到新的环境和机器人,无需重新训练。实验结果表明,GADGET在球形障碍物、箱子拣选和货架环境中实现了高成功率和低碰撞强度,CBF引导进一步提高了安全性。此外,对比评估表明,相对于基于采样和基于学习的基线方法,GADGET 表现出强大的性能。GADGET 还提供了跨 Franka Panda、Kinova Gen3 (6/7-DoF) 和 UR5 机器人的可迁移性,并且在 Kinova Gen3 上的物理执行证明了其在现实环境中生成安全、无碰撞轨迹的能力。

🔬 方法详解

问题定义:论文旨在解决机器人路径规划在高维复杂环境中效率、安全性和泛化性不足的问题。现有方法,如传统采样算法计算成本高,需要大量参数调整;而基于学习的方法在新环境和机器人上泛化能力差,需要重新训练。

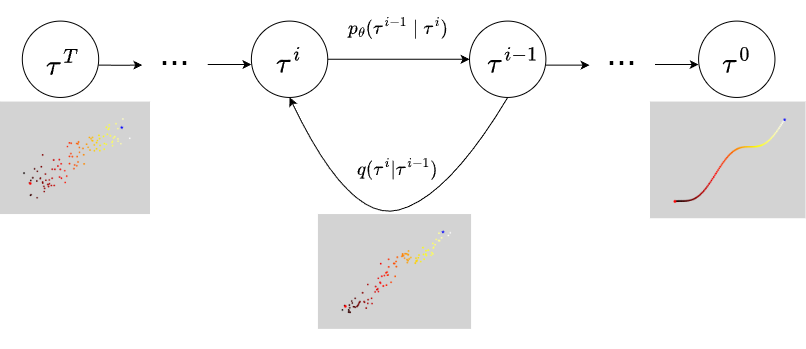

核心思路:论文的核心思路是利用条件扩散模型生成关节空间轨迹,并结合环境感知和安全约束,实现零样本迁移。通过将场景信息和安全约束融入到扩散模型的去噪过程中,使模型能够生成适应新环境和机器人的安全轨迹。

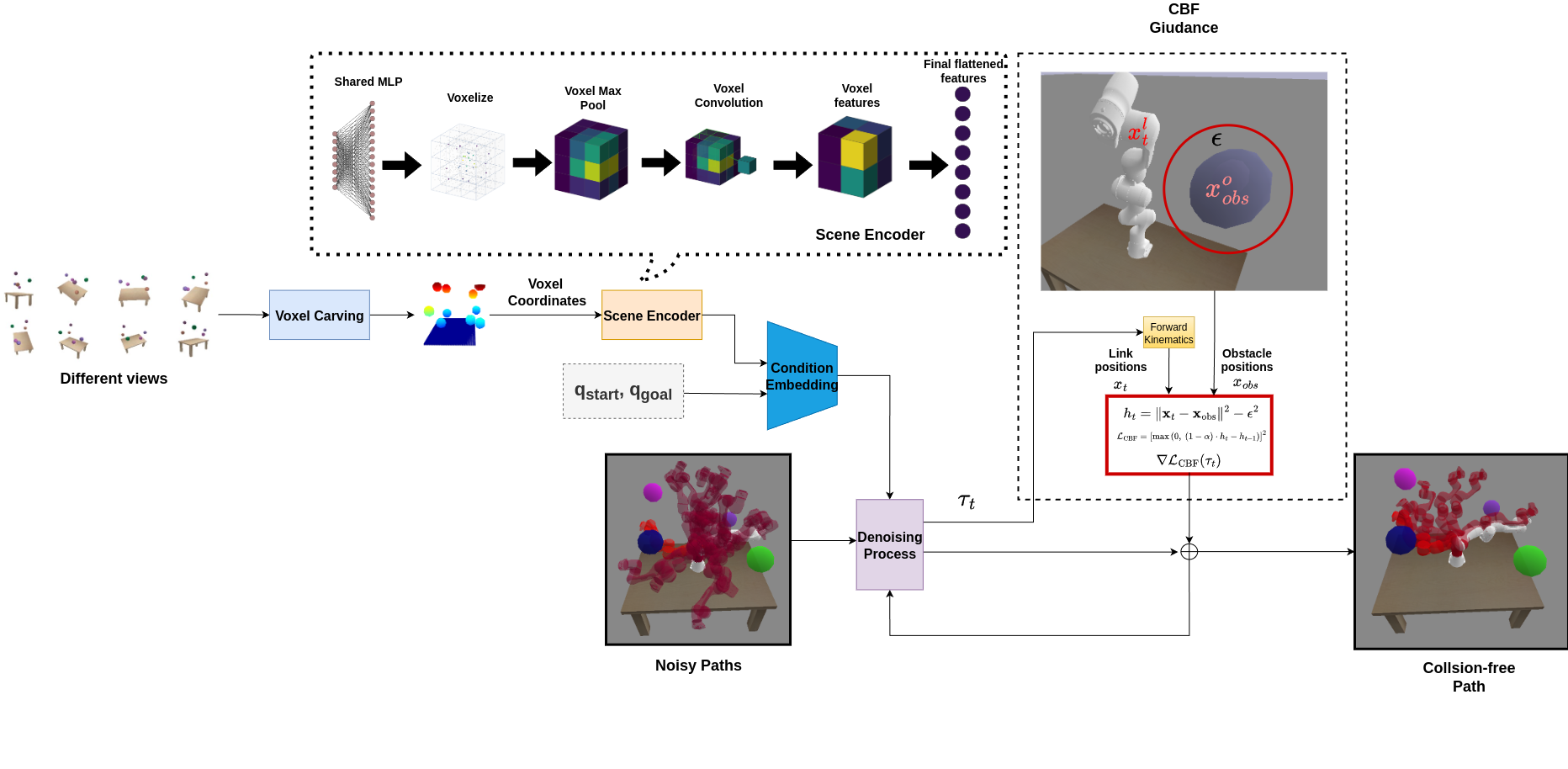

技术框架:GADGET框架主要包含以下几个模块:1) 场景编码器:将环境信息编码为体素化的表示;2) 条件扩散模型:以场景编码、起始和目标配置为条件,生成关节空间轨迹;3) 控制屏障函数(CBF)引导:利用CBF对轨迹进行安全约束,避免碰撞。整体流程是,首先将环境信息输入场景编码器,然后将场景编码、起始和目标配置输入条件扩散模型,最后利用CBF对生成的轨迹进行安全引导。

关键创新:GADGET的关键创新在于其混合双重条件机制,该机制结合了无分类器引导和分类器引导的CBF安全塑造。无分类器引导利用学习到的场景编码,使模型能够感知环境信息;分类器引导的CBF安全塑造则直接在去噪过程中对轨迹进行安全约束,避免碰撞。这种混合条件机制使得GADGET能够实现零样本迁移,无需重新训练。

关键设计:GADGET的关键设计包括:1) 使用体素化的场景表示,能够有效地捕捉环境信息;2) 使用条件扩散模型,能够生成高质量的关节空间轨迹;3) 使用控制屏障函数(CBF),能够对轨迹进行安全约束。具体的技术细节包括扩散模型的网络结构、损失函数,以及CBF的设计等。论文中可能还涉及一些超参数的设置,但具体数值未知。

🖼️ 关键图片

📊 实验亮点

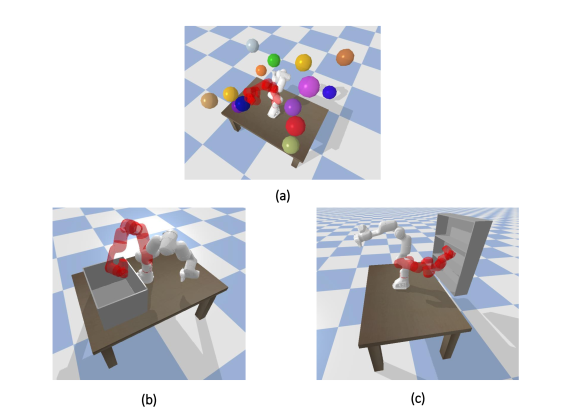

实验结果表明,GADGET在球形障碍物、箱子拣选和货架环境中实现了高成功率和低碰撞强度。与基于采样和基于学习的基线方法相比,GADGET表现出更强的性能。此外,GADGET能够成功迁移到Franka Panda、Kinova Gen3和UR5等不同机器人,并在Kinova Gen3上进行了物理实验,验证了其在现实环境中生成安全、无碰撞轨迹的能力。具体的性能提升数据未知。

🎯 应用场景

GADGET框架可应用于各种机器人路径规划场景,如工业自动化、物流仓储、家庭服务等。该框架能够提高机器人路径规划的效率、安全性和泛化性,降低部署成本,加速机器人应用落地。未来,该研究可进一步扩展到更复杂的环境和任务,例如动态环境下的路径规划、多机器人协同等。

📄 摘要(原文)

Path planning for a robotic system in high-dimensional cluttered environments needs to be efficient, safe, and adaptable for different environments and hardware. Conventional methods face high computation time and require extensive parameter tuning, while prior learning-based methods still fail to generalize effectively. The primary goal of this research is to develop a path planning framework capable of generalizing to unseen environments and new robotic manipulators without the need for retraining. We present GADGET (Generalizable and Adaptive Diffusion-Guided Environment-aware Trajectory generation), a diffusion-based planning model that generates joint-space trajectories conditioned on voxelized scene representations as well as start and goal configurations. A key innovation is GADGET's hybrid dual-conditioning mechanism that combines classifier-free guidance via learned scene encoding with classifier-guided Control Barrier Function (CBF) safety shaping, integrating environment awareness with real-time collision avoidance directly in the denoising process. This design supports zero-shot transfer to new environments and robotic embodiments without retraining. Experimental results show that GADGET achieves high success rates with low collision intensity in spherical-obstacle, bin-picking, and shelf environments, with CBF guidance further improving safety. Moreover, comparative evaluations indicate strong performance relative to both sampling-based and learning-based baselines. Furthermore, GADGET provides transferability across Franka Panda, Kinova Gen3 (6/7-DoF), and UR5 robots, and physical execution on a Kinova Gen3 demonstrates its ability to generate safe, collision-free trajectories in real-world settings.