Kinematic Analysis and Integration of Vision Algorithms for a Mobile Manipulator Employed Inside a Self-Driving Laboratory

作者: Shifa Sulaiman, Tobias Busk Jensen, Stefan Hein Bengtson, Simon Bøgh

分类: cs.RO

发布日期: 2025-10-21

备注: International Journal of Intelligent Robotics and Applications 2025

期刊: International Journal of Intelligent Robotics and Applications 2025

💡 一句话要点

针对自动驾驶实验室,提出移动机械臂的运动学分析与视觉算法集成方案

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 移动机械臂 运动学建模 视觉伺服 目标检测 姿态估计 自动驾驶实验室 人机协作

📋 核心要点

- 现有实验室自动化程度不足,依赖人工操作,效率和可重复性受限,难以满足高通量实验需求。

- 本文提出一种移动机械臂系统,结合运动学建模和视觉算法,实现自主抓取和操作,提升实验效率。

- 通过集成特征检测和单应性姿态估计的视觉方法,系统能够适应不同对象方向,实现鲁棒的自主操作。

📝 摘要(中文)

本文全面开发了一种移动机械臂,旨在辅助自动驾驶实验室(SDLs)中的人工操作员。基于Denavit Hartenberg (DH) 约定对机械臂进行运动学建模,并确定逆运动学解,以实现精确和自适应的操作能力。研究重点是增强机械臂可靠抓取纹理对象的能力,这是自主处理任务的关键组成部分。实施了先进的基于视觉的算法,以执行实时对象检测和姿态估计,从而引导机械臂进行动态抓取和跟随任务。本文集成了一种视觉方法,该方法将基于特征的检测与单应性驱动的姿态估计相结合,利用深度信息将对象姿态表示为3D空间中的2D平面投影。这种自适应能力使系统能够适应对象方向的变化,并支持在不同环境中进行鲁棒的自主操作。通过实现自主实验和人机协作,这项工作有助于下一代化学实验室的可扩展性和可重复性。

🔬 方法详解

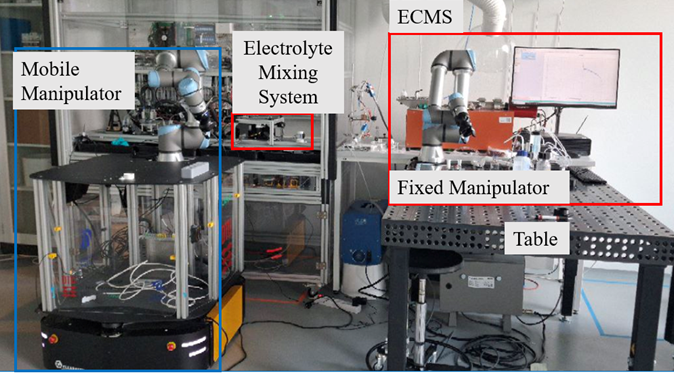

问题定义:在自动驾驶实验室中,需要一种能够自主操作的移动机械臂来辅助或替代人工完成实验任务。现有的机械臂系统在处理具有复杂纹理或姿态不确定的物体时,抓取成功率较低,难以满足实验室环境的鲁棒性要求。

核心思路:本文的核心思路是将机械臂的运动学建模与先进的视觉算法相结合,利用视觉信息引导机械臂进行精确的抓取操作。通过运动学建模,可以实现机械臂的精确控制;通过视觉算法,可以实现对目标物体的实时检测和姿态估计,从而提高抓取成功率。

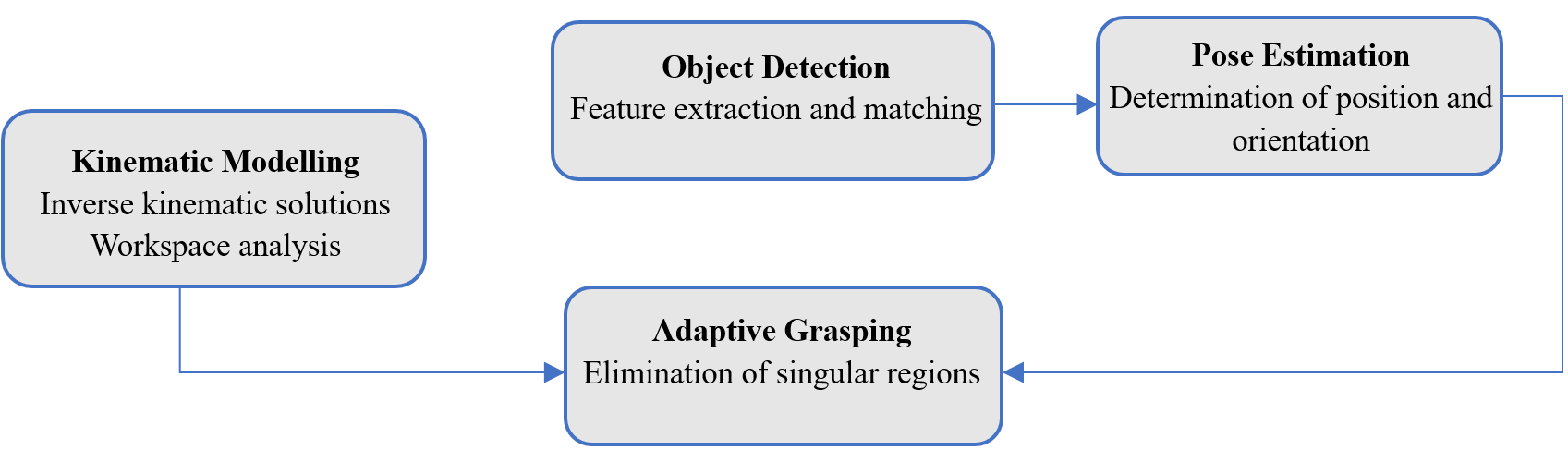

技术框架:该系统的整体架构包括以下几个主要模块:1) 机械臂运动学建模模块,基于DH参数建立机械臂的运动学模型,并求解逆运动学;2) 视觉感知模块,利用相机获取环境图像,并使用基于特征的检测方法和单应性矩阵估计目标物体的姿态;3) 抓取规划模块,根据视觉感知的结果,规划机械臂的抓取轨迹;4) 运动控制模块,控制机械臂按照规划的轨迹运动,完成抓取任务。

关键创新:该论文的关键创新在于将基于特征的检测与单应性驱动的姿态估计相结合,并利用深度信息将对象姿态表示为3D空间中的2D平面投影。这种方法能够有效地处理具有复杂纹理或姿态不确定的物体,提高抓取成功率。此外,将视觉信息与机械臂运动学模型相结合,实现了视觉引导的精确抓取。

关键设计:视觉感知模块中,使用了SURF等特征提取算法进行特征点检测,并使用RANSAC算法进行单应性矩阵估计,以消除噪声和异常值。深度信息用于将2D姿态投影到3D空间,从而提高姿态估计的准确性。抓取规划模块中,采用了基于优化的轨迹规划方法,以保证机械臂运动的平滑性和安全性。

🖼️ 关键图片

📊 实验亮点

论文重点在于视觉算法与机械臂的集成,通过特征检测和单应性估计实现了对纹理物体的鲁棒抓取。虽然文中没有给出明确的性能数据,但强调了该方法在适应物体方向变化方面的优势,并声称能够在不同环境中实现可靠的自主操作。未来的工作可以量化抓取成功率、抓取时间等指标,并与其他基线方法进行比较。

🎯 应用场景

该研究成果可应用于自动化化学合成、高通量筛选、药物发现等领域。通过部署移动机械臂,可以实现实验室的无人化操作,提高实验效率和可重复性,加速科学研究的进程。此外,该技术还可应用于其他需要自主操作的场景,如智能制造、物流分拣等。

📄 摘要(原文)

Recent advances in robotics and autonomous systems have broadened the use of robots in laboratory settings, including automated synthesis, scalable reaction workflows, and collaborative tasks in self-driving laboratories (SDLs). This paper presents a comprehensive development of a mobile manipulator designed to assist human operators in such autonomous lab environments. Kinematic modeling of the manipulator is carried out based on the Denavit Hartenberg (DH) convention and inverse kinematics solution is determined to enable precise and adaptive manipulation capabilities. A key focus of this research is enhancing the manipulator ability to reliably grasp textured objects as a critical component of autonomous handling tasks. Advanced vision-based algorithms are implemented to perform real-time object detection and pose estimation, guiding the manipulator in dynamic grasping and following tasks. In this work, we integrate a vision method that combines feature-based detection with homography-driven pose estimation, leveraging depth information to represent an object pose as a $2$D planar projection within $3$D space. This adaptive capability enables the system to accommodate variations in object orientation and supports robust autonomous manipulation across diverse environments. By enabling autonomous experimentation and human-robot collaboration, this work contributes to the scalability and reproducibility of next-generation chemical laboratories