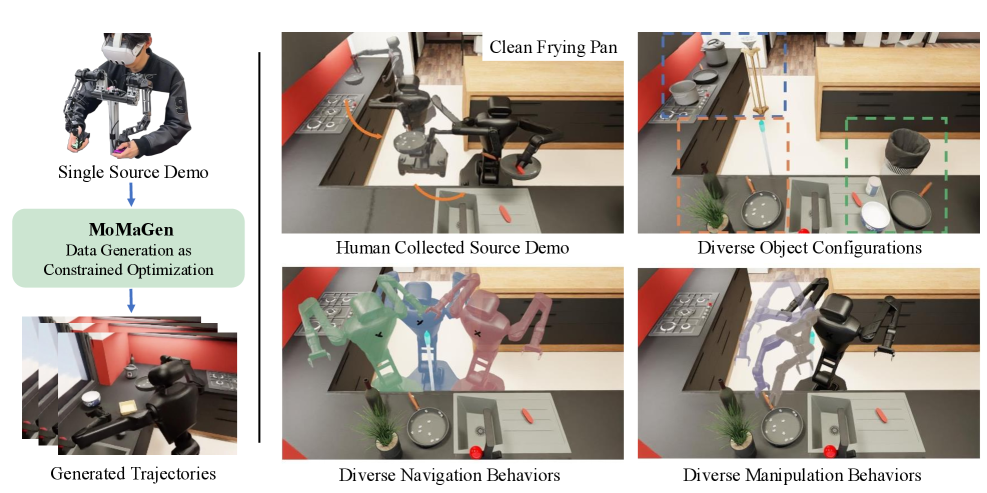

MoMaGen: Generating Demonstrations under Soft and Hard Constraints for Multi-Step Bimanual Mobile Manipulation

作者: Chengshu Li, Mengdi Xu, Arpit Bahety, Hang Yin, Yunfan Jiang, Huang Huang, Josiah Wong, Sujay Garlanka, Cem Gokmen, Ruohan Zhang, Weiyu Liu, Jiajun Wu, Roberto Martín-Martín, Li Fei-Fei

分类: cs.RO, cs.AI, cs.LG

发布日期: 2025-10-21

备注: Project website: momagen.github.io. The first four authors contribute equally

💡 一句话要点

MoMaGen:通过软硬约束生成多步双臂移动操作演示数据

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模仿学习 机器人操作 数据生成 约束优化 双臂机器人

📋 核心要点

- 多步双臂移动操作的数据收集成本高昂,现有方法难以同时保证底座可达性和相机视野。

- MoMaGen将数据生成建模为约束优化问题,兼顾硬约束(可达性)和软约束(导航可见性)。

- 实验表明,MoMaGen生成的数据集更具多样性,仅需少量真实数据微调即可部署到真实机器人。

📝 摘要(中文)

从大规模、多样化的人工演示中进行模仿学习已被证明对训练机器人有效,但收集此类数据的成本高昂且耗时。对于多步双臂移动操作,这一挑战更加严峻,因为人类必须遥控移动底座和两个高自由度手臂。先前的自动化数据生成框架通过在模拟中扩充少量人工演示来解决静态双臂操作问题,但由于两个关键挑战,它们在移动环境中表现不佳:(1) 确定底座位置以确保可达性,以及 (2) 定位相机以提供足够的视觉运动策略可见性。为了解决这些问题,我们引入了 MoMaGen,它将数据生成公式化为一个约束优化问题,该问题强制执行硬约束(例如,可达性),同时平衡软约束(例如,导航期间的可见性)。这种公式概括了先前的方法,并为未来的方法提供了原则性基础。我们在四个多步双臂移动操作任务上评估了 MoMaGen,并表明它生成的数据集比现有方法更加多样化。利用这种多样性,MoMaGen 可以从单个源演示中训练成功的模仿学习策略,并且可以使用少至 40 个真实世界的演示进行微调,以实现在物理机器人硬件上的部署。

🔬 方法详解

问题定义:论文旨在解决多步双臂移动操作中,模仿学习训练数据不足的问题。现有方法在移动机器人场景下,难以同时保证机械臂的可达性和相机视野,导致生成的数据质量不高,无法有效训练机器人。

核心思路:论文的核心思路是将数据生成过程建模为一个约束优化问题。通过显式地定义硬约束(如机械臂的可达性)和软约束(如相机视野),并使用优化算法来寻找满足这些约束的机器人配置,从而生成高质量的演示数据。这种方法能够有效地探索状态空间,生成多样化的数据。

技术框架:MoMaGen 的整体框架包含以下几个主要步骤: 1. 任务定义:定义需要完成的多步双臂移动操作任务。 2. 约束建模:对任务相关的硬约束(如可达性、碰撞避免)和软约束(如相机视野、运动平滑性)进行建模。 3. 优化求解:使用优化算法(如序列二次规划)求解约束优化问题,得到满足约束的机器人配置序列。 4. 数据生成:根据优化得到的机器人配置序列,生成演示数据。

关键创新:MoMaGen 的关键创新在于将数据生成建模为一个约束优化问题,并同时考虑了硬约束和软约束。这种方法能够有效地平衡可达性、可见性和运动质量,从而生成更适合模仿学习的数据。与现有方法相比,MoMaGen 能够生成更具多样性的数据集,并显著降低了对真实世界数据的依赖。

关键设计:MoMaGen 的关键设计包括: 1. 可达性约束:使用逆运动学求解器来确保机械臂能够到达目标位置。 2. 碰撞避免约束:使用碰撞检测算法来避免机器人与环境发生碰撞。 3. 相机视野约束:定义相机视野范围,并确保目标物体始终在视野内。 4. 运动平滑性约束:使用运动规划算法来生成平滑的机器人运动轨迹。 5. 优化目标函数:设计一个目标函数,用于平衡不同约束的重要性,并引导优化算法找到最优解。

🖼️ 关键图片

📊 实验亮点

MoMaGen 在四个多步双臂移动操作任务上进行了评估,结果表明,与现有方法相比,MoMaGen 生成的数据集更具多样性。使用 MoMaGen 生成的数据训练的模仿学习策略,仅需少量真实世界数据(40个演示)进行微调,即可在物理机器人硬件上实现部署,显著降低了对真实数据的依赖。

🎯 应用场景

MoMaGen 的潜在应用领域包括:自动化装配、物流分拣、家庭服务机器人等。通过生成高质量的演示数据,可以显著降低机器人学习的成本,加速机器人在复杂环境中的部署。该研究对于推动机器人技术在工业和生活中的应用具有重要意义。

📄 摘要(原文)

Imitation learning from large-scale, diverse human demonstrations has proven effective for training robots, but collecting such data is costly and time-consuming. This challenge is amplified for multi-step bimanual mobile manipulation, where humans must teleoperate both a mobile base and two high-degree-of-freedom arms. Prior automated data generation frameworks have addressed static bimanual manipulation by augmenting a few human demonstrations in simulation, but they fall short for mobile settings due to two key challenges: (1) determining base placement to ensure reachability, and (2) positioning the camera to provide sufficient visibility for visuomotor policies. To address these issues, we introduce MoMaGen, which formulates data generation as a constrained optimization problem that enforces hard constraints (e.g., reachability) while balancing soft constraints (e.g., visibility during navigation). This formulation generalizes prior approaches and provides a principled foundation for future methods. We evaluate MoMaGen on four multi-step bimanual mobile manipulation tasks and show that it generates significantly more diverse datasets than existing methods. Leveraging this diversity, MoMaGen can train successful imitation learning policies from a single source demonstration, and these policies can be fine-tuned with as few as 40 real-world demonstrations to achieve deployment on physical robotic hardware. More details are available at our project page: momagen.github.io.