R2BC: Multi-Agent Imitation Learning from Single-Agent Demonstrations

作者: Connor Mattson, Varun Raveendra, Ellen Novoseller, Nicholas Waytowich, Vernon J. Lawhern, Daniel S. Brown

分类: cs.RO, cs.AI, cs.MA

发布日期: 2025-10-20

备注: 9 pages, 6 figures

💡 一句话要点

R2BC:从单智能体演示中学习多智能体协作策略

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体 模仿学习 行为克隆 机器人 循环训练

📋 核心要点

- 多智能体模仿学习面临挑战,尤其是在人类难以提供联合动作空间演示时。

- R2BC通过循环方式,让人类依次演示单个智能体的行为,从而学习多智能体策略。

- 实验表明,R2BC在模拟和真实机器人任务中,性能可媲美甚至超越oracle行为克隆。

📝 摘要(中文)

模仿学习(IL)是人类训练机器人的一种自然方式,尤其是在容易获得高质量演示的情况下。虽然IL已广泛应用于单机器人环境,但相对较少的研究关注于将这些方法扩展到多智能体系统,特别是在单个人类必须为协作机器人团队提供演示的环境中。在本文中,我们介绍并研究了循环行为克隆(R2BC),这是一种使单个人类操作员能够通过顺序的单智能体演示有效地训练多机器人系统的方法。我们的方法允许人类一次远程操作一个智能体,并逐步地将多智能体行为教给整个系统,而无需在联合多智能体动作空间中进行演示。我们表明,R2BC方法在四个多智能体模拟任务中达到甚至超过了在特权同步演示上训练的oracle行为克隆方法的性能。最后,我们将R2BC部署在两个使用真实人类演示训练的物理机器人任务上。

🔬 方法详解

问题定义:现有的多智能体模仿学习方法通常需要提供所有智能体同步的联合动作演示,这在实际应用中往往难以实现,特别是当人类操作员需要同时控制多个机器人时。此外,直接将单智能体模仿学习方法扩展到多智能体系统,可能会导致智能体之间缺乏协调,无法学习到有效的协作策略。因此,如何仅通过单智能体演示来训练多智能体系统,是一个亟待解决的问题。

核心思路:R2BC的核心思想是利用循环(Round-Robin)的方式,让人类操作员依次控制每个智能体进行演示。通过这种方式,人类可以专注于单个智能体的行为,而无需考虑联合动作空间的复杂性。R2BC通过学习每个智能体的策略,并结合循环训练的方式,最终实现多智能体系统的协作行为。这种设计降低了人类操作员的负担,并简化了多智能体模仿学习的流程。

技术框架:R2BC的整体框架包括以下几个主要步骤:1) 人类操作员选择一个智能体进行远程操作,并提供一段时间的演示数据。2) 使用行为克隆(Behavior Cloning)方法,根据该智能体的演示数据训练其策略。3) 循环切换到下一个智能体,重复步骤1和2,直到所有智能体的策略都得到训练。4) 在多智能体环境中,所有智能体同时执行各自的策略,形成整体的协作行为。

关键创新:R2BC最重要的创新点在于其循环训练的方式,它将复杂的多智能体模仿学习问题分解为多个简单的单智能体模仿学习问题。这种分解方式降低了学习难度,并使得人类操作员可以更轻松地提供高质量的演示数据。此外,R2BC不需要在联合动作空间中进行演示,从而大大简化了数据收集的过程。

关键设计:R2BC的关键设计包括:1) 智能体选择策略:可以采用随机选择或基于智能体表现的选择策略,以平衡训练效率和智能体之间的协作。2) 行为克隆损失函数:可以使用标准的交叉熵损失函数或均方误差损失函数,具体取决于动作空间的类型。3) 循环训练次数:需要根据任务的复杂程度和智能体的数量,调整循环训练的次数,以确保所有智能体的策略都得到充分训练。

🖼️ 关键图片

📊 实验亮点

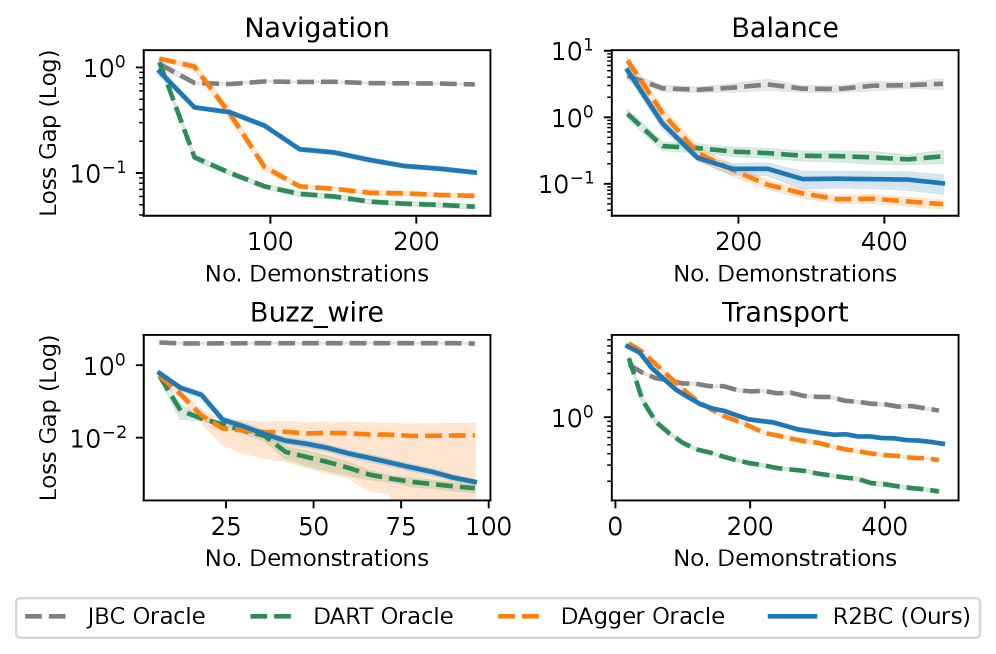

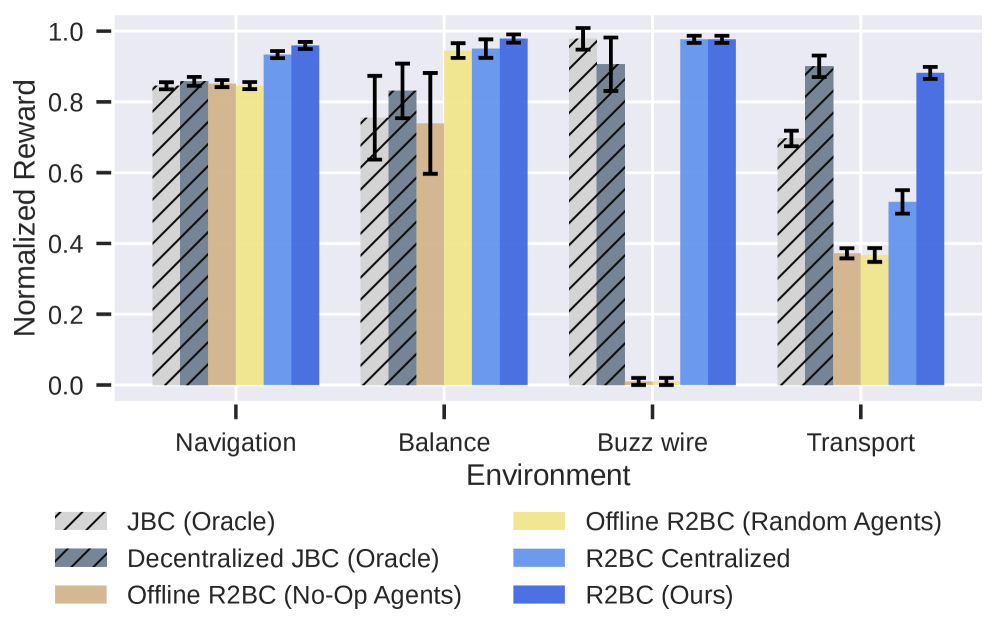

实验结果表明,R2BC在四个多智能体模拟任务中,性能与在同步演示上训练的oracle行为克隆方法相当,甚至在某些情况下超过了oracle方法。此外,R2BC还在两个真实的机器人任务中成功部署,证明了其在实际应用中的可行性。这些结果表明,R2BC是一种有效的多智能体模仿学习方法。

🎯 应用场景

R2BC方法具有广泛的应用前景,例如在多机器人协同搬运、多无人机协同搜索、以及多智能体游戏等领域。该方法可以降低多智能体系统训练的成本和难度,使得非专业人员也能轻松地训练机器人团队完成复杂的任务。未来,R2BC有望成为多智能体机器人领域的重要技术手段。

📄 摘要(原文)

Imitation Learning (IL) is a natural way for humans to teach robots, particularly when high-quality demonstrations are easy to obtain. While IL has been widely applied to single-robot settings, relatively few studies have addressed the extension of these methods to multi-agent systems, especially in settings where a single human must provide demonstrations to a team of collaborating robots. In this paper, we introduce and study Round-Robin Behavior Cloning (R2BC), a method that enables a single human operator to effectively train multi-robot systems through sequential, single-agent demonstrations. Our approach allows the human to teleoperate one agent at a time and incrementally teach multi-agent behavior to the entire system, without requiring demonstrations in the joint multi-agent action space. We show that R2BC methods match, and in some cases surpass, the performance of an oracle behavior cloning approach trained on privileged synchronized demonstrations across four multi-agent simulated tasks. Finally, we deploy R2BC on two physical robot tasks trained using real human demonstrations.