Implicit State Estimation via Video Replanning

作者: Po-Chen Ko, Jiayuan Mao, Yu-Hsiang Fu, Hsien-Jeng Yeh, Chu-Rong Chen, Wei-Chiu Ma, Yilun Du, Shao-Hua Sun

分类: cs.RO

发布日期: 2025-10-20

💡 一句话要点

提出基于视频重规划的隐式状态估计框架,提升交互式操作任务的适应性。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱八:物理动画 (Physics-based Animation)

关键词: 视频规划 隐式状态估计 重规划 在线学习 机器人操作

📋 核心要点

- 现有基于视频的规划方法难以适应交互过程中的失败,主要原因是它们无法处理部分观测环境中的不确定性。

- 该论文提出一种新框架,通过在线更新模型参数和过滤失败计划,将交互时的数据融入规划过程,实现隐式状态估计。

- 实验结果表明,该框架能够有效提高重规划性能,并在模拟操作基准测试中取得了显著进展。

📝 摘要(中文)

本文提出了一种新颖的框架,通过视频重规划进行隐式状态估计,旨在解决现有视频规划框架在部分观测环境中因无法处理不确定性而导致的交互失败问题。该方法将交互时的数据集成到规划过程中,在线更新模型参数,并过滤掉之前失败的计划。这种隐式状态估计使得系统能够动态适应环境,而无需显式建模未知的状态变量。通过在一个新的模拟操作基准上进行的大量实验,验证了该框架在提高重规划性能方面的能力,并推动了基于视频的决策领域的发展。

🔬 方法详解

问题定义:现有基于视频的规划方法在部分可观测的环境中,由于无法有效处理交互过程中的不确定性,导致在交互时遇到失败难以适应。这些方法通常依赖于预先训练的模型,无法根据实际交互数据进行动态调整,从而限制了其在复杂任务中的应用。

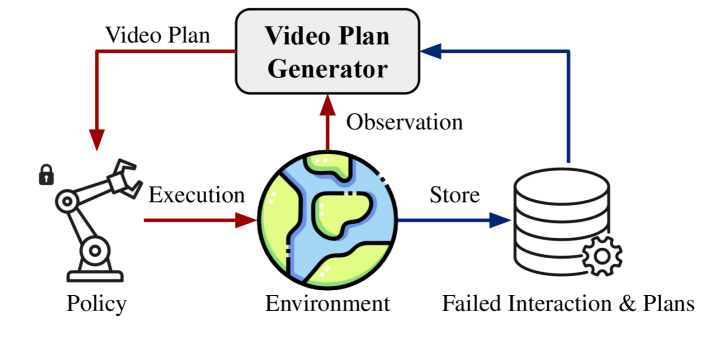

核心思路:论文的核心思路是利用交互过程中产生的数据,在线更新模型参数,并根据历史失败经验过滤掉不可行的计划。通过这种方式,系统能够隐式地估计环境状态,而无需显式地建模未知变量,从而提高对环境变化的适应能力。

技术框架:该框架主要包含以下几个阶段:1) 视频规划生成初始计划;2) 在交互过程中收集数据;3) 基于收集到的数据在线更新模型参数;4) 根据更新后的模型和历史失败经验,过滤掉不可行的计划;5) 基于剩余的计划进行重规划。整个框架通过不断迭代上述过程,实现对环境的动态适应。

关键创新:该论文的关键创新在于提出了隐式状态估计的概念,通过在线更新模型参数和过滤失败计划,实现了对环境状态的动态估计,而无需显式地建模未知变量。这种方法能够有效地处理部分可观测环境中的不确定性,提高了系统的鲁棒性和适应性。

关键设计:论文中涉及的关键设计可能包括:1) 用于视频规划的神经网络结构,例如Transformer或RNN;2) 在线更新模型参数的学习算法,例如梯度下降或贝叶斯优化;3) 用于过滤失败计划的策略,例如基于置信度的过滤或基于相似度的过滤;4) 损失函数的设计,可能包括重构损失、预测损失和一致性损失等。具体的参数设置和网络结构等技术细节在摘要中未提及,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文通过在一个新的模拟操作基准上进行了大量实验,验证了所提出的框架在提高重规划性能方面的能力。具体的性能数据和对比基线在摘要中未提及,属于未知信息。但实验结果表明,该方法能够有效地提高系统在不确定环境中的适应能力,并推动了基于视频的决策领域的发展。

🎯 应用场景

该研究成果可应用于机器人操作、自动驾驶、游戏AI等领域。通过提高系统在不确定环境中的适应能力,可以实现更智能、更可靠的自动化解决方案。例如,在机器人操作中,可以使机器人更好地处理物体的不确定性,完成更复杂的装配任务;在自动驾驶中,可以提高车辆在复杂交通环境中的安全性。

📄 摘要(原文)

Video-based representations have gained prominence in planning and decision-making due to their ability to encode rich spatiotemporal dynamics and geometric relationships. These representations enable flexible and generalizable solutions for complex tasks such as object manipulation and navigation. However, existing video planning frameworks often struggle to adapt to failures at interaction time due to their inability to reason about uncertainties in partially observed environments. To overcome these limitations, we introduce a novel framework that integrates interaction-time data into the planning process. Our approach updates model parameters online and filters out previously failed plans during generation. This enables implicit state estimation, allowing the system to adapt dynamically without explicitly modeling unknown state variables. We evaluate our framework through extensive experiments on a new simulated manipulation benchmark, demonstrating its ability to improve replanning performance and advance the field of video-based decision-making.