OmniVIC: A Self-Improving Variable Impedance Controller with Vision-Language In-Context Learning for Safe Robotic Manipulation

作者: Heng Zhang, Wei-Hsing Huang, Gokhan Solak, Arash Ajoudani

分类: cs.RO

发布日期: 2025-10-20 (更新: 2025-10-22)

备注: Code, video and RAG dataset are available at \url{https://sites.google.com/view/omni-vic}

💡 一句话要点

OmniVIC:基于视觉语言上下文学习的自适应变阻抗控制器,提升机器人操作安全性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 变阻抗控制 视觉语言模型 上下文学习 机器人操作 人机交互

📋 核心要点

- 传统变阻抗控制器在复杂、未知的接触交互任务中泛化性不足,难以保证安全性。

- OmniVIC利用视觉语言模型理解任务上下文,结合检索增强生成和上下文学习,自适应调整阻抗参数。

- 实验表明,OmniVIC在模拟和真实机器人任务中,显著提高了成功率并降低了力超出安全阈值的风险。

📝 摘要(中文)

本文提出了一种名为OmniVIC的通用变阻抗控制器(VIC),它通过视觉语言模型(VLM)增强,从而在任何接触丰富的机器人操作任务中提高安全性和适应性,以增强安全物理交互。传统的VIC在机器人与环境进行物理交互时表现出优势,但在涉及接触或不确定性的通用任务场景中,对于未见过的、复杂的和非结构化的安全交互缺乏泛化能力。为此,所提出的OmniVIC解释了从图像和自然语言中推导出的任务上下文,并为VIC控制器生成自适应阻抗参数。具体来说,OmniVIC的核心是自改进的检索增强生成(RAG)和上下文学习(ICL),其中RAG从结构化记忆库中检索相关的先前经验,以告知控制器关于类似的过去任务,而ICL利用这些检索到的示例和当前任务的提示来查询VLM,从而为当前的操纵场景生成上下文感知和自适应阻抗参数。因此,自改进的RAG和ICL保证了OmniVIC在通用任务场景中的工作能力。阻抗参数的调节进一步通过实时力/力矩反馈来告知,以确保交互力保持在安全阈值内。我们证明了我们的方法在模拟和真实世界的机器人任务中,在一套复杂的接触丰富的任务上优于基线,具有更高的成功率和更少的力违规。OmniVIC朝着桥接高层语义推理和低层顺应控制迈出了一步,从而实现了更安全和更通用的操作。总体而言,平均成功率从27%(基线)提高到61.4%(OmniVIC)。

🔬 方法详解

问题定义:现有机器人变阻抗控制器(VIC)在处理复杂、未知的接触交互任务时,泛化能力有限。它们难以根据任务的上下文信息(例如,视觉输入和自然语言描述)动态调整阻抗参数,从而导致任务失败或潜在的安全风险,例如力超出安全阈值。

核心思路:OmniVIC的核心思路是利用视觉语言模型(VLM)理解任务的上下文信息,并结合检索增强生成(RAG)和上下文学习(ICL)技术,自适应地生成合适的阻抗参数。通过从历史经验中学习,并根据当前任务的特点进行调整,OmniVIC能够更好地适应不同的接触交互场景,提高任务成功率和安全性。

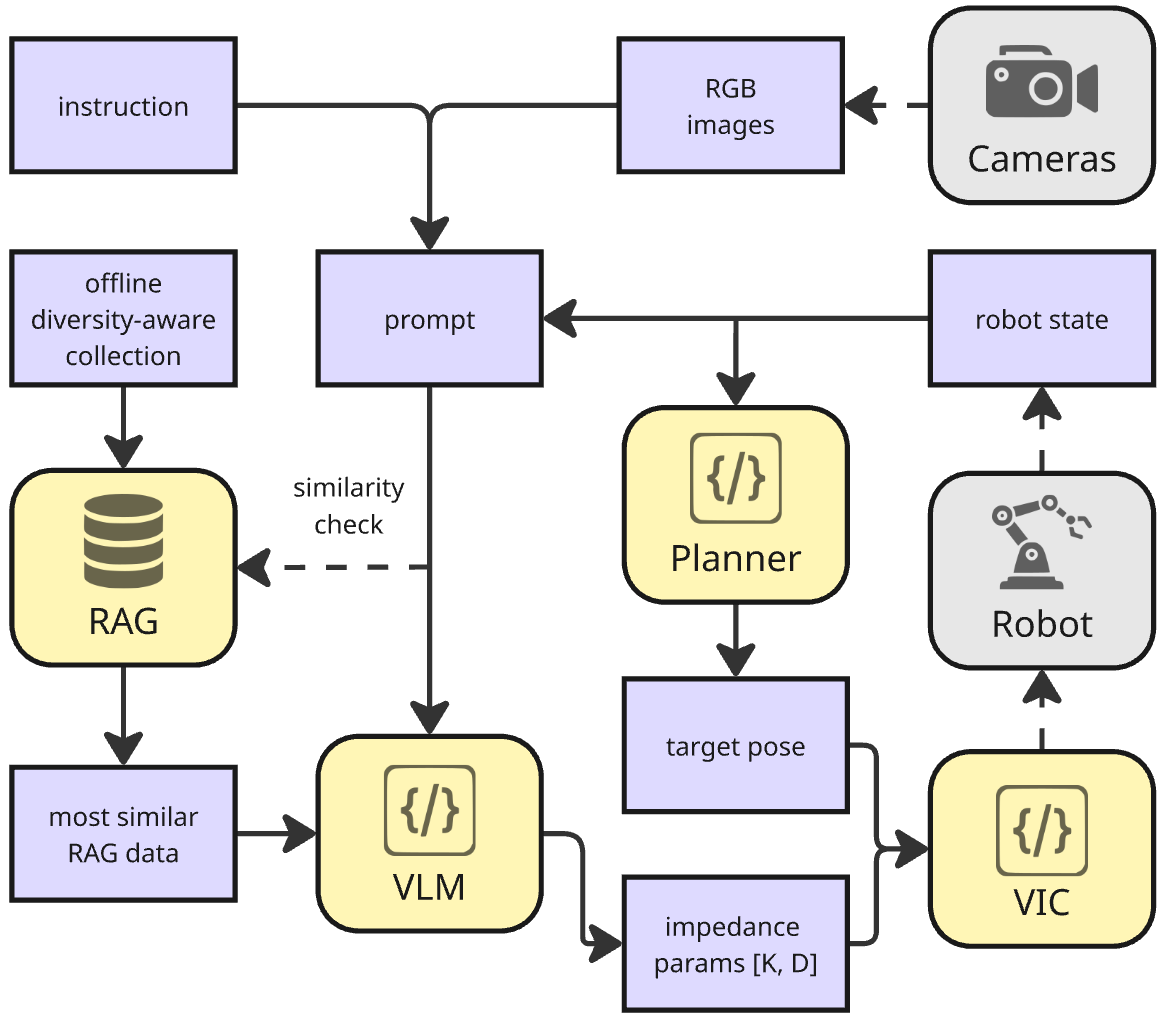

技术框架:OmniVIC的整体框架包括以下几个主要模块:1) 任务上下文理解模块:利用VLM从图像和自然语言描述中提取任务相关的语义信息。2) 检索增强生成模块:从结构化的记忆库中检索与当前任务相似的历史经验。3) 上下文学习模块:利用检索到的历史经验和当前任务的上下文信息,通过VLM生成自适应的阻抗参数。4) 变阻抗控制器:根据生成的阻抗参数,控制机器人的运动。5) 力/力矩反馈模块:实时监测交互力,并根据反馈信息调整阻抗参数,以确保安全性。

关键创新:OmniVIC的关键创新在于将视觉语言模型与变阻抗控制相结合,实现了上下文感知的自适应阻抗控制。通过RAG和ICL技术,OmniVIC能够从历史经验中学习,并根据当前任务的特点进行调整,从而提高了控制器的泛化能力和鲁棒性。与传统的VIC相比,OmniVIC能够更好地适应不同的接触交互场景,并保证安全性。

关键设计:OmniVIC的关键设计包括:1) 结构化的记忆库:用于存储历史任务的上下文信息和阻抗参数。2) VLM的选择和训练:选择合适的VLM,并针对机器人操作任务进行微调。3) RAG和ICL的实现:设计有效的检索策略和上下文学习方法,以提高阻抗参数生成的准确性和效率。4) 力/力矩反馈的控制策略:设计合适的控制策略,根据力/力矩反馈信息调整阻抗参数,以确保安全性。具体参数设置和损失函数等细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

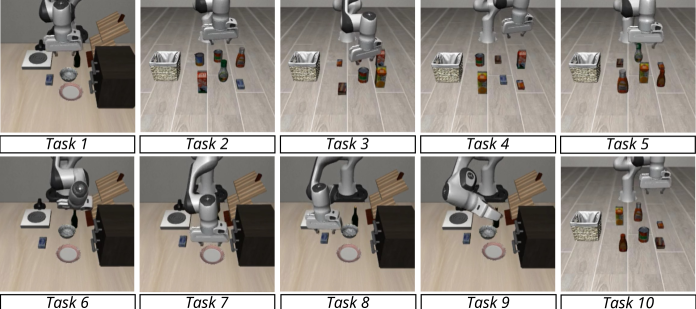

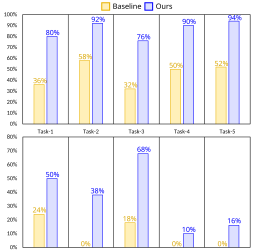

📊 实验亮点

OmniVIC在模拟和真实世界的机器人任务中都取得了显著的性能提升。在多个复杂的接触交互任务中,OmniVIC的平均成功率从基线的27%提高到61.4%。此外,OmniVIC还显著减少了力超出安全阈值的风险,表明其在保证机器人操作安全性方面的有效性。

🎯 应用场景

OmniVIC具有广泛的应用前景,例如:在医疗机器人领域,可以用于安全地进行手术操作;在工业机器人领域,可以用于灵活地进行装配和搬运任务;在家庭服务机器人领域,可以用于安全地与人进行交互。该研究有助于推动机器人技术在复杂和不确定环境中的应用,提高机器人的智能化水平和服务能力。

📄 摘要(原文)

We present OmniVIC, a universal variable impedance controller (VIC) enhanced by a vision language model (VLM), which improves safety and adaptation in any contact-rich robotic manipulation task to enhance safe physical interaction. Traditional VIC have shown advantages when the robot physically interacts with the environment, but lack generalization in unseen, complex, and unstructured safe interactions in universal task scenarios involving contact or uncertainty. To this end, the proposed OmniVIC interprets task context derived reasoning from images and natural language and generates adaptive impedance parameters for a VIC controller. Specifically, the core of OmniVIC is a self-improving Retrieval-Augmented Generation(RAG) and in-context learning (ICL), where RAG retrieves relevant prior experiences from a structured memory bank to inform the controller about similar past tasks, and ICL leverages these retrieved examples and the prompt of current task to query the VLM for generating context-aware and adaptive impedance parameters for the current manipulation scenario. Therefore, a self-improved RAG and ICL guarantee OmniVIC works in universal task scenarios. The impedance parameter regulation is further informed by real-time force/torque feedback to ensure interaction forces remain within safe thresholds. We demonstrate that our method outperforms baselines on a suite of complex contact-rich tasks, both in simulation and on real-world robotic tasks, with improved success rates and reduced force violations. OmniVIC takes a step towards bridging high-level semantic reasoning and low-level compliant control, enabling safer and more generalizable manipulation. Overall, the average success rate increases from 27% (baseline) to 61.4% (OmniVIC).