DexCanvas: Bridging Human Demonstrations and Robot Learning for Dexterous Manipulation

作者: Xinyue Xu, Jieqiang Sun, Jing, Dai, Siyuan Chen, Lanjie Ma, Ke Sun, Bin Zhao, Jianbo Yuan, Sheng Yi, Haohua Zhu, Yiwen Lu

分类: cs.RO, cs.LG

发布日期: 2025-10-17 (更新: 2025-10-23)

💡 一句话要点

DexCanvas:桥接人类演示与机器人学习的灵巧操作数据集

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 灵巧操作 机器人学习 强化学习 数据集 物理模拟 接触力 人机交互

📋 核心要点

- 现有机器人操作学习缺乏大规模、高质量、且包含物理信息的真实数据,限制了模型泛化能力和对复杂操作的理解。

- DexCanvas通过真实人类演示结合强化学习,生成大规模合成数据,并提供物理一致的接触力信息,弥补了现有数据集的不足。

- 该数据集包含7000小时数据,覆盖21种操作类型,并提供多视角RGB-D、运动捕捉和MANO参数,为机器人操作学习提供丰富资源。

📝 摘要(中文)

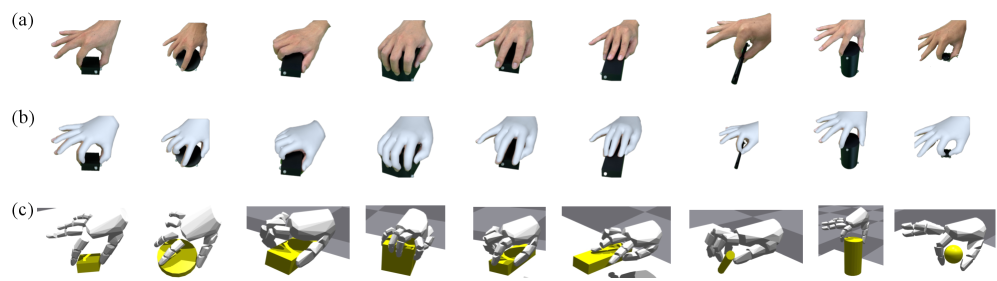

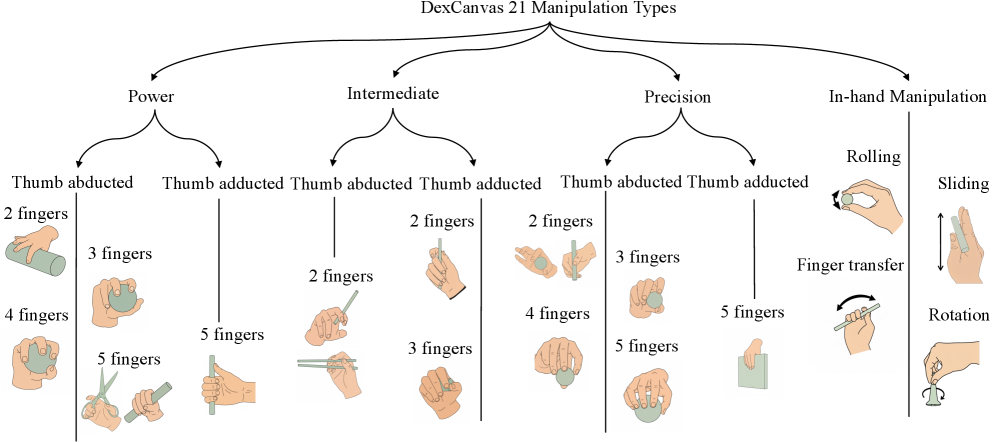

DexCanvas是一个大规模混合真实-合成的人类操作数据集,包含7000小时的灵巧手部-物体交互数据,这些数据源于70小时的真实人类演示,并根据Cutkosky分类法组织成21种基本操作类型。每个条目都结合了同步的多视角RGB-D数据、带有MANO手部参数的高精度运动捕捉数据,以及具有物理一致性力分布的每帧接触点。我们的真实到模拟的流程使用强化学习来训练策略,该策略控制物理模拟中驱动的MANO手,重现人类演示,同时发现产生观察到的物体运动的潜在接触力。DexCanvas是第一个结合大规模真实演示、基于已建立分类法的系统技能覆盖和物理验证的接触注释的操作数据集。该数据集可以促进机器人操作学习、富接触控制以及跨不同手部形态的技能转移方面的研究。

🔬 方法详解

问题定义:现有机器人灵巧操作学习面临的挑战是缺乏足够规模且包含丰富物理信息的训练数据。真实数据采集成本高昂,且难以获取精确的接触力和力矩信息。现有数据集往往规模较小,覆盖的操作类型有限,难以支持复杂操作的学习和泛化。

核心思路:论文的核心思路是利用少量真实人类演示作为种子,通过强化学习在物理模拟环境中训练机器人策略,生成大规模的合成数据。该方法能够自动探索不同的操作方式,并学习到潜在的接触力,从而弥补真实数据不足的问题。

技术框架:DexCanvas的整体框架包含以下几个主要阶段:1) 真实数据采集:收集70小时的人类灵巧操作演示数据,包括多视角RGB-D图像、运动捕捉数据和手部参数(MANO)。2) 强化学习训练:使用强化学习算法训练一个控制物理模拟环境中MANO手的策略,使其能够复现人类演示。3) 数据生成与标注:利用训练好的策略生成大规模的合成数据,并标注每帧的接触点和物理一致的力分布。4) 数据集构建:将真实数据和合成数据整合在一起,构建成DexCanvas数据集。

关键创新:该论文的关键创新在于提出了一种结合真实人类演示和强化学习的数据生成方法,能够自动生成大规模、高质量、且包含物理信息的灵巧操作数据集。与传统的纯合成数据相比,该方法生成的数据更接近真实场景,有助于提高机器人在真实环境中的操作性能。

关键设计:在强化学习训练过程中,论文使用了奖励函数来鼓励机器人复现人类演示,并探索不同的操作方式。此外,论文还设计了一种物理一致的力分布估计方法,能够根据物体运动和接触点信息,估计出每帧的接触力和力矩。

🖼️ 关键图片

📊 实验亮点

DexCanvas数据集是首个结合大规模真实演示、系统技能覆盖和物理验证接触注释的操作数据集。它包含7000小时的数据,覆盖21种操作类型,并提供多视角RGB-D、运动捕捉和MANO参数。通过强化学习生成的合成数据能够有效复现人类演示,并提供物理一致的接触力信息,为机器人操作学习提供高质量的训练数据。

🎯 应用场景

DexCanvas数据集可广泛应用于机器人灵巧操作学习、富接触控制、以及跨不同手部形态的技能迁移等领域。例如,可以利用该数据集训练机器人完成复杂的装配、抓取、操作等任务。此外,该数据集还可以用于研究人机协作、虚拟现实等领域,具有重要的学术价值和应用前景。

📄 摘要(原文)

We present DexCanvas, a large-scale hybrid real-synthetic human manipulation dataset containing 7,000 hours of dexterous hand-object interactions seeded from 70 hours of real human demonstrations, organized across 21 fundamental manipulation types based on the Cutkosky taxonomy. Each entry combines synchronized multi-view RGB-D, high-precision mocap with MANO hand parameters, and per-frame contact points with physically consistent force profiles. Our real-to-sim pipeline uses reinforcement learning to train policies that control an actuated MANO hand in physics simulation, reproducing human demonstrations while discovering the underlying contact forces that generate the observed object motion. DexCanvas is the first manipulation dataset to combine large-scale real demonstrations, systematic skill coverage based on established taxonomies, and physics-validated contact annotations. The dataset can facilitate research in robotic manipulation learning, contact-rich control, and skill transfer across different hand morphologies.