GaussGym: An open-source real-to-sim framework for learning locomotion from pixels

作者: Alejandro Escontrela, Justin Kerr, Arthur Allshire, Jonas Frey, Rocky Duan, Carmelo Sferrazza, Pieter Abbeel

分类: cs.RO, cs.AI, cs.GR

发布日期: 2025-10-17

💡 一句话要点

GaussGym:一种基于像素学习机器人运动的开源实-虚框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 机器人仿真 3D高斯溅射 强化学习 视觉感知 实-虚迁移

📋 核心要点

- 现有机器人仿真在速度和真实感之间难以兼顾,限制了大规模机器人学习的效率和泛化能力。

- GaussGym将3D高斯溅射作为渲染器集成到物理模拟器中,实现了高速度和高视觉保真度的平衡。

- 实验表明,该方法在导航和决策方面表现出色,并能轻松整合各种真实环境数据,促进机器人学习。

📝 摘要(中文)

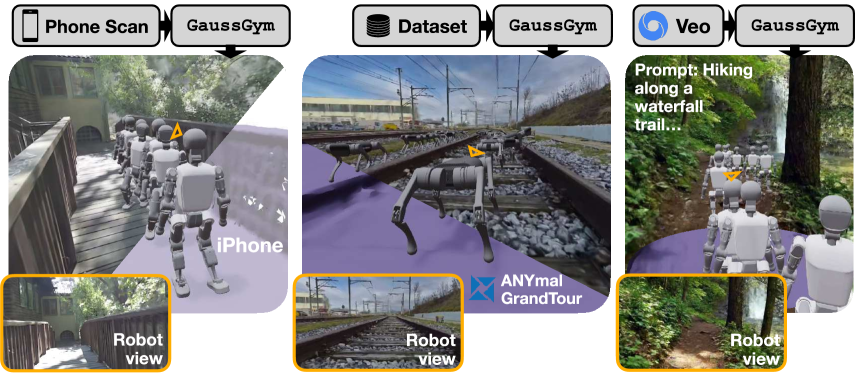

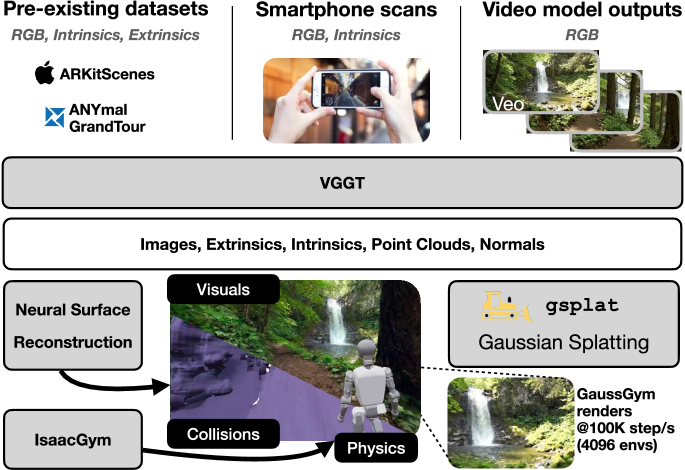

本文提出了一种新颖的逼真机器人仿真方法,该方法将3D高斯溅射集成到向量化物理模拟器(如IsaacGym)中,作为一种即插即用的渲染器。这实现了前所未有的速度——在消费级GPU上超过每秒100,000步——同时保持了高视觉保真度,我们在各种任务中展示了这一点。此外,我们还展示了其在实-虚机器人环境中的适用性。除了基于深度的感知之外,我们的结果还突出了丰富的视觉语义如何改善导航和决策,例如避免不良区域。我们进一步展示了从iPhone扫描、大型场景数据集(例如,GrandTour、ARKit)以及生成视频模型(如Veo)的输出中轻松整合数千个环境,从而能够快速创建逼真的训练世界。这项工作桥接了高吞吐量仿真和高保真感知,从而推进了可扩展和通用的机器人学习。所有代码和数据都将开源,供社区在此基础上进行构建。

🔬 方法详解

问题定义:现有机器人仿真方法通常难以在高吞吐量和高视觉逼真度之间取得平衡。传统的渲染方法计算成本高昂,限制了仿真速度,而简化的渲染方法则牺牲了真实感,影响了模型在真实环境中的泛化能力。因此,需要一种既能快速渲染又能提供足够视觉信息的仿真框架,以支持高效的机器人学习。

核心思路:GaussGym的核心思路是将3D高斯溅射(3D Gaussian Splatting)作为一种高效的渲染方法,集成到现有的向量化物理模拟器中。3D高斯溅射能够以相对较低的计算成本生成高质量的图像,从而在保证视觉逼真度的同时,实现高吞吐量的仿真。

技术框架:GaussGym的整体框架包括以下几个主要模块:1) 物理模拟器:使用如IsaacGym等向量化物理模拟器,负责机器人的运动学和动力学计算。2) 3D高斯溅射渲染器:将场景表示为一组3D高斯分布,并使用高效的渲染算法生成图像。3) 环境数据接口:支持从各种来源导入环境数据,包括iPhone扫描、大型场景数据集和生成视频模型。4) 机器人控制接口:提供与机器人控制算法的接口,实现基于视觉的机器人学习。

关键创新:GaussGym的关键创新在于将3D高斯溅射作为一种可微分的渲染器,无缝集成到物理模拟器中。这种集成使得可以利用梯度信息进行基于视觉的机器人学习,例如通过视觉反馈优化机器人控制策略。此外,该框架还支持快速导入和生成各种逼真的环境,从而大大提高了机器人学习的效率和泛化能力。

关键设计:GaussGym的关键设计包括:1) 高斯分布的参数化:每个高斯分布由其中心位置、协方差矩阵和颜色等参数表示。2) 可微分渲染:使用可微分的渲染算法,使得可以计算图像像素值对高斯分布参数的梯度。3) 损失函数:使用各种损失函数来优化机器人控制策略,例如基于图像相似度的损失函数和基于任务目标的损失函数。

🖼️ 关键图片

📊 实验亮点

GaussGym在消费级GPU上实现了超过每秒100,000步的仿真速度,同时保持了高视觉保真度。实验表明,使用GaussGym训练的机器人可以在复杂的环境中进行导航和决策,并能有效避免不良区域。此外,该框架还支持从各种来源导入环境数据,大大提高了机器人学习的效率。

🎯 应用场景

GaussGym具有广泛的应用前景,包括机器人导航、操作、抓取等任务的训练。它可以用于开发更智能、更鲁棒的机器人系统,应用于自动驾驶、物流、医疗等领域。此外,该框架还可以用于生成逼真的虚拟环境,用于游戏开发、电影制作等领域,具有重要的实际价值和未来影响。

📄 摘要(原文)

We present a novel approach for photorealistic robot simulation that integrates 3D Gaussian Splatting as a drop-in renderer within vectorized physics simulators such as IsaacGym. This enables unprecedented speed -- exceeding 100,000 steps per second on consumer GPUs -- while maintaining high visual fidelity, which we showcase across diverse tasks. We additionally demonstrate its applicability in a sim-to-real robotics setting. Beyond depth-based sensing, our results highlight how rich visual semantics improve navigation and decision-making, such as avoiding undesirable regions. We further showcase the ease of incorporating thousands of environments from iPhone scans, large-scale scene datasets (e.g., GrandTour, ARKit), and outputs from generative video models like Veo, enabling rapid creation of realistic training worlds. This work bridges high-throughput simulation and high-fidelity perception, advancing scalable and generalizable robot learning. All code and data will be open-sourced for the community to build upon. Videos, code, and data available at https://escontrela.me/gauss_gym/.