LVI-Q: Robust LiDAR-Visual-Inertial-Kinematic Odometry for Quadruped Robots Using Tightly-Coupled and Efficient Alternating Optimization

作者: Kevin Christiansen Marsim, Minho Oh, Byeongho Yu, Seungjae Lee, I Made Aswin Nahrendra, Hyungtae Lim, Hyun Myung

分类: cs.RO

发布日期: 2025-10-17

备注: 8 Pages, 9 Figures

期刊: IEEE Robotics and Automation Letters, vol. 10, no. 10, pp. 10050-10057, Oct. 2025

💡 一句话要点

提出LVI-Q:一种鲁棒的激光雷达-视觉-惯性-运动学里程计,用于四足机器人。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 四足机器人 激光雷达 视觉惯性里程计 传感器融合 运动学里程计

📋 核心要点

- 现有基于传感器融合的SLAM算法在复杂环境中易受漂移影响,原因是融合策略不当。

- LVI-Q系统融合激光雷达、视觉、惯性和运动学信息,采用交替优化策略,提升鲁棒性。

- 实验结果表明,LVI-Q在公开数据集和长期数据集上均表现出优异的性能。

📝 摘要(中文)

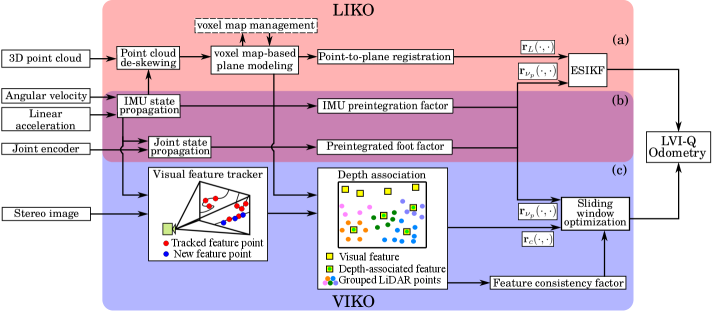

本文提出了一种鲁棒的激光雷达-视觉-惯性-运动学里程计系统(LVI-Q),旨在解决复杂动态环境中四足机器人自主导航问题。该系统融合了相机、激光雷达、惯性测量单元(IMU)和关节编码器等多传感器信息,用于视觉和激光雷达里程计估计。系统采用基于融合的位姿估计方法,根据测量数据的可用性,运行基于优化的视觉-惯性-运动学里程计(VIKO)和基于滤波的激光雷达-惯性-运动学里程计(LIKO)。在VIKO中,利用足部预积分技术和基于超像素聚类的鲁棒激光雷达-视觉深度一致性,进行滑动窗口优化。在LIKO中,结合足部运动学,并在误差状态迭代卡尔曼滤波器(ESIKF)中使用点到面残差。实验结果表明,与其它基于传感器融合的SLAM算法相比,该方法在公开和长期数据集上表现出更强的鲁棒性。

🔬 方法详解

问题定义:四足机器人在复杂和动态环境中自主导航需要精确的定位和建图。现有的基于传感器融合的SLAM方法在恶劣环境下容易出现估计漂移,影响导航的可靠性。这些方法通常依赖于次优的融合策略,无法充分利用多传感器信息的互补性。

核心思路:LVI-Q的核心思路是根据传感器数据的可用性,交替运行视觉-惯性-运动学里程计(VIKO)和激光雷达-惯性-运动学里程计(LIKO),并采用紧耦合的方式进行融合。VIKO侧重于视觉和惯性信息的融合,LIKO侧重于激光雷达和惯性信息的融合。通过这种交替优化策略,可以充分利用不同传感器的优势,提高系统的鲁棒性。

技术框架:LVI-Q系统主要包含两个并行运行的里程计模块:VIKO和LIKO。VIKO模块使用视觉和惯性信息,结合足部预积分和激光雷达-视觉深度一致性约束,进行滑动窗口优化。LIKO模块使用激光雷达和惯性信息,结合足部运动学约束,并在误差状态迭代卡尔曼滤波器(ESIKF)中进行位姿估计。系统根据传感器数据的可用性,动态选择运行哪个模块,并将两个模块的估计结果进行融合。

关键创新:LVI-Q的关键创新在于其紧耦合的交替优化策略。与传统的传感器融合方法不同,LVI-Q不是简单地将不同传感器的信息进行加权平均,而是根据数据的质量和可用性,动态选择最优的里程计模块。此外,LVI-Q还引入了足部预积分和激光雷达-视觉深度一致性约束,进一步提高了系统的精度和鲁棒性。

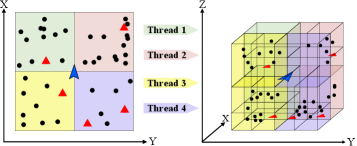

关键设计:在VIKO模块中,使用了超像素聚类来提高激光雷达-视觉深度一致性约束的鲁棒性。在LIKO模块中,使用了点到面残差来提高激光雷达里程计的精度。此外,系统还使用了误差状态迭代卡尔曼滤波器(ESIKF)来提高滤波器的稳定性和精度。足部预积分技术用于约束四足机器人的运动,减少漂移。

🖼️ 关键图片

📊 实验亮点

论文在公开数据集和长期数据集上进行了实验,结果表明LVI-Q系统具有优异的性能。与其它基于传感器融合的SLAM算法相比,LVI-Q在定位精度和鲁棒性方面均有显著提升。具体数据结果未知,但摘要强调了其在公开和长期数据集上的鲁棒性表现。

🎯 应用场景

LVI-Q系统可应用于各种四足机器人自主导航场景,例如复杂地形搜索救援、工业巡检、农业勘测等。该系统能够提高四足机器人在恶劣环境下的定位精度和导航可靠性,使其能够安全高效地完成任务。未来,该系统还可以扩展到其他类型的移动机器人,例如无人车和无人机。

📄 摘要(原文)

Autonomous navigation for legged robots in complex and dynamic environments relies on robust simultaneous localization and mapping (SLAM) systems to accurately map surroundings and localize the robot, ensuring safe and efficient operation. While prior sensor fusion-based SLAM approaches have integrated various sensor modalities to improve their robustness, these algorithms are still susceptible to estimation drift in challenging environments due to their reliance on unsuitable fusion strategies. Therefore, we propose a robust LiDAR-visual-inertial-kinematic odometry system that integrates information from multiple sensors, such as a camera, LiDAR, inertial measurement unit (IMU), and joint encoders, for visual and LiDAR-based odometry estimation. Our system employs a fusion-based pose estimation approach that runs optimization-based visual-inertial-kinematic odometry (VIKO) and filter-based LiDAR-inertial-kinematic odometry (LIKO) based on measurement availability. In VIKO, we utilize the footpreintegration technique and robust LiDAR-visual depth consistency using superpixel clusters in a sliding window optimization. In LIKO, we incorporate foot kinematics and employ a point-toplane residual in an error-state iterative Kalman filter (ESIKF). Compared with other sensor fusion-based SLAM algorithms, our approach shows robust performance across public and longterm datasets.