SkyDreamer: Interpretable End-to-End Vision-Based Drone Racing with Model-Based Reinforcement Learning

作者: Aderik Verraest, Stavrow Bahnam, Robin Ferede, Guido de Croon, Christophe De Wagter

分类: cs.RO

发布日期: 2025-10-16

💡 一句话要点

SkyDreamer:基于模型强化学习的可解释端到端视觉无人机竞速

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 无人机竞速 端到端控制 视觉导航 模型强化学习 Sim-to-Real迁移 世界模型 自主导航

📋 核心要点

- 现有自主无人机竞速系统虽然性能优异,但泛化性差,难以实现完全的sim-to-real迁移和板载执行。

- SkyDreamer利用informed Dreamer,通过世界模型解码特权信息,实现隐式状态和参数估计,提高可解释性。

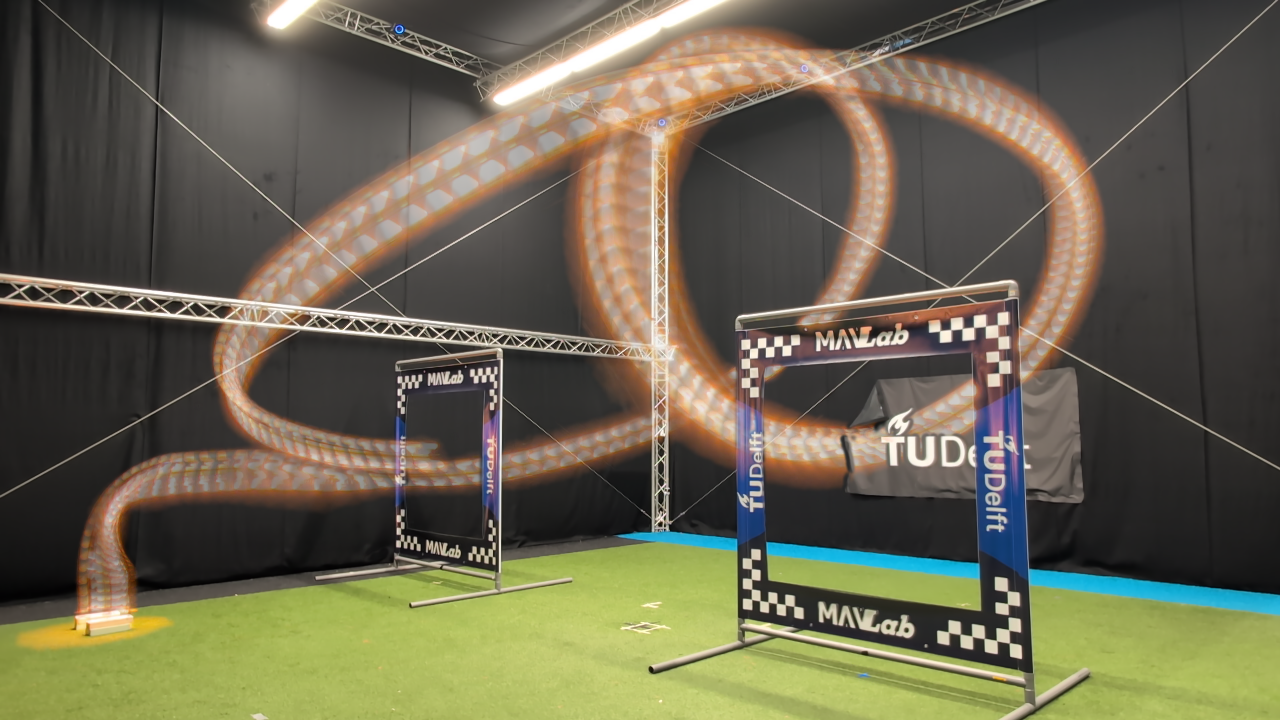

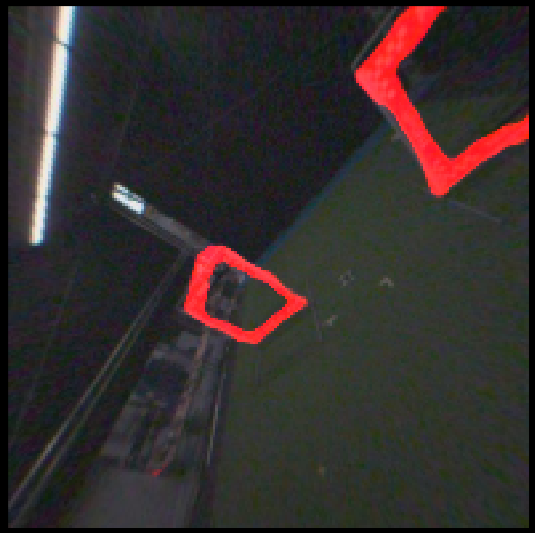

- 实验表明,SkyDreamer能够在真实环境中实现高速飞行和复杂机动,并对视觉质量和电池耗尽具有鲁棒性。

📝 摘要(中文)

自主无人机竞速(ADR)系统最近已达到冠军级水平,但仍然高度特定于无人机竞速。虽然端到端视觉方法有望实现更广泛的适用性,但迄今为止,还没有任何系统能够同时实现完全的sim-to-real迁移、板载执行和冠军级性能。本文提出了SkyDreamer,据我们所知,这是第一个端到端视觉ADR策略,可以直接从像素级表示映射到电机命令。SkyDreamer建立在informed Dreamer的基础上,这是一种基于模型的强化学习方法,其中世界模型解码为仅在训练期间可用的特权信息。通过将此概念扩展到端到端视觉ADR,世界模型有效地充当了隐式状态和参数估计器,大大提高了可解释性。SkyDreamer完全在板上运行,无需外部辅助,通过使用从世界模型的隐藏状态解码的状态来跟踪进度,从而解决视觉歧义,并且不需要外部相机校准,从而可以在不同的无人机上快速部署而无需重新训练。真实世界的实验表明,SkyDreamer实现了稳健、高速的飞行,执行了诸如倒环、split-S和梯子等高难度动作,达到了高达21米/秒的速度和高达6g的加速度。它进一步展示了非平凡的视觉sim-to-real迁移,通过对低质量的分割掩码进行操作,并通过准确估计最大可达到的电机RPM并实时调整其飞行路径,展示了对电池耗尽的鲁棒性。这些结果突出了SkyDreamer对现实差距的重要方面的适应性,在保持鲁棒性的同时,仍然实现了极高速、敏捷的飞行。

🔬 方法详解

问题定义:现有无人机竞速系统通常依赖于特定环境和复杂的外部传感器,难以实现端到端的视觉控制和sim-to-real迁移。痛点在于缺乏对环境状态的有效估计和对不同无人机的快速部署能力。

核心思路:SkyDreamer的核心思路是利用基于模型的强化学习,通过世界模型学习环境的隐式状态表示,并将其作为控制策略的输入。这种方法可以提高策略的可解释性,并减少对外部传感器的依赖。

技术框架:SkyDreamer的整体框架包括一个视觉感知模块、一个世界模型和一个控制策略。视觉感知模块负责将像素级的图像输入转换为特征表示。世界模型基于informed Dreamer,学习环境的动态模型,并解码出状态信息。控制策略根据世界模型的状态估计输出电机控制指令。

关键创新:SkyDreamer的关键创新在于将informed Dreamer扩展到端到端的视觉控制,使得世界模型能够从像素输入中学习环境状态,并将其用于控制策略。这种方法实现了完全的sim-to-real迁移和板载执行,无需外部相机校准。

关键设计:SkyDreamer的关键设计包括使用低质量分割掩码进行训练以提高sim-to-real的鲁棒性,以及通过估计最大电机RPM来应对电池耗尽。此外,网络结构和损失函数的设计也旨在提高世界模型的预测精度和控制策略的性能。

🖼️ 关键图片

📊 实验亮点

SkyDreamer在真实环境中实现了高达21 m/s的速度和6g的加速度,成功执行了倒环、split-S和梯子等复杂机动。它还展示了对低质量分割掩码的鲁棒性,并通过实时调整飞行路径来应对电池耗尽。这些结果表明SkyDreamer在现实环境中具有出色的性能和适应性。

🎯 应用场景

SkyDreamer具有广泛的应用前景,包括自主导航、搜索救援、环境监测等领域。其端到端视觉控制和sim-to-real迁移能力可以降低部署成本,提高系统的鲁棒性和适应性。未来,该技术有望应用于更复杂的环境和任务中。

📄 摘要(原文)

Autonomous drone racing (ADR) systems have recently achieved champion-level performance, yet remain highly specific to drone racing. While end-to-end vision-based methods promise broader applicability, no system to date simultaneously achieves full sim-to-real transfer, onboard execution, and champion-level performance. In this work, we present SkyDreamer, to the best of our knowledge, the first end-to-end vision-based ADR policy that maps directly from pixel-level representations to motor commands. SkyDreamer builds on informed Dreamer, a model-based reinforcement learning approach where the world model decodes to privileged information only available during training. By extending this concept to end-to-end vision-based ADR, the world model effectively functions as an implicit state and parameter estimator, greatly improving interpretability. SkyDreamer runs fully onboard without external aid, resolves visual ambiguities by tracking progress using the state decoded from the world model's hidden state, and requires no extrinsic camera calibration, enabling rapid deployment across different drones without retraining. Real-world experiments show that SkyDreamer achieves robust, high-speed flight, executing tight maneuvers such as an inverted loop, a split-S and a ladder, reaching speeds of up to 21 m/s and accelerations of up to 6 g. It further demonstrates a non-trivial visual sim-to-real transfer by operating on poor-quality segmentation masks, and exhibits robustness to battery depletion by accurately estimating the maximum attainable motor RPM and adjusting its flight path in real-time. These results highlight SkyDreamer's adaptability to important aspects of the reality gap, bringing robustness while still achieving extremely high-speed, agile flight.