Spatially anchored Tactile Awareness for Robust Dexterous Manipulation

作者: Jialei Huang, Yang Ye, Yuanqing Gong, Xuezhou Zhu, Yang Gao, Kaifeng Zhang

分类: cs.RO

发布日期: 2025-10-16

备注: 8 pages

💡 一句话要点

提出SaTA:通过空间锚定的触觉感知实现鲁棒的灵巧操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting)

关键词: 灵巧操作 触觉感知 空间锚定 机器人学习 几何推理

📋 核心要点

- 现有视觉-触觉学习方法在亚毫米级精度任务中表现不足,无法充分利用触觉信号的空间关系。

- SaTA通过正向运动学将触觉特征锚定到手部运动学框架,实现精确几何推理,无需物体模型或姿态估计。

- 在USB-C插拔、灯泡安装和卡片滑动等任务中,SaTA显著优于基线方法,成功率提升高达30%。

📝 摘要(中文)

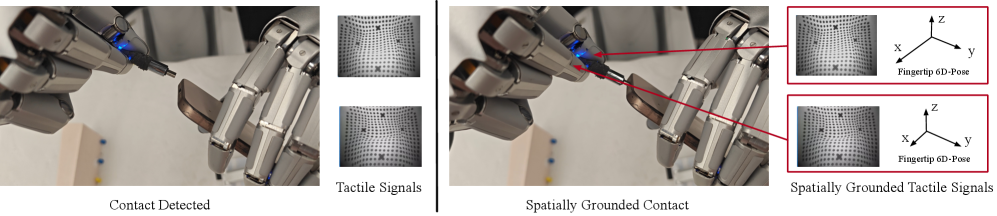

灵巧操作需要精确的几何推理,但现有的视觉-触觉学习方法难以胜任传统基于模型方法能够轻松处理的亚毫米级精度任务。我们发现一个关键限制:虽然触觉传感器提供了丰富的接触信息,但当前的学习框架未能有效利用触觉信号的感知丰富性及其与手部运动学的空间关系。我们认为,理想的触觉表示应该在稳定的参考系中明确地锚定接触测量,同时保留详细的感官信息,使策略不仅能够检测接触发生,还能精确地推断手部坐标系中的物体几何形状。我们介绍SaTA(用于灵巧操作的空间锚定触觉感知),这是一个端到端策略框架,通过正向运动学将触觉特征明确地锚定到手部的运动学框架中,从而实现精确的几何推理,而无需物体模型或显式姿态估计。我们的关键见解是,空间接地的触觉表示使策略不仅能够检测接触发生,还能精确地推断手部坐标系中的物体几何形状。我们在具有挑战性的灵巧操作任务上验证了SaTA,包括自由空间中的双手USB-C插拔(需要亚毫米级对准精度)、需要精确螺纹啮合和旋转控制的灯泡安装,以及需要精细力调节和角度精度的卡片滑动。由于其严格的精度要求,这些任务对基于学习的方法提出了重大挑战。在多个基准测试中,SaTA显著优于强大的视觉-触觉基线,成功率提高了高达30%,同时任务完成时间减少了27%。

🔬 方法详解

问题定义:现有基于视觉-触觉的灵巧操作学习方法难以达到亚毫米级的精度,无法满足一些高精度操作任务的需求。这些方法通常无法有效利用触觉传感器提供的丰富空间信息,以及触觉信息与手部运动学之间的关系,导致几何推理能力不足。

核心思路:SaTA的核心思路是将触觉特征与手部的运动学框架进行空间锚定。通过将触觉信息转换到手部的坐标系中,策略可以更好地理解接触点的位置和方向,从而实现更精确的几何推理。这种方法避免了对物体模型或显式姿态估计的依赖,提高了操作的鲁棒性。

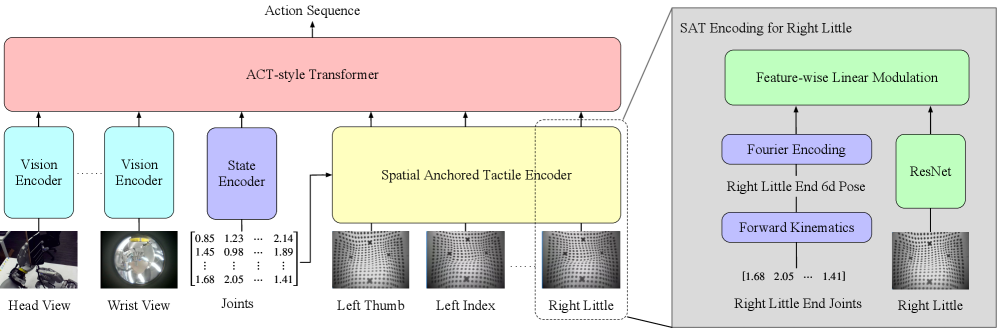

技术框架:SaTA是一个端到端的策略学习框架,主要包括以下几个模块:1) 触觉传感器数据采集模块:负责从触觉传感器获取原始数据。2) 空间锚定模块:利用正向运动学将触觉特征转换到手部的运动学框架中。3) 策略网络:基于空间锚定的触觉特征,学习控制策略,输出手部的动作指令。4) 环境交互模块:将动作指令发送到机器人手臂,与环境进行交互,并获取新的触觉数据。

关键创新:SaTA最重要的创新在于提出了空间锚定的触觉感知方法。与传统的触觉学习方法不同,SaTA显式地将触觉特征与手部的运动学框架联系起来,从而使策略能够更好地理解接触点的几何信息。这种空间锚定方法提高了策略的几何推理能力,使其能够胜任高精度操作任务。

关键设计:SaTA的关键设计包括:1) 使用正向运动学进行空间锚定:正向运动学可以将手部的关节角度转换为末端执行器的位姿,从而将触觉特征转换到手部的坐标系中。2) 端到端学习:SaTA采用端到端的学习方式,直接从原始触觉数据学习控制策略,避免了手动设计特征的复杂性。3) 策略网络结构:策略网络可以采用各种常见的神经网络结构,如MLP、CNN或RNN,具体选择取决于任务的复杂程度。

🖼️ 关键图片

📊 实验亮点

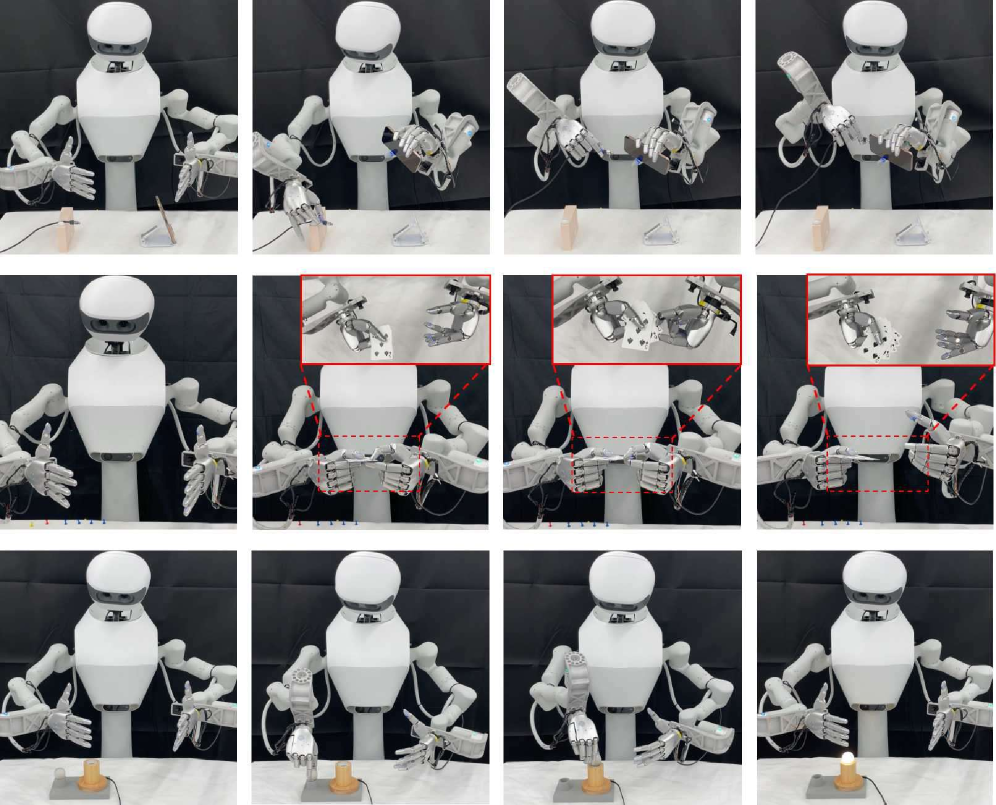

SaTA在多个灵巧操作任务中取得了显著的性能提升。在USB-C插拔任务中,SaTA的成功率比基线方法提高了30%。在灯泡安装任务中,SaTA能够精确地啮合螺纹并完成旋转控制。在卡片滑动任务中,SaTA能够精细地调节力和角度,实现平稳的滑动。实验结果表明,SaTA能够有效地利用触觉信息进行几何推理,从而实现高精度的灵巧操作。

🎯 应用场景

SaTA在需要高精度操作的机器人应用中具有广泛的应用前景,例如精密装配、医疗手术、微纳操作等。通过利用触觉传感器提供的丰富信息,SaTA可以提高机器人在复杂环境中的操作能力和鲁棒性,实现更安全、更高效的自动化操作。未来,SaTA可以与其他感知模态(如视觉、力觉)相结合,进一步提升机器人的感知和操作能力。

📄 摘要(原文)

Dexterous manipulation requires precise geometric reasoning, yet existing visuo-tactile learning methods struggle with sub-millimeter precision tasks that are routine for traditional model-based approaches. We identify a key limitation: while tactile sensors provide rich contact information, current learning frameworks fail to effectively leverage both the perceptual richness of tactile signals and their spatial relationship with hand kinematics. We believe an ideal tactile representation should explicitly ground contact measurements in a stable reference frame while preserving detailed sensory information, enabling policies to not only detect contact occurrence but also precisely infer object geometry in the hand's coordinate system. We introduce SaTA (Spatially-anchored Tactile Awareness for dexterous manipulation), an end-to-end policy framework that explicitly anchors tactile features to the hand's kinematic frame through forward kinematics, enabling accurate geometric reasoning without requiring object models or explicit pose estimation. Our key insight is that spatially grounded tactile representations allow policies to not only detect contact occurrence but also precisely infer object geometry in the hand's coordinate system. We validate SaTA on challenging dexterous manipulation tasks, including bimanual USB-C mating in free space, a task demanding sub-millimeter alignment precision, as well as light bulb installation requiring precise thread engagement and rotational control, and card sliding that demands delicate force modulation and angular precision. These tasks represent significant challenges for learning-based methods due to their stringent precision requirements. Across multiple benchmarks, SaTA significantly outperforms strong visuo-tactile baselines, improving success rates by up to 30 percentage while reducing task completion times by 27 percentage.