Proprioceptive Image: An Image Representation of Proprioceptive Data from Quadruped Robots for Contact Estimation Learning

作者: Gabriel Fischer Abati, João Carlos Virgolino Soares, Giulio Turrisi, Victor Barasuol, Claudio Semini

分类: cs.RO

发布日期: 2025-10-16

💡 一句话要点

提出基于本体感受图像的四足机器人接触估计学习方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 四足机器人 本体感受 接触估计 卷积神经网络 图像表示

📋 核心要点

- 现有方法难以有效利用四足机器人的本体感受数据进行接触估计,限制了其在复杂地形上的运动能力。

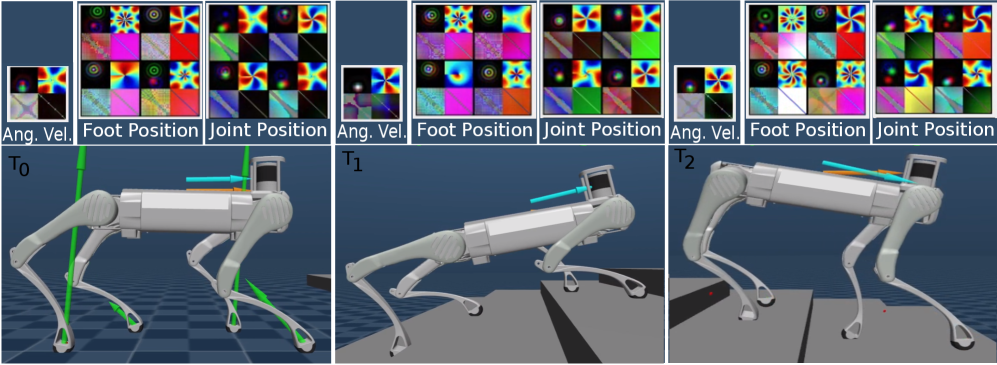

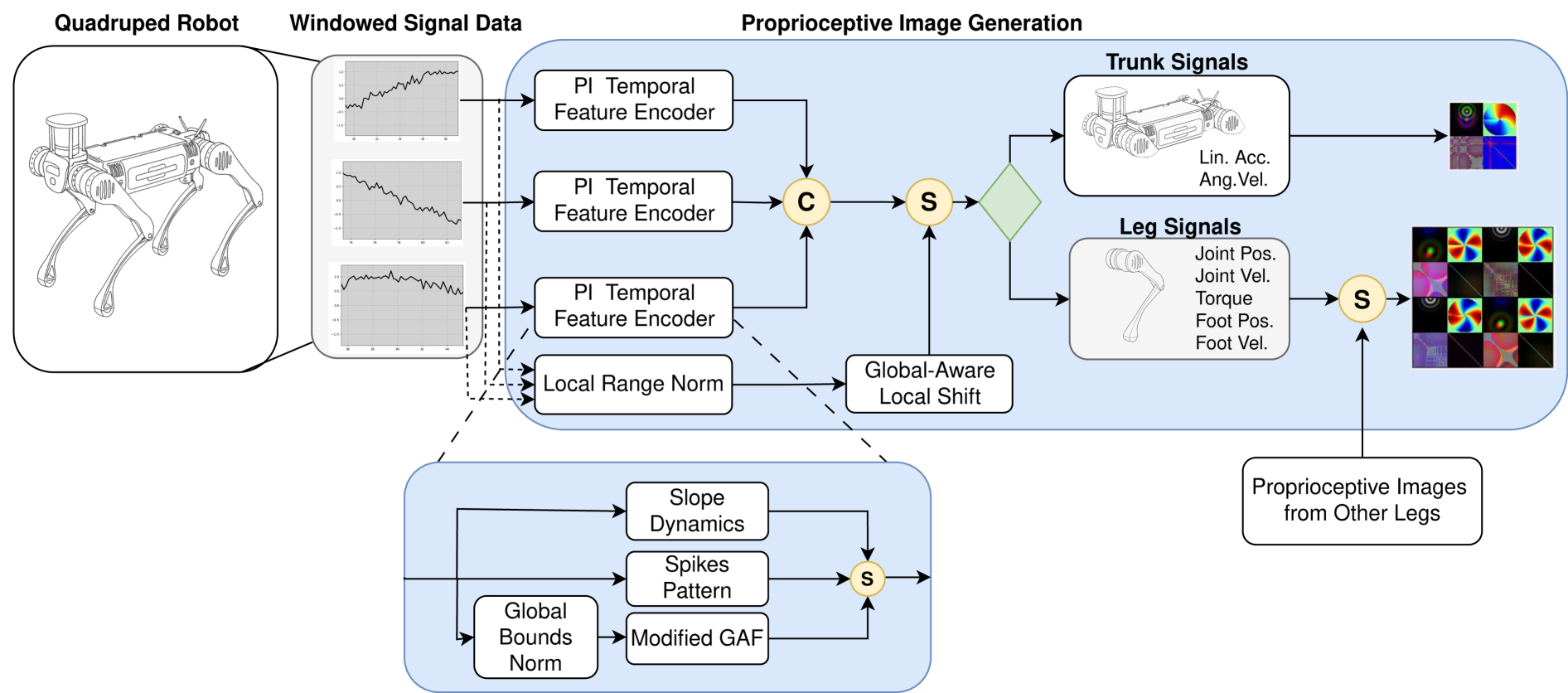

- 论文提出将本体感受时间序列数据转换为二维图像,保留机器人形态结构和时间动态,以便卷积神经网络学习。

- 实验结果表明,该方法在接触估计任务中显著提高了预测精度和泛化能力,优于传统序列模型。

📝 摘要(中文)

本文提出了一种新颖的方法,将四足机器人的本体感受时间序列数据表示为结构化的二维图像,从而能够使用卷积神经网络学习与运动相关的任务。该方法编码了来自多个本体感受信号(如关节位置、IMU读数和足端速度)的时间动态,同时在图像的空间排列中保留了机器人的形态结构。这种转换捕获了信号间的相关性和依赖于步态的模式,提供了比直接时间序列处理更丰富的特征空间。我们将此概念应用于接触估计问题,这是在不同地形上实现稳定和自适应运动的关键能力。在真实世界数据集和模拟环境中的实验评估表明,与传统的基于序列的模型相比,我们的基于图像的表示方法始终能够提高预测精度和泛化能力,突出了跨模态编码策略在机器人状态学习中的潜力。我们的方法在接触数据集上实现了卓越的性能,使用短15倍的窗口大小,将接触状态精度从最近提出的MI-HGNN方法的87.7%提高到94.5%。

🔬 方法详解

问题定义:四足机器人在复杂地形上的稳定运动依赖于准确的接触估计。然而,直接处理本体感受时间序列数据(如关节角度、IMU数据等)进行接触估计面临挑战,因为这些数据之间存在复杂的时序依赖关系和空间相关性,传统方法难以有效捕捉。现有方法,如基于序列的模型,可能无法充分利用这些信息,导致预测精度和泛化能力不足。

核心思路:论文的核心思路是将本体感受时间序列数据编码为二维图像,称为“本体感受图像”。这种图像表示方法旨在保留机器人形态结构的空间信息,并编码本体感受信号的时间动态。通过将时间序列数据映射到图像的像素值,可以利用卷积神经网络(CNN)强大的特征提取能力,学习信号间的相关性和步态依赖模式。

技术框架:该方法主要包含以下几个阶段:1) 数据收集:从四足机器人获取本体感受数据,包括关节位置、IMU读数、足端速度等。2) 数据预处理:对原始数据进行归一化和同步处理。3) 图像编码:将预处理后的时间序列数据映射到二维图像。图像的每个像素对应于一个特定的本体感受信号,像素值表示该信号在特定时间点的值。时间维度可以通过滑动窗口或循环的方式编码到图像中。4) 模型训练:使用卷积神经网络(CNN)对本体感受图像进行训练,以预测接触状态。5) 接触估计:使用训练好的CNN模型,根据输入的本体感受图像预测机器人的接触状态。

关键创新:该方法最重要的技术创新点在于将本体感受时间序列数据表示为二维图像。这种表示方法能够同时保留机器人的形态结构和时间动态,从而能够利用CNN强大的特征提取能力,学习信号间的相关性和步态依赖模式。与传统的基于序列的模型相比,该方法能够提供更丰富的特征空间,从而提高预测精度和泛化能力。

关键设计:在图像编码方面,论文采用了一种空间排列方式,使得图像的像素位置与机器人的关节位置相对应,从而保留了机器人的形态结构。在网络结构方面,论文采用了标准的卷积神经网络结构,并针对接触估计任务进行了优化。在损失函数方面,论文采用了交叉熵损失函数,以衡量预测结果与真实标签之间的差异。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在接触数据集上实现了显著的性能提升,将接触状态精度从最近提出的MI-HGNN方法的87.7%提高到94.5%,并且使用了短15倍的窗口大小。这表明该方法能够更有效地利用本体感受数据进行接触估计,并且具有更好的实时性。

🎯 应用场景

该研究成果可应用于提高四足机器人在复杂地形上的运动能力,例如搜索救援、物流运输、巡检等领域。通过更准确的接触估计,机器人可以更好地适应地形变化,实现更稳定、更高效的运动。此外,该方法还可以推广到其他类型的机器人,例如人形机器人和轮式机器人,以提高其在复杂环境中的适应能力。

📄 摘要(原文)

This paper presents a novel approach for representing proprioceptive time-series data from quadruped robots as structured two-dimensional images, enabling the use of convolutional neural networks for learning locomotion-related tasks. The proposed method encodes temporal dynamics from multiple proprioceptive signals, such as joint positions, IMU readings, and foot velocities, while preserving the robot's morphological structure in the spatial arrangement of the image. This transformation captures inter-signal correlations and gait-dependent patterns, providing a richer feature space than direct time-series processing. We apply this concept in the problem of contact estimation, a key capability for stable and adaptive locomotion on diverse terrains. Experimental evaluations on both real-world datasets and simulated environments show that our image-based representation consistently enhances prediction accuracy and generalization over conventional sequence-based models, underscoring the potential of cross-modal encoding strategies for robotic state learning. Our method achieves superior performance on the contact dataset, improving contact state accuracy from 87.7% to 94.5% over the recently proposed MI-HGNN method, using a 15 times shorter window size.