Learning Human-Humanoid Coordination for Collaborative Object Carrying

作者: Yushi Du, Yixuan Li, Baoxiong Jia, Yutang Lin, Pei Zhou, Wei Liang, Yanchao Yang, Siyuan Huang

分类: cs.RO, cs.AI, cs.CV, cs.LG

发布日期: 2025-10-16

💡 一句话要点

提出COLA,实现基于本体感受的类人机器人协同搬运,提升人机协作效率。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 人机协作 类人机器人 强化学习 协同搬运 本体感受 轨迹规划 机器人控制

📋 核心要点

- 现有方法难以处理类人机器人复杂的全身动力学,限制了人与类人机器人的协同搬运。

- COLA方法通过强化学习,将领导者和跟随者行为融入单一策略,实现协同轨迹规划。

- 实验表明,COLA在模拟环境中减少人类体力消耗24.7%,用户研究证实提升27.4%。

📝 摘要(中文)

本文提出了一种基于本体感受的强化学习方法COLA,用于实现人与类人机器人在协同搬运任务中的协作。该方法将领导者和跟随者的行为融合在单一策略中,通过在动态对象交互的闭环环境中训练模型,隐式地预测对象运动模式和人类意图,从而实现协同的轨迹规划,保持负载平衡。在协同搬运任务的模拟和真实世界实验中,验证了该模型的有效性、泛化性和鲁棒性。模拟实验表明,与基线方法相比,该模型可减少人类24.7%的体力消耗,同时保持物体稳定性。真实世界实验验证了在不同物体类型(箱子、桌子、担架等)和运动模式(直线、转弯、爬坡)下的鲁棒协同搬运。包含23名参与者的人工用户研究证实,与基线模型相比,平均提升了27.4%。该方法无需外部传感器或复杂的交互模型,即可实现协同的人机协同搬运,为实际部署提供了一种可行的解决方案。

🔬 方法详解

问题定义:论文旨在解决人与类人机器人在协同搬运任务中,如何实现高效、稳定、舒适的协作问题。现有方法主要集中在机器人手臂的协同,而忽略了类人机器人全身动力学的复杂性,导致难以实现自然流畅的人机协同,并且通常依赖外部传感器,增加了部署成本和复杂性。

核心思路:论文的核心思路是利用强化学习,训练一个能够同时模拟领导者和跟随者行为的策略。通过让机器人在动态环境中学习与人类的交互,使其能够隐式地预测人类的意图和运动模式,从而实现协同的轨迹规划,并保持负载平衡。这种方法避免了显式地建模人类行为,降低了复杂性。

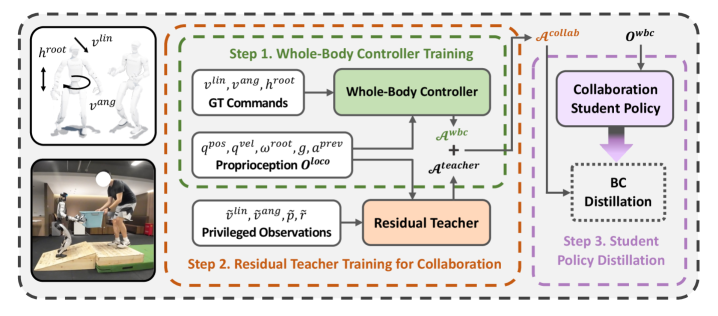

技术框架:COLA方法的整体框架是一个闭环强化学习系统。首先,构建一个包含人和类人机器人的仿真环境,并模拟物体交互的动力学。然后,使用强化学习算法训练一个策略网络,该网络以机器人的本体感受信息作为输入,输出机器人的关节控制指令。在训练过程中,通过奖励函数来引导机器人学习协同搬运的行为,例如保持物体稳定、减少人类的体力消耗等。最后,将训练好的策略部署到真实的类人机器人上,进行实际的协同搬运实验。

关键创新:该论文的关键创新在于提出了一个基于本体感受的强化学习方法,用于实现人与类人机器人的协同搬运。与现有方法相比,该方法不需要外部传感器或复杂的交互模型,仅依赖于机器人的自身感知信息,即可实现高效、稳定的协同。此外,该方法还能够同时模拟领导者和跟随者的行为,从而实现更加自然流畅的人机交互。

关键设计:COLA方法使用了一种actor-critic的强化学习算法,其中actor网络负责生成机器人的控制指令,critic网络负责评估当前状态的价值。奖励函数的设计至关重要,它需要综合考虑物体稳定性、人类体力消耗、运动平滑性等多个因素。网络结构方面,使用了多层感知机(MLP)来处理机器人的本体感受信息,并输出关节控制指令。训练过程中,使用了经验回放和目标网络等技术来提高训练的稳定性和效率。

🖼️ 关键图片

📊 实验亮点

模拟实验表明,COLA方法相比基线方法,能够减少人类24.7%的体力消耗,同时保持物体的稳定性。在真实世界实验中,COLA成功地实现了在不同物体类型(箱子、桌子、担架等)和运动模式(直线、转弯、爬坡)下的鲁棒协同搬运。包含23名参与者的人工用户研究证实,与基线模型相比,COLA平均提升了27.4%的用户体验。

🎯 应用场景

该研究成果可广泛应用于医疗保健、家庭服务和制造业等领域。例如,在医院中,类人机器人可以协助医护人员搬运病人或医疗设备;在家庭中,可以帮助老年人或残疾人搬运重物;在工厂中,可以与工人协同完成装配或搬运任务。该技术有望提高工作效率,降低劳动强度,并改善人机交互体验。

📄 摘要(原文)

Human-humanoid collaboration shows significant promise for applications in healthcare, domestic assistance, and manufacturing. While compliant robot-human collaboration has been extensively developed for robotic arms, enabling compliant human-humanoid collaboration remains largely unexplored due to humanoids' complex whole-body dynamics. In this paper, we propose a proprioception-only reinforcement learning approach, COLA, that combines leader and follower behaviors within a single policy. The model is trained in a closed-loop environment with dynamic object interactions to predict object motion patterns and human intentions implicitly, enabling compliant collaboration to maintain load balance through coordinated trajectory planning. We evaluate our approach through comprehensive simulator and real-world experiments on collaborative carrying tasks, demonstrating the effectiveness, generalization, and robustness of our model across various terrains and objects. Simulation experiments demonstrate that our model reduces human effort by 24.7%. compared to baseline approaches while maintaining object stability. Real-world experiments validate robust collaborative carrying across different object types (boxes, desks, stretchers, etc.) and movement patterns (straight-line, turning, slope climbing). Human user studies with 23 participants confirm an average improvement of 27.4% compared to baseline models. Our method enables compliant human-humanoid collaborative carrying without requiring external sensors or complex interaction models, offering a practical solution for real-world deployment.