Active Tactile Exploration for Rigid Body Pose and Shape Estimation

作者: Ethan K. Gordon, Bruke Baraki, Hien Bui, Michael Posa

分类: cs.RO

发布日期: 2025-10-15

备注: 8 pages, 6 figures

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出基于主动触觉探索的刚体位姿与形状估计方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 触觉感知 主动探索 刚体位姿估计 形状估计 机器人操作

📋 核心要点

- 通用机器人操作需要处理先前未见过的物体,在测试时学习物理精确的模型可以在数据效率、可预测性和任务之间的重用方面提供显著优势。

- 该论文提出了一种基于触觉的主动探索框架,用于同时估计刚性物体的形状和位置,旨在通过最小化机器人运动来实现高效的数据收集。

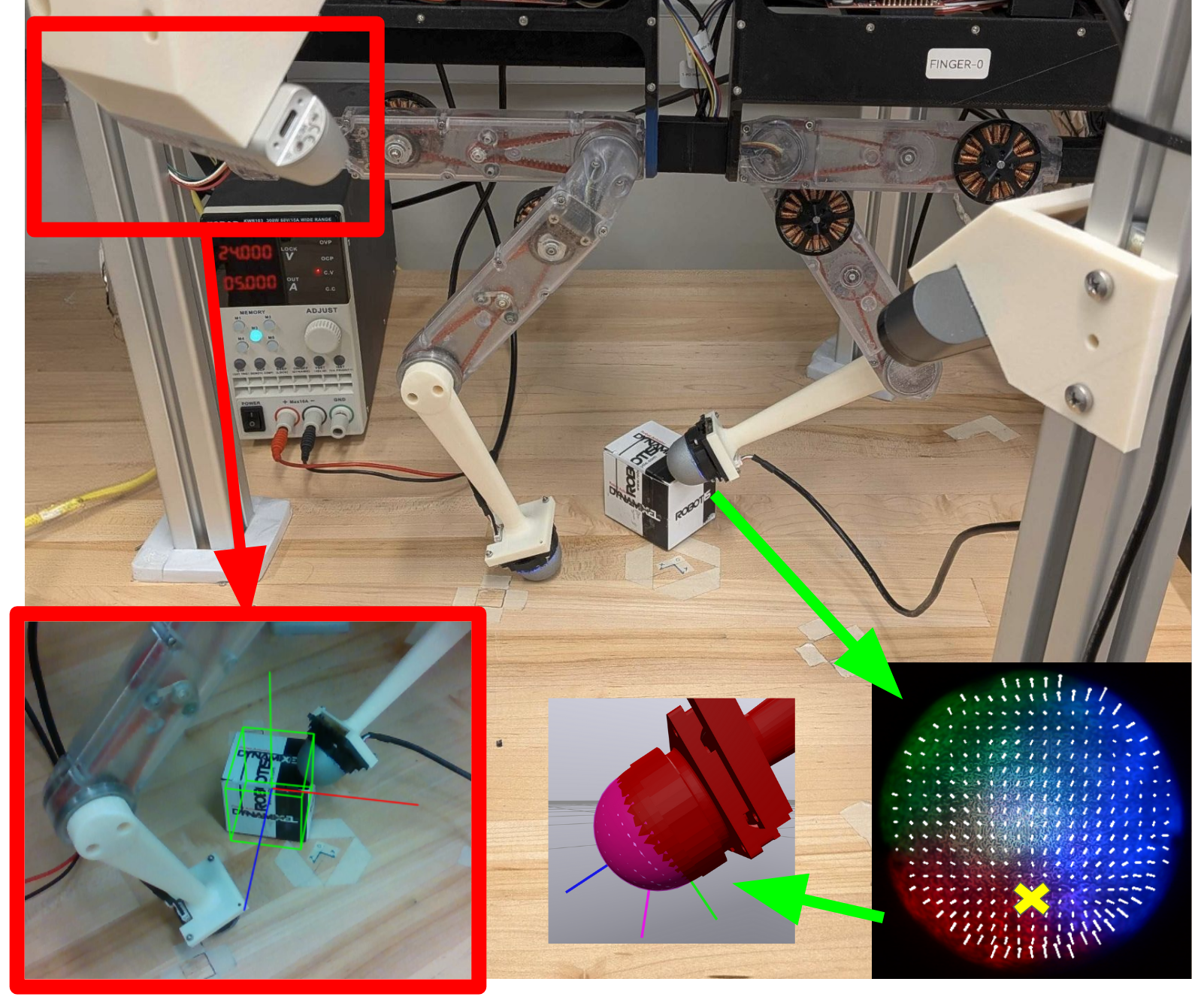

- 实验结果表明,该方法能够在模拟和真实机器人环境中,利用少量触觉数据快速学习物体的几何形状,并优于随机探索策略。

📝 摘要(中文)

本文提出了一种学习和探索框架,该框架仅使用触觉数据来同时确定刚性物体的形状和位置,并最大限度地减少机器人运动。该方法建立在接触丰富的系统识别的最新进展之上,制定了一个损失函数,该函数惩罚物理约束违反,而不会引入刚体接触中固有的数值刚度。通过优化此损失,可以在首次接触后使用少于 10 秒的随机收集数据来学习长方体和凸多面体几何形状。提出的探索方案旨在最大限度地提高预期信息增益,并在模拟和真实机器人实验中实现更快的学习。

🔬 方法详解

问题定义:现有机器人操作任务中,处理未知物体时,需要快速准确地估计物体的形状和位姿。传统的视觉方法容易受到遮挡的影响,而触觉感知虽然对遮挡具有鲁棒性,但其时间稀疏性使得在线探索成为挑战。此外,直接接触可能导致物体移动,需要同时估计形状和位置。

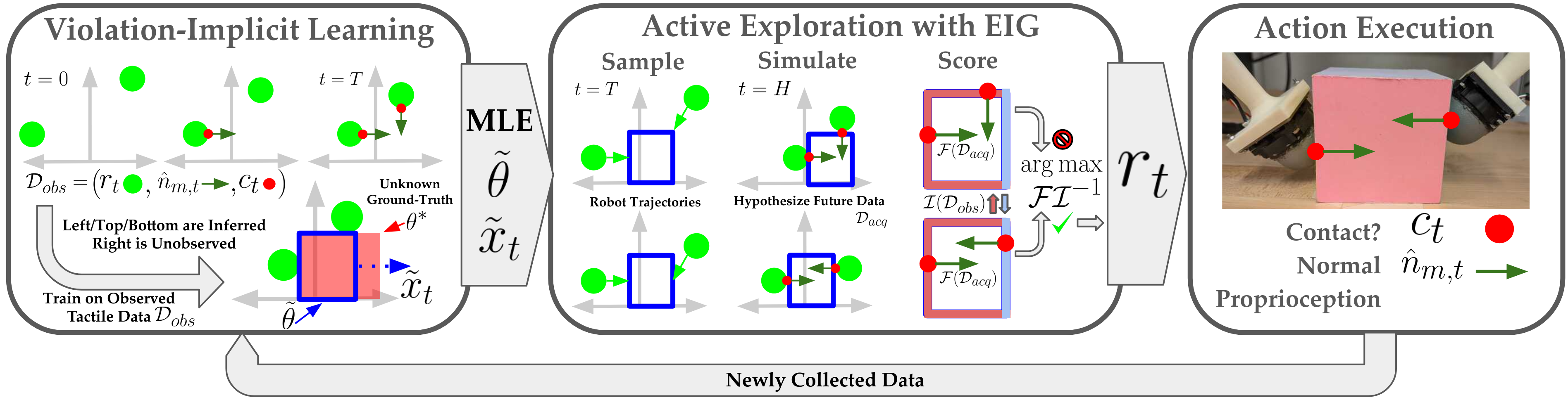

核心思路:该论文的核心思路是利用主动触觉探索,通过精心设计的探索策略,最大化每次触觉交互的信息增益,从而在尽可能短的时间内学习到物体的形状和位姿。同时,采用一种新的损失函数,避免了刚体接触中常见的数值刚度问题。

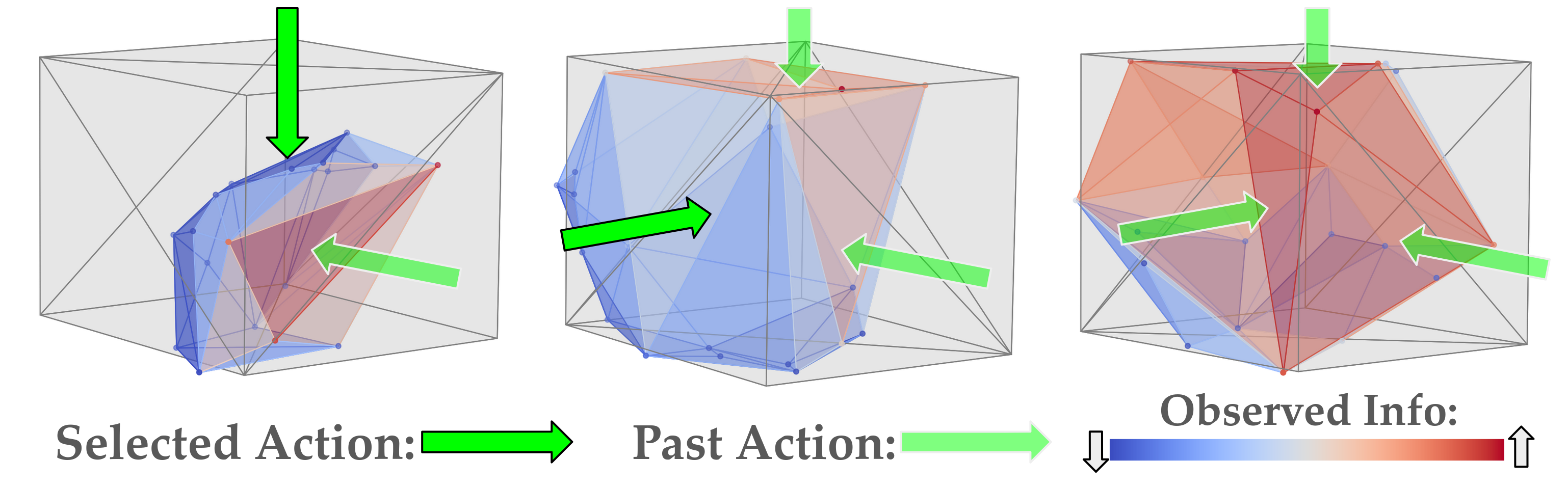

技术框架:该框架包含以下几个主要模块:1) 触觉数据采集模块,通过机器人上的触觉传感器获取与物体的接触信息;2) 形状和位姿估计模块,利用触觉数据和物理约束,估计物体的几何形状和位姿;3) 主动探索策略模块,根据当前估计的不确定性,选择下一个最佳的触觉探索位置,以最大化预期信息增益。整个流程是一个迭代的过程,通过不断地触觉探索和模型更新,最终实现对物体形状和位姿的准确估计。

关键创新:该论文的关键创新在于以下几个方面:1) 提出了一种新的损失函数,该函数能够有效地惩罚物理约束违反,同时避免了刚体接触中固有的数值刚度问题;2) 设计了一种基于预期信息增益的主动探索策略,能够显著提高数据效率和学习速度;3) 将形状和位姿估计与主动探索相结合,实现了一个完整的触觉感知和操作框架。

关键设计:在损失函数设计方面,论文采用了基于接触丰富的系统识别方法,具体细节未知。在主动探索策略方面,论文采用了预期信息增益作为探索目标,并可能使用了一些近似方法来加速计算。具体的参数设置和网络结构等技术细节在摘要中没有详细说明,需要参考论文全文。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够在少于10秒的随机数据收集后,学习长方体和凸多面体几何形状。提出的主动探索策略显著提高了学习速度,在模拟和真实机器人实验中均优于随机探索策略。具体的性能提升幅度未知,需要参考论文全文。

🎯 应用场景

该研究成果可应用于各种机器人操作任务中,例如:自动化装配、物体抓取、环境探索等。通过触觉感知,机器人可以在复杂环境中更好地理解和操作物体,提高其自主性和适应性。未来,该技术有望应用于服务机器人、工业机器人等领域,实现更智能、更高效的机器人操作。

📄 摘要(原文)

General robot manipulation requires the handling of previously unseen objects. Learning a physically accurate model at test time can provide significant benefits in data efficiency, predictability, and reuse between tasks. Tactile sensing can compliment vision with its robustness to occlusion, but its temporal sparsity necessitates careful online exploration to maintain data efficiency. Direct contact can also cause an unrestrained object to move, requiring both shape and location estimation. In this work, we propose a learning and exploration framework that uses only tactile data to simultaneously determine the shape and location of rigid objects with minimal robot motion. We build on recent advances in contact-rich system identification to formulate a loss function that penalizes physical constraint violation without introducing the numerical stiffness inherent in rigid-body contact. Optimizing this loss, we can learn cuboid and convex polyhedral geometries with less than 10s of randomly collected data after first contact. Our exploration scheme seeks to maximize Expected Information Gain and results in significantly faster learning in both simulated and real-robot experiments. More information can be found at https://dairlab.github.io/activetactile