T(R,O) Grasp: Efficient Graph Diffusion of Robot-Object Spatial Transformation for Cross-Embodiment Dexterous Grasping

作者: Xin Fei, Zhixuan Xu, Huaicong Fang, Tianrui Zhang, Lin Shao

分类: cs.RO

发布日期: 2025-10-14

备注: 12 pages, 14 figures

💡 一句话要点

提出T(R,O) Grasp,通过图扩散高效生成跨具身灵巧抓取

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 灵巧抓取 图扩散模型 机器人操作 空间变换 具身智能

📋 核心要点

- 灵巧抓取因其高维状态和动作空间的复杂性而极具挑战,现有方法难以兼顾效率、精度和泛化性。

- T(R,O) Grasp通过T(R,O)图统一表示机器人手和物体间的空间变换,并利用图扩散模型生成抓取姿态。

- 实验表明,T(R,O) Grasp在成功率、推理速度和吞吐量上均显著优于现有方法,并具有良好的泛化能力。

📝 摘要(中文)

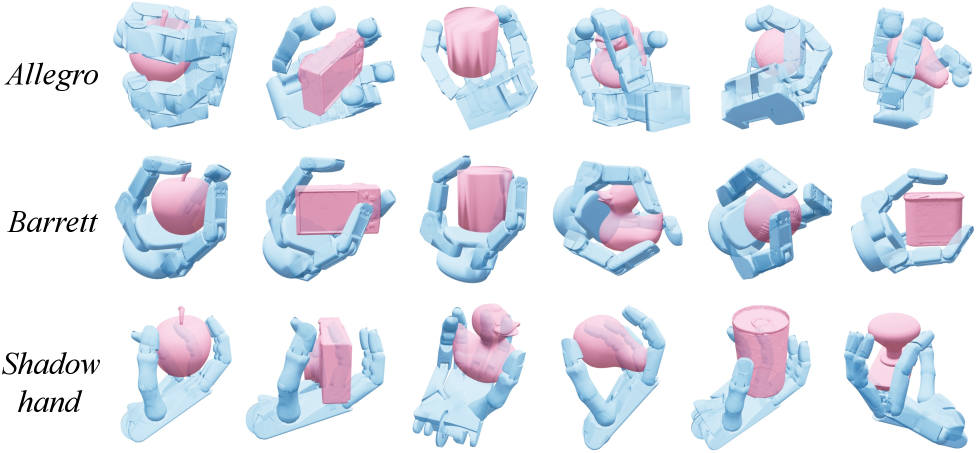

本文提出T(R,O) Grasp,一个基于扩散模型的框架,旨在高效生成精确且多样化的跨多种机器人手的抓取姿态。其核心是T(R,O)图,一种统一的表示方法,用于建模机器人手和物体之间的空间变换,同时编码它们的几何属性。一个图扩散模型,结合高效的逆运动学求解器,支持无条件和条件抓取合成。在各种灵巧手上的大量实验表明,T(R,O) Grasp实现了94.83%的平均成功率,0.21秒的推理速度,以及在NVIDIA A100 40GB GPU上每秒41个抓取的吞吐量,显著优于现有的基线方法。此外,我们的方法在不同具身之间具有鲁棒性和泛化性,同时显著降低了内存消耗。更重要的是,高推理速度使得闭环灵巧操作成为可能,突显了T(R,O) Grasp扩展为灵巧抓取基础模型的潜力。

🔬 方法详解

问题定义:灵巧抓取任务需要控制多自由度的机械手与物体进行交互,难点在于如何高效、准确地生成可行的抓取姿态,并保证在不同机械手上的泛化能力。现有方法通常计算复杂度高,推理速度慢,且难以适应不同的机械手结构。

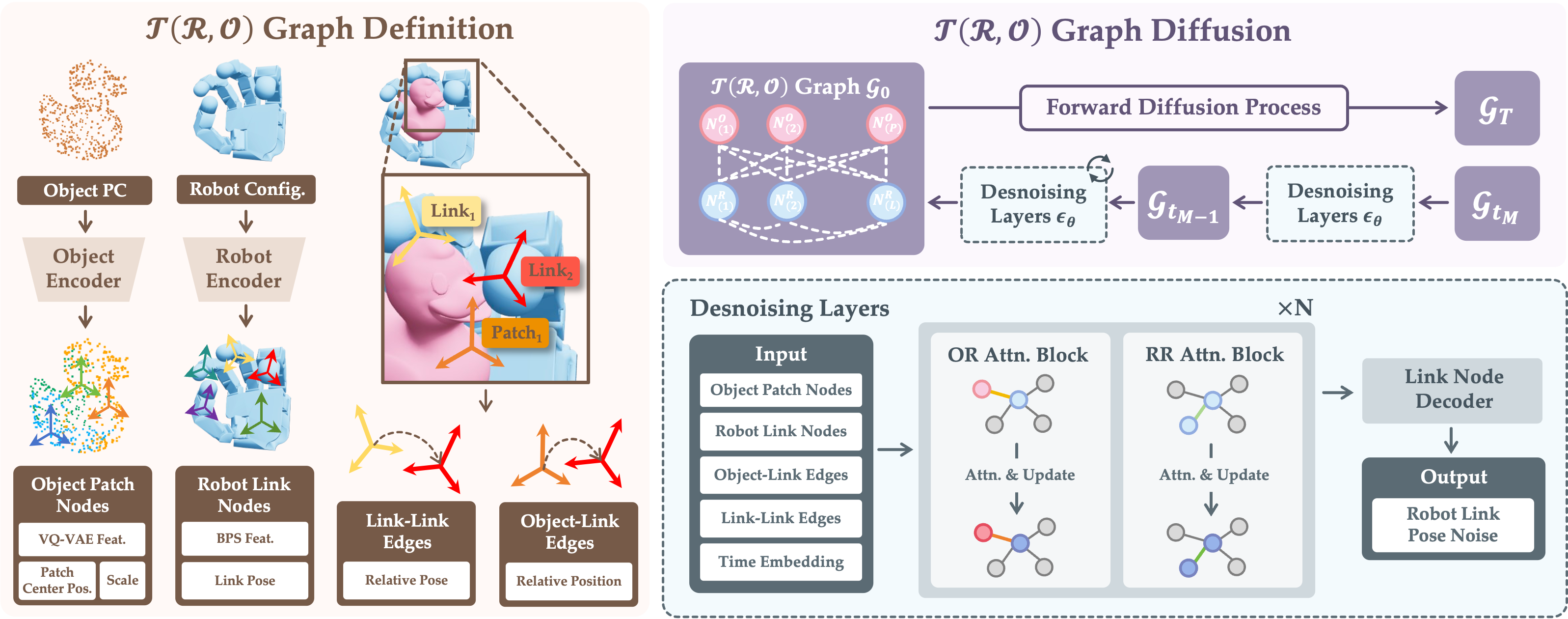

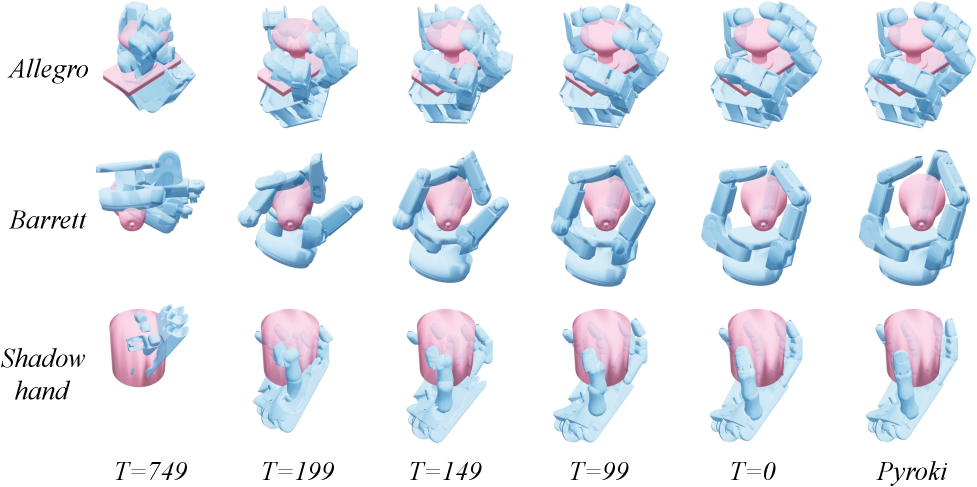

核心思路:T(R,O) Grasp的核心在于将机器人手和物体之间的空间变换关系建模成图结构,即T(R,O)图。通过图扩散模型学习抓取姿态的分布,从而能够生成多样且高质量的抓取姿态。这种基于图的表示方法能够更好地捕捉手和物体之间的几何关系,并提高泛化能力。

技术框架:T(R,O) Grasp框架主要包含以下几个模块:1) T(R,O)图构建模块,用于将机器人手和物体的几何信息以及它们之间的空间变换关系编码成图结构;2) 图扩散模型,用于学习抓取姿态的分布,并生成新的抓取姿态;3) 逆运动学求解器,用于将生成的抓取姿态转换为机械手的关节角度;4) 抓取评估模块,用于评估生成的抓取姿态的质量。整个流程首先构建T(R,O)图,然后通过图扩散模型生成抓取姿态,再通过逆运动学求解器得到关节角度,最后评估抓取姿态的质量。

关键创新:T(R,O) Grasp的关键创新在于提出了T(R,O)图这种统一的表示方法,能够同时编码机器人手和物体的几何信息以及它们之间的空间变换关系。与传统的基于点云或体素的表示方法相比,T(R,O)图能够更好地捕捉手和物体之间的几何关系,并提高泛化能力。此外,采用图扩散模型能够生成多样且高质量的抓取姿态。

关键设计:T(R,O)图的节点表示机器人手的指尖和物体的关键点,边表示它们之间的空间变换关系。图扩散模型采用Transformer结构,用于学习节点之间的关系。损失函数包括抓取成功率损失和关节角度平滑性损失。逆运动学求解器采用数值优化方法,以保证求解的效率和精度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,T(R,O) Grasp在多种灵巧手上取得了显著的性能提升。平均抓取成功率达到94.83%,推理速度为0.21秒,在NVIDIA A100 40GB GPU上每秒可生成41个抓取姿态。与现有基线方法相比,T(R,O) Grasp在成功率、推理速度和吞吐量上均有显著优势,并且具有更好的泛化能力和更低的内存消耗。

🎯 应用场景

T(R,O) Grasp在工业自动化、家庭服务机器人、医疗机器人等领域具有广泛的应用前景。它可以用于提高机器人抓取物体的效率和精度,从而实现更复杂的任务。例如,在工业自动化中,机器人可以使用T(R,O) Grasp来抓取不同形状和大小的零件,从而提高生产效率。在家庭服务机器人中,机器人可以使用T(R,O) Grasp来抓取各种家居用品,从而提供更便捷的服务。

📄 摘要(原文)

Dexterous grasping remains a central challenge in robotics due to the complexity of its high-dimensional state and action space. We introduce T(R,O) Grasp, a diffusion-based framework that efficiently generates accurate and diverse grasps across multiple robotic hands. At its core is the T(R,O) Graph, a unified representation that models spatial transformations between robotic hands and objects while encoding their geometric properties. A graph diffusion model, coupled with an efficient inverse kinematics solver, supports both unconditioned and conditioned grasp synthesis. Extensive experiments on a diverse set of dexterous hands show that T(R,O) Grasp achieves average success rate of 94.83%, inference speed of 0.21s, and throughput of 41 grasps per second on an NVIDIA A100 40GB GPU, substantially outperforming existing baselines. In addition, our approach is robust and generalizable across embodiments while significantly reducing memory consumption. More importantly, the high inference speed enables closed-loop dexterous manipulation, underscoring the potential of T(R,O) Grasp to scale into a foundation model for dexterous grasping.