Autonomous Legged Mobile Manipulation for Lunar Surface Operations via Constrained Reinforcement Learning

作者: Alvaro Belmonte-Baeza, Miguel Cazorla, Gabriel J. García, Carlos J. Pérez-Del-Pulgar, Jorge Pomares

分类: cs.RO, eess.SY

发布日期: 2025-10-14

备注: This is the authors version of the paper accepted for publication in The IEEE International Conference on Space Robotics 2025. The final version link will be added here after conference proceedings are published

💡 一句话要点

提出基于约束强化学习的月球表面四足机器人自主操作框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 四足机器人 移动操作 约束强化学习 月球探测 自主导航

📋 核心要点

- 轮式漫游车在复杂地形受限,腿式机器人更具优势,但自主操作在月球环境下仍面临挑战。

- 提出约束强化学习框架,融合全身运动与操作,显式考虑避障、稳定性和能效等安全约束。

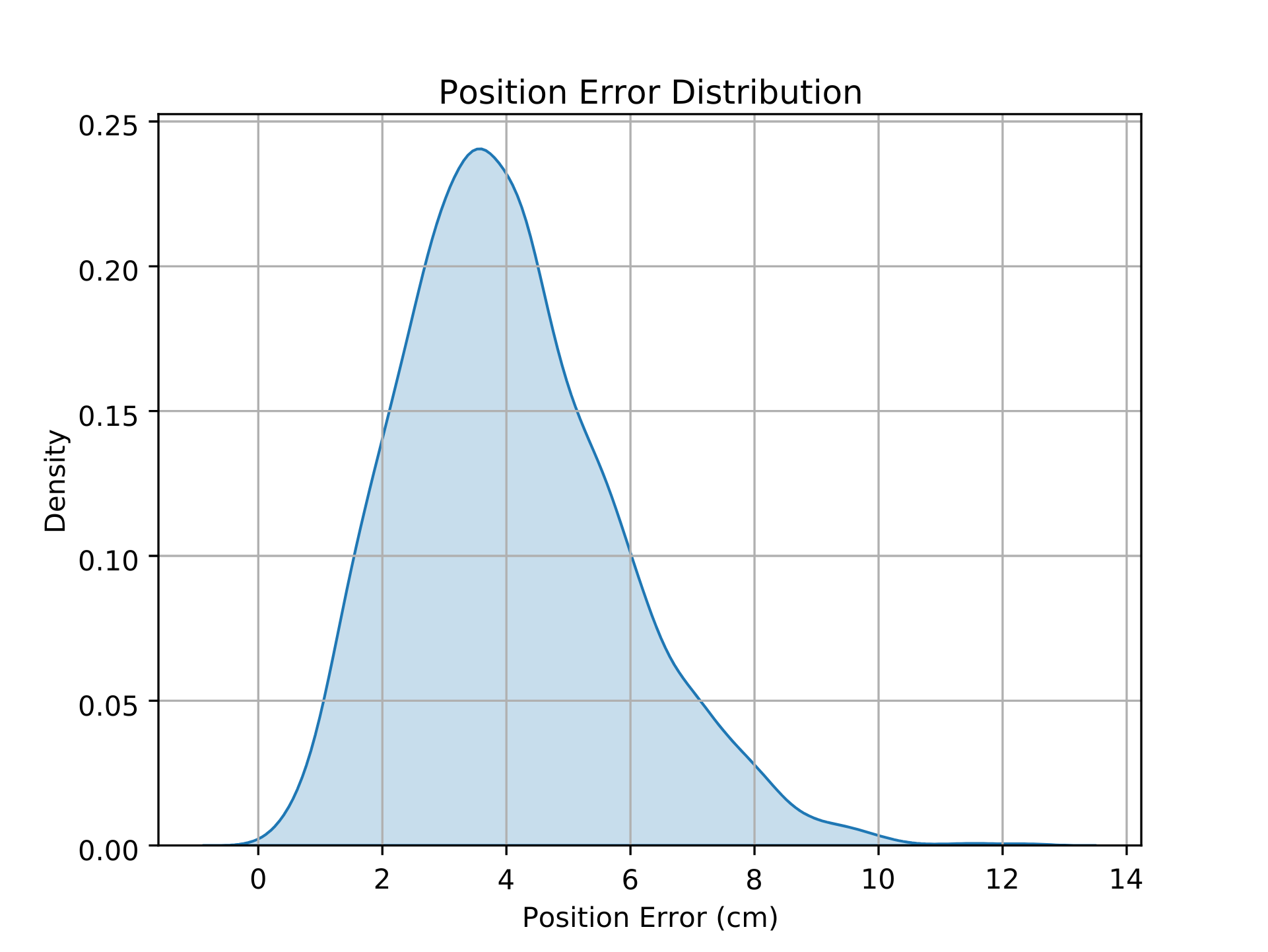

- 实验验证框架在月球重力下能实现精确6D姿态跟踪,位置精度4cm,方向精度8.1度,并满足约束。

📝 摘要(中文)

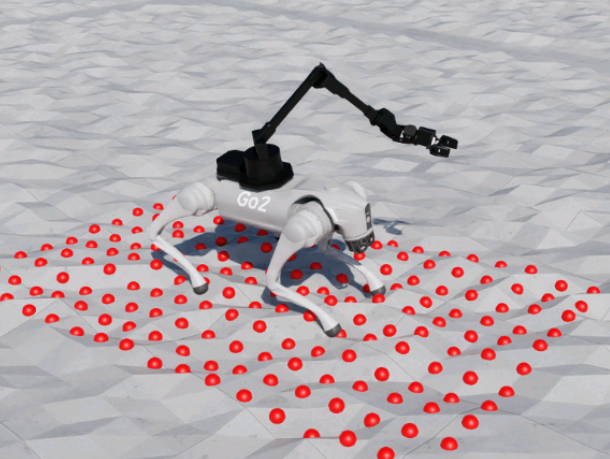

本文提出了一种基于约束强化学习的框架,用于月球环境下四足移动操作机器人的自主操作。该框架集成了全身运动和操作能力,同时显式地解决了关键的安全约束,包括避障、动态稳定性和功率效率,以确保在月球特定条件(如低重力和不规则地形)下的鲁棒性能。实验结果表明,该框架在实现精确的6D任务空间末端执行器姿态跟踪方面是有效的,平均位置精度为4厘米,方向精度为8.1度。该系统始终遵守软约束和硬约束,表现出针对月球重力条件优化的自适应行为。这项工作有效地将自适应学习与关键任务安全需求联系起来,为未来月球任务的先进自主机器人探索者铺平了道路。

🔬 方法详解

问题定义:论文旨在解决月球环境下四足机器人自主移动操作的问题。现有方法在复杂地形的适应性、安全约束的显式处理以及运动和操作的协调方面存在不足。尤其是在月球的低重力、崎岖地形和能源限制下,如何保证机器人安全、高效地完成任务是一个挑战。

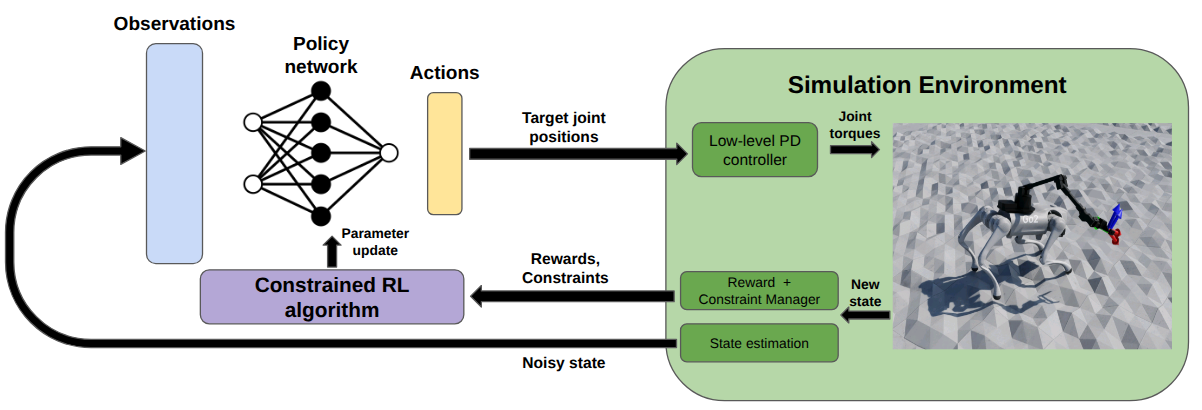

核心思路:论文的核心思路是利用约束强化学习,将安全约束(如避障、动态稳定性和功率效率)直接融入到强化学习的训练过程中。通过这种方式,机器人可以在学习过程中考虑到这些约束,从而避免产生不安全的行为。同时,结合全身运动规划和操作控制,实现运动和操作的协调。

技术框架:该框架包含以下主要模块:1) 环境建模与感知:用于获取月球表面的地形信息和障碍物信息。2) 约束定义:定义了避障、动态稳定性和功率效率等安全约束。3) 强化学习策略:使用强化学习算法训练机器人的运动和操作策略,同时考虑安全约束。4) 运动规划与控制:根据强化学习策略生成运动轨迹,并使用全身动力学控制保证机器人的稳定性和精确运动。整体流程是,机器人通过感知模块获取环境信息,然后根据强化学习策略生成运动和操作指令,运动规划与控制模块执行这些指令,同时保证满足安全约束。

关键创新:最重要的技术创新点在于将安全约束显式地融入到强化学习的训练过程中。传统的强化学习方法通常只关注任务的奖励,而忽略了安全约束。该论文通过定义约束损失函数或使用约束优化算法,使得机器人在学习过程中能够同时优化任务奖励和满足安全约束。这与现有方法只在训练后进行安全验证或使用启发式规则来避免不安全行为有本质区别。

关键设计:论文中可能使用了特定的强化学习算法,例如近端策略优化(PPO)或信任区域策略优化(TRPO),并对其进行了修改以适应约束强化学习的需求。约束的实现可能通过添加额外的损失项到奖励函数中,或者使用投影梯度下降等约束优化方法。具体的参数设置,例如学习率、折扣因子、约束损失的权重等,需要根据实际的月球环境和机器人模型进行调整。网络结构可能包含用于感知环境的卷积神经网络(CNN)和用于控制机器人运动和操作的循环神经网络(RNN)或多层感知机(MLP)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该框架能够实现精确的6D任务空间末端执行器姿态跟踪,平均位置精度达到4厘米,方向精度达到8.1度。同时,系统能够始终遵守软约束和硬约束,表现出针对月球重力条件优化的自适应行为。这些结果验证了该框架在月球环境下自主移动操作的可行性和有效性。

🎯 应用场景

该研究成果可应用于未来的月球探测任务,例如月球资源勘探、月球基地建设和科学实验。通过自主移动操作,机器人可以完成样本采集、设备维护和地形勘测等任务,从而降低人类宇航员的风险和成本。此外,该技术还可以推广到其他极端环境下的机器人应用,例如深海探测和灾后救援。

📄 摘要(原文)

Robotics plays a pivotal role in planetary science and exploration, where autonomous and reliable systems are crucial due to the risks and challenges inherent to space environments. The establishment of permanent lunar bases demands robotic platforms capable of navigating and manipulating in the harsh lunar terrain. While wheeled rovers have been the mainstay for planetary exploration, their limitations in unstructured and steep terrains motivate the adoption of legged robots, which offer superior mobility and adaptability. This paper introduces a constrained reinforcement learning framework designed for autonomous quadrupedal mobile manipulators operating in lunar environments. The proposed framework integrates whole-body locomotion and manipulation capabilities while explicitly addressing critical safety constraints, including collision avoidance, dynamic stability, and power efficiency, in order to ensure robust performance under lunar-specific conditions, such as reduced gravity and irregular terrain. Experimental results demonstrate the framework's effectiveness in achieving precise 6D task-space end-effector pose tracking, achieving an average positional accuracy of 4 cm and orientation accuracy of 8.1 degrees. The system consistently respects both soft and hard constraints, exhibiting adaptive behaviors optimized for lunar gravity conditions. This work effectively bridges adaptive learning with essential mission-critical safety requirements, paving the way for advanced autonomous robotic explorers for future lunar missions.