A Task-Efficient Reinforcement Learning Task-Motion Planner for Safe Human-Robot Cooperation

作者: Gaoyuan Liu, Joris de Winter, Kelly Merckaert, Denis Steckelmacher, Ann Nowe, Bram Vanderborght

分类: cs.RO

发布日期: 2025-10-14

💡 一句话要点

提出一种任务高效的强化学习任务-运动规划器,用于安全的人机协作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 人机协作 强化学习 任务规划 运动规划 安全控制

📋 核心要点

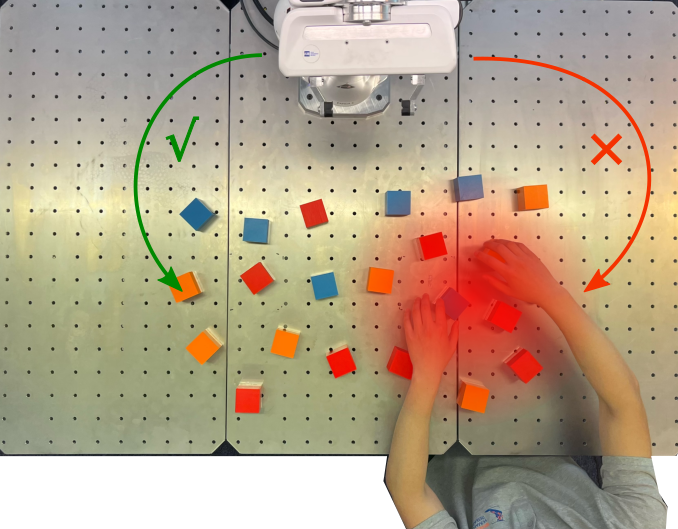

- 人机协作中,安全机制常牺牲效率,人为干预导致机器人任务失败和频繁重规划。

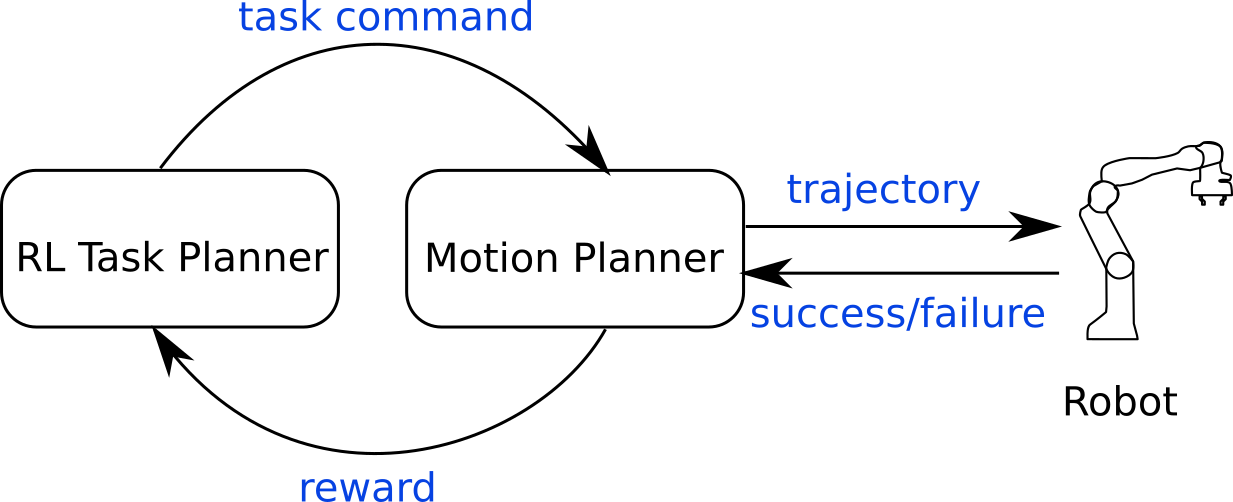

- 提出混合强化学习框架,RL任务规划器选择安全高效的任务序列,运动规划器保证无碰撞。

- 实验表明,该框架能应对不确定的人类运动,减少失败命令和重规划请求。

📝 摘要(中文)

在人机协作(HRC)环境中,安全性和效率是评估机器人性能的两个核心属性。然而,安全机制通常会阻碍任务效率,因为人为干预会导致机器人的备份运动和目标失败。频繁的运动重规划会增加计算负担和失败的几率。本文提出了一种混合强化学习(RL)规划框架,该框架由一个交互式运动规划器和一个RL任务规划器组成。RL任务规划器试图根据运动规划器的反馈选择统计上安全且高效的任务序列,而运动规划器通过检测人类手臂运动并在先前路径不再有效时部署新路径来保持任务执行过程的无碰撞。直观地说,RL智能体将学习避免危险任务,而运动规划器确保所选任务是安全的。所提出的框架在仿真和真实环境中都经过了cobot验证,我们将该规划器与硬编码的任务运动规划方法进行了比较。结果表明,我们的规划框架可以1)在关节和任务级别上对不确定的人类运动做出反应;2)减少重复失败目标命令的次数;3)减少重规划请求的总数。

🔬 方法详解

问题定义:论文旨在解决人机协作中,由于人类干预导致机器人任务效率降低的问题。现有方法通常采用硬编码的任务运动规划,难以适应人类不确定的行为,导致频繁的运动重规划和任务失败,增加了计算负担,降低了协作效率。

核心思路:论文的核心思路是利用强化学习(RL)来学习一个任务规划器,该规划器能够根据运动规划器的反馈,选择统计上更安全和高效的任务序列。通过让RL智能体学习避免危险任务,并结合运动规划器来保证任务的安全性,从而在安全性和效率之间取得平衡。

技术框架:该框架包含两个主要模块:RL任务规划器和交互式运动规划器。RL任务规划器负责选择任务序列,它接收来自运动规划器的反馈(例如,任务执行的成功率、碰撞风险等),并根据这些反馈来更新其策略。运动规划器则负责在任务执行过程中,实时检测人类手臂的运动,并在当前路径不再安全时,重新规划新的无碰撞路径。这两个模块相互协作,共同完成人机协作任务。

关键创新:该方法的主要创新在于将强化学习应用于任务规划,使其能够自适应地学习安全高效的任务序列,从而减少了对硬编码规则的依赖,提高了系统的鲁棒性和适应性。此外,该框架还结合了交互式运动规划器,能够实时响应人类的运动,保证任务执行过程的安全性。

关键设计:RL任务规划器使用Q-learning算法来学习最优策略。状态空间包括当前任务、人类的位置等信息,动作空间包括可选择的任务序列。奖励函数的设计至关重要,它需要综合考虑任务的完成情况、碰撞风险、重规划次数等因素。运动规划器采用基于采样的运动规划算法,如RRT*,以快速生成无碰撞路径。具体参数设置和网络结构在论文中未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的规划框架能够有效地应对不确定的人类运动,减少重复失败目标命令的次数,并降低重规划请求的总数。与硬编码的任务运动规划方法相比,该框架在任务完成率、安全性和效率方面均有显著提升。具体性能数据和提升幅度在论文中未明确给出,属于未知信息。

🎯 应用场景

该研究成果可应用于各种人机协作场景,例如工业装配、医疗康复、家庭服务等。通过提高人机协作的安全性、效率和适应性,可以减轻人类的工作负担,提高生产效率,并改善用户体验。未来,该方法有望进一步扩展到更复杂的任务和环境,实现更智能、更安全的人机协作。

📄 摘要(原文)

In a Human-Robot Cooperation (HRC) environment, safety and efficiency are the two core properties to evaluate robot performance. However, safety mechanisms usually hinder task efficiency since human intervention will cause backup motions and goal failures of the robot. Frequent motion replanning will increase the computational load and the chance of failure. In this paper, we present a hybrid Reinforcement Learning (RL) planning framework which is comprised of an interactive motion planner and a RL task planner. The RL task planner attempts to choose statistically safe and efficient task sequences based on the feedback from the motion planner, while the motion planner keeps the task execution process collision-free by detecting human arm motions and deploying new paths when the previous path is not valid anymore. Intuitively, the RL agent will learn to avoid dangerous tasks, while the motion planner ensures that the chosen tasks are safe. The proposed framework is validated on the cobot in both simulation and the real world, we compare the planner with hard-coded task motion planning methods. The results show that our planning framework can 1) react to uncertain human motions at both joint and task levels; 2) reduce the times of repeating failed goal commands; 3) reduce the total number of replanning requests.