PolygMap: A Perceptive Locomotion Framework for Humanoid Robot Stair Climbing

作者: Bingquan Li, Ning Wang, Tianwei Zhang, Zhicheng He, Yucong Wu

分类: cs.RO

发布日期: 2025-10-14

💡 一句话要点

提出PolygMap框架,实现人形机器人在未知环境中感知驱动的楼梯攀爬

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 人形机器人 楼梯攀爬 运动规划 多传感器融合 语义地图 平面分割

📋 核心要点

- 现有双足机器人行走技术主要集中在平坦地面,缺乏在未知环境中根据视觉信息精确落脚的能力。

- PolygMap框架通过构建实时多边形楼梯平面语义地图,并以此进行足迹规划,实现感知驱动的运动控制。

- 在NVIDIA Orin上部署的实验表明,该方法能以20-30Hz频率进行全身运动规划,并在真实场景中表现出高效性和鲁棒性。

📝 摘要(中文)

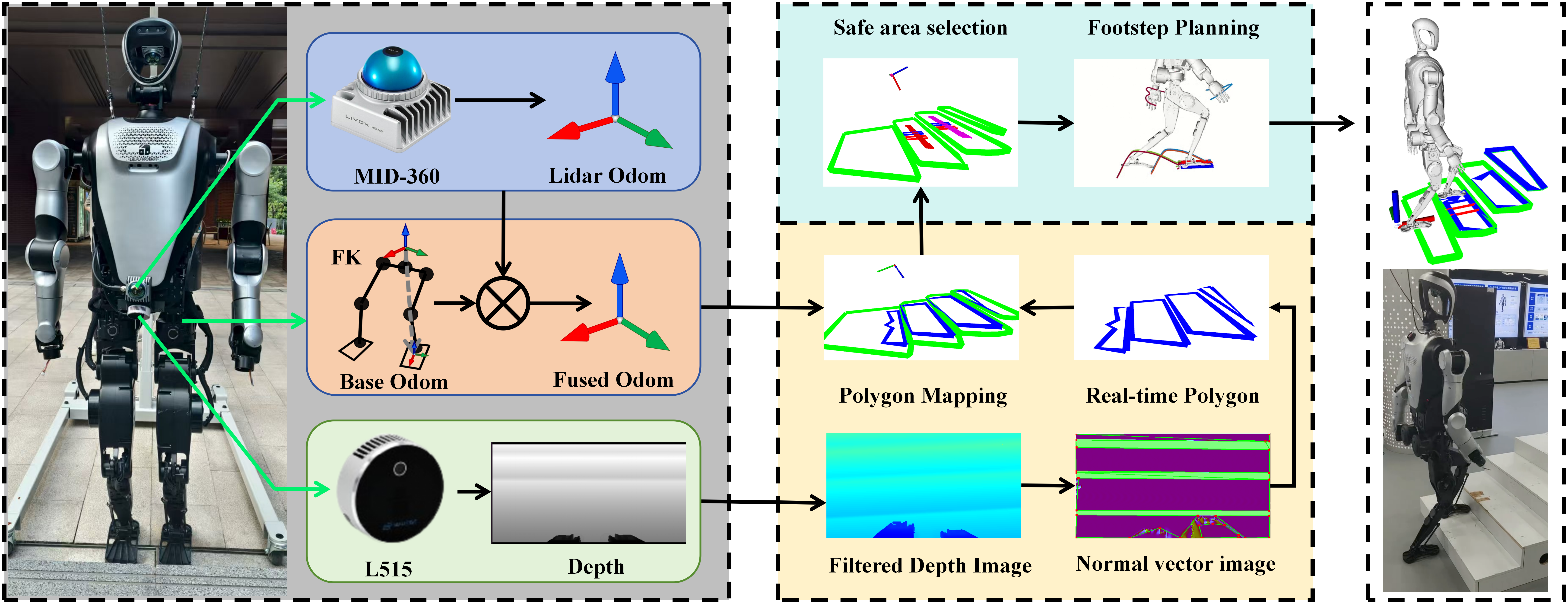

本文提出了一种基于感知的运动规划框架PolygMap,用于人形机器人攀爬楼梯。核心思想是构建一个实时的多边形楼梯平面语义地图,然后利用这些多边形平面片段进行足迹规划。平面分割和视觉里程计通过多传感器融合(激光雷达、RGB-D相机和IMU)完成。该框架部署在NVIDIA Orin上,能够以20-30Hz的频率输出全身运动规划。室内和室外真实场景的实验表明,该方法对于人形机器人攀爬楼梯是高效且鲁棒的。

🔬 方法详解

问题定义:现有的人形机器人行走方案主要针对平坦地面,缺乏在复杂、未知的环境中自主导航和运动的能力。尤其是在楼梯攀爬等任务中,机器人需要准确感知环境几何信息,并规划合理的足迹。现有方法通常依赖于预定义的地图或简单的视觉信息,难以适应真实场景中的各种挑战,例如光照变化、噪声干扰和楼梯形状不规则等。

核心思路:PolygMap的核心思路是构建一个实时的、基于多边形平面分割的楼梯语义地图。通过融合来自激光雷达、RGB-D相机和IMU等多传感器的信息,可以更准确地感知楼梯的几何结构。然后,利用这些多边形平面片段进行足迹规划,确保机器人能够安全、稳定地攀爬楼梯。这种基于感知的运动规划方法能够使机器人更好地适应未知环境。

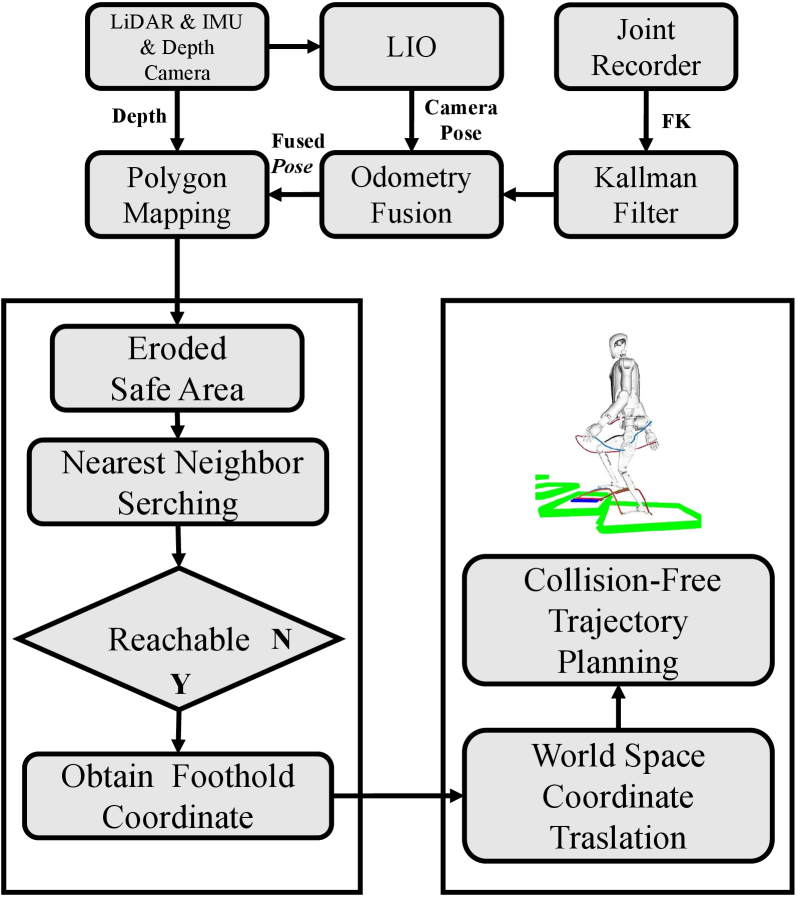

技术框架:PolygMap框架主要包含以下几个模块:1) 多传感器数据采集与融合:利用激光雷达、RGB-D相机和IMU等传感器获取环境信息,并进行数据融合,提高感知精度和鲁棒性。2) 楼梯平面分割:对融合后的点云数据进行平面分割,提取楼梯的各个平面。3) 语义地图构建:将分割后的平面信息构建成多边形楼梯平面语义地图。4) 足迹规划:基于语义地图,规划机器人的足迹,确保其能够安全、稳定地攀爬楼梯。5) 全身运动控制:根据足迹规划结果,进行全身运动控制,驱动机器人完成攀爬动作。

关键创新:该论文的关键创新在于提出了一个基于多边形平面语义地图的楼梯攀爬框架。与传统的基于预定义地图或简单视觉信息的方法相比,PolygMap能够实时构建环境地图,并根据地图信息进行足迹规划,从而更好地适应未知环境。此外,多传感器融合技术也提高了感知精度和鲁棒性。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构等技术细节。但是,多传感器融合策略和多边形平面分割算法是该框架的关键组成部分。具体实现中,可能需要根据传感器的特性和环境的复杂程度,调整滤波参数、分割阈值等。此外,足迹规划算法也需要根据机器人的动力学特性进行优化,以确保运动的稳定性和效率。

🖼️ 关键图片

📊 实验亮点

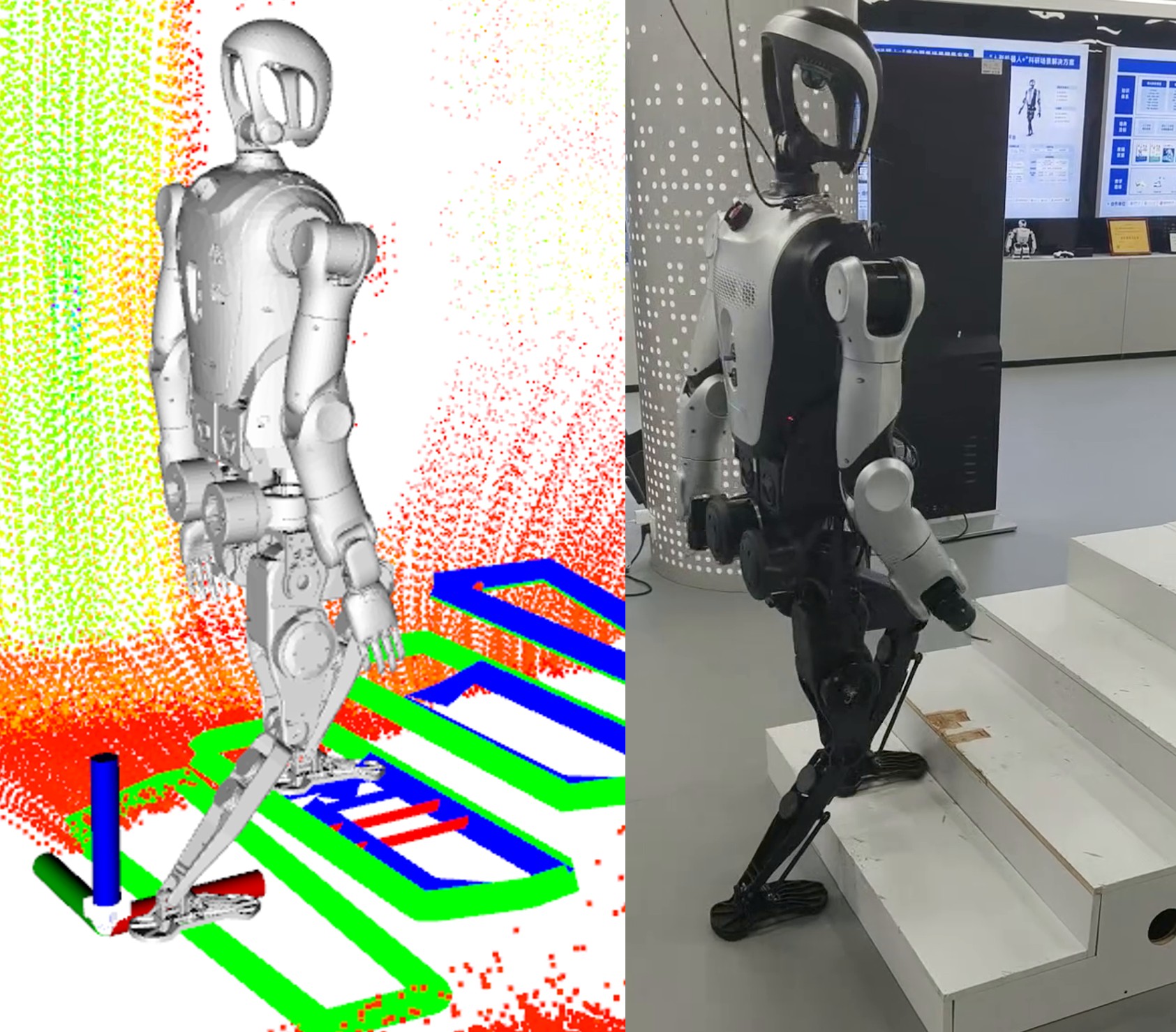

该论文在室内和室外真实场景中进行了实验,验证了PolygMap框架的有效性和鲁棒性。实验结果表明,该框架能够以20-30Hz的频率输出全身运动规划,并成功地使人形机器人攀爬楼梯。虽然论文中没有提供具体的性能数据和对比基线,但实验结果表明该方法在真实场景中具有良好的表现。

🎯 应用场景

PolygMap框架具有广泛的应用前景,例如在家庭服务机器人、医疗辅助机器人、工业巡检机器人等领域。它可以使机器人在复杂环境中自主导航和运动,完成各种任务,例如上下楼梯、跨越障碍物等。此外,该框架还可以应用于灾难救援等场景,帮助机器人在恶劣环境中进行搜索和救援。

📄 摘要(原文)

Recently, biped robot walking technology has been significantly developed, mainly in the context of a bland walking scheme. To emulate human walking, robots need to step on the positions they see in unknown spaces accurately. In this paper, we present PolyMap, a perception-based locomotion planning framework for humanoid robots to climb stairs. Our core idea is to build a real-time polygonal staircase plane semantic map, followed by a footstep planar using these polygonal plane segments. These plane segmentation and visual odometry are done by multi-sensor fusion(LiDAR, RGB-D camera and IMUs). The proposed framework is deployed on a NVIDIA Orin, which performs 20-30 Hz whole-body motion planning output. Both indoor and outdoor real-scene experiments indicate that our method is efficient and robust for humanoid robot stair climbing.