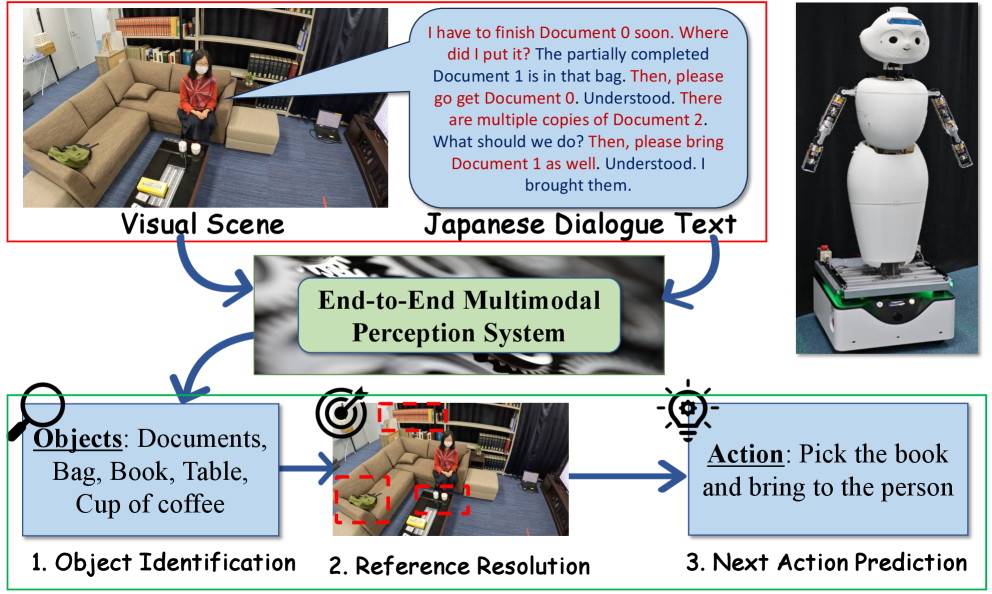

J-ORA: A Framework and Multimodal Dataset for Japanese Object Identification, Reference, Action Prediction in Robot Perception

作者: Jesse Atuhurra, Hidetaka Kamigaito, Taro Watanabe, Koichiro Yoshino

分类: cs.RO, cs.AI, cs.CV

发布日期: 2025-10-13

备注: Accepted to IROS2025

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

J-ORA:用于机器人感知的日语物体识别、指代和动作预测的多模态数据集与框架

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人感知 多模态数据集 视觉语言模型 物体识别 人机交互

📋 核心要点

- 现有机器人感知方法在理解复杂场景和细粒度物体属性方面存在不足,限制了人机交互的自然性。

- J-ORA数据集通过提供详细的日语场景物体属性标注,旨在提升视觉语言模型在物体识别、指代消解和动作预测方面的能力。

- 实验表明,结合详细物体属性的视觉语言模型在多模态感知任务中表现更优,但开源模型与专有模型间仍有差距。

📝 摘要(中文)

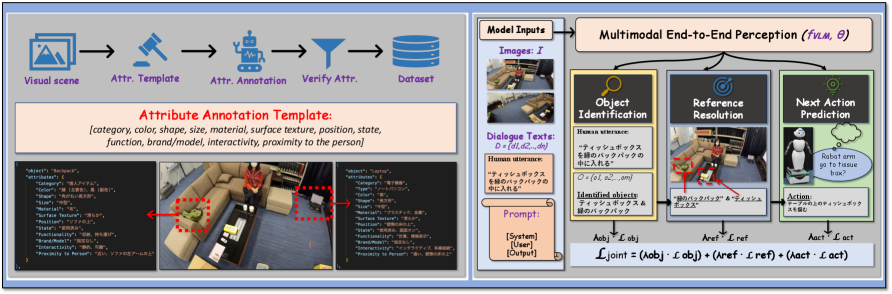

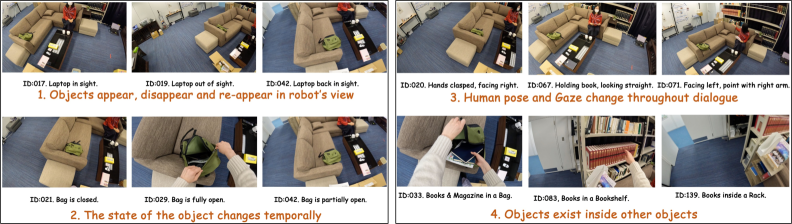

本文介绍了一个名为J-ORA的新型多模态数据集,旨在弥合机器人感知领域的差距。该数据集通过提供日语人机对话场景中详细的物体属性标注,支持三个关键的感知任务:物体识别、指代消解和下一步动作预测。J-ORA利用了一个全面的属性模板(例如,类别、颜色、形状、大小、材料和空间关系)。通过对专有和开源视觉语言模型(VLM)进行广泛评估,结果表明,与不包含物体属性的情况相比,结合详细的物体属性可以显著提高多模态感知性能。尽管有所改进,但我们发现专有VLM和开源VLM之间仍然存在差距。此外,我们对物体可供性的分析表明,不同的VLM在理解物体功能和上下文关系方面存在不同的能力。这些发现强调了在动态环境中推进机器人感知时,丰富、上下文敏感的属性标注的重要性。

🔬 方法详解

问题定义:现有机器人感知系统在理解真实世界复杂场景,特别是涉及细粒度物体属性和人机交互的场景时,面临挑战。缺乏高质量、多模态的日语数据集,限制了视觉语言模型(VLM)在日语环境下的应用,阻碍了机器人理解人类指令和预测下一步动作的能力。现有方法难以有效利用物体属性信息,导致感知精度不足。

核心思路:J-ORA的核心思路是通过构建一个包含详细物体属性标注的多模态数据集,来提升VLM在机器人感知任务中的性能。该数据集专注于日语人机对话场景,提供丰富的上下文信息,包括物体类别、颜色、形状、大小、材料和空间关系等属性。通过对VLM进行训练和评估,可以提高其对物体功能和上下文关系的理解能力。

技术框架:J-ORA框架包含数据集构建和模型评估两个主要部分。数据集构建阶段,收集日语人机对话场景的图像和文本数据,并进行详细的物体属性标注。模型评估阶段,使用J-ORA数据集对现有的VLM进行训练和测试,评估其在物体识别、指代消解和动作预测等任务上的性能。框架还包括一个分析模块,用于分析不同VLM在理解物体可供性方面的差异。

关键创新:J-ORA的关键创新在于其构建了一个高质量、多模态的日语数据集,该数据集包含详细的物体属性标注,能够有效提升VLM在机器人感知任务中的性能。与现有数据集相比,J-ORA更注重人机交互场景,并提供更丰富的上下文信息。此外,J-ORA还对不同VLM在理解物体可供性方面的差异进行了深入分析。

关键设计:J-ORA数据集的物体属性标注采用了一个全面的模板,包括类别、颜色、形状、大小、材料和空间关系等属性。在模型评估阶段,使用了常用的视觉语言模型,并针对不同的感知任务设计了相应的评估指标。损失函数根据具体任务选择,例如,物体识别任务可以使用交叉熵损失函数,指代消解任务可以使用排序损失函数。网络结构方面,可以采用预训练的VLM,并根据具体任务进行微调。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在J-ORA数据集上训练的视觉语言模型,在物体识别、指代消解和动作预测等任务上的性能显著提升。与不包含物体属性的情况相比,结合详细的物体属性可以提高多模态感知性能。虽然专有VLM表现优于开源VLM,但J-ORA数据集的引入缩小了两者之间的差距,为开源VLM的发展提供了有力支持。

🎯 应用场景

J-ORA的研究成果可应用于智能家居、服务机器人、工业自动化等领域。通过提升机器人对物体属性和人类指令的理解能力,可以实现更自然、高效的人机交互。例如,机器人可以根据用户的口头指令,准确识别并操作特定物体,从而提供更智能化的服务。未来,该研究还可以扩展到其他语言和场景,进一步推动机器人感知技术的发展。

📄 摘要(原文)

We introduce J-ORA, a novel multimodal dataset that bridges the gap in robot perception by providing detailed object attribute annotations within Japanese human-robot dialogue scenarios. J-ORA is designed to support three critical perception tasks, object identification, reference resolution, and next-action prediction, by leveraging a comprehensive template of attributes (e.g., category, color, shape, size, material, and spatial relations). Extensive evaluations with both proprietary and open-source Vision Language Models (VLMs) reveal that incorporating detailed object attributes substantially improves multimodal perception performance compared to without object attributes. Despite the improvement, we find that there still exists a gap between proprietary and open-source VLMs. In addition, our analysis of object affordances demonstrates varying abilities in understanding object functionality and contextual relationships across different VLMs. These findings underscore the importance of rich, context-sensitive attribute annotations in advancing robot perception in dynamic environments. See project page at https://jatuhurrra.github.io/J-ORA/.