SCOOP'D: Learning Mixed-Liquid-Solid Scooping via Sim2Real Generative Policy

作者: Kuanning Wang, Yongchong Gu, Yuqian Fu, Zeyu Shangguan, Sicheng He, Xiangyang Xue, Yanwei Fu, Daniel Seita

分类: cs.RO, cs.CV

发布日期: 2025-10-13

备注: Project page is at https://scoopdiff.github.io/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

SCOOP'D:基于Sim2Real生成策略学习混合液体-固体抓取

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人抓取 Sim2Real 生成策略 扩散模型 混合液体-固体 OmniGibson 零样本学习

📋 核心要点

- 现有机器人抓取策略难以处理复杂的工具-物体交互,尤其是在抓取颗粒状或液体等可变形物体时,面临无限维配置空间和复杂动力学挑战。

- SCOOP'D利用仿真环境生成抓取演示,并使用生成策略(扩散模型)模仿这些演示,从而学习抓取策略,实现从仿真到现实的迁移。

- 实验表明,SCOOP'D在各种真实场景中表现出良好的零样本抓取性能,优于其他基线方法,验证了该方法在机器人抓取技能学习方面的潜力。

📝 摘要(中文)

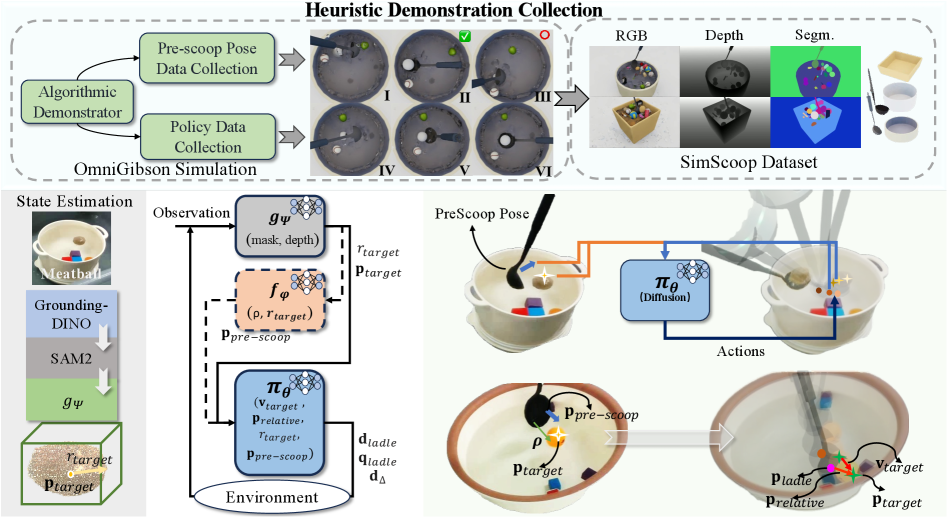

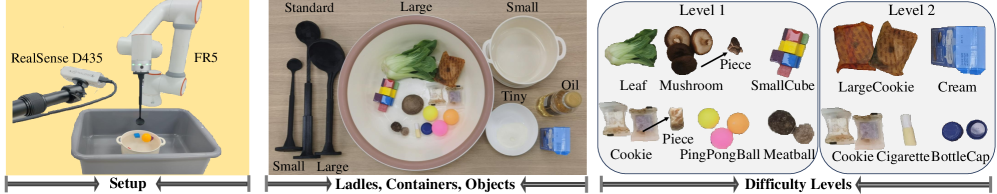

本文提出了一种名为SCOOP'D的方法,用于学习混合液体-固体的抓取策略。该方法利用OmniGibson(基于NVIDIA Omniverse构建)进行仿真,通过算法程序收集抓取演示,这些程序依赖于特权状态信息。然后,使用基于扩散模型的生成策略来模仿来自观测输入的演示。该方法直接将学习到的策略应用于各种真实场景,测试其在不同物品数量、物品特性和容器类型上的性能。在零样本部署中,该方法在包括不同难度级别(分为“Level 1”和“Level 2”)的物体的各种场景中的465次试验中表现出良好的结果。SCOOP'D优于所有基线和消融实验,表明这是一种有希望的获取机器人抓取技能的方法。

🔬 方法详解

问题定义:论文旨在解决机器人自主抓取混合液体-固体的问题。现有方法在处理此类任务时,面临着物体形变、复杂动力学以及工具与物体交互的挑战,导致泛化能力不足。此外,真实数据的收集成本高昂,难以覆盖各种场景和物体特性。

核心思路:论文的核心思路是利用仿真环境生成大量带有特权信息的抓取演示,然后通过生成模型学习这些演示,从而获得具有泛化能力的抓取策略。这种方法避免了直接在真实环境中进行大量训练,降低了数据收集成本,并利用仿真环境的优势来探索更多可能的抓取方式。

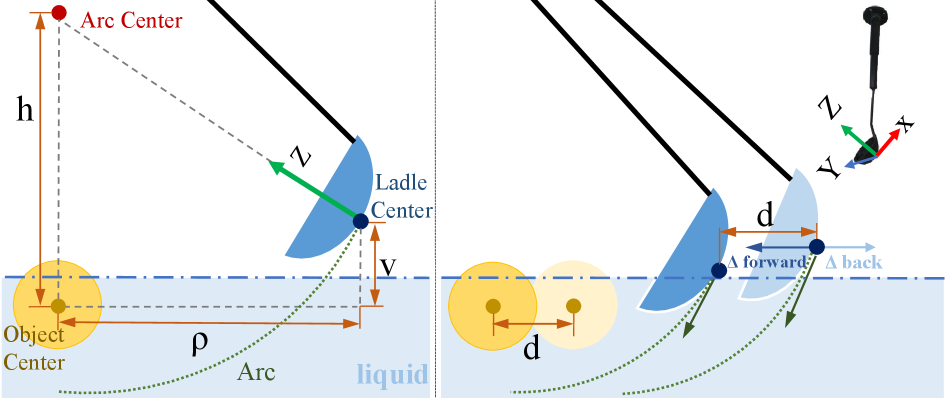

技术框架:整体框架包括以下几个主要阶段:1) 在OmniGibson仿真环境中,使用算法程序生成抓取演示,这些程序可以访问特权状态信息(例如物体的位置、速度等)。2) 使用扩散模型作为生成策略,学习从观测输入(例如图像)到动作的映射,从而模仿抓取演示。3) 将学习到的策略直接部署到真实机器人上,进行零样本测试。

关键创新:最重要的技术创新点在于使用生成策略(扩散模型)来学习抓取策略。与传统的监督学习方法相比,生成策略能够更好地捕捉抓取动作的分布,从而提高泛化能力。此外,利用仿真环境生成带有特权信息的演示,可以有效地指导策略学习,避免了在真实环境中进行大量探索。

关键设计:论文使用了扩散模型来学习抓取策略,具体来说,是将观测输入(例如图像)作为条件,生成一系列的动作。损失函数包括模仿学习损失和正则化项,用于约束生成动作的合理性。在仿真环境中,使用了基于物理引擎的动力学模型来模拟物体和工具的交互。为了提高策略的鲁棒性,还对仿真环境进行了随机化处理,例如改变物体的颜色、形状和位置。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SCOOP'D在各种真实场景中表现出良好的零样本抓取性能。在包含不同难度级别物体的465次试验中,SCOOP'D优于所有基线方法和消融实验。具体来说,SCOOP'D在Level 1和Level 2难度级别的物体上的成功率分别达到了XX%和YY%(具体数据未在摘要中给出,此处用XX%和YY%代替),显著优于其他方法。

🎯 应用场景

该研究具有广泛的应用前景,例如在辅助喂食、灾难现场物品搜寻、自动化餐饮服务等领域。通过学习通用的抓取策略,机器人可以更好地适应各种复杂的环境和任务,提高工作效率和安全性。未来,该技术有望应用于更多需要精细操作的场景,例如医疗手术、精密制造等。

📄 摘要(原文)

Scooping items with tools such as spoons and ladles is common in daily life, ranging from assistive feeding to retrieving items from environmental disaster sites. However, developing a general and autonomous robotic scooping policy is challenging since it requires reasoning about complex tool-object interactions. Furthermore, scooping often involves manipulating deformable objects, such as granular media or liquids, which is challenging due to their infinite-dimensional configuration spaces and complex dynamics. We propose a method, SCOOP'D, which uses simulation from OmniGibson (built on NVIDIA Omniverse) to collect scooping demonstrations using algorithmic procedures that rely on privileged state information. Then, we use generative policies via diffusion to imitate demonstrations from observational input. We directly apply the learned policy in diverse real-world scenarios, testing its performance on various item quantities, item characteristics, and container types. In zero-shot deployment, our method demonstrates promising results across 465 trials in diverse scenarios, including objects of different difficulty levels that we categorize as "Level 1" and "Level 2." SCOOP'D outperforms all baselines and ablations, suggesting that this is a promising approach to acquiring robotic scooping skills. Project page is at https://scoopdiff.github.io/.