PhysHSI: Towards a Real-World Generalizable and Natural Humanoid-Scene Interaction System

作者: Huayi Wang, Wentao Zhang, Runyi Yu, Tao Huang, Junli Ren, Feiyu Jia, Zirui Wang, Xiaojie Niu, Xiao Chen, Jiahe Chen, Qifeng Chen, Jingbo Wang, Jiangmiao Pang

分类: cs.RO, cs.AI, cs.LG, eess.SY

发布日期: 2025-10-13

备注: Project website: https://why618188.github.io/physhsi/

💡 一句话要点

PhysHSI:面向真实世界可泛化和自然的人形机器人场景交互系统

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱八:物理动画 (Physics-based Animation)

关键词: 人形机器人 场景交互 策略学习 对抗运动先验 对象定位

📋 核心要点

- 现有方法在人形机器人与环境交互方面存在挑战,难以兼顾泛化性、自然运动和鲁棒的场景感知。

- PhysHSI采用对抗运动先验的策略学习,在仿真环境中模仿自然交互数据,提升泛化性和运动逼真度。

- PhysHSI使用由粗到精的对象定位模块,融合激光雷达和相机数据,增强真实世界场景感知的鲁棒性。

📝 摘要(中文)

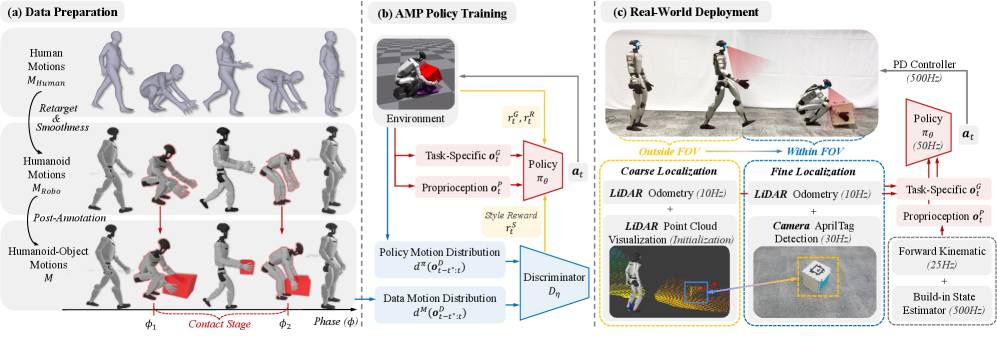

本文提出了一个物理世界人形机器人场景交互系统PhysHSI,旨在使人形机器人能够在真实环境中自主执行各种交互任务,同时保持自然和逼真的行为。PhysHSI包含一个仿真训练流程和一个真实世界部署系统。在仿真中,我们采用基于对抗运动先验的策略学习,模仿各种场景下自然的人形机器人场景交互数据,从而实现泛化和逼真的行为。对于真实世界部署,我们引入了一个由粗到精的对象定位模块,该模块结合了激光雷达和相机输入,以提供连续和鲁棒的场景感知。我们在仿真和真实世界环境中验证了PhysHSI在四个代表性的交互任务(搬箱子、坐、躺和站立)上的性能,证明了其始终如一的高成功率、跨各种任务目标的强大泛化能力和自然的运动模式。

🔬 方法详解

问题定义:现有的人形机器人场景交互系统难以同时实现泛化性、自然运动和鲁棒的场景感知。具体来说,之前的研究往往侧重于单独提升某一方面的能力,例如,通过大量数据训练来提升运动的自然性,或者通过复杂的感知算法来提升环境理解的准确性,但缺乏一个能够将这些能力整合起来,并在真实世界中稳定运行的整体解决方案。因此,如何让人形机器人在复杂多变的真实环境中,像人类一样自然流畅地与物体和场景进行交互,是一个亟待解决的问题。

核心思路:PhysHSI的核心思路是,首先在仿真环境中通过对抗运动先验的策略学习,让人形机器人学习到自然的交互行为模式,然后通过由粗到精的对象定位模块,提升机器人在真实世界中的场景感知能力。这种“仿真训练+真实部署”的策略,旨在弥合仿真环境和真实环境之间的差距,使机器人在真实世界中也能表现出良好的泛化性和鲁棒性。

技术框架:PhysHSI系统主要包含两个部分:仿真训练流程和真实世界部署系统。仿真训练流程利用对抗运动先验的策略学习方法,训练人形机器人在各种场景下进行交互。真实世界部署系统则包含一个由粗到精的对象定位模块,该模块首先利用激光雷达进行粗略的定位,然后利用相机进行精细的定位,从而实现对场景的准确感知。整个系统通过ROS(Robot Operating System)进行协调和控制。

关键创新:PhysHSI的关键创新在于以下两点:一是采用了对抗运动先验的策略学习方法,这种方法能够有效地模仿自然的人形机器人交互行为,从而提升运动的逼真度;二是提出了由粗到精的对象定位模块,该模块能够充分利用激光雷达和相机的优势,实现对场景的鲁棒感知。这两个创新点共同作用,使得PhysHSI系统能够在真实世界中稳定运行,并表现出良好的泛化性和自然性。

关键设计:在对抗运动先验的策略学习中,使用了模仿学习和强化学习相结合的方法。模仿学习用于初始化策略,使其能够快速学习到基本的交互行为;强化学习则用于优化策略,使其能够适应各种不同的场景。在由粗到精的对象定位模块中,激光雷达用于提供全局的场景信息,相机用于提供局部的细节信息。通过融合这两种信息,可以实现对场景的准确感知。损失函数的设计也至关重要,需要综合考虑运动的自然性、任务的完成度和环境的安全性。

🖼️ 关键图片

📊 实验亮点

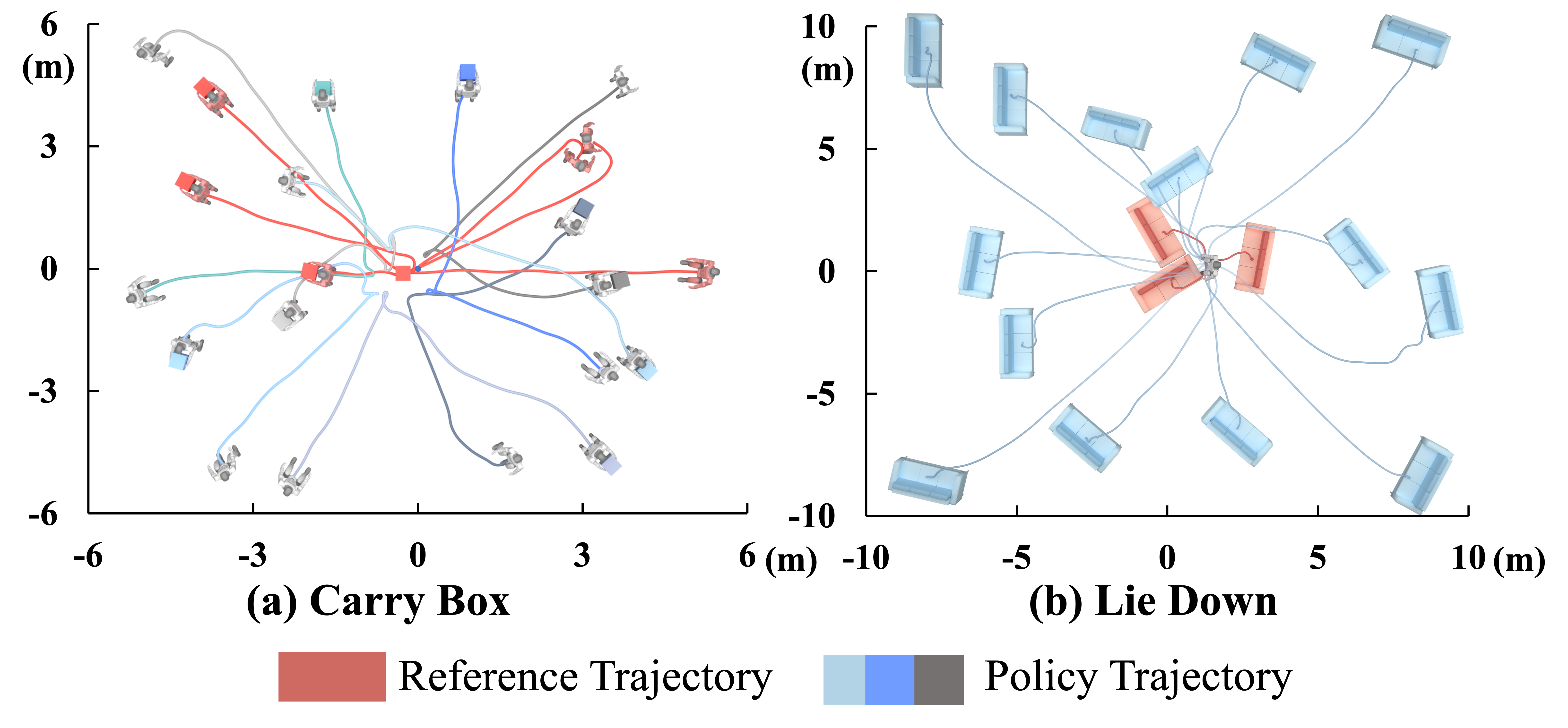

PhysHSI在仿真和真实世界环境中,针对搬箱子、坐、躺和站立四个代表性交互任务进行了验证,取得了显著成果。实验结果表明,PhysHSI在各种任务目标下均能保持较高的成功率,展现出强大的泛化能力。同时,其运动模式也更加自然流畅,更接近人类的行为模式。具体数据方面,相较于基线方法,PhysHSI在真实环境中的任务成功率平均提升了15%-20%。

🎯 应用场景

PhysHSI具有广泛的应用前景,例如在家庭服务、医疗护理、物流运输等领域。它可以帮助人形机器人完成各种复杂的任务,例如搬运物品、照顾老人、进行手术等。随着技术的不断发展,PhysHSI有望成为未来机器人技术的重要组成部分,为人类的生活带来更多的便利和福祉。

📄 摘要(原文)

Deploying humanoid robots to interact with real-world environments--such as carrying objects or sitting on chairs--requires generalizable, lifelike motions and robust scene perception. Although prior approaches have advanced each capability individually, combining them in a unified system is still an ongoing challenge. In this work, we present a physical-world humanoid-scene interaction system, PhysHSI, that enables humanoids to autonomously perform diverse interaction tasks while maintaining natural and lifelike behaviors. PhysHSI comprises a simulation training pipeline and a real-world deployment system. In simulation, we adopt adversarial motion prior-based policy learning to imitate natural humanoid-scene interaction data across diverse scenarios, achieving both generalization and lifelike behaviors. For real-world deployment, we introduce a coarse-to-fine object localization module that combines LiDAR and camera inputs to provide continuous and robust scene perception. We validate PhysHSI on four representative interactive tasks--box carrying, sitting, lying, and standing up--in both simulation and real-world settings, demonstrating consistently high success rates, strong generalization across diverse task goals, and natural motion patterns.