Into the Unknown: Towards using Generative Models for Sampling Priors of Environment Uncertainty for Planning in Configuration Spaces

作者: Subhransu S. Bhattacharjee, Hao Lu, Dylan Campbell, Rahul Shome

分类: cs.RO, cs.AI, cs.CV

发布日期: 2025-10-13

备注: Under Review

💡 一句话要点

提出基于生成模型的采样方法,用于配置空间规划中环境不确定性的先验估计。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 生成模型 机器人规划 环境不确定性 先验信息 部分可观测 配置空间 RGB-D点云

📋 核心要点

- 在部分可观测环境中,机器人规划依赖于准确的环境先验知识,而获取这些先验知识通常非常困难。

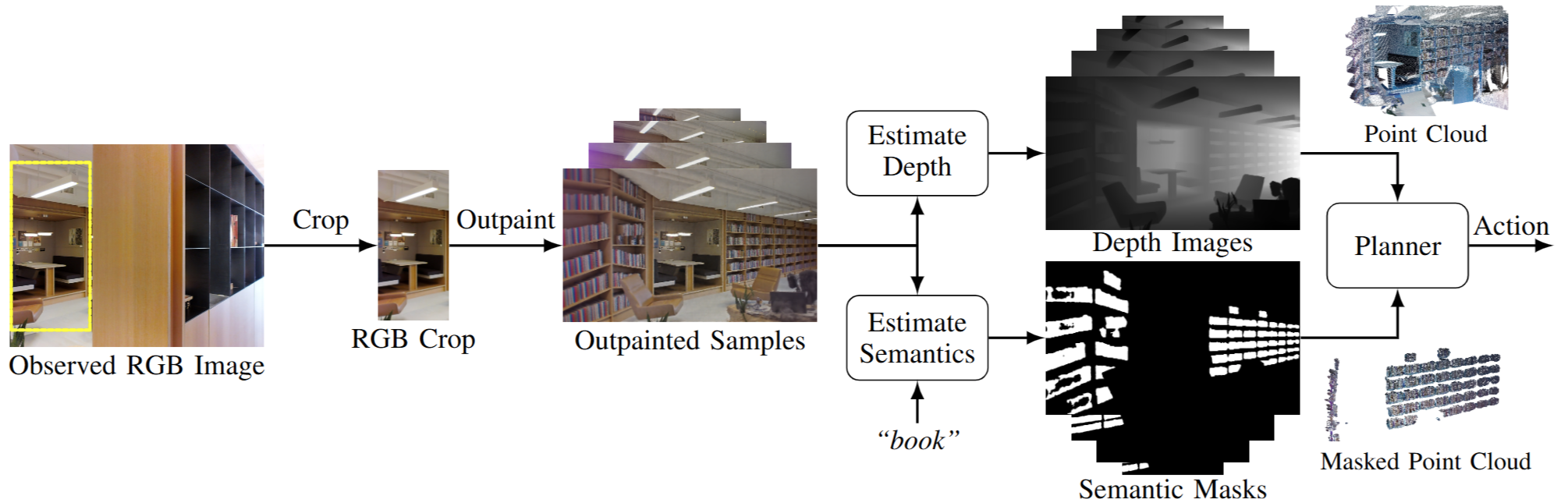

- 论文提出利用预训练生成模型,从部分观测数据中推断出完整的环境信息,包括 occupancy 和目标语义,从而为规划提供先验。

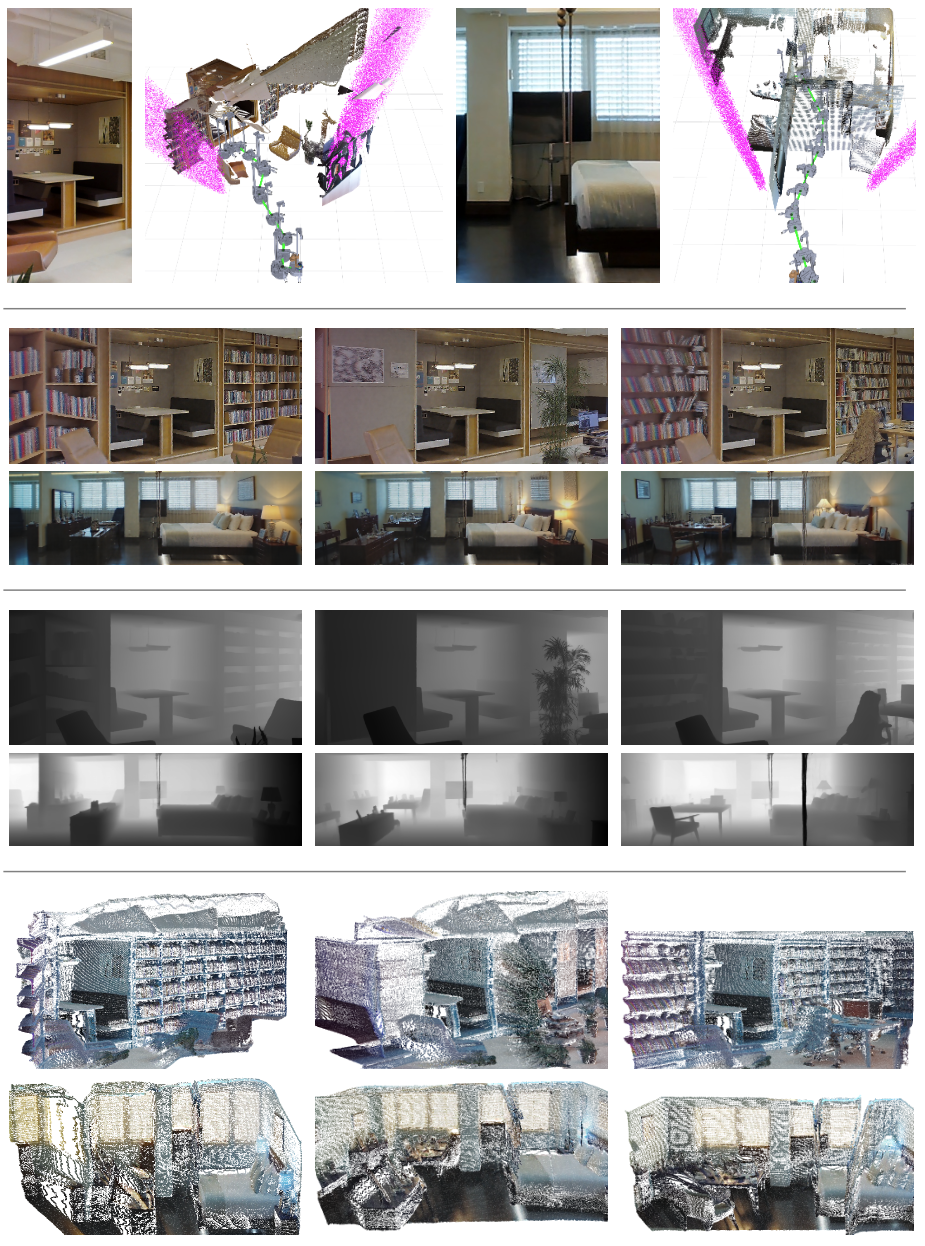

- 实验表明,该方法能够生成符合常识的空间语义信息,并产生高质量的3D点云,可直接用于运动规划。

📝 摘要(中文)

先验信息对于部分可观测下的规划至关重要,但在实践中难以获得。本文提出了一种基于采样的流程,利用大规模预训练生成模型以零样本方式生成概率先验,捕捉环境不确定性和空间语义关系。该流程以部分观测为条件,恢复完整的RGB-D点云样本,包含 occupancy 和目标语义,可以直接用于配置空间规划。我们在 Matterport3D 基准测试中,针对机器人必须导航到未观测目标对象的场景(房间通过门口部分可见),进行了实验。有效的先验必须表示未观测区域中的 occupancy 和目标位置不确定性。实验表明,我们的方法恢复了与 ground truth 一致的常识空间语义,产生了可用于运动规划的多样、干净的 3D 点云,突出了生成模型作为机器人规划的丰富先验来源的潜力。

🔬 方法详解

问题定义:论文旨在解决在部分可观测环境下,机器人如何有效地进行运动规划的问题。现有方法通常依赖于人工设计的先验知识或需要大量数据进行学习,难以泛化到新的环境和任务。痛点在于如何利用有限的观测信息,准确估计未观测区域的环境信息,特别是 occupancy 和目标位置的不确定性。

核心思路:论文的核心思路是利用大规模预训练的生成模型,学习环境的空间语义关系,并根据部分观测信息生成完整的环境表示。通过对生成模型的采样,可以获得多种可能的环境状态,从而表示环境的不确定性。这种方法无需人工设计先验,也无需大量数据进行训练,具有较强的泛化能力。

技术框架:整体流程包括以下几个阶段:1) 输入部分观测的RGB-D点云数据;2) 利用预训练的生成模型,以部分观测数据为条件,生成完整的RGB-D点云;3) 对生成模型进行多次采样,获得多个可能的完整环境表示;4) 将生成的点云数据用于配置空间规划,例如使用RRT算法进行路径规划。

关键创新:最重要的技术创新点在于利用预训练的生成模型作为环境先验的来源。与传统方法相比,该方法无需人工设计先验,也无需大量数据进行训练,具有更强的泛化能力。此外,通过对生成模型进行采样,可以有效地表示环境的不确定性,从而提高规划的鲁棒性。

关键设计:论文使用了大规模预训练的生成模型,例如基于Transformer的模型,用于生成完整的RGB-D点云。损失函数的设计需要考虑生成点云的质量和与部分观测数据的一致性。具体的参数设置和网络结构细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文在 Matterport3D 基准测试中进行了实验,结果表明,该方法能够恢复与 ground truth 一致的常识空间语义,并生成可用于运动规划的多样、干净的 3D 点云。虽然论文中没有给出具体的性能数据和提升幅度,但实验结果表明,该方法能够有效地利用生成模型作为环境先验的来源,为机器人规划提供有价值的信息。

🎯 应用场景

该研究成果可应用于各种需要在部分可观测环境下进行机器人导航和操作的场景,例如家庭服务机器人、仓库自动化、搜索救援等。通过利用生成模型提供的环境先验,机器人可以更有效地规划路径、避开障碍物、找到目标物体,从而提高任务完成的效率和安全性。未来,该方法还可以扩展到更复杂的环境和任务中,例如在动态环境中进行规划,或在多机器人协作中共享环境信息。

📄 摘要(原文)

Priors are vital for planning under partial observability, yet difficult to obtain in practice. We present a sampling-based pipeline that leverages large-scale pretrained generative models to produce probabilistic priors capturing environmental uncertainty and spatio-semantic relationships in a zero-shot manner. Conditioned on partial observations, the pipeline recovers complete RGB-D point cloud samples with occupancy and target semantics, formulated to be directly useful in configuration-space planning. We establish a Matterport3D benchmark of rooms partially visible through doorways, where a robot must navigate to an unobserved target object. Effective priors for this setting must represent both occupancy and target-location uncertainty in unobserved regions. Experiments show that our approach recovers commonsense spatial semantics consistent with ground truth, yielding diverse, clean 3D point clouds usable in motion planning, highlight the promise of generative models as a rich source of priors for robotic planning.