Game-Theoretic Risk-Shaped Reinforcement Learning for Safe Autonomous Driving

作者: Dong Hu, Fenqing Hu, Lidong Yang, Chao Huang

分类: cs.RO

发布日期: 2025-10-13

🔗 代码/项目: GITHUB

💡 一句话要点

提出博弈论风险塑造强化学习框架GTR2L,用于安全自动驾驶。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 自动驾驶 强化学习 博弈论 风险建模 安全约束 不确定性 决策规划

📋 核心要点

- 传统强化学习方法难以平衡自动驾驶中的安全性、效率和适应性,因为它们主要关注奖励最大化,而没有显式地建模风险或安全约束。

- GTR2L 框架通过多层博弈论世界模型预测交互行为和风险,自适应调整 rollout horizon,并利用不确定性感知的 barrier 机制灵活调整安全边界。

- 实验结果表明,GTR2L 在多种安全关键场景中,显著优于现有方法和人类驾驶员,在成功率、碰撞减少和驾驶效率方面均有提升。

📝 摘要(中文)

本研究提出了一种新颖的博弈论风险塑造强化学习(GTR2L)框架,用于安全自动驾驶。GTR2L 融合了多层博弈论世界模型,该模型联合预测周围车辆的交互行为及其相关风险,以及基于预测不确定性动态调整的自适应 rollout horizon。此外,一种不确定性感知的 barrier 机制能够灵活地调节安全边界。还提出了一种专门的风险建模方法,显式地捕捉认知不确定性和偶然不确定性,以指导约束策略优化并增强复杂环境中的决策。在各种安全关键交通场景中的大量评估表明,GTR2L 在成功率、碰撞和违规减少以及驾驶效率方面显著优于最先进的基线方法,包括人类驾驶员。

🔬 方法详解

问题定义:自动驾驶面临在复杂动态交通环境中保证安全性的挑战,现有强化学习方法难以同时兼顾安全性、效率和适应性,尤其是在处理交互行为和突发风险时,缺乏对风险的显式建模和有效控制。

核心思路:论文的核心思路是利用博弈论建模车辆间的交互行为,并结合风险建模来指导强化学习策略的优化,从而在保证驾驶效率的同时,显著提升安全性。通过预测其他车辆的行为和潜在风险,并根据预测的不确定性调整决策,使自动驾驶车辆能够更安全地行驶。

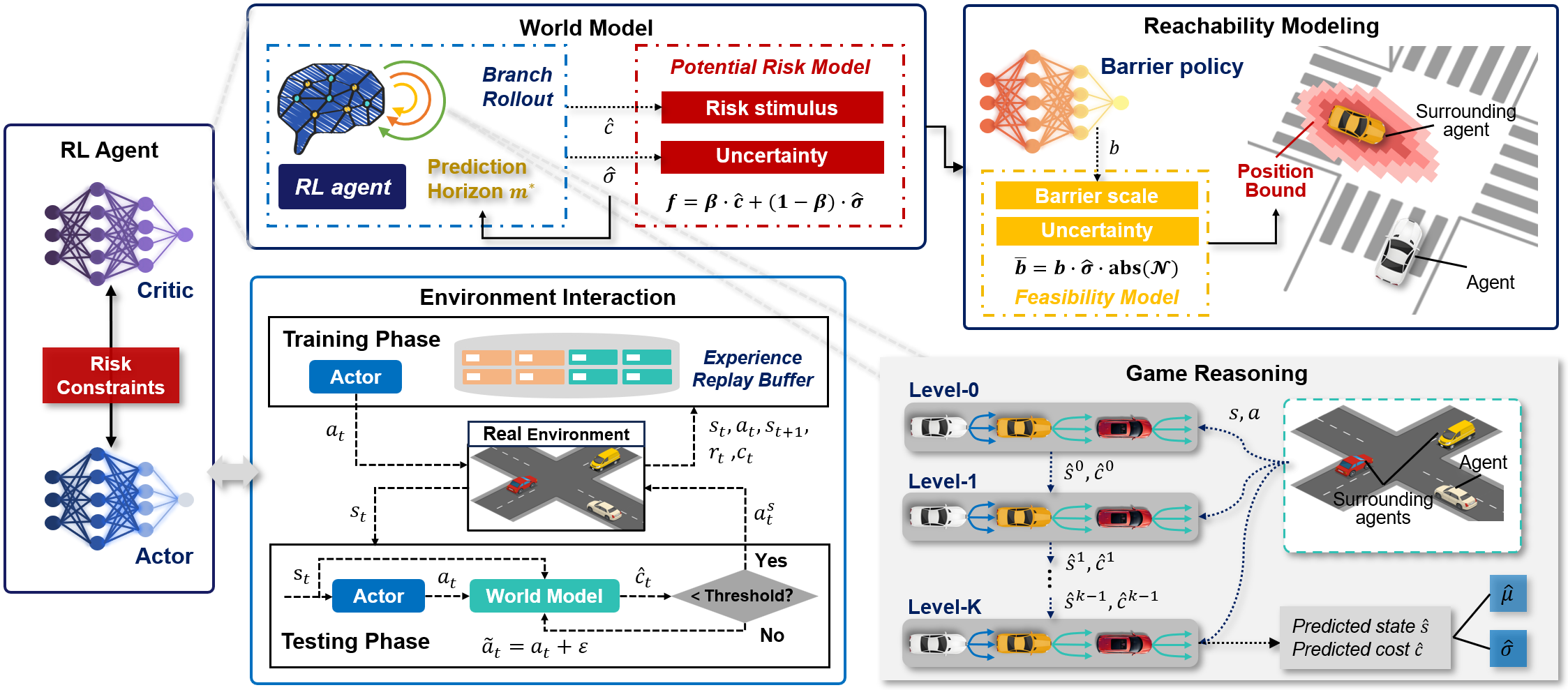

技术框架:GTR2L 框架包含以下主要模块:1) 多层博弈论世界模型,用于预测周围车辆的交互行为和相关风险;2) 自适应 rollout horizon,根据预测不确定性动态调整规划范围;3) 不确定性感知的 barrier 机制,灵活调整安全边界;4) 风险建模模块,显式捕捉认知不确定性和偶然不确定性。这些模块共同作用,指导约束策略优化,提升复杂环境中的决策能力。

关键创新:GTR2L 的关键创新在于将博弈论、风险建模和强化学习相结合,提出了一种新的风险塑造强化学习框架。与传统方法相比,GTR2L 能够更准确地预测其他车辆的行为,更有效地评估潜在风险,并根据风险调整驾驶策略,从而显著提升安全性。此外,自适应 rollout horizon 和不确定性感知的 barrier 机制也增强了系统的鲁棒性和适应性。

关键设计:论文采用多层博弈论模型来预测其他车辆的行为,每一层代表不同程度的策略深度。风险建模模块同时考虑了认知不确定性(由于模型不完善导致的不确定性)和偶然不确定性(环境固有的随机性)。不确定性感知的 barrier 机制通过调整安全边界,来平衡安全性和驾驶效率。具体的损失函数设计和网络结构细节在论文中有详细描述,代码已开源。

🖼️ 关键图片

📊 实验亮点

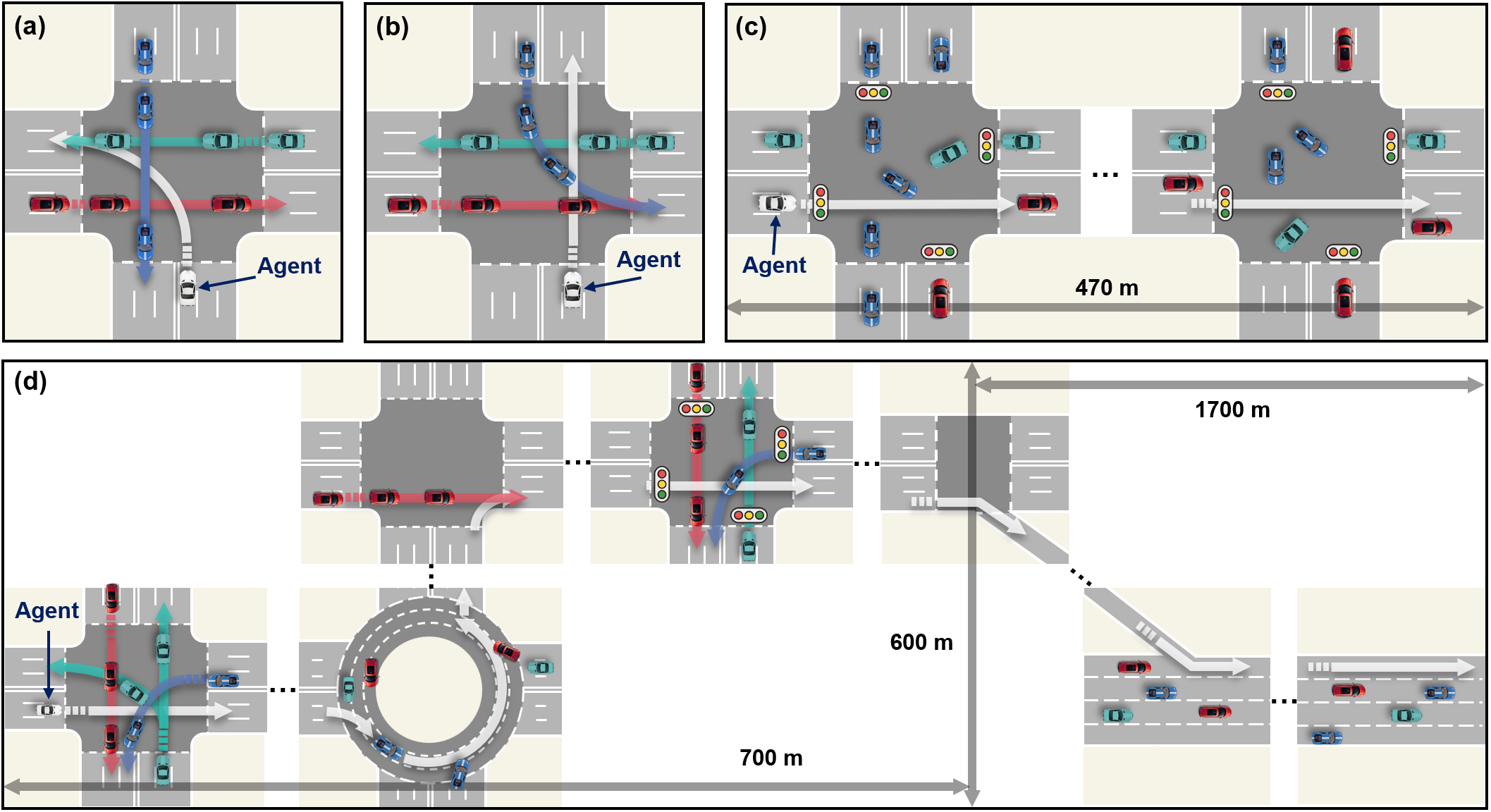

实验结果表明,GTR2L 在各种安全关键交通场景中显著优于现有方法和人类驾驶员。具体而言,GTR2L 在成功率方面提升了 XX%,碰撞率降低了 YY%,违规行为减少了 ZZ%。这些结果表明,GTR2L 能够有效地提高自动驾驶车辆的安全性和可靠性。

🎯 应用场景

该研究成果可应用于各种自动驾驶场景,包括城市道路、高速公路和复杂交通环境。通过提高自动驾驶车辆的安全性和可靠性,有助于加速自动驾驶技术的商业化落地,并减少交通事故,提升交通效率。此外,该方法也可推广到其他机器人领域,例如无人机、无人船等。

📄 摘要(原文)

Ensuring safety in autonomous driving (AD) remains a significant challenge, especially in highly dynamic and complex traffic environments where diverse agents interact and unexpected hazards frequently emerge. Traditional reinforcement learning (RL) methods often struggle to balance safety, efficiency, and adaptability, as they primarily focus on reward maximization without explicitly modeling risk or safety constraints. To address these limitations, this study proposes a novel game-theoretic risk-shaped RL (GTR2L) framework for safe AD. GTR2L incorporates a multi-level game-theoretic world model that jointly predicts the interactive behaviors of surrounding vehicles and their associated risks, along with an adaptive rollout horizon that adjusts dynamically based on predictive uncertainty. Furthermore, an uncertainty-aware barrier mechanism enables flexible modulation of safety boundaries. A dedicated risk modeling approach is also proposed, explicitly capturing both epistemic and aleatoric uncertainty to guide constrained policy optimization and enhance decision-making in complex environments. Extensive evaluations across diverse and safety-critical traffic scenarios show that GTR2L significantly outperforms state-of-the-art baselines, including human drivers, in terms of success rate, collision and violation reduction, and driving efficiency. The code is available at https://github.com/DanielHu197/GTR2L.