GRIP: A Unified Framework for Grid-Based Relay and Co-Occurrence-Aware Planning in Dynamic Environments

作者: Ahmed Alanazi, Duy Ho, Yugyung Lee

分类: cs.RO, cs.AI

发布日期: 2025-10-13

备注: 17 pages, 5 figures, 8 tables

💡 一句话要点

GRIP:动态环境中基于网格的中继与共现感知统一规划框架

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 机器人导航 符号推理 空间规划 语义SLAM 动态环境 共现感知 开放词汇 grounding

📋 核心要点

- 现有方法依赖静态先验或有限记忆,难以适应部分可观察性和语义模糊性下的动态环境。

- GRIP框架通过动态网格构建、开放词汇对象 grounding 和共现感知符号规划,实现统一的导航。

- 实验表明,GRIP在AI2-THOR和RoboTHOR上显著提升了成功率和路径效率,并在真实机器人上验证了泛化能力。

📝 摘要(中文)

本文提出GRIP,一个统一的模块化框架,用于解决机器人如何在动态、杂乱和语义复杂的环境中导航的问题。GRIP集成了感知、符号推理和空间规划,以应对不同布局和对象类别。该框架包含三个可扩展的变体:GRIP-L(轻量级),优化用于通过语义占用网格进行符号导航;GRIP-F(完整版),支持多跳锚链和基于LLM的自省;GRIP-R(真实世界),支持在感知不确定性下的物理机器人部署。GRIP整合了动态2D网格构建、开放词汇对象 grounding、共现感知符号规划以及使用行为克隆、D*搜索和网格条件控制的混合策略执行。在AI2-THOR和RoboTHOR基准测试上的实验结果表明,GRIP在长时程任务中实现了高达9.6%的成功率提升,以及超过2倍的路径效率(SPL和SAE)改进。定性分析揭示了在模糊场景中可解释的符号计划。在Jetbot上的真实世界部署进一步验证了GRIP在传感器噪声和环境变化下的泛化能力。这些结果表明GRIP是一个鲁棒、可扩展且可解释的框架,可以桥接模拟和真实世界导航。

🔬 方法详解

问题定义:论文旨在解决机器人如何在动态、杂乱和语义复杂的环境中进行有效导航的问题。现有方法通常依赖于静态先验知识或有限的记忆能力,这限制了它们在部分可观察性和语义模糊性下的适应性。此外,将感知、符号推理和空间规划有效整合仍然是一个挑战。

核心思路:GRIP的核心思路是利用动态构建的网格表示环境,并结合开放词汇对象 grounding 和共现感知符号规划,从而实现更鲁棒和可解释的导航。通过中间规划步骤(Intermediate Planning),GRIP能够更好地处理长时程任务和环境变化。

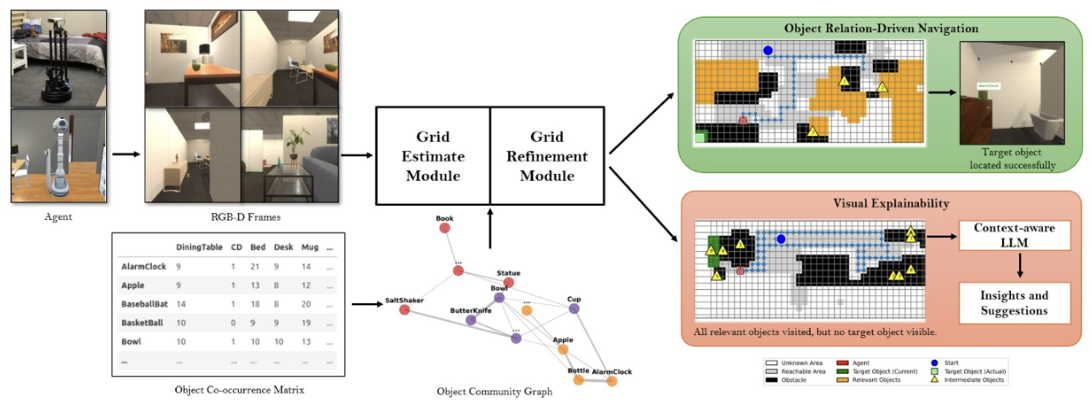

技术框架:GRIP框架包含以下主要模块:1) 动态2D网格构建:根据环境感知信息动态构建2D网格地图。2) 开放词汇对象 grounding:利用视觉模型识别环境中的物体,并将其与符号表示关联。3) 共现感知符号规划:基于物体之间的共现关系进行符号规划,生成可解释的导航计划。4) 混合策略执行:结合行为克隆、D*搜索和网格条件控制等方法,执行生成的导航计划。框架包含三个变体:GRIP-L、GRIP-F和GRIP-R,分别针对不同的应用场景和计算资源进行了优化。

关键创新:GRIP的关键创新在于其统一的框架设计,能够将感知、符号推理和空间规划有效整合。此外,GRIP还引入了共现感知符号规划,利用物体之间的共现关系来提高规划的效率和鲁棒性。GRIP-F变体中基于LLM的自省机制也是一个重要的创新点,能够帮助机器人更好地理解环境和任务。

关键设计:GRIP使用动态更新的语义占用网格来表示环境,网格中的每个单元格都包含语义信息。共现感知符号规划使用概率模型来表示物体之间的共现关系。混合策略执行结合了行为克隆(用于模仿人类行为)、D*搜索(用于路径规划)和网格条件控制(用于低层运动控制)。具体参数设置和网络结构的选择取决于具体的应用场景和计算资源。

🖼️ 关键图片

📊 实验亮点

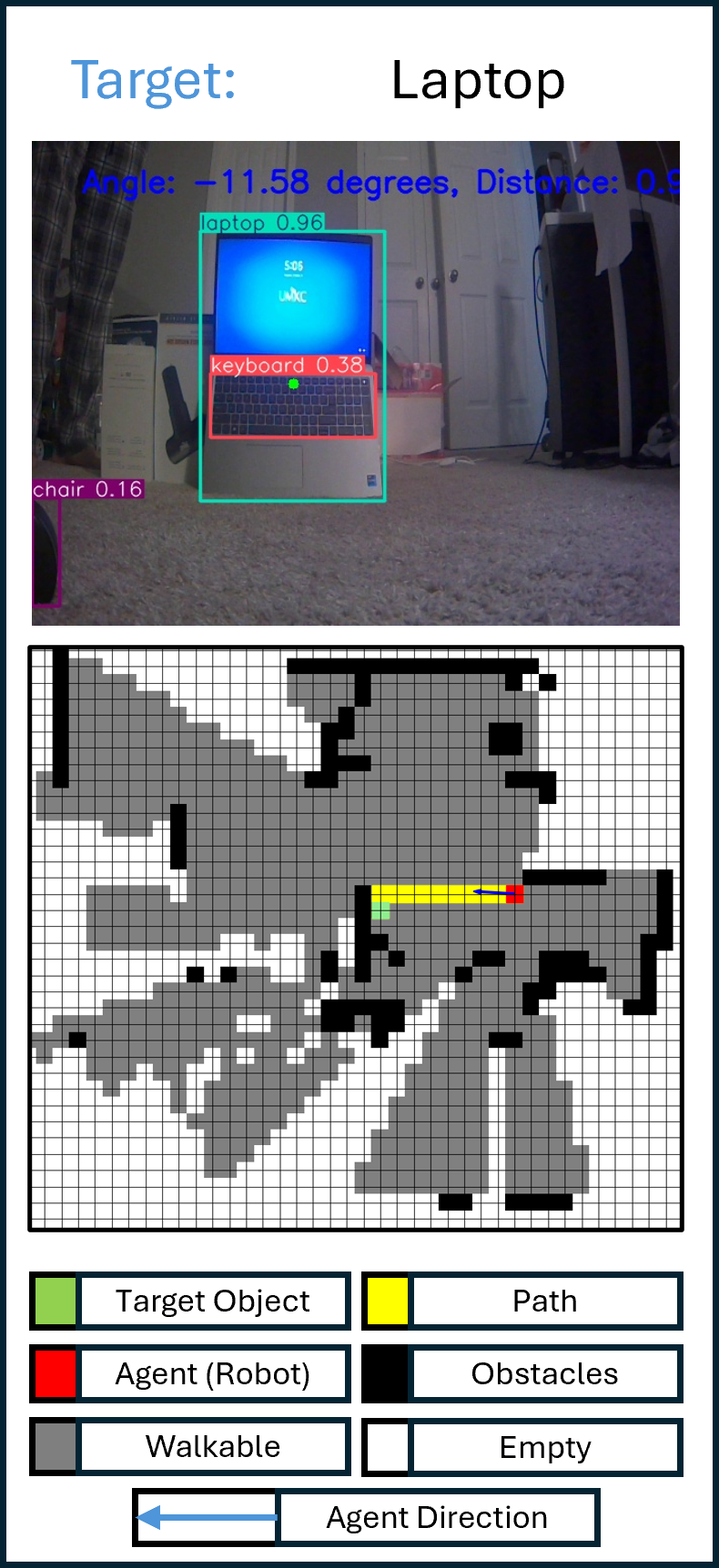

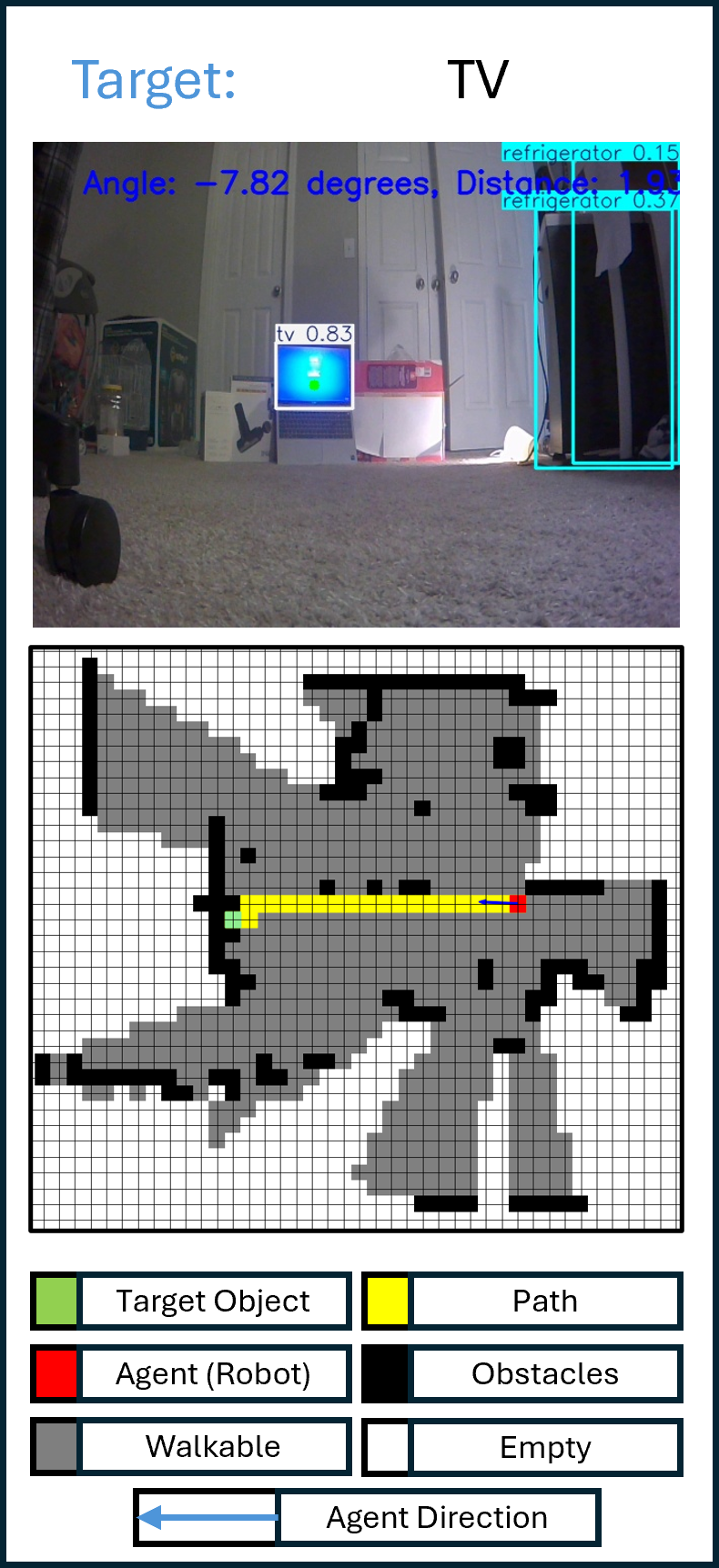

GRIP在AI2-THOR和RoboTHOR基准测试中取得了显著的性能提升,成功率提高了高达9.6%,路径效率(SPL和SAE)提高了超过2倍。在Jetbot上的真实世界部署验证了GRIP在传感器噪声和环境变化下的泛化能力。这些实验结果表明GRIP是一个鲁棒、可扩展且可解释的导航框架。

🎯 应用场景

GRIP框架具有广泛的应用前景,可用于家庭服务机器人、仓储物流机器人、自动驾驶等领域。该框架能够帮助机器人在复杂和动态的环境中进行更智能、更鲁棒的导航,提高机器人的自主性和适应性。此外,GRIP的可解释性也使其在人机协作场景中具有重要价值。

📄 摘要(原文)

Robots navigating dynamic, cluttered, and semantically complex environments must integrate perception, symbolic reasoning, and spatial planning to generalize across diverse layouts and object categories. Existing methods often rely on static priors or limited memory, constraining adaptability under partial observability and semantic ambiguity. We present GRIP, Grid-based Relay with Intermediate Planning, a unified, modular framework with three scalable variants: GRIP-L (Lightweight), optimized for symbolic navigation via semantic occupancy grids; GRIP-F (Full), supporting multi-hop anchor chaining and LLM-based introspection; and GRIP-R (Real-World), enabling physical robot deployment under perceptual uncertainty. GRIP integrates dynamic 2D grid construction, open-vocabulary object grounding, co-occurrence-aware symbolic planning, and hybrid policy execution using behavioral cloning, D* search, and grid-conditioned control. Empirical results on AI2-THOR and RoboTHOR benchmarks show that GRIP achieves up to 9.6% higher success rates and over $2\times$ improvement in path efficiency (SPL and SAE) on long-horizon tasks. Qualitative analyses reveal interpretable symbolic plans in ambiguous scenes. Real-world deployment on a Jetbot further validates GRIP's generalization under sensor noise and environmental variation. These results position GRIP as a robust, scalable, and explainable framework bridging simulation and real-world navigation.