SpikeGrasp: A Benchmark for 6-DoF Grasp Pose Detection from Stereo Spike Streams

作者: Zhuoheng Gao, Jiyao Zhang, Zhiyong Xie, Hao Dong, Zhaofei Yu, Rongmei Chen, Guozhang Chen, Tiejun Huang

分类: cs.RO, cs.CV

发布日期: 2025-10-12

💡 一句话要点

SpikeGrasp:基于立体脉冲事件流的6自由度抓取姿态检测基准

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人抓取 脉冲神经网络 事件相机 神经启发 6自由度姿态估计 立体视觉 异步事件流

📋 核心要点

- 传统机器人抓取系统依赖于将传感器数据转换为3D点云,计算成本高昂且不符合生物学原理。

- SpikeGrasp模仿生物视觉运动通路,直接从立体脉冲事件流中推断抓取姿态,无需重建点云。

- 实验表明,SpikeGrasp在复杂场景中优于传统点云方法,并具有更高的数据效率,为神经启发式抓取开辟了新方向。

📝 摘要(中文)

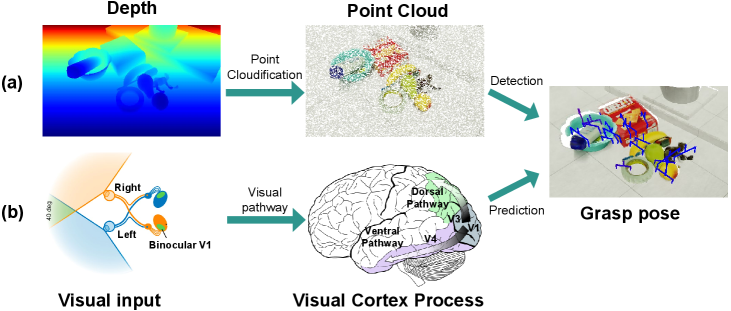

本文提出了一种神经启发的6自由度抓取检测范式,与传统方法将传感器数据转换为显式3D点云不同,该方法模仿生物视觉运动通路,直接处理来自立体脉冲相机(类似于视网膜)的原始异步事件,以推断抓取姿态。我们引入了SpikeGrasp框架,该模型融合了立体脉冲事件流,并使用循环脉冲神经网络(类似于高级视觉处理)迭代地细化抓取假设,而无需重建点云。为了验证该方法,我们构建了一个大规模的合成基准数据集。实验表明,SpikeGrasp超越了传统的基于点云的基线方法,尤其是在杂乱和无纹理的场景中,并表现出卓越的数据效率。通过验证这种端到端的神经启发方法的有效性,SpikeGrasp为未来能够实现自然界中流畅高效操作的系统(特别是对于动态对象)铺平了道路。

🔬 方法详解

问题定义:现有机器人抓取系统通常依赖于从传感器数据(如图像或深度图)重建3D点云,然后进行抓取姿态估计。这种方法计算量大,且在光照变化、纹理缺失或遮挡严重的场景下性能下降。此外,这种方法与生物视觉系统的工作方式存在显著差异,缺乏生物学上的合理性。

核心思路:SpikeGrasp的核心思路是模仿生物视觉系统,直接从立体脉冲事件流中学习抓取姿态,避免了中间的3D重建步骤。通过使用脉冲神经网络处理异步事件,模型能够更高效地利用信息,并对噪声和变化具有更强的鲁棒性。这种端到端的学习方式允许模型直接优化抓取性能,而无需手动设计特征或规则。

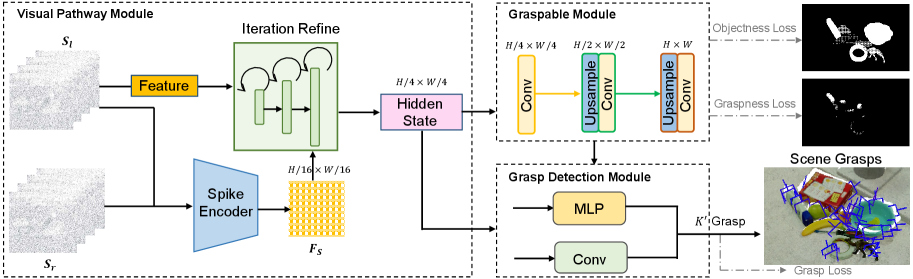

技术框架:SpikeGrasp框架包含以下主要模块:1) 立体脉冲相机:用于捕获场景的异步事件流。2) 事件流融合模块:将来自左右相机的事件流进行融合,形成统一的表示。3) 循环脉冲神经网络:用于处理融合后的事件流,迭代地细化抓取假设。该网络接收事件流作为输入,并输出抓取姿态的估计。4) 抓取姿态优化模块:对网络输出的抓取姿态进行优化,以提高抓取的成功率。

关键创新:SpikeGrasp的关键创新在于其神经启发的端到端学习方法,直接从立体脉冲事件流中学习抓取姿态,避免了中间的3D重建步骤。与传统的基于点云的方法相比,SpikeGrasp更高效、更鲁棒,并且更符合生物视觉系统的工作方式。此外,使用循环脉冲神经网络能够有效地处理异步事件流,并进行时序信息的建模。

关键设计:SpikeGrasp使用循环脉冲神经网络(RSNN)作为其核心处理单元。RSNN的结构和参数经过精心设计,以有效地处理异步事件流并提取有用的特征。损失函数的设计也至关重要,它直接影响着模型的学习效果。论文中使用了合适的损失函数来优化抓取姿态的准确性。此外,数据增强技术也被用于提高模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SpikeGrasp在合成数据集上超越了传统的基于点云的基线方法,尤其是在杂乱和无纹理的场景中。SpikeGrasp还表现出卓越的数据效率,即在较少的数据量下就能达到较高的性能。这些结果验证了SpikeGrasp方法的有效性,并表明其具有实际应用潜力。

🎯 应用场景

SpikeGrasp具有广泛的应用前景,例如在光照条件恶劣、纹理信息不足或存在遮挡的复杂环境中进行机器人抓取。该技术可应用于工业自动化、物流、医疗等领域,尤其是在需要快速、准确抓取动态物体的场景中。未来,SpikeGrasp有望推动机器人操作系统的发展,使其更接近生物智能的水平。

📄 摘要(原文)

Most robotic grasping systems rely on converting sensor data into explicit 3D point clouds, which is a computational step not found in biological intelligence. This paper explores a fundamentally different, neuro-inspired paradigm for 6-DoF grasp detection. We introduce SpikeGrasp, a framework that mimics the biological visuomotor pathway, processing raw, asynchronous events from stereo spike cameras, similarly to retinas, to directly infer grasp poses. Our model fuses these stereo spike streams and uses a recurrent spiking neural network, analogous to high-level visual processing, to iteratively refine grasp hypotheses without ever reconstructing a point cloud. To validate this approach, we built a large-scale synthetic benchmark dataset. Experiments show that SpikeGrasp surpasses traditional point-cloud-based baselines, especially in cluttered and textureless scenes, and demonstrates remarkable data efficiency. By establishing the viability of this end-to-end, neuro-inspired approach, SpikeGrasp paves the way for future systems capable of the fluid and efficient manipulation seen in nature, particularly for dynamic objects.