HANDO: Hierarchical Autonomous Navigation and Dexterous Omni-loco-manipulation

作者: Jingyuan Sun, Chaoran Wang, Mingyu Zhang, Cui Miao, Hongyu Ji, Zihan Qu, Han Sun, Bing Wang, Qingyi Si

分类: cs.RO

发布日期: 2025-10-10

备注: 4 pages, 2 figures, this paper has been accepted for the workshop Perception and Planning for Mobile Manipulation in Changing Environments (PM2CE) at IROS 2025

💡 一句话要点

HANDO:用于腿式机器人复杂操作的分层自主导航框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 腿式机器人 自主导航 全身控制 移动操作 强化学习

📋 核心要点

- 现有方法难以在复杂环境中实现腿式机器人自主导航和灵巧操作的无缝集成。

- HANDO框架通过分层结构,将自主导航和全身操作解耦,实现高效的任务执行。

- 论文初步部署了导航模块,未来将进一步完善全身移动操作的精细控制。

📝 摘要(中文)

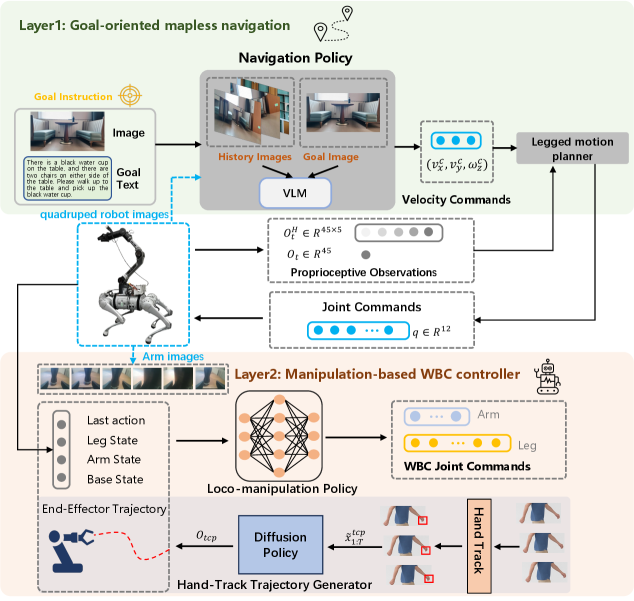

本文提出HANDO(分层自主导航和灵巧的全方位移动操作),一个双层框架,旨在使配备机械臂的腿式机器人在非结构化环境中执行以人为中心的移动操作任务。第一层利用目标条件自主探索策略引导机器人在动态环境中到达语义指定的目标,例如黑色的办公椅。第二层采用统一的全身移动操作策略来协调手臂和腿部,以进行精确的交互任务,例如将饮料递给坐在椅子上的人。我们已经对导航模块进行了初步部署,并将继续进行更精细的全身移动操作部署。

🔬 方法详解

问题定义:论文旨在解决腿式机器人在非结构化动态环境中,如何自主地导航到目标位置并执行复杂的交互操作的问题。现有方法通常难以兼顾导航的全局性和操作的精确性,或者需要大量人工干预,限制了机器人的自主性和泛化能力。

核心思路:HANDO框架的核心思路是将任务分解为两个层次:高层的目标条件自主探索负责全局导航,低层的全身移动操作负责局部交互。这种分层结构能够有效地解耦导航和操作,降低控制复杂度,提高任务执行效率。

技术框架:HANDO框架包含两个主要层:1) 目标条件自主探索层:该层利用强化学习训练的策略,引导机器人在环境中自主探索,并根据语义目标(例如“黑色的办公椅”)规划导航路径。2) 全身移动操作层:该层采用统一的全身控制策略,协调机器人的手臂和腿部,实现精确的交互操作,例如递送物品。这两层通过目标信息进行连接,实现整体任务的协同完成。

关键创新:HANDO的关键创新在于其分层结构和统一的全身控制策略。分层结构能够有效地解耦导航和操作,降低控制复杂度。统一的全身控制策略能够协调手臂和腿部,实现精确的交互操作,提高任务执行效率。

关键设计:目标条件自主探索层使用深度强化学习算法训练导航策略,奖励函数的设计需要考虑导航效率、安全性以及目标语义信息的匹配程度。全身移动操作层可能采用基于优化的控制方法,需要仔细设计目标函数,以实现手臂和腿部的协调运动,并保证机器人的稳定性。

🖼️ 关键图片

📊 实验亮点

论文初步部署了导航模块,验证了目标条件自主探索策略的有效性。虽然全身移动操作的实验结果尚未完全展示,但该框架的设计思路和技术方案具有很强的潜力,有望在未来的研究中取得显著进展。

🎯 应用场景

HANDO框架具有广泛的应用前景,例如在家庭服务、医疗护理、物流运输等领域,可以使腿式机器人自主地完成各种复杂的任务,例如递送物品、清洁环境、辅助病人等。该研究有望推动腿式机器人在实际场景中的应用,提高机器人的智能化水平和服务能力。

📄 摘要(原文)

Seamless loco-manipulation in unstructured environments requires robots to leverage autonomous exploration alongside whole-body control for physical interaction. In this work, we introduce HANDO (Hierarchical Autonomous Navigation and Dexterous Omni-loco-manipulation), a two-layer framework designed for legged robots equipped with manipulators to perform human-centered mobile manipulation tasks. The first layer utilizes a goal-conditioned autonomous exploration policy to guide the robot to semantically specified targets, such as a black office chair in a dynamic environment. The second layer employs a unified whole-body loco-manipulation policy to coordinate the arm and legs for precise interaction tasks-for example, handing a drink to a person seated on the chair. We have conducted an initial deployment of the navigation module, and will continue to pursue finer-grained deployment of whole-body loco-manipulation.