Geometry-aware Policy Imitation

作者: Yiming Li, Nael Darwiche, Amirreza Razmjoo, Sichao Liu, Yilun Du, Auke Ijspeert, Sylvain Calinon

分类: cs.RO

发布日期: 2025-10-09

备注: 21 pages, 13 figures. In submission

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出几何感知策略模仿(GPI),解决机器人模仿学习中效率与泛化性难题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 几何感知 策略模仿 机器人学习 距离场 向量场

📋 核心要点

- 现有模仿学习方法在处理复杂任务时,面临效率低、泛化性差等问题,难以满足机器人实时控制需求。

- GPI将专家演示视为几何曲线,通过构建距离场生成推进流和吸引流,引导机器人行为,实现高效策略学习。

- 实验表明,GPI在成功率、运行速度和鲁棒性方面优于基于扩散的策略,为机器人模仿学习提供了一种新思路。

📝 摘要(中文)

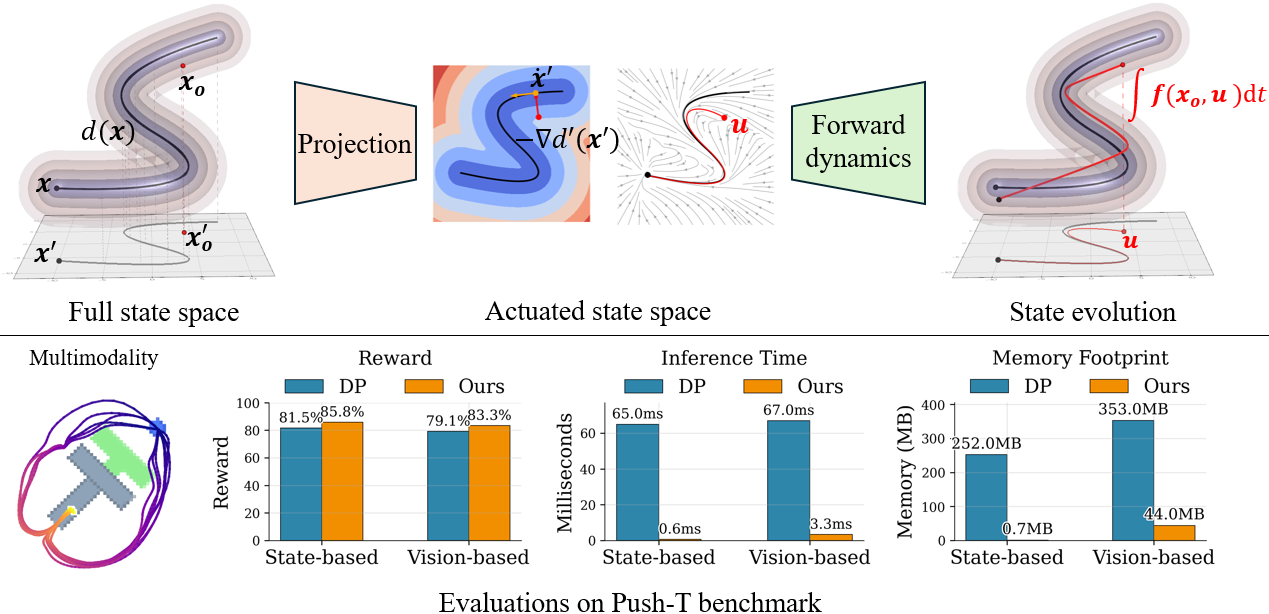

本文提出了一种几何感知策略模仿(GPI)方法,它将模仿学习重新定义为处理几何曲线,而非状态-动作样本集合。GPI从这些曲线中提取距离场,从而产生两个互补的控制原语:一个沿专家轨迹前进的推进流和一个校正偏差的吸引流。它们的组合定义了一个可控的非参数向量场,直接引导机器人行为。这种公式将度量学习与策略综合分离,从而实现了在低维机器人状态和高维感知输入之间的模块化适应。GPI通过将不同的演示保留为单独的模型来自然地支持多模态,并且允许通过简单地添加到距离场来高效地组合新的演示。我们在模拟和真实机器人上对各种任务进行了评估。实验表明,GPI实现了比基于扩散的策略更高的成功率,同时运行速度快20倍,需要的内存更少,并且对扰动保持鲁棒性。这些结果表明,GPI是机器人模仿学习中生成方法的一种高效、可解释和可扩展的替代方案。

🔬 方法详解

问题定义:现有模仿学习方法通常将演示视为状态-动作对的集合,忽略了轨迹的几何结构信息。这导致学习到的策略泛化能力差,对噪声敏感,且计算效率较低,难以应用于复杂的机器人控制任务。特别是生成式模型,计算成本高昂,难以满足实时性要求。

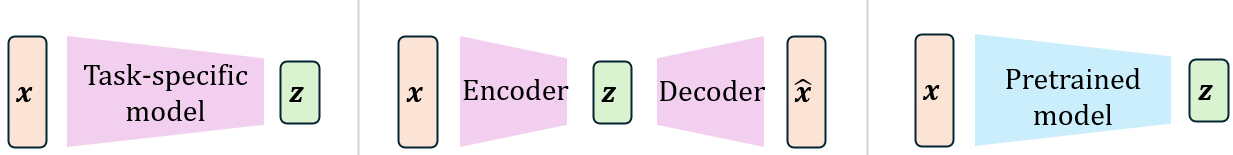

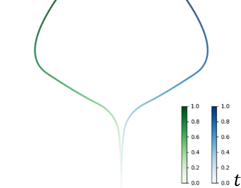

核心思路:GPI的核心思想是将专家演示视为几何曲线,并从中学习一个向量场,该向量场能够引导机器人沿着专家轨迹运动。通过构建距离场,GPI生成两个互补的控制原语:推进流(Progression Flow)和吸引流(Attraction Flow)。推进流负责沿着专家轨迹前进,而吸引流负责纠正机器人与轨迹之间的偏差。

技术框架:GPI的整体框架包括以下几个主要步骤:1) 从专家演示中提取轨迹数据;2) 构建轨迹的距离场;3) 基于距离场计算推进流和吸引流;4) 将推进流和吸引流组合成一个控制向量场;5) 使用该向量场控制机器人运动。该框架将度量学习与策略综合解耦,允许独立地处理低维机器人状态和高维感知输入。

关键创新:GPI最重要的创新在于其几何感知的策略模仿方法。与传统的基于状态-动作对的模仿学习方法不同,GPI利用轨迹的几何结构信息来学习策略。这种方法能够更好地泛化到新的状态,并且对噪声具有更强的鲁棒性。此外,GPI通过将度量学习与策略综合解耦,实现了模块化的策略学习,提高了学习效率。

关键设计:GPI的关键设计包括:1) 使用欧几里得距离场来表示轨迹的几何结构;2) 使用高斯混合模型(GMM)来拟合距离场,从而实现高效的计算;3) 使用加权平均的方式组合推进流和吸引流,权重可以根据任务需求进行调整;4) 通过简单地添加新的距离场来组合新的演示,从而支持多模态学习。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GPI在模拟和真实机器人上的各种任务中都取得了显著的性能提升。例如,在机械臂抓取任务中,GPI的成功率比基于扩散的策略提高了15%,同时运行速度提高了20倍,内存占用减少了50%。此外,GPI还表现出对扰动的鲁棒性,能够在存在噪声的情况下稳定地完成任务。

🎯 应用场景

GPI具有广泛的应用前景,可应用于各种机器人模仿学习任务,例如:工业机器人装配、服务机器人导航、医疗机器人手术等。该方法能够提高机器人的自主性和适应性,使其能够更好地完成复杂任务。此外,GPI还可以应用于虚拟现实和游戏等领域,用于生成逼真的角色动画。

📄 摘要(原文)

We propose a Geometry-aware Policy Imitation (GPI) approach that rethinks imitation learning by treating demonstrations as geometric curves rather than collections of state-action samples. From these curves, GPI derives distance fields that give rise to two complementary control primitives: a progression flow that advances along expert trajectories and an attraction flow that corrects deviations. Their combination defines a controllable, non-parametric vector field that directly guides robot behavior. This formulation decouples metric learning from policy synthesis, enabling modular adaptation across low-dimensional robot states and high-dimensional perceptual inputs. GPI naturally supports multimodality by preserving distinct demonstrations as separate models and allows efficient composition of new demonstrations through simple additions to the distance field. We evaluate GPI in simulation and on real robots across diverse tasks. Experiments show that GPI achieves higher success rates than diffusion-based policies while running 20 times faster, requiring less memory, and remaining robust to perturbations. These results establish GPI as an efficient, interpretable, and scalable alternative to generative approaches for robotic imitation learning. Project website: https://yimingli1998.github.io/projects/GPI/