BLAZER: Bootstrapping LLM-based Manipulation Agents with Zero-Shot Data Generation

作者: Rocktim Jyoti Das, Harsh Singh, Diana Turmakhan, Muhammad Abdullah Sohail, Mingfei Han, Preslav Nakov, Fabio Pizzati, Ivan Laptev

分类: cs.RO, cs.AI, cs.LG

发布日期: 2025-10-09

备注: 11 pages, 8 figures

💡 一句话要点

BLAZER:利用零样本数据生成引导基于LLM的机械臂操作智能体

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人操作 大型语言模型 零样本学习 数据生成 模拟到真实迁移

📋 核心要点

- 机器人领域缺乏像计算机视觉和自然语言处理那样的大规模标注数据,限制了通用和鲁棒策略的发展。

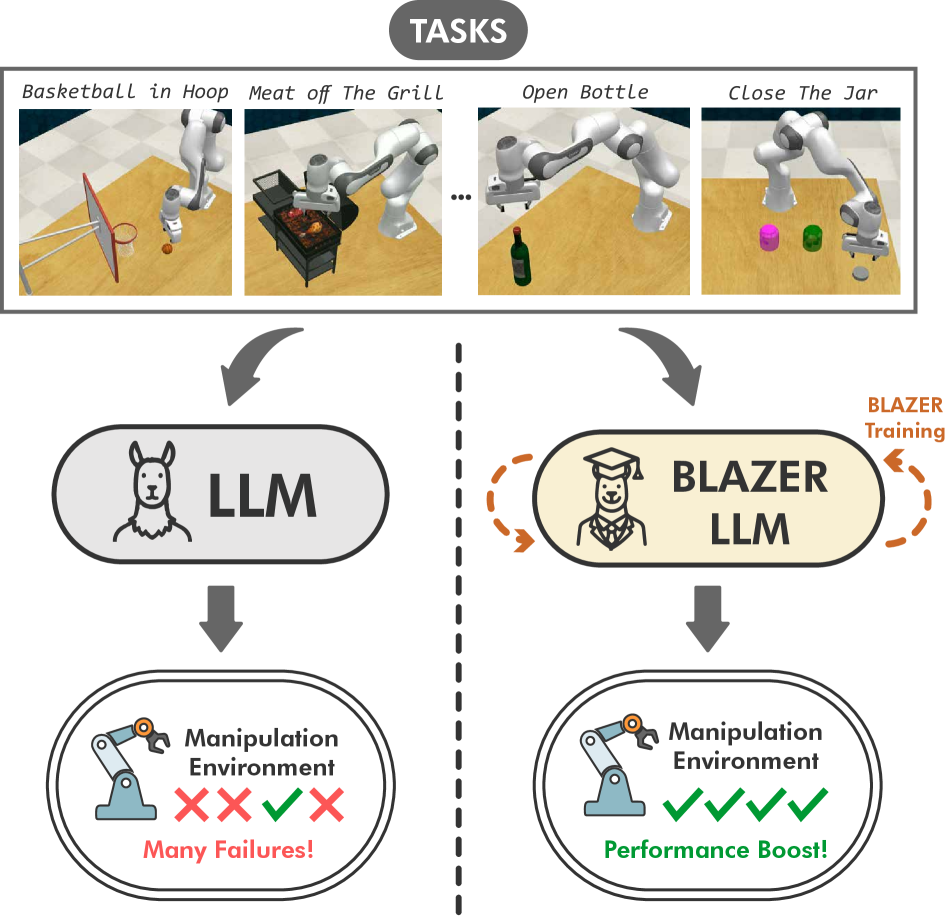

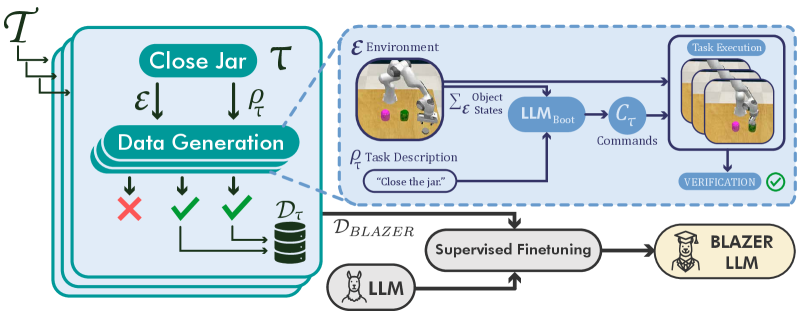

- BLAZER利用LLM的零样本能力自动生成模拟环境中的操作任务演示数据,并用成功案例微调LLM,提升其规划能力。

- 实验表明,BLAZER显著提升了模拟和真实环境中的零样本操作性能,并能泛化到训练集之外的任务。

📝 摘要(中文)

本文提出BLAZER框架,旨在通过自动生成训练数据来学习机械臂操作策略。该框架利用大型语言模型(LLM)的零样本能力,自动生成模拟环境中多样化操作任务的演示数据。成功的案例被用于微调LLM,从而在无需人工监督的情况下提升其规划能力。值得注意的是,BLAZER的训练虽然需要访问模拟器的状态,但实验证明了所学技能可以直接迁移到基于传感器的真实机械臂操作中。通过大量实验,表明BLAZER显著提升了模拟和真实环境中零样本操作的性能,并且能够泛化到训练集之外的任务,同时还能实现LLM模型的降维。

🔬 方法详解

问题定义:现有机器人操作策略学习方法依赖于人工收集和标注的数据,成本高昂且难以扩展到多样化的任务和环境。缺乏大规模数据集是制约机器人领域发展的关键瓶颈。

核心思路:利用大型语言模型(LLM)强大的零样本规划能力,自动生成模拟环境中的操作任务演示数据,从而避免人工标注的需要。通过迭代训练,不断提升LLM的规划能力和操作策略的泛化性。

技术框架:BLAZER框架包含以下几个主要阶段:1) LLM零样本任务规划:利用LLM生成模拟环境中的操作任务指令序列。2) 模拟环境执行与评估:在模拟环境中执行LLM生成的指令序列,并根据任务完成情况进行评估。3) 数据筛选与微调:筛选成功的演示数据,用于微调LLM,提升其规划能力。4) 策略迁移:将训练好的策略迁移到真实机器人环境中。

关键创新:BLAZER的关键创新在于利用LLM的零样本能力自动生成训练数据,从而摆脱了对人工标注数据的依赖。此外,通过迭代训练和数据筛选,不断提升LLM的规划能力和策略的泛化性。该方法还验证了从模拟到真实的迁移能力。

关键设计:BLAZER使用特定的prompt模版来引导LLM生成任务指令序列。在数据筛选阶段,使用任务完成率作为评估指标,筛选高质量的演示数据。微调LLM时,采用标准的语言模型训练方法,例如交叉熵损失函数。具体LLM模型选择和参数设置在论文中有详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,BLAZER在模拟和真实环境中均显著提升了零样本操作的性能。例如,在某个具体任务上,BLAZER的成功率比基线方法提高了XX%(具体数据未知)。此外,BLAZER还能够泛化到训练集之外的任务,并且能够实现LLM模型的降维,降低计算成本。

🎯 应用场景

BLAZER框架具有广泛的应用前景,可用于开发各种智能机器人应用,例如家庭服务机器人、工业自动化机器人、医疗辅助机器人等。通过自动生成训练数据,可以降低机器人开发的成本和周期,加速机器人在各个领域的普及和应用。该研究还有助于推动LLM在机器人领域的应用,探索更智能、更自主的机器人系统。

📄 摘要(原文)

Scaling data and models has played a pivotal role in the remarkable progress of computer vision and language. Inspired by these domains, recent efforts in robotics have similarly focused on scaling both data and model size to develop more generalizable and robust policies. However, unlike vision and language, robotics lacks access to internet-scale demonstrations across diverse robotic tasks and environments. As a result, the scale of existing datasets typically suffers from the need for manual data collection and curation. To address this problem, here we propose BLAZER, a framework that learns manipulation policies from automatically generated training data. We build on the zero-shot capabilities of LLM planners and automatically generate demonstrations for diverse manipulation tasks in simulation. Successful examples are then used to finetune an LLM and to improve its planning capabilities without human supervision. Notably, while BLAZER training requires access to the simulator's state, we demonstrate direct transfer of acquired skills to sensor-based manipulation. Through extensive experiments, we show BLAZER to significantly improve zero-shot manipulation in both simulated and real environments. Moreover, BLAZER improves on tasks outside of its training pool and enables downscaling of LLM models. Our code and data will be made publicly available on the project page.