NovaFlow: Zero-Shot Manipulation via Actionable Flow from Generated Videos

作者: Hongyu Li, Lingfeng Sun, Yafei Hu, Duy Ta, Jennifer Barry, George Konidaris, Jiahui Fu

分类: cs.RO, cs.AI, cs.CV

发布日期: 2025-10-09

💡 一句话要点

NovaFlow:通过生成视频中的可执行光流实现机器人零样本操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting)

关键词: 机器人操作 零样本学习 视频生成 光流估计 动作规划 跨平台迁移 可变形对象操作

📋 核心要点

- 现有机器人操作方法依赖同分布任务或特定机器人数据微调,限制了跨平台迁移能力。

- NovaFlow通过生成视频并提取可执行光流,将任务描述转化为机器人可执行的动作序列。

- 实验表明,NovaFlow在刚性、铰接和可变形对象操作任务中,实现了零样本的有效执行。

📝 摘要(中文)

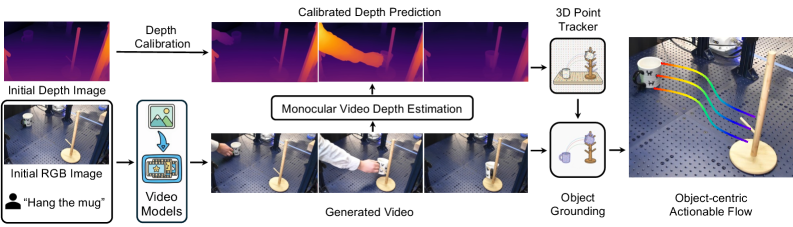

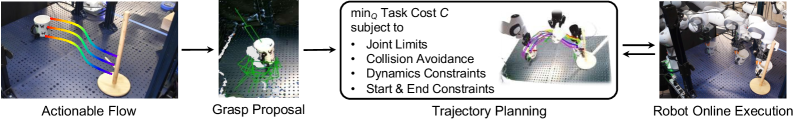

本文提出NovaFlow,一个自主操作框架,旨在使机器人能够零样本执行新的操作任务。现有方法通常假设任务是同分布的,或者依赖于与具体机器人匹配的数据进行微调,限制了跨平台的迁移能力。NovaFlow将任务描述转换为目标机器人的可执行计划,无需任何演示。给定任务描述,NovaFlow使用视频生成模型合成视频,并使用现成的感知模块将其提炼为3D可执行对象光流。从对象光流中,它计算刚性对象的相对姿势,并通过抓取建议和轨迹优化将其实现为机器人动作。对于可变形对象,此光流作为基于粒子动力学模型的模型预测控制的跟踪目标。通过将任务理解与底层控制解耦,NovaFlow自然地跨机器人平台迁移。在桌面Franka机械臂和Spot四足移动机器人上,对刚性、铰接和可变形对象的操作任务进行了验证,实现了有效的零样本执行,无需演示或特定于机器人的训练。

🔬 方法详解

问题定义:现有机器人操作方法在零样本学习方面存在挑战,尤其是在跨不同机器人平台迁移时。主要痛点在于对同分布任务的依赖,以及需要针对特定机器人进行微调,缺乏通用性和泛化能力。

核心思路:NovaFlow的核心思路是将任务理解与底层控制解耦。通过生成视频来模拟任务执行过程,然后从视频中提取可执行的光流信息,作为机器人动作规划的指导。这种方法避免了直接学习机器人控制策略,而是侧重于理解任务本身,从而实现跨平台的零样本迁移。

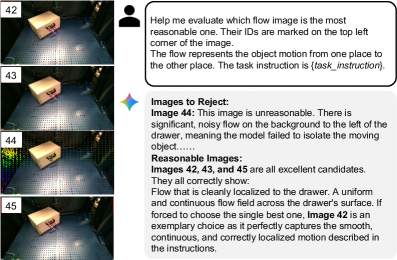

技术框架:NovaFlow框架包含以下几个主要模块:1) 视频生成模块:根据任务描述生成模拟任务执行的视频。2) 对象光流提取模块:从生成的视频中提取3D可执行的对象光流。3) 动作规划模块:根据对象光流,针对刚性对象计算相对姿势,并生成抓取建议和轨迹优化;针对可变形对象,将光流作为模型预测控制的跟踪目标。

关键创新:NovaFlow的关键创新在于利用生成视频作为中间表示,将任务理解与机器人控制解耦。这种方法避免了直接学习复杂的机器人控制策略,而是通过视觉感知和运动规划来实现任务执行。此外,使用对象光流作为可执行的动作表示,使得机器人能够理解任务的目标和约束。

关键设计:视频生成模块可以使用现有的文本到视频生成模型。对象光流提取模块可以使用现成的3D光流估计方法。动作规划模块针对刚性对象使用抓取建议和轨迹优化,针对可变形对象使用基于粒子动力学模型的模型预测控制。具体的参数设置和损失函数需要根据具体的任务和机器人平台进行调整。

🖼️ 关键图片

📊 实验亮点

NovaFlow在桌面Franka机械臂和Spot四足移动机器人上进行了验证,成功实现了刚性、铰接和可变形对象的操作任务的零样本执行。实验结果表明,NovaFlow无需任何演示或特定于机器人的训练,即可有效地完成各种操作任务,展示了其强大的泛化能力和跨平台迁移能力。具体性能数据和对比基线在论文中进行了详细描述。

🎯 应用场景

NovaFlow具有广泛的应用前景,例如在智能制造、家庭服务、医疗康复等领域。它可以帮助机器人自主完成各种复杂的操作任务,例如装配、清洁、护理等。通过零样本学习能力,NovaFlow可以快速适应新的任务和环境,降低了机器人部署和维护的成本。未来,NovaFlow可以与自然语言处理、计算机视觉等技术相结合,实现更智能、更灵活的机器人操作。

📄 摘要(原文)

Enabling robots to execute novel manipulation tasks zero-shot is a central goal in robotics. Most existing methods assume in-distribution tasks or rely on fine-tuning with embodiment-matched data, limiting transfer across platforms. We present NovaFlow, an autonomous manipulation framework that converts a task description into an actionable plan for a target robot without any demonstrations. Given a task description, NovaFlow synthesizes a video using a video generation model and distills it into 3D actionable object flow using off-the-shelf perception modules. From the object flow, it computes relative poses for rigid objects and realizes them as robot actions via grasp proposals and trajectory optimization. For deformable objects, this flow serves as a tracking objective for model-based planning with a particle-based dynamics model. By decoupling task understanding from low-level control, NovaFlow naturally transfers across embodiments. We validate on rigid, articulated, and deformable object manipulation tasks using a table-top Franka arm and a Spot quadrupedal mobile robot, and achieve effective zero-shot execution without demonstrations or embodiment-specific training. Project website: https://novaflow.lhy.xyz/.