Towards Reliable LLM-based Robot Planning via Combined Uncertainty Estimation

作者: Shiyuan Yin, Chenjia Bai, Zihao Zhang, Junwei Jin, Xinxin Zhang, Chi Zhang, Xuelong Li

分类: cs.RO, cs.AI

发布日期: 2025-10-09

💡 一句话要点

提出CURE方法,结合不确定性估计,提升LLM机器人规划的可靠性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM机器人规划 不确定性估计 认知不确定性 内在不确定性 随机网络蒸馏 具身智能 任务规划

📋 核心要点

- 现有基于LLM的机器人规划方法易受LLM幻觉影响,导致规划结果不可靠,安全性难以保证。

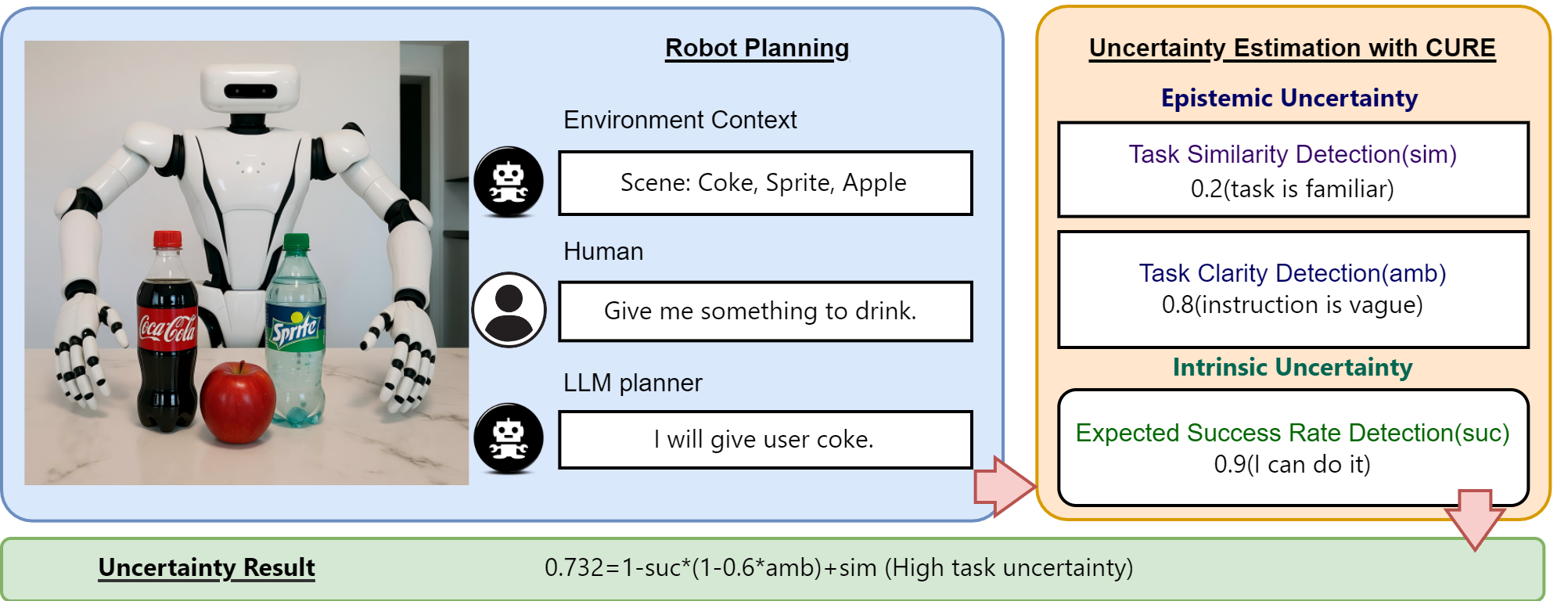

- CURE方法将不确定性分解为认知和内在不确定性,并进一步细分认知不确定性,从而更准确地评估规划风险。

- 在厨房操作和桌面重排实验中,CURE方法的不确定性估计与实际执行结果的对齐程度优于现有方法。

📝 摘要(中文)

大型语言模型(LLMs)展现了先进的推理能力,使机器人能够理解自然语言指令并生成具有适当基础的高级规划。然而,LLM的幻觉现象构成了一个重大挑战,常常导致过度自信但可能错位或不安全的计划。虽然研究人员已经探索了不确定性估计来提高基于LLM的规划的可靠性,但现有研究尚未充分区分认知不确定性和内在不确定性,限制了不确定性估计的有效性。在本文中,我们提出了用于可靠具身规划的组合不确定性估计(CURE),它将不确定性分解为认知不确定性和内在不确定性,分别进行估计。此外,认知不确定性被细分为任务清晰度和任务熟悉度,以进行更准确的评估。使用随机网络蒸馏和由LLM特征驱动的多层感知器回归头获得总体不确定性评估。我们在两个不同的实验环境中验证了我们的方法:厨房操作和桌面重排实验。结果表明,与现有方法相比,我们的方法产生的不确定性估计与实际执行结果更加一致。

🔬 方法详解

问题定义:现有基于LLM的机器人规划方法,由于LLM固有的幻觉问题,生成的规划方案可能存在错误或不安全的情况。现有不确定性估计方法未能充分区分认知不确定性(由于缺乏知识或信息导致的不确定性)和内在不确定性(由于数据本身的随机性导致的不确定性),导致不确定性估计不准确,无法有效指导机器人规划。

核心思路:CURE方法的核心在于将总体不确定性分解为认知不确定性和内在不确定性,并对认知不确定性进一步细分为任务清晰度和任务熟悉度。通过分别估计这些不确定性,可以更准确地评估LLM规划的可靠性,从而提高机器人规划的安全性。这种分解的思路能够更细粒度地捕捉LLM规划中潜在的风险。

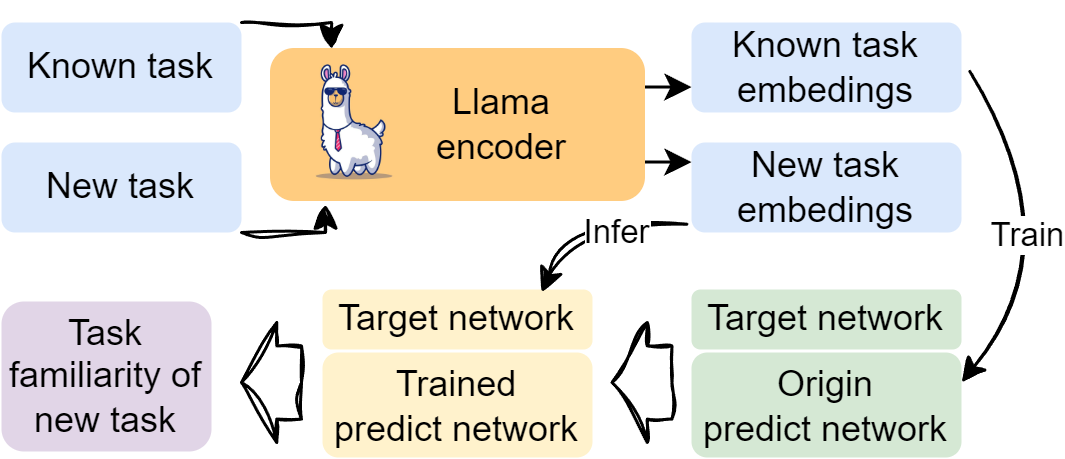

技术框架:CURE方法的技术框架主要包括以下几个模块:1) LLM规划器:负责根据自然语言指令生成机器人规划方案。2) 特征提取器:从LLM的输出中提取特征,用于不确定性估计。3) 认知不确定性估计器:使用多层感知器(MLP)回归头,基于LLM特征估计任务清晰度和任务熟悉度。4) 内在不确定性估计器:使用随机网络蒸馏(RND)方法估计内在不确定性。5) 不确定性融合模块:将认知不确定性和内在不确定性进行融合,得到总体不确定性评估。

关键创新:CURE方法的关键创新在于对不确定性的分解和细化。与现有方法相比,CURE方法不仅区分了认知不确定性和内在不确定性,还进一步将认知不确定性分解为任务清晰度和任务熟悉度。这种更细粒度的不确定性估计能够更准确地反映LLM规划的可靠性,从而提高机器人规划的安全性。现有方法通常只关注总体不确定性,无法区分不同类型的不确定性来源。

关键设计:在认知不确定性估计中,使用了两个MLP回归头分别估计任务清晰度和任务熟悉度。MLP的输入是LLM提取的特征,输出是对应的不确定性值。在内在不确定性估计中,使用了随机网络蒸馏(RND)方法,通过训练一个预测网络来预测目标网络的输出,预测误差作为内在不确定性的度量。总体不确定性通过加权平均认知不确定性和内在不确定性得到,权重可以根据具体任务进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CURE方法在厨房操作和桌面重排两个实验环境中,其不确定性估计与实际执行结果的对齐程度明显优于现有方法。具体而言,CURE方法能够更准确地识别出可能导致失败的规划方案,从而避免机器人执行错误或不安全的动作。量化指标(具体数值未知)表明,CURE方法在不确定性估计的准确性方面取得了显著提升。

🎯 应用场景

该研究成果可应用于各种需要机器人进行复杂任务规划的场景,例如智能家居、自动化工厂、医疗辅助机器人等。通过提高LLM机器人规划的可靠性,可以减少人为干预,提高工作效率,并降低潜在的安全风险。未来,该方法可以进一步扩展到多模态输入和更复杂的任务场景。

📄 摘要(原文)

Large language models (LLMs) demonstrate advanced reasoning abilities, enabling robots to understand natural language instructions and generate high-level plans with appropriate grounding. However, LLM hallucinations present a significant challenge, often leading to overconfident yet potentially misaligned or unsafe plans. While researchers have explored uncertainty estimation to improve the reliability of LLM-based planning, existing studies have not sufficiently differentiated between epistemic and intrinsic uncertainty, limiting the effectiveness of uncertainty estimation. In this paper, we present Combined Uncertainty estimation for Reliable Embodied planning (CURE), which decomposes the uncertainty into epistemic and intrinsic uncertainty, each estimated separately. Furthermore, epistemic uncertainty is subdivided into task clarity and task familiarity for more accurate evaluation. The overall uncertainty assessments are obtained using random network distillation and multi-layer perceptron regression heads driven by LLM features. We validated our approach in two distinct experimental settings: kitchen manipulation and tabletop rearrangement experiments. The results show that, compared to existing methods, our approach yields uncertainty estimates that are more closely aligned with the actual execution outcomes.