FastUMI-100K: Advancing Data-driven Robotic Manipulation with a Large-scale UMI-style Dataset

作者: Kehui Liu, Zhongjie Jia, Yang Li, Zhaxizhuoma, Pengan Chen, Song Liu, Xin Liu, Pingrui Zhang, Haoming Song, Xinyi Ye, Nieqing Cao, Zhigang Wang, Jia Zeng, Dong Wang, Yan Ding, Bin Zhao, Xuelong Li

分类: cs.RO, cs.AI

发布日期: 2025-10-09

🔗 代码/项目: GITHUB

💡 一句话要点

FastUMI-100K:大规模UMI风格数据集推动数据驱动的机器人操作学习

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人操作 数据集 数据驱动学习 多模态数据 机器人演示学习

📋 核心要点

- 现有机器人操作数据集依赖人工遥操作,存在规模有限、轨迹不够平滑以及难以泛化到不同机器人平台等问题。

- FastUMI-100K数据集通过模块化机器人系统FastUMI收集,具有高可扩展性、灵活性和适应性,旨在满足真实世界复杂操作任务的需求。

- 实验结果表明,FastUMI-100K数据集能够提升多种基线算法的策略成功率,验证了其在真实场景中的鲁棒性和适用性。

📝 摘要(中文)

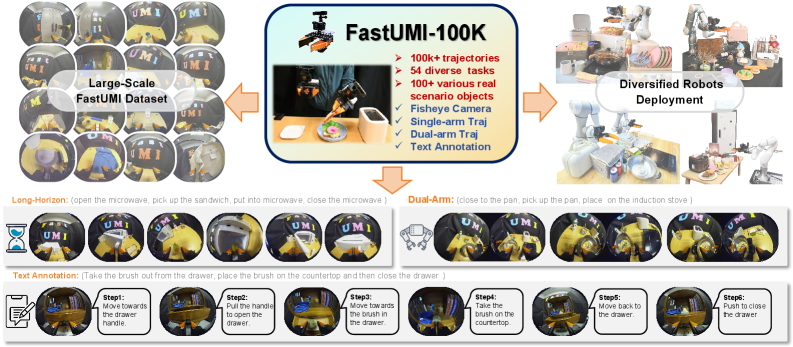

本文提出了FastUMI-100K,一个大规模的UMI风格多模态演示数据集,旨在克服现有机器人操作学习数据集中可扩展性、轨迹平滑性和在真实环境中跨不同机器人形态的适用性等局限。该数据集由FastUMI机器人系统收集,该系统具有模块化、硬件解耦的机械设计和集成的轻量级跟踪系统。FastUMI-100K提供了更具可扩展性、灵活性和适应性的解决方案,以满足真实世界机器人演示数据的多样化需求。该数据集包含超过10万条演示轨迹,涵盖了代表性的家庭环境中的54个任务和数百种物体类型。数据集集成了多模态数据流,包括末端执行器状态、多视角腕部鱼眼图像和文本注释。每条轨迹的长度从120到500帧不等。实验结果表明,FastUMI-100K能够实现各种基线算法的高策略成功率,证实了其在解决复杂、动态操作挑战方面的鲁棒性、适应性和真实世界适用性。

🔬 方法详解

问题定义:现有数据驱动的机器人操作学习方法依赖于大规模专家演示数据集,但现有数据集主要通过人工遥操作收集,在可扩展性、轨迹平滑性以及在真实环境中跨不同机器人形态的适用性方面存在局限性。这些局限性阻碍了机器人操作学习在复杂真实世界任务中的应用。

核心思路:本文的核心思路是构建一个大规模、高质量、多模态的机器人操作演示数据集,该数据集能够克服现有数据集的局限性,并支持各种数据驱动的机器人操作学习算法。通过设计一种新型的机器人系统FastUMI,能够高效地收集大量高质量的演示数据。

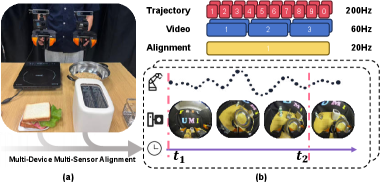

技术框架:FastUMI-100K数据集的构建主要包括以下几个阶段:1) 设计并构建FastUMI机器人系统,该系统具有模块化、硬件解耦的机械设计和集成的轻量级跟踪系统。2) 在代表性的家庭环境中,定义并执行54个不同的操作任务,涵盖数百种物体类型。3) 使用FastUMI机器人系统收集超过10万条演示轨迹,每条轨迹包含末端执行器状态、多视角腕部鱼眼图像和文本注释等多模态数据。4) 对收集到的数据进行清洗、标注和整理,最终构建成FastUMI-100K数据集。

关键创新:该论文的关键创新在于:1) 提出了FastUMI机器人系统,该系统能够高效地收集大规模、高质量的机器人操作演示数据。2) 构建了FastUMI-100K数据集,该数据集在规模、多样性和多模态信息方面优于现有数据集。3) 验证了FastUMI-100K数据集在支持各种数据驱动的机器人操作学习算法方面的有效性。与现有数据集相比,FastUMI-100K具有更高的可扩展性、灵活性和适应性。

关键设计:FastUMI机器人系统的模块化设计允许快速更换和定制不同的末端执行器和传感器。轻量级跟踪系统能够精确地捕捉机器人的运动轨迹。数据集中的多模态信息(末端执行器状态、多视角图像和文本注释)为机器人操作学习提供了更丰富的输入。轨迹长度范围为120到500帧,以适应不同任务的需求。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在FastUMI-100K数据集上训练的机器人操作策略在各种基线算法上都取得了较高的成功率,验证了数据集的有效性。具体而言,使用该数据集训练的策略在多个复杂操作任务上显著优于使用其他数据集训练的策略,表明FastUMI-100K具有更好的泛化能力和鲁棒性。该数据集的规模和多样性使其能够支持更复杂的机器人操作学习算法。

🎯 应用场景

该研究成果可广泛应用于家庭服务机器人、工业自动化、医疗辅助机器人等领域。通过利用FastUMI-100K数据集,可以训练出更鲁棒、更智能的机器人操作策略,从而实现更复杂的任务,例如物品整理、烹饪辅助、医疗康复等。该数据集的发布将促进机器人操作学习领域的发展,加速机器人技术在实际生活中的应用。

📄 摘要(原文)

Data-driven robotic manipulation learning depends on large-scale, high-quality expert demonstration datasets. However, existing datasets, which primarily rely on human teleoperated robot collection, are limited in terms of scalability, trajectory smoothness, and applicability across different robotic embodiments in real-world environments. In this paper, we present FastUMI-100K, a large-scale UMI-style multimodal demonstration dataset, designed to overcome these limitations and meet the growing complexity of real-world manipulation tasks. Collected by FastUMI, a novel robotic system featuring a modular, hardware-decoupled mechanical design and an integrated lightweight tracking system, FastUMI-100K offers a more scalable, flexible, and adaptable solution to fulfill the diverse requirements of real-world robot demonstration data. Specifically, FastUMI-100K contains over 100K+ demonstration trajectories collected across representative household environments, covering 54 tasks and hundreds of object types. Our dataset integrates multimodal streams, including end-effector states, multi-view wrist-mounted fisheye images and textual annotations. Each trajectory has a length ranging from 120 to 500 frames. Experimental results demonstrate that FastUMI-100K enables high policy success rates across various baseline algorithms, confirming its robustness, adaptability, and real-world applicability for solving complex, dynamic manipulation challenges. The source code and dataset will be released in this link https://github.com/MrKeee/FastUMI-100K.