Trajectory Conditioned Cross-embodiment Skill Transfer

作者: YuHang Tang, Yixuan Lou, Pengfei Han, Haoming Song, Xinyi Ye, Dong Wang, Bin Zhao

分类: cs.RO, cs.AI

发布日期: 2025-10-09

💡 一句话要点

TrajSkill:基于轨迹条件的跨具身操作技能迁移框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 跨具身技能迁移 机器人学习 模仿学习 光流轨迹 视频生成

📋 核心要点

- 现有方法依赖配对数据集或手工设计的奖励函数,限制了从人类演示视频中学习机器人操作技能的可扩展性和泛化性。

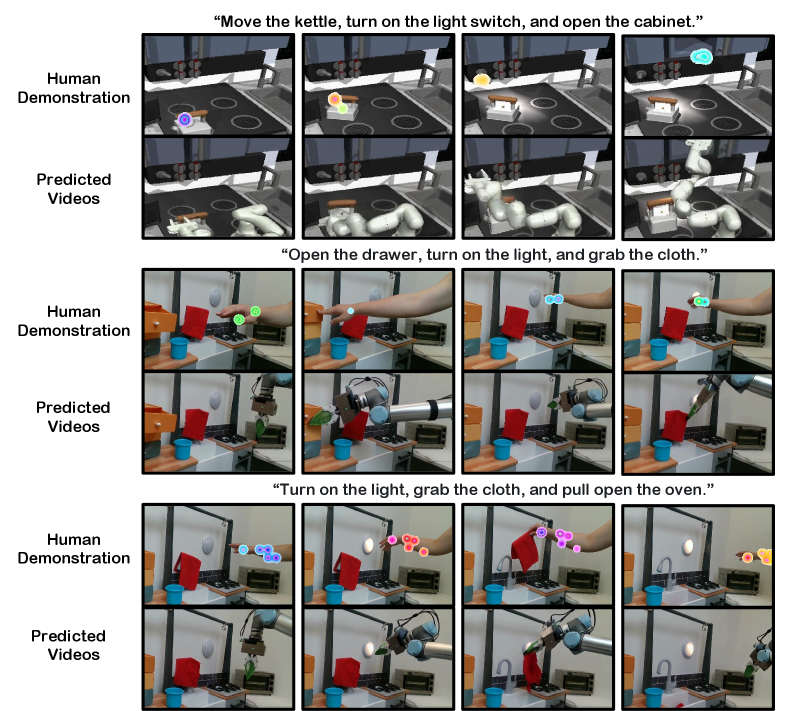

- TrajSkill将人类运动表示为稀疏光流轨迹,作为与具身无关的运动线索,并以此为条件生成机器人操作视频和可执行动作。

- 在MetaWorld仿真环境中,TrajSkill显著降低了FVD和KVD,并提高了跨具身成功率;真实机器人实验验证了其在厨房操作任务中的有效性。

📝 摘要(中文)

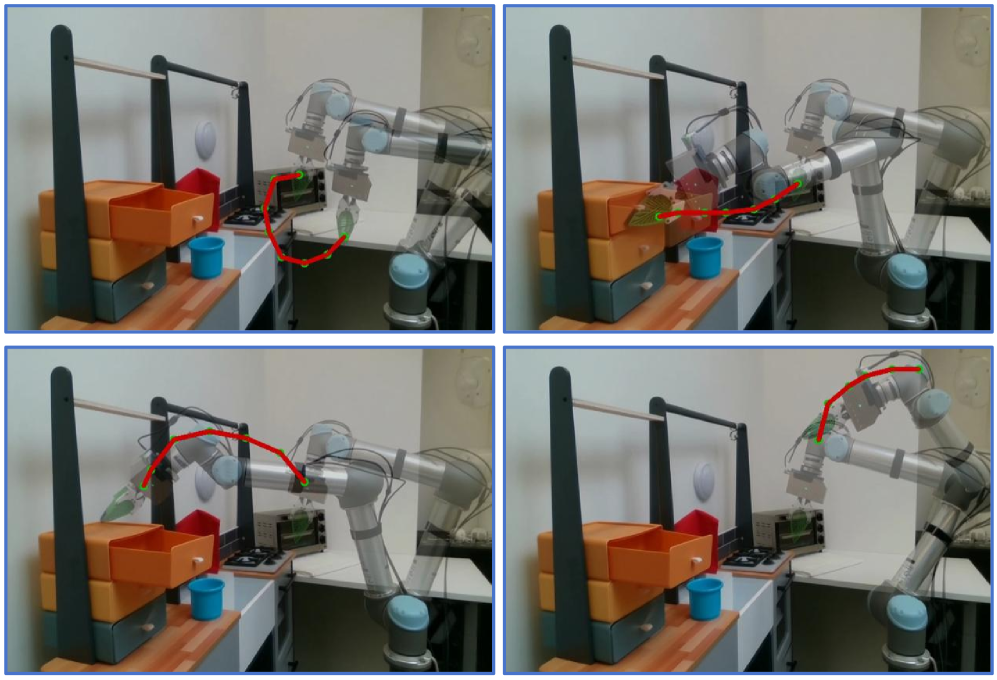

本文提出了一种名为TrajSkill的轨迹条件跨具身技能迁移框架,旨在使机器人能够直接从人类演示视频中学习操作技能。该方法的核心思想是将人类运动表示为稀疏光流轨迹,这些轨迹通过消除形态差异并保留基本动力学,充当与具身无关的运动线索。TrajSkill以这些轨迹以及视觉和文本输入为条件,联合合成时间上一致的机器人操作视频,并将它们转换为可执行的动作,从而实现跨具身技能迁移。在仿真数据(MetaWorld)上的实验结果表明,与最先进的方法相比,TrajSkill的FVD降低了39.6%,KVD降低了36.6%,并且跨具身成功率提高了16.7%。在厨房操作任务中的真实机器人实验进一步验证了该方法的有效性,展示了从人类到机器人的跨具身技能迁移的实用性。

🔬 方法详解

问题定义:现有方法在机器人从人类演示视频中学习操作技能时,面临着巨大的人体与机器人之间的具身差异。现有方法依赖于配对数据集或手工设计的奖励函数,这限制了它们的可扩展性和泛化能力。因此,如何有效地弥合这种具身差异,实现从人类到机器人的技能迁移是一个关键问题。

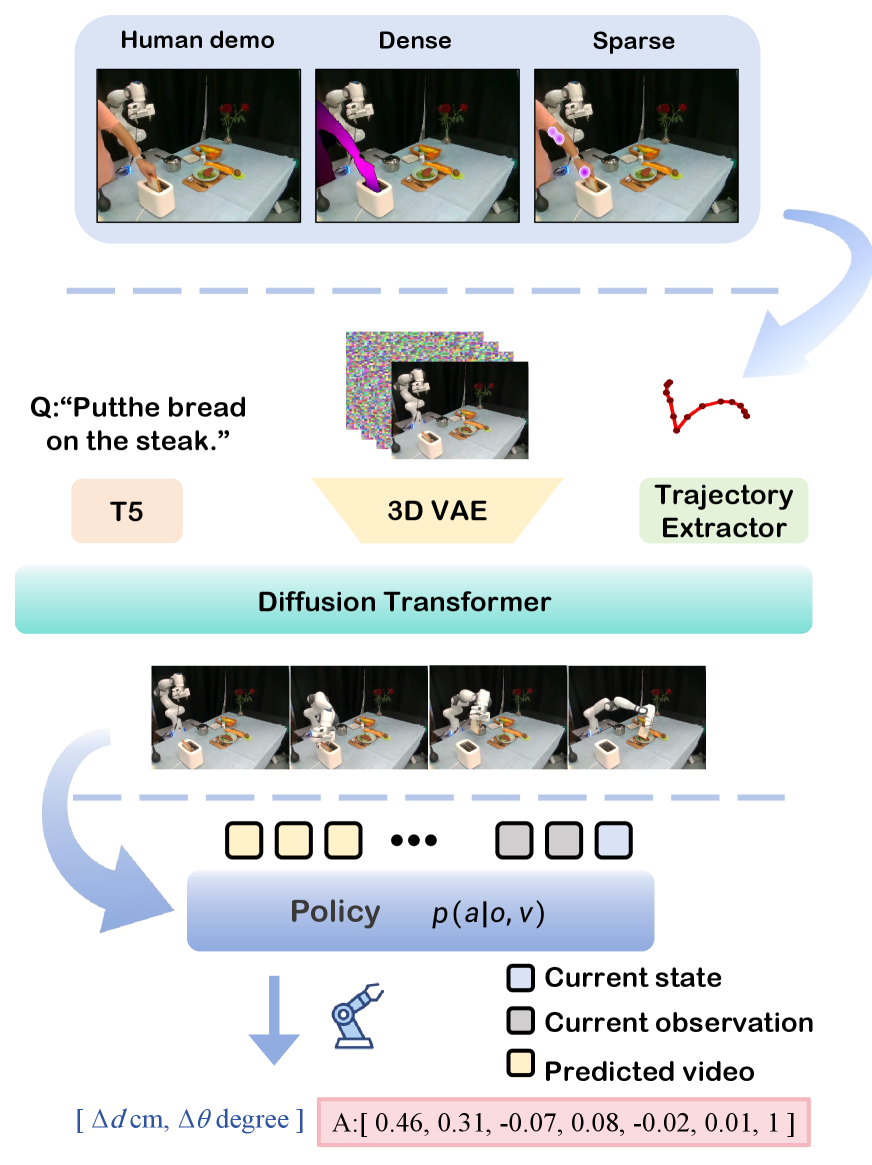

核心思路:TrajSkill的核心思路是将人类的运动解耦为与具身无关的运动轨迹,即稀疏光流轨迹。这些轨迹保留了运动的关键动力学信息,同时消除了人体形态带来的差异。通过将这些轨迹作为条件,模型可以学习生成与机器人具身相关的操作视频和动作。这种解耦和条件生成的方法能够有效地实现跨具身技能迁移。

技术框架:TrajSkill框架包含以下主要模块:1) 运动轨迹提取模块,用于从人类演示视频中提取稀疏光流轨迹;2) 视频生成模块,以提取的轨迹、视觉输入和文本描述为条件,生成机器人操作视频;3) 动作转换模块,将生成的视频转换为机器人可执行的动作序列。整个流程实现了从人类演示到机器人动作的端到端学习。

关键创新:TrajSkill最重要的技术创新在于使用稀疏光流轨迹作为与具身无关的运动表示。这种表示方法能够有效地消除人体形态带来的差异,保留运动的关键动力学信息,从而实现跨具身技能迁移。与直接学习像素级别的对应关系或依赖手工设计的奖励函数相比,这种方法更加通用和可扩展。

关键设计:在视频生成模块中,使用了时序一致性损失函数,以保证生成的机器人操作视频在时间上的连贯性。在动作转换模块中,使用了强化学习方法,以优化机器人执行动作的成功率。此外,还使用了对抗训练方法,以提高生成视频的真实感。

🖼️ 关键图片

📊 实验亮点

TrajSkill在MetaWorld仿真环境中的实验结果表明,与当前最先进的方法相比,FVD(Fréchet Video Distance)降低了39.6%,KVD(Kernel Video Distance)降低了36.6%,跨具身成功率提高了高达16.7%。这些数据表明TrajSkill在跨具身技能迁移方面具有显著的优势。真实机器人实验也验证了该方法在厨房操作任务中的有效性。

🎯 应用场景

该研究成果可广泛应用于机器人自动化领域,例如家庭服务机器人、工业机器人等。通过学习人类的演示视频,机器人可以快速掌握各种操作技能,从而提高其智能化水平和服务能力。此外,该方法还可以应用于虚拟现实和增强现实领域,实现人机交互的自然性和智能化。

📄 摘要(原文)

Learning manipulation skills from human demonstration videos presents a promising yet challenging problem, primarily due to the significant embodiment gap between human body and robot manipulators. Existing methods rely on paired datasets or hand-crafted rewards, which limit scalability and generalization. We propose TrajSkill, a framework for Trajectory Conditioned Cross-embodiment Skill Transfer, enabling robots to acquire manipulation skills directly from human demonstration videos. Our key insight is to represent human motions as sparse optical flow trajectories, which serve as embodiment-agnostic motion cues by removing morphological variations while preserving essential dynamics. Conditioned on these trajectories together with visual and textual inputs, TrajSkill jointly synthesizes temporally consistent robot manipulation videos and translates them into executable actions, thereby achieving cross-embodiment skill transfer. Extensive experiments are conducted, and the results on simulation data (MetaWorld) show that TrajSkill reduces FVD by 39.6\% and KVD by 36.6\% compared with the state-of-the-art, and improves cross-embodiment success rate by up to 16.7\%. Real-robot experiments in kitchen manipulation tasks further validate the effectiveness of our approach, demonstrating practical human-to-robot skill transfer across embodiments.