TrackVLA++: Unleashing Reasoning and Memory Capabilities in VLA Models for Embodied Visual Tracking

作者: Jiahang Liu, Yunpeng Qi, Jiazhao Zhang, Minghan Li, Shaoan Wang, Kui Wu, Hanjing Ye, Hong Zhang, Zhibo Chen, Fangwei Zhong, Zhizheng Zhang, He Wang

分类: cs.RO, cs.AI, cs.CV

发布日期: 2025-10-08

备注: Project page: https://pku-epic.github.io/TrackVLA-plus-plus-Web/

💡 一句话要点

TrackVLA++:通过增强视觉-语言-动作模型中的推理和记忆能力,实现具身视觉跟踪

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction) 支柱八:物理动画 (Physics-based Animation) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身视觉跟踪 视觉-语言-动作模型 空间推理 时序记忆 Chain-of-Thought 目标识别 机器人

📋 核心要点

- 现有具身视觉跟踪方法在严重遮挡或存在相似干扰物时表现不佳,主要原因是缺乏显式的空间推理和有效的时序记忆。

- TrackVLA++通过引入空间推理机制(Polar-CoT)和目标识别记忆(TIM)来增强VLA模型,从而提升具身视觉跟踪的鲁棒性。

- 实验结果表明,TrackVLA++在EVT-Bench DT split上显著超越现有方法,并在真实世界场景中展现出强大的零样本泛化能力。

📝 摘要(中文)

具身视觉跟踪(EVT)是伴侣机器人、引导机器人和服务助手等实际应用的基础能力,在这些应用中,持续跟踪移动目标至关重要。最近的进展使得在复杂和非结构化场景中进行语言引导的跟踪成为可能。然而,现有方法缺乏显式的空间推理和有效的时序记忆,导致在严重遮挡或存在相似干扰物时失效。为了解决这些挑战,我们提出了TrackVLA++,一种新型的视觉-语言-动作(VLA)模型,它通过两个关键模块增强了具身视觉跟踪能力:空间推理机制和目标识别记忆(TIM)。推理模块引入了一种思维链范式,称为Polar-CoT,它推断目标的相对位置,并将其编码为紧凑的极坐标token用于动作预测。在这些空间先验的指导下,TIM采用门控更新策略来保持长时程目标记忆,确保时空一致性,并减轻在长时间遮挡期间的目标丢失。大量的实验表明,TrackVLA++在自我中心和多摄像头设置下的公共基准测试中都取得了最先进的性能。在具有挑战性的EVT-Bench DT split上,TrackVLA++分别超过了之前的领先方法5.1和12。此外,TrackVLA++表现出强大的零样本泛化能力,能够在动态和遮挡场景中实现鲁棒的真实世界跟踪。

🔬 方法详解

问题定义:论文旨在解决具身视觉跟踪(EVT)中,现有方法在复杂场景下,尤其是在目标被遮挡或存在相似干扰物时,跟踪性能显著下降的问题。现有方法缺乏对目标空间位置的有效推理和对目标长期状态的记忆能力,导致跟踪容易失败。

核心思路:论文的核心思路是通过引入空间推理和目标记忆机制来增强VLA模型。具体来说,利用Chain-of-Thought范式进行空间推理,提取目标的相对位置信息,并使用门控记忆模块来维护目标的长期状态,从而提高跟踪的鲁棒性。

技术框架:TrackVLA++模型包含视觉、语言和动作三个模态的处理模块,以及两个关键模块:Polar-CoT空间推理模块和Target Identification Memory (TIM) 目标识别记忆模块。视觉模块提取图像特征,语言模块处理跟踪指令,Polar-CoT模块进行空间推理,TIM模块维护目标状态,最后动作模块预测下一步动作。整体流程是:输入图像和语言指令,经过各模块处理后,输出跟踪动作。

关键创新:最重要的技术创新点在于Polar-CoT空间推理模块和TIM目标识别记忆模块的结合。Polar-CoT模块通过Chain-of-Thought的方式,将复杂的空间推理过程分解为多个步骤,并输出极坐标形式的位置信息,这与直接预测动作相比,更具解释性和鲁棒性。TIM模块则通过门控机制,选择性地更新和记忆目标状态,有效应对长时间遮挡。

关键设计:Polar-CoT模块采用Transformer结构,通过多层自注意力机制进行推理。TIM模块使用GRU作为记忆单元,并引入门控机制来控制信息的更新和遗忘。损失函数包括动作预测损失和辅助损失,用于指导Polar-CoT模块的学习。具体参数设置和网络结构细节未在摘要中详细说明,属于未知信息。

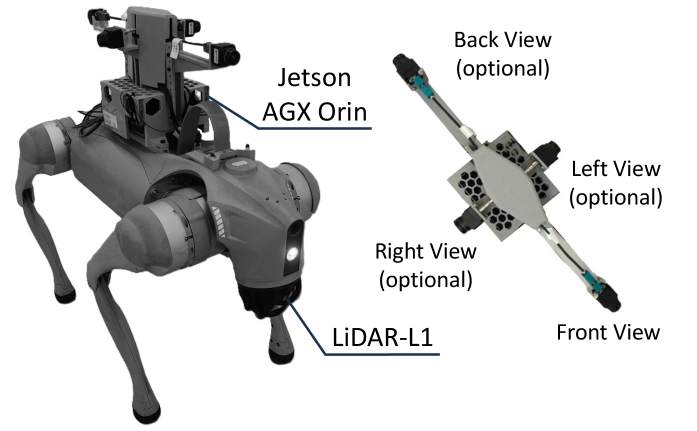

🖼️ 关键图片

📊 实验亮点

TrackVLA++在EVT-Bench DT split上取得了显著的性能提升,分别超越了之前的领先方法5.1和12。此外,该模型还展现出强大的零样本泛化能力,能够在未见过的真实世界场景中进行鲁棒的跟踪。这些实验结果表明,TrackVLA++在具身视觉跟踪领域具有重要的研究价值和应用潜力。

🎯 应用场景

TrackVLA++在伴侣机器人、引导机器人和服务助手等领域具有广泛的应用前景。它可以使机器人在复杂环境中更稳定、更准确地跟踪目标,例如在拥挤的商场中跟随顾客,或是在家庭环境中陪伴老人。该研究的成果有助于提升机器人的自主性和智能化水平,促进人机协作的发展。

📄 摘要(原文)

Embodied Visual Tracking (EVT) is a fundamental ability that underpins practical applications, such as companion robots, guidance robots and service assistants, where continuously following moving targets is essential. Recent advances have enabled language-guided tracking in complex and unstructured scenes. However, existing approaches lack explicit spatial reasoning and effective temporal memory, causing failures under severe occlusions or in the presence of similar-looking distractors. To address these challenges, we present TrackVLA++, a novel Vision-Language-Action (VLA) model that enhances embodied visual tracking with two key modules, a spatial reasoning mechanism and a Target Identification Memory (TIM). The reasoning module introduces a Chain-of-Thought paradigm, termed Polar-CoT, which infers the target's relative position and encodes it as a compact polar-coordinate token for action prediction. Guided by these spatial priors, the TIM employs a gated update strategy to preserve long-horizon target memory, ensuring spatiotemporal consistency and mitigating target loss during extended occlusions. Extensive experiments show that TrackVLA++ achieves state-of-the-art performance on public benchmarks across both egocentric and multi-camera settings. On the challenging EVT-Bench DT split, TrackVLA++ surpasses the previous leading approach by 5.1 and 12, respectively. Furthermore, TrackVLA++ exhibits strong zero-shot generalization, enabling robust real-world tracking in dynamic and occluded scenarios.