EmbodiedCoder: Parameterized Embodied Mobile Manipulation via Modern Coding Model

作者: Zefu Lin, Rongxu Cui, Chen Hanning, Xiangyu Wang, Junjia Xu, Xiaojuan Jin, Chen Wenbo, Hui Zhou, Lue Fan, Wenling Li, Zhaoxiang Zhang

分类: cs.RO

发布日期: 2025-10-07 (更新: 2025-10-15)

备注: Demo Page: https://embodiedcoder.github.io/EmbodiedCoder/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

EmbodiedCoder:利用代码模型实现参数化的具身移动操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能 移动机器人操作 代码模型 轨迹生成 开放世界 参数化操作 可解释性 机器人控制

📋 核心要点

- 现有机器人控制方法难以扩展到多样化环境,通常依赖大量标注数据且缺乏可解释性。

- EmbodiedCoder利用代码模型直接生成机器人轨迹,实现灵活的对象参数化和轨迹合成,无需额外训练。

- 真实机器人实验表明,EmbodiedCoder在复杂任务中表现稳健,并能有效泛化到新环境和物体。

📝 摘要(中文)

本文提出EmbodiedCoder,一个无需训练的开放世界移动机器人操作框架,它利用代码模型直接生成可执行的机器人轨迹。通过将高级指令置于代码中,EmbodiedCoder无需额外的数据收集或微调,即可实现灵活的对象几何参数化和操作轨迹合成。这种基于编码的范式提供了一种透明且通用的方式来连接感知和操作。在真实移动机器人上的实验表明,EmbodiedCoder在各种长期任务中实现了稳健的性能,并有效地推广到新的对象和环境中。结果展示了一种可解释的方法,用于桥接高级推理和低级控制,从而超越了固定的原语,迈向了通用的机器人智能。

🔬 方法详解

问题定义:现有机器人操作方法,如端到端视觉-语言-动作框架或具有预定义原语的模块化系统,在处理复杂和多样化的环境时面临挑战。它们通常依赖于大量的标注数据集进行训练,并且在可解释性方面存在局限性,难以适应新的物体和环境。

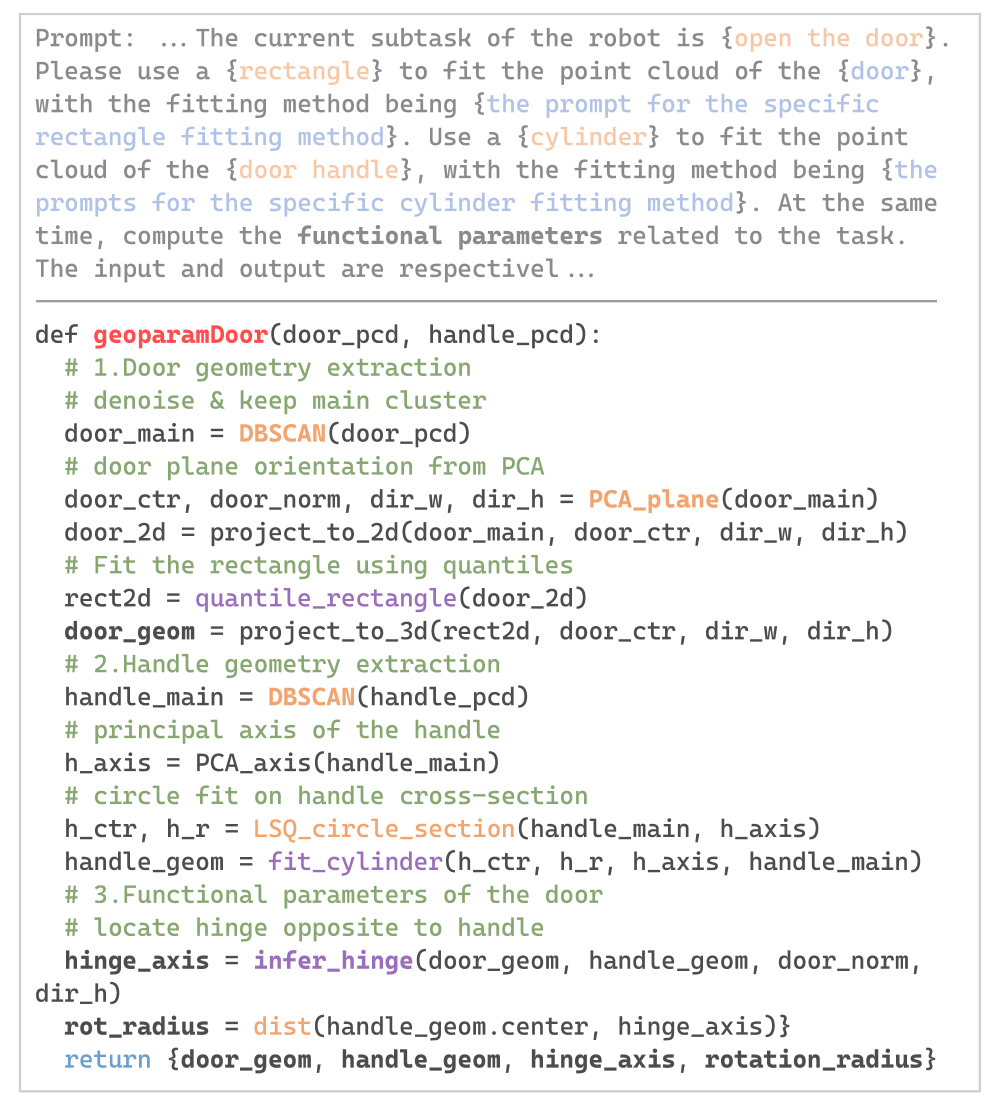

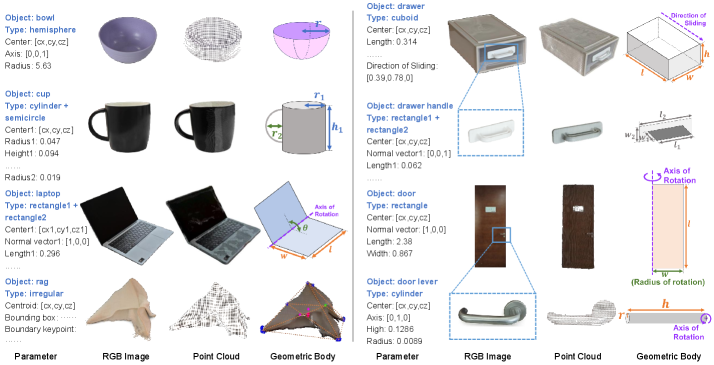

核心思路:EmbodiedCoder的核心思路是将高级指令转换为可执行的代码,利用代码模型直接生成机器人轨迹。通过将操作任务表示为代码,可以实现对物体几何形状的参数化,并灵活地合成操作轨迹,而无需进行额外的数据收集或微调。这种方法旨在提供一种更通用、可解释且易于扩展的机器人操作框架。

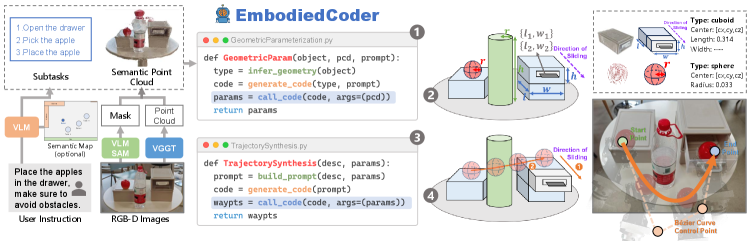

技术框架:EmbodiedCoder框架主要包含以下几个关键模块:1) 感知模块:用于从环境中获取物体的信息,例如位置、形状等;2) 代码生成模块:将高级指令转换为机器人可执行的代码,该代码描述了操作任务的步骤和参数;3) 轨迹规划模块:根据生成的代码,规划出机器人执行任务所需的轨迹;4) 控制模块:控制机器人按照规划的轨迹执行操作。整个流程无需训练,而是依赖于代码模型的推理能力。

关键创新:EmbodiedCoder最重要的创新在于其基于代码的机器人操作范式。与传统的基于学习或预定义原语的方法不同,EmbodiedCoder直接利用代码模型生成操作指令,从而实现了更高的灵活性、可解释性和泛化能力。这种方法避免了对大量标注数据的依赖,并且能够轻松地适应新的物体和环境。

关键设计:EmbodiedCoder的关键设计包括:1) 使用参数化的代码表示物体几何形状和操作任务;2) 设计了一种代码生成模型,能够将高级指令转换为可执行的机器人代码;3) 采用了一种轨迹优化算法,能够根据生成的代码规划出平滑且高效的机器人轨迹。具体的参数设置、损失函数和网络结构等技术细节在论文中进行了详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

EmbodiedCoder在真实移动机器人上进行了实验,结果表明其在各种长期任务中实现了稳健的性能,并有效地推广到新的对象和环境中。具体性能数据和对比基线在论文中进行了详细描述(未知),但总体而言,EmbodiedCoder展示了一种可解释的方法,用于桥接高级推理和低级控制,超越了固定的原语,迈向了通用的机器人智能。

🎯 应用场景

EmbodiedCoder具有广泛的应用前景,例如在家庭服务机器人、工业自动化、医疗辅助机器人等领域。它可以用于执行各种复杂的操作任务,如物体抓取、放置、组装等。该研究的实际价值在于提供了一种更通用、可解释且易于扩展的机器人操作框架,有望推动机器人技术的发展,并使其能够更好地服务于人类。

📄 摘要(原文)

Recent advances in control robot methods, from end-to-end vision-language-action frameworks to modular systems with predefined primitives, have advanced robots' ability to follow natural language instructions. Nonetheless, many approaches still struggle to scale to diverse environments, as they often rely on large annotated datasets and offer limited interpretability.In this work, we introduce EmbodiedCoder, a training-free framework for open-world mobile robot manipulation that leverages coding models to directly generate executable robot trajectories. By grounding high-level instructions in code, EmbodiedCoder enables flexible object geometry parameterization and manipulation trajectory synthesis without additional data collection or fine-tuning.This coding-based paradigm provides a transparent and generalizable way to connect perception with manipulation. Experiments on real mobile robots show that EmbodiedCoder achieves robust performance across diverse long-term tasks and generalizes effectively to novel objects and environments.Our results demonstrate an interpretable approach for bridging high-level reasoning and low-level control, moving beyond fixed primitives toward versatile robot intelligence. See the project page at: https://embodiedcoder.github.io/EmbodiedCoder/