Learning to Crawl: Latent Model-Based Reinforcement Learning for Soft Robotic Adaptive Locomotion

作者: Vaughn Gzenda, Robin Chhabra

分类: cs.RO

发布日期: 2025-10-07

💡 一句话要点

提出基于潜在模型的强化学习方法,用于软体机器人自适应运动控制。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 软体机器人 强化学习 模型预测控制 潜在变量模型 自适应运动 机器人控制 Actor-Critic算法

📋 核心要点

- 软体机器人控制策略设计面临模型不准确、传感器噪声和步态发现等挑战。

- 利用从传感器数据推断的潜在动态模型,指导强化学习算法优化软体机器人的运动策略。

- 在模拟环境中验证了该框架的有效性,证明了其在软体机器人自适应运动控制方面的潜力。

📝 摘要(中文)

本文提出了一种基于模型的强化学习(MB-RL)框架,用于软体爬行机器人的自适应运动控制。该框架利用从板载传感器推断出的潜在动态模型作为预测模型,指导Actor-Critic算法优化运动策略。在模拟环境中,我们使用惯性测量单元和飞行时间传感器作为观测,对一个最小爬行机器人模型进行了评估。学习到的潜在动态模型能够进行短时程运动预测,同时Actor-Critic算法能够发现有效的运动策略。该方法突出了潜在动态MB-RL在仅基于噪声传感器反馈实现具身软体机器人自适应运动的潜力。

🔬 方法详解

问题定义:软体爬行机器人的运动控制是一个复杂的问题,传统的控制方法难以应对软体机器人自身形变带来的模型不确定性,以及传感器噪声的影响。此外,如何自动发现有效的运动步态也是一个挑战。现有方法通常依赖精确的机器人模型或大量的手动调整,难以适应不同的环境和任务。

核心思路:本文的核心思路是利用基于模型的强化学习(MB-RL),通过学习一个潜在的动态模型来预测机器人的未来状态,并利用该模型来指导强化学习算法优化运动策略。这种方法可以在不需要精确机器人模型的情况下,实现自适应的运动控制。

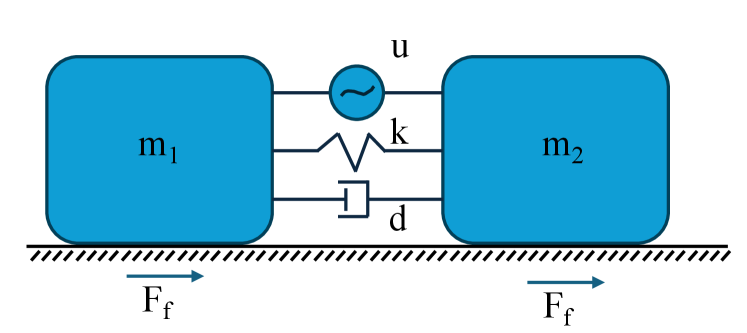

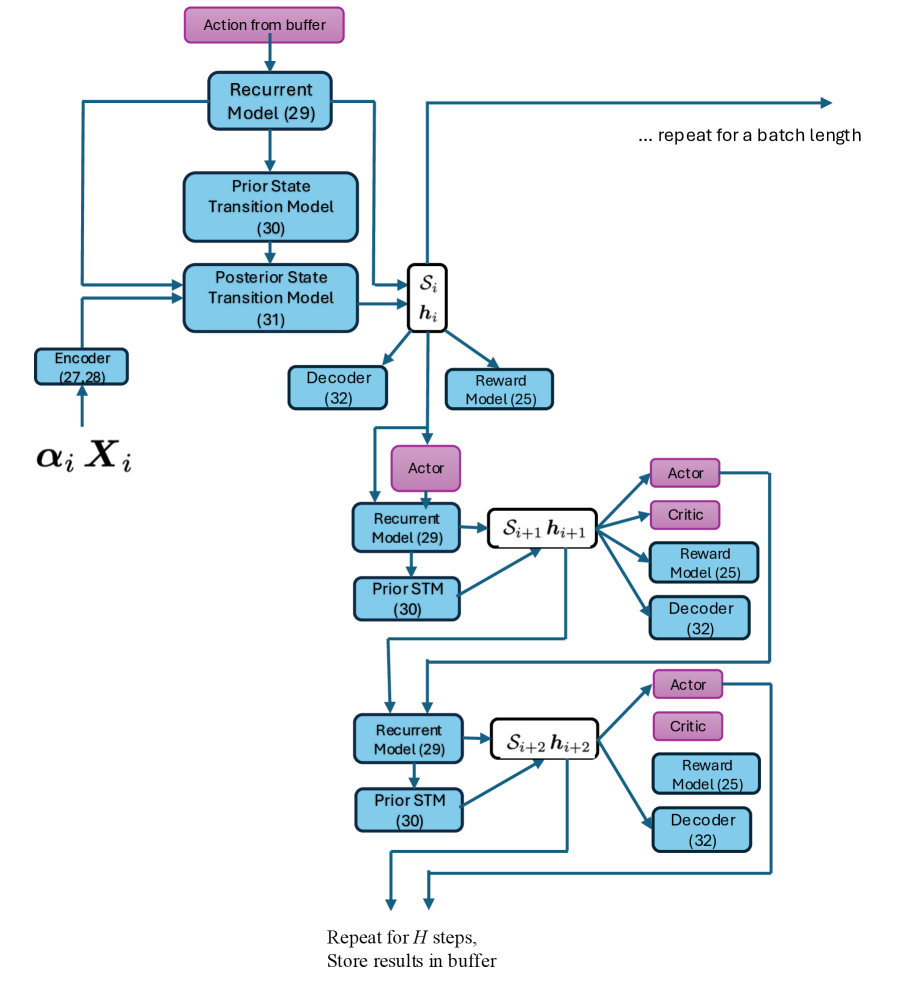

技术框架:该框架主要包含两个模块:潜在动态模型学习模块和Actor-Critic强化学习模块。首先,利用板载传感器(如IMU和ToF传感器)的数据,学习一个潜在的动态模型,该模型能够预测机器人在给定动作下的未来状态。然后,利用Actor-Critic算法,以潜在动态模型作为环境模型,优化机器人的运动策略。Actor负责输出动作,Critic负责评估动作的价值。

关键创新:该方法最重要的创新在于将潜在动态模型学习与强化学习相结合,从而可以在不需要精确机器人模型的情况下,实现软体机器人的自适应运动控制。与传统的基于模型的强化学习方法相比,该方法不需要预先知道机器人的精确模型,而是通过学习来获得一个近似的模型。

关键设计:潜在动态模型可以使用各种神经网络结构来实现,例如循环神经网络(RNN)或Transformer。Actor和Critic可以使用深度神经网络来实现,例如多层感知机(MLP)。损失函数通常包括预测误差和强化学习的奖励函数。关键参数包括学习率、折扣因子、探索率等。具体网络结构和参数设置需要根据具体的机器人和任务进行调整。

🖼️ 关键图片

📊 实验亮点

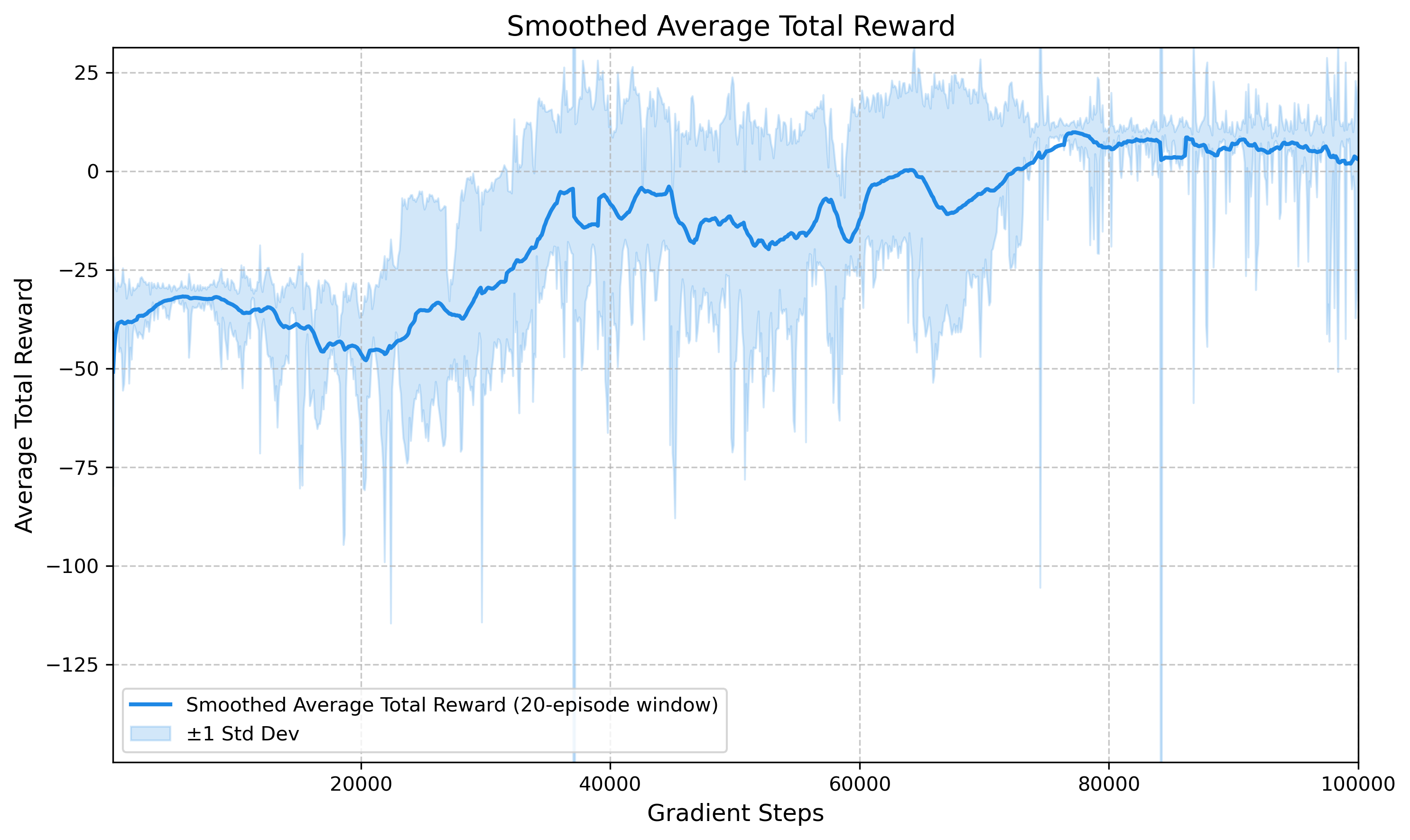

该研究在模拟环境中验证了所提出方法的有效性。实验结果表明,该方法能够学习到有效的运动策略,并实现软体机器人的自适应运动控制。与传统的控制方法相比,该方法能够更好地应对模型不确定性和传感器噪声的影响,并能够自动发现有效的运动步态。具体的性能数据和对比基线需要在论文中查找。

🎯 应用场景

该研究成果可应用于各种软体机器人的运动控制,例如搜索救援、医疗康复、工业检测等领域。软体机器人具有良好的环境适应性和安全性,能够在复杂和危险的环境中执行任务。该方法能够提高软体机器人的自主性和适应性,使其能够更好地完成各种任务,具有重要的实际应用价值和未来发展潜力。

📄 摘要(原文)

Soft robotic crawlers are mobile robots that utilize soft body deformability and compliance to achieve locomotion through surface contact. Designing control strategies for such systems is challenging due to model inaccuracies, sensor noise, and the need to discover locomotor gaits. In this work, we present a model-based reinforcement learning (MB-RL) framework in which latent dynamics inferred from onboard sensors serve as a predictive model that guides an actor-critic algorithm to optimize locomotor policies. We evaluate the framework on a minimal crawler model in simulation using inertial measurement units and time-of-flight sensors as observations. The learned latent dynamics enable short-horizon motion prediction while the actor-critic discovers effective locomotor policies. This approach highlights the potential of latent-dynamics MB-RL for enabling embodied soft robotic adaptive locomotion based solely on noisy sensor feedback.