Verifier-free Test-Time Sampling for Vision Language Action Models

作者: Suhyeok Jang, Dongyoung Kim, Changyeon Kim, Youngsuk Kim, Jinwoo Shin

分类: cs.RO, cs.AI, cs.LG

发布日期: 2025-10-07

备注: 14 pages; 3 figures

💡 一句话要点

提出MG-Select,一种免验证器的VLA测试时采样方法,提升机器人控制精度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言动作模型 机器人控制 测试时采样 免验证器 KL散度

📋 核心要点

- VLA模型在机器人控制中面临精度瓶颈,现有测试时扩展方法依赖外部验证器,泛化能力不足。

- MG-Select利用模型内部属性,通过与参考分布的KL散度选择最优动作,无需额外训练。

- 实验表明,MG-Select在真实场景和模拟环境中均显著提升了VLA模型的控制性能。

📝 摘要(中文)

视觉-语言-动作模型(VLA)在机器人控制中表现出色,但受限于单次推理模式,难以胜任高精度任务。测试时扩展方法虽有潜力,但依赖额外训练的外部验证器,泛化性差。我们提出Masking Distribution Guided Selection (MG-Select),一种无需额外训练或外部模块的VLA测试时扩展框架,利用模型内部属性。该方法使用与参考动作token分布的KL散度作为置信度指标,从多个候选动作中选择最优动作。参考分布由同一VLA生成,但输入为随机掩码的状态和语言条件,确保最大不确定性,同时与目标任务分布对齐。此外,我们提出联合训练策略,通过对状态和语言条件应用dropout,使模型学习条件和无条件分布,从而提高参考分布的质量。实验表明,MG-Select显著提升性能,在真实场景的同分布/异分布任务中分别提升28%/35%,在RoboCasa抓取放置任务中,仅用30个演示数据训练,相对提升高达168%。

🔬 方法详解

问题定义:现有视觉-语言-动作模型(VLA)在机器人控制任务中,由于采用单次推理范式,难以满足高精度要求。虽然可以通过测试时扩展方法提升性能,但这些方法通常需要额外的外部验证器进行训练,这增加了训练成本,并且验证器的泛化能力有限,难以适应未见过的环境和任务。

核心思路:MG-Select的核心思路是利用VLA模型自身的内部属性,构建一个置信度指标,用于从多个候选动作中选择最优的动作。该方法避免了使用外部验证器,从而降低了训练成本,并提高了泛化能力。核心在于构建一个与目标任务分布对齐,但具有最大不确定性的参考分布,并使用KL散度来衡量候选动作与该参考分布的差异,差异越小,则认为该动作越可靠。

技术框架:MG-Select的整体框架包括以下几个主要步骤:1) 生成多个候选动作:通过多次运行VLA模型,得到多个不同的动作输出。2) 构建参考分布:使用相同的VLA模型,但输入随机掩码的状态和语言条件,生成参考动作token分布。3) 计算KL散度:计算每个候选动作的token分布与参考分布之间的KL散度。4) 选择最优动作:选择KL散度最小的动作作为最终的输出。

关键创新:MG-Select的关键创新在于:1) 提出了一种免验证器的测试时扩展方法,避免了额外训练外部模块的需求。2) 利用随机掩码的状态和语言条件生成参考分布,确保参考分布与目标任务分布对齐,同时具有最大不确定性。3) 提出了一种联合训练策略,通过dropout增强模型学习条件和无条件分布的能力,从而提高参考分布的质量。

关键设计:在参考分布的生成过程中,状态和语言条件的掩码比例是一个重要的参数。论文中可能探讨了不同掩码比例对性能的影响。此外,联合训练策略中dropout的概率也是一个关键参数,需要根据具体任务进行调整。损失函数方面,可能使用了标准的交叉熵损失函数来训练VLA模型,并可能引入了额外的正则化项来提高模型的泛化能力。

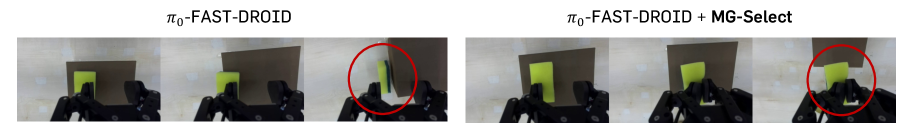

🖼️ 关键图片

📊 实验亮点

MG-Select在真实机器人任务中取得了显著的性能提升。在同分布任务中,性能提升了28%,而在更具挑战性的异分布任务中,性能提升高达35%。此外,在RoboCasa的抓取放置任务中,仅使用30个演示数据进行训练,MG-Select就实现了168%的相对性能提升,表明了其在数据稀缺场景下的优越性。

🎯 应用场景

该研究成果可广泛应用于各种需要高精度机器人控制的场景,例如:工业自动化中的精密装配、医疗手术机器人中的微创操作、以及家庭服务机器人中的复杂任务执行。通过提高VLA模型的控制精度和泛化能力,可以显著提升机器人的智能化水平和应用范围,降低人工干预的需求,并最终实现更高效、更安全的自动化生产和服务。

📄 摘要(原文)

Vision-Language-Action models (VLAs) have demonstrated remarkable performance in robot control. However, they remain fundamentally limited in tasks that require high precision due to their single-inference paradigm. While test-time scaling approaches using external verifiers have shown promise, they require additional training and fail to generalize to unseen conditions. We propose Masking Distribution Guided Selection (MG-Select), a novel test-time scaling framework for VLAs that leverages the model's internal properties without requiring additional training or external modules. Our approach utilizes KL divergence from a reference action token distribution as a confidence metric for selecting the optimal action from multiple candidates. We introduce a reference distribution generated by the same VLA but with randomly masked states and language conditions as inputs, ensuring maximum uncertainty while remaining aligned with the target task distribution. Additionally, we propose a joint training strategy that enables the model to learn both conditional and unconditional distributions by applying dropout to state and language conditions, thereby further improving the quality of the reference distribution. Our experiments demonstrate that MG-Select achieves significant performance improvements, including a 28%/35% improvement in real-world in-distribution/out-of-distribution tasks, along with a 168% relative gain on RoboCasa pick-and-place tasks trained with 30 demonstrations.