AD-NODE: Adaptive Dynamics Learning with Neural ODEs for Mobile Robots Control

作者: Shao-Yi Yu, Jen-Wei Wang, Maya Horii, Vikas Garg, Tarek Zohdi

分类: cs.RO, cs.LG, eess.SY

发布日期: 2025-10-06

💡 一句话要点

提出基于神经ODE的自适应动力学学习方法,用于移动机器人控制。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 移动机器人控制 自适应动力学模型 神经常微分方程 环境推断 模型预测控制

📋 核心要点

- 现有基于模型的控制方法在环境变化时性能下降,因为它们依赖于精确的动力学模型,而获取精确模型在复杂环境中具有挑战性。

- 该论文提出一种基于神经常微分方程(Neural ODEs)的自适应动力学模型,通过学习潜在环境表示,使机器人能够适应环境变化。

- 实验结果表明,该方法在模拟和真实世界的机器人平台上,均能有效应对时空变化的环境,提升了goal-reaching和path-tracking任务的性能。

📝 摘要(中文)

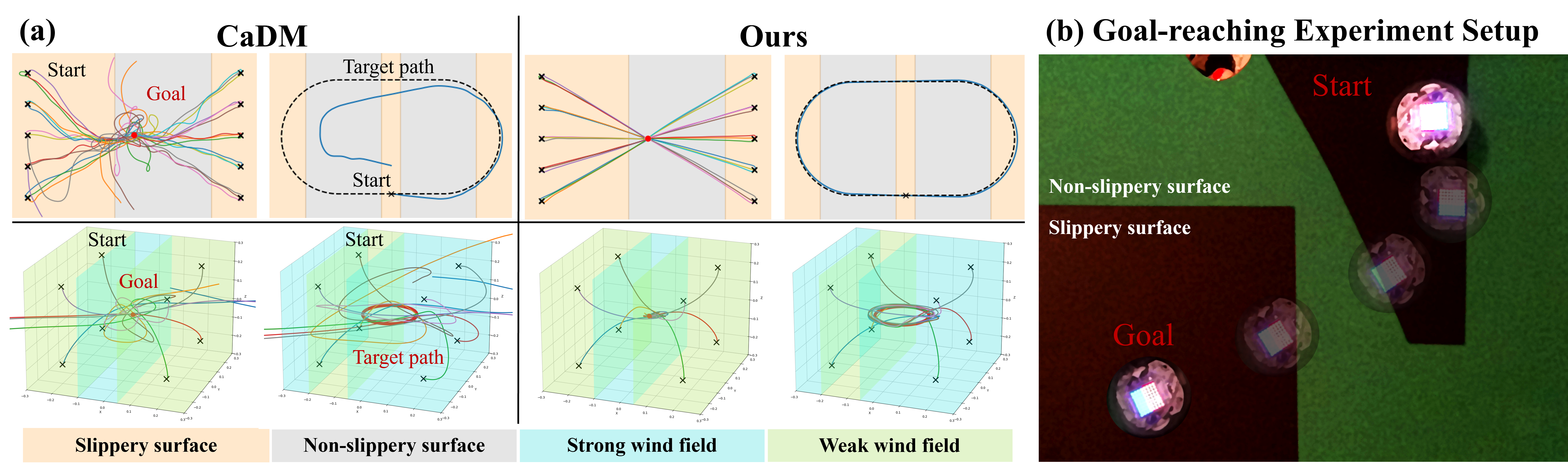

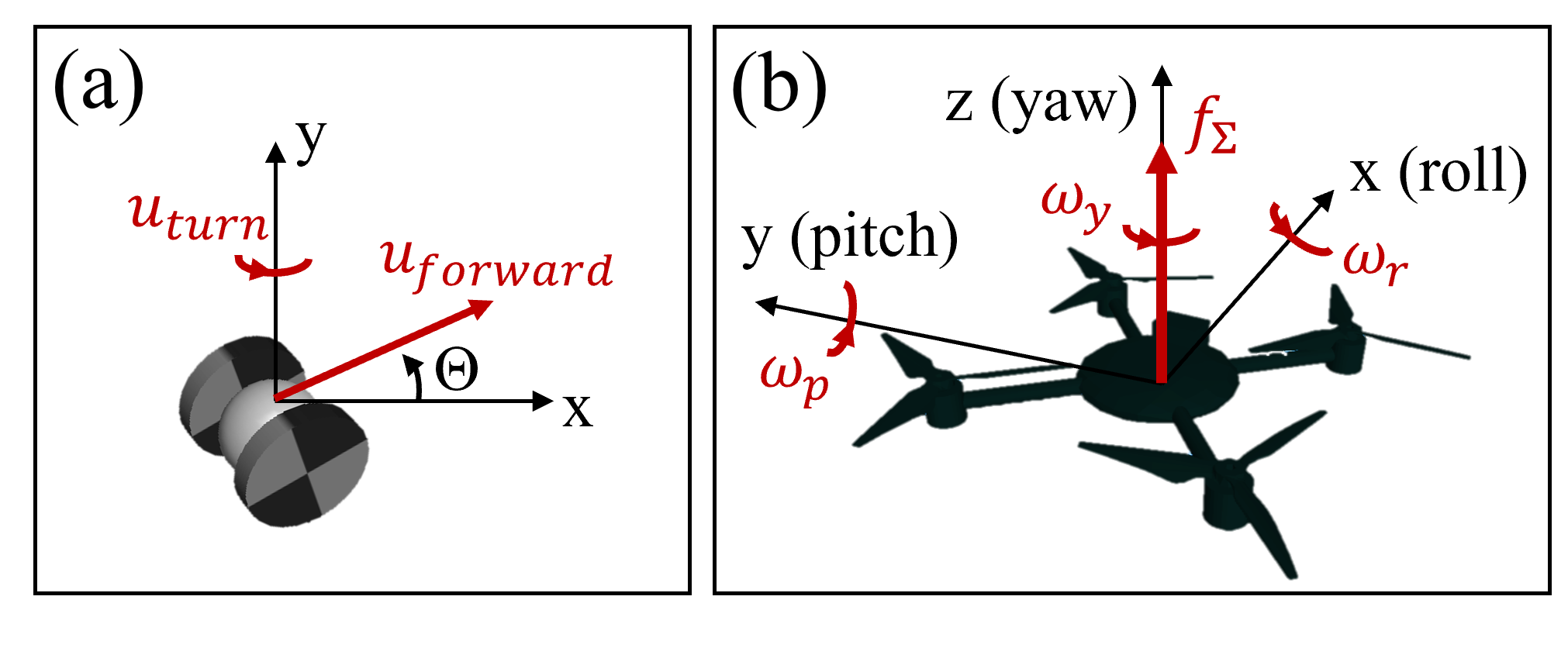

本文提出了一种自适应动力学模型,用于移动机器人在不确定环境中有效执行任务,例如地面车辆和四旋翼飞行器。该模型通过从状态-动作历史中推断操作环境,无需直接的环境信息。该动力学模型基于神经常微分方程(Neural ODEs),并采用两阶段训练过程来学习潜在的环境表示。通过在三种复杂度递增的机器人平台上进行的goal-reaching和path-tracking任务,验证了该方法的有效性:包括具有变化车轮接触条件的2D差分轮式机器人、变异风场中的3D四旋翼飞行器,以及在两种接触条件下进行真实世界部署的Sphero BOLT机器人。实验结果表明,该方法能够处理模拟和真实世界系统中时空变化的动态环境。

🔬 方法详解

问题定义:移动机器人在复杂和不确定的环境中运行时,需要能够适应环境变化的动力学模型。传统的基于模型的控制方法依赖于精确的动力学模型,但在实际应用中,环境信息往往难以获取或随时间变化,导致模型性能下降。因此,如何使机器人能够根据自身的经验学习并适应环境变化是一个关键问题。

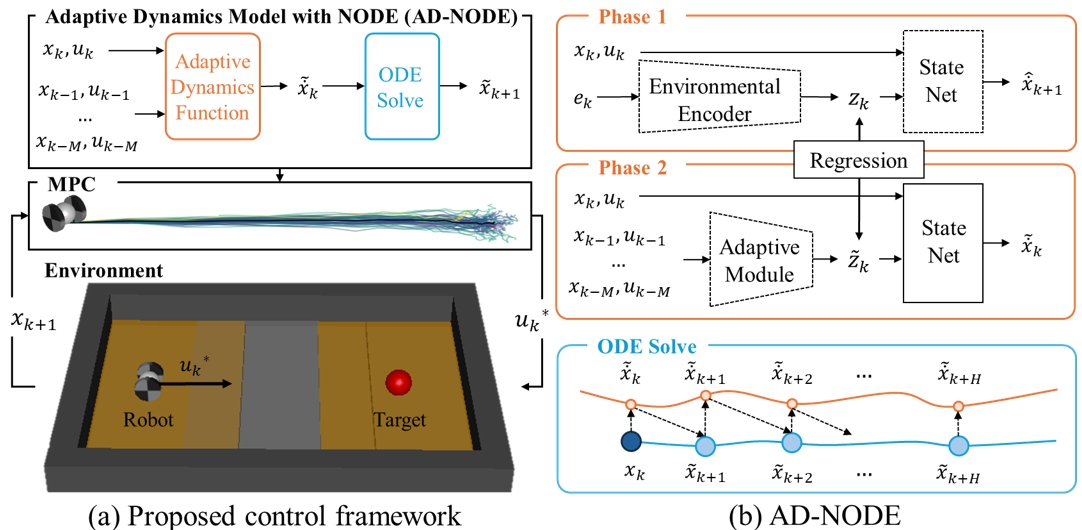

核心思路:该论文的核心思路是通过学习一个能够推断潜在环境表示的自适应动力学模型,使机器人能够根据状态-动作历史来适应环境变化。该模型基于神经常微分方程(Neural ODEs),能够学习连续时间的动力学表示,并能够根据环境变化动态调整模型参数。

技术框架:该方法包含两个主要阶段:环境推断和动力学预测。首先,使用一个循环神经网络(RNN)从状态-动作历史中推断潜在的环境表示。然后,将该环境表示作为神经常微分方程(Neural ODEs)的输入,用于预测机器人的未来状态。整个框架通过端到端的方式进行训练,以最小化预测状态与真实状态之间的差异。

关键创新:该方法最重要的创新点在于其自适应性,即能够根据状态-动作历史动态地调整动力学模型,从而适应环境变化。与传统的基于模型的控制方法相比,该方法无需直接的环境信息,而是通过学习潜在的环境表示来实现自适应控制。此外,使用神经常微分方程(Neural ODEs)能够学习连续时间的动力学表示,从而更好地捕捉环境变化的影响。

关键设计:该方法使用一个两阶段的训练过程。第一阶段,使用自编码器学习状态-动作历史的潜在表示。第二阶段,使用神经常微分方程(Neural ODEs)学习动力学模型,并将第一阶段学习到的潜在表示作为输入。损失函数包括预测状态与真实状态之间的均方误差,以及正则化项,以防止过拟合。网络结构包括一个循环神经网络(RNN)用于环境推断,以及一个多层感知机(MLP)用于神经常微分方程(Neural ODEs)的参数化。

🖼️ 关键图片

📊 实验亮点

该方法在三种机器人平台上进行了实验验证,包括2D差分轮式机器人、3D四旋翼飞行器和Sphero BOLT机器人。实验结果表明,该方法能够有效应对时空变化的环境,并在goal-reaching和path-tracking任务中取得了显著的性能提升。例如,在Sphero BOLT机器人的真实世界实验中,该方法能够成功适应两种不同的接触条件,并实现了稳定的轨迹跟踪。

🎯 应用场景

该研究成果可广泛应用于需要在复杂和不确定环境中运行的移动机器人,例如物流、农业、搜索救援等领域。通过使机器人能够适应环境变化,可以提高其在这些领域的自主性和效率,降低对人工干预的依赖。此外,该方法还可以应用于其他需要动态建模和控制的系统,例如自动驾驶汽车和无人机。

📄 摘要(原文)

Mobile robots, such as ground vehicles and quadrotors, are becoming increasingly important in various fields, from logistics to agriculture, where they automate processes in environments that are difficult to access for humans. However, to perform effectively in uncertain environments using model-based controllers, these systems require dynamics models capable of responding to environmental variations, especially when direct access to environmental information is limited. To enable such adaptivity and facilitate integration with model predictive control, we propose an adaptive dynamics model which bypasses the need for direct environmental knowledge by inferring operational environments from state-action history. The dynamics model is based on neural ordinary equations, and a two-phase training procedure is used to learn latent environment representations. We demonstrate the effectiveness of our approach through goal-reaching and path-tracking tasks on three robotic platforms of increasing complexity: a 2D differential wheeled robot with changing wheel contact conditions, a 3D quadrotor in variational wind fields, and the Sphero BOLT robot under two contact conditions for real-world deployment. Empirical results corroborate that our method can handle temporally and spatially varying environmental changes in both simulation and real-world systems.