ContextVLA: Vision-Language-Action Model with Amortized Multi-Frame Context

作者: Huiwon Jang, Sihyun Yu, Heeseung Kwon, Hojin Jeon, Younggyo Seo, Jinwoo Shin

分类: cs.RO, cs.AI

发布日期: 2025-10-05

备注: Project page: https://huiwon-jang.github.io/contextvla

💡 一句话要点

ContextVLA:通过分摊多帧上下文的视觉-语言-动作模型,提升机器人任务性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人 视觉-语言-动作模型 时间上下文 多帧观测 行为克隆

📋 核心要点

- 在部分可观测的机器人任务中,利用时间上下文至关重要,但现有基于行为克隆的方法在使用多帧观测时性能提升不稳定。

- ContextVLA的核心思想是将多帧观测压缩成单个上下文token,从而高效地利用时间上下文,同时降低计算复杂度。

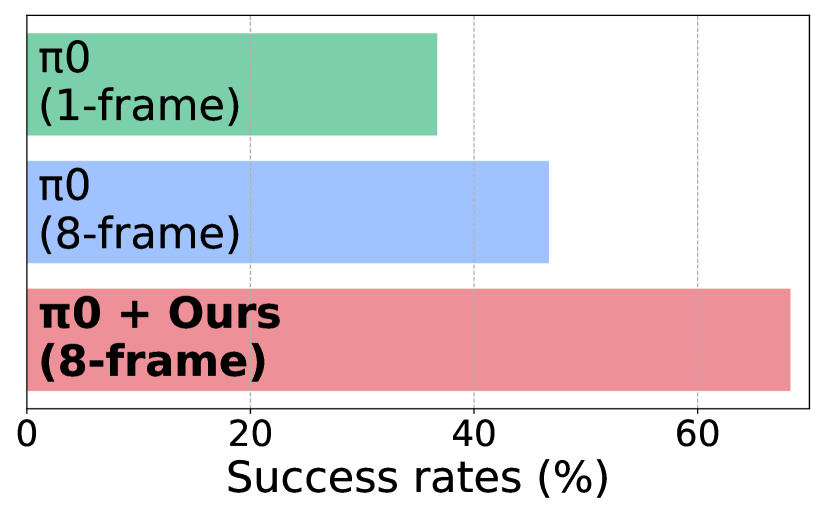

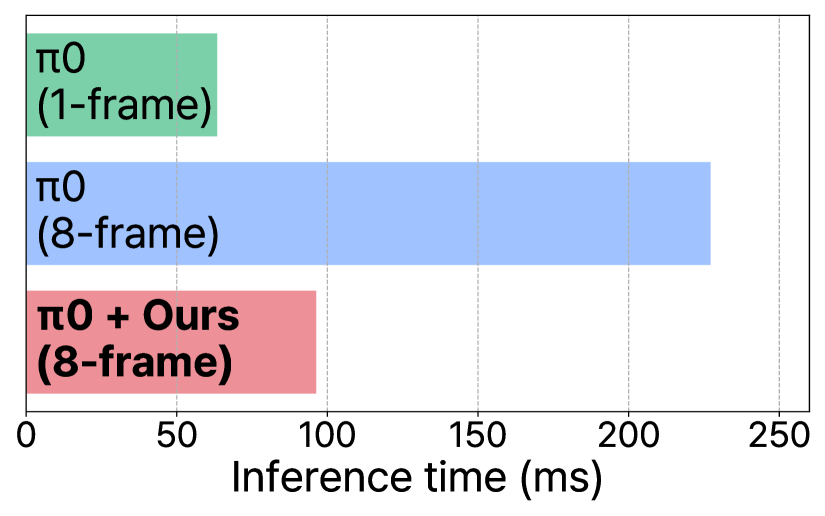

- 实验结果表明,ContextVLA在训练和推理时间减少的同时,性能始终优于单帧VLA,并能达到完整多帧训练的性能水平。

📝 摘要(中文)

本文提出ContextVLA,一种通过有效利用多帧观测来稳健提升机器人任务性能的策略模型。该方法基于关键观察:构建于视觉-语言模型(VLM)之上的视觉-语言-动作模型(VLA)能更有效地利用多帧观测进行动作生成。这表明VLM固有的时间理解能力使其能够从多帧观测中提取更有意义的上下文。然而,视频输入的高维度带来了显著的计算开销,使得VLA的训练和推理效率低下。为了解决这个问题,ContextVLA将过去的观测压缩成一个单一的上下文token,允许策略有效地利用时间上下文进行动作生成。实验表明,ContextVLA始终优于单帧VLA,并实现了完整多帧训练的优势,同时减少了训练和推理时间。

🔬 方法详解

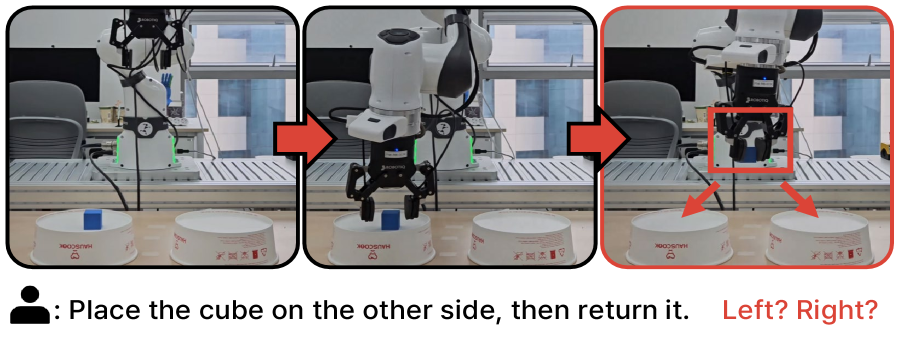

问题定义:论文旨在解决在部分可观测机器人任务中,如何有效利用多帧观测以提升策略模型性能的问题。现有方法,特别是基于行为克隆的方法,在使用多帧观测时性能提升并不稳定,且直接使用多帧视频作为输入会带来巨大的计算开销。

核心思路:论文的核心思路是利用视觉-语言模型(VLM)的固有时间理解能力,将多帧观测压缩成一个单一的上下文token。这样既能保留时间上下文信息,又能显著降低计算复杂度,从而提高训练和推理效率。

技术框架:ContextVLA模型首先使用视觉编码器处理多帧图像,然后利用一个上下文压缩模块将这些帧的信息压缩成一个上下文token。这个上下文token与语言指令一起输入到VLM中,VLM输出动作指令。整体流程包括视觉特征提取、上下文压缩和动作生成三个主要阶段。

关键创新:ContextVLA的关键创新在于使用分摊(amortized)的方式学习多帧上下文的压缩表示。通过将多帧信息压缩成单个token,模型能够在利用时间信息的同时,避免了直接处理高维视频数据带来的计算瓶颈。这种方法允许模型在训练和推理时更高效地利用时间上下文。

关键设计:ContextVLA的具体实现细节包括:使用预训练的视觉编码器提取图像特征;设计一个基于Transformer的上下文压缩模块,学习将多帧特征压缩成单个token;使用预训练的VLM作为策略模型的主干网络。损失函数可能包括行为克隆损失,用于模仿专家动作,以及可能的辅助损失,用于提高上下文token的质量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ContextVLA在多个机器人任务上均优于单帧VLA模型,并且在训练和推理时间上显著减少。ContextVLA能够达到与完整多帧训练相似的性能水平,但计算成本更低。这些结果验证了ContextVLA在利用时间上下文方面的有效性和效率。

🎯 应用场景

ContextVLA模型可应用于各种需要时间上下文信息的机器人任务,例如家庭服务机器人、自动驾驶、工业自动化等。该模型能够帮助机器人在部分可观测的环境中更好地理解任务指令,并做出更准确的动作决策,从而提高机器人的自主性和适应性。未来,该研究可以扩展到更复杂的机器人任务和更广泛的应用场景。

📄 摘要(原文)

Leveraging temporal context is crucial for success in partially observable robotic tasks. However, prior work in behavior cloning has demonstrated inconsistent performance gains when using multi-frame observations. In this paper, we introduce ContextVLA, a policy model that robustly improves robotic task performance by effectively leveraging multi-frame observations. Our approach is motivated by the key observation that Vision-Language-Action models (VLA), i.e., policy models built upon a Vision-Language Model (VLM), more effectively utilize multi-frame observations for action generation. This suggests that VLMs' inherent temporal understanding capability enables them to extract more meaningful context from multi-frame observations. However, the high dimensionality of video inputs introduces significant computational overhead, making VLA training and inference inefficient. To address this, ContextVLA compresses past observations into a single context token, allowing the policy to efficiently leverage temporal context for action generation. Our experiments show that ContextVLA consistently improves over single-frame VLAs and achieves the benefits of full multi-frame training but with reduced training and inference times.