NoTVLA: Narrowing of Dense Action Trajectories for Generalizable Robot Manipulation

作者: Zheng Huang, Mingyu Liu, Xiaoyi Lin, Muzhi Zhu, Canyu Zhao, Zongze Du, Xiaoman Li, Yiduo Jia, Hao Zhong, Hao Chen, Chunhua Shen

分类: cs.RO, cs.CV

发布日期: 2025-10-04

💡 一句话要点

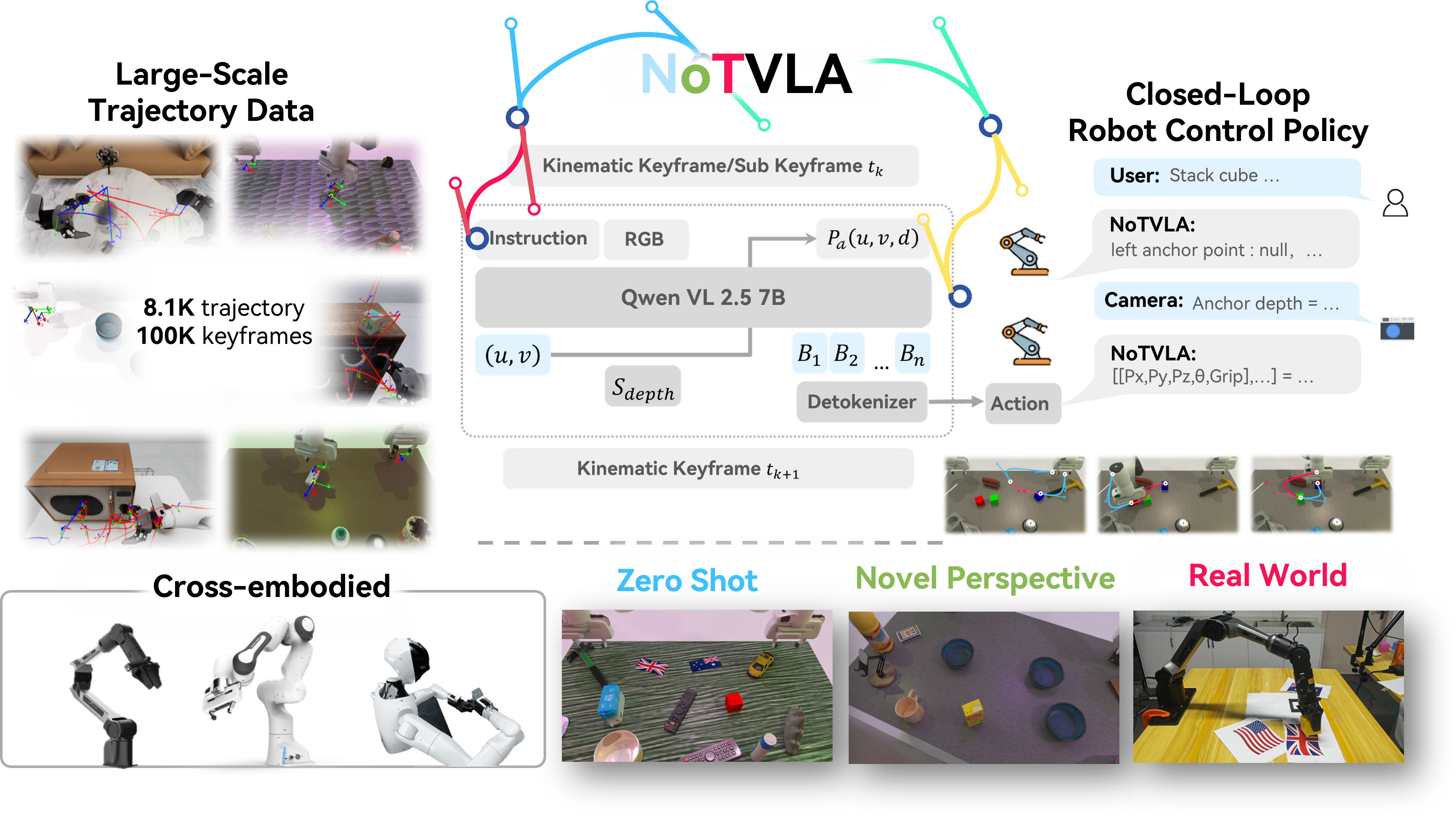

提出NoTVLA框架,通过稀疏轨迹学习解决VLA模型中的灾难性遗忘问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言动作模型 机器人操作 灾难性遗忘 稀疏轨迹学习 多任务学习

📋 核心要点

- VLA模型依赖连续动作序列,导致数据孤岛,引发灾难性遗忘,阻碍了跨任务知识迁移。

- NoTVLA框架聚焦稀疏轨迹,利用时间压缩和空间推理剪枝,优化机器人末端执行器的轨迹规划。

- NoTVLA在多任务评估中表现出优越的性能和泛化能力,计算资源需求更低,且无需腕式摄像头。

📝 摘要(中文)

视觉-语言-动作(VLA)模型是具身智能的关键进展,但面临实际部署的重大障碍,尤其是灾难性遗忘。这个问题源于过度依赖连续动作序列或动作块,这无意中创建了孤立的数据孤岛,破坏了跨任务的知识保留。为了解决这些挑战,我们提出了轨迹窄化VLA(NoTVLA)框架:一种新颖的方法,它将其重点缩小到稀疏轨迹,从而避免了与密集轨迹微调相关的灾难性遗忘。NoTVLA的一个关键创新在于其轨迹规划策略:它不是以目标对象的轨迹为中心,而是专门利用时间压缩和空间推理剪枝来处理机器人末端执行器的轨迹。此外,训练是使用这些稀疏轨迹而不是密集动作轨迹进行的,这种优化提供了显著的实际优势,并在零样本中实现了更好的性能。在多任务评估场景中,NoTVLA与pi0相比,实现了卓越的性能和泛化,同时在两个关键约束下运行:它使用的计算能力比pi0少一个数量级以上,并且不需要腕式摄像头。这种设计确保了NoTVLA的运行精度与单任务专家模型非常接近。至关重要的是,它还保留了模型固有的语言能力,从而在特定场景中实现零样本泛化,支持跨多个机器人平台的统一模型部署,并在从新的角度感知任务时培养一定程度的泛化。

🔬 方法详解

问题定义:VLA模型在多任务学习中面临灾难性遗忘问题,即在学习新任务时,会忘记之前学习的任务。现有方法依赖于密集的动作轨迹,导致模型过度拟合特定任务的数据,形成孤立的数据孤岛,阻碍了知识的泛化和迁移。

核心思路:NoTVLA的核心思路是通过聚焦于稀疏的轨迹来避免灾难性遗忘。具体来说,它不是学习目标对象的完整轨迹,而是专注于机器人末端执行器的关键动作点,并利用时间压缩和空间推理剪枝来减少需要学习的动作序列,从而降低模型对特定任务的依赖性,提高泛化能力。

技术框架:NoTVLA框架主要包含以下几个阶段:1) 轨迹规划:利用时间压缩和空间推理剪枝,生成机器人末端执行器的稀疏轨迹。2) 数据收集:收集稀疏轨迹数据,用于训练VLA模型。3) 模型训练:使用稀疏轨迹数据训练VLA模型,优化模型参数。4) 模型评估:在多任务场景下评估模型的性能和泛化能力。

关键创新:NoTVLA的关键创新在于其轨迹规划策略,它不是以目标对象的轨迹为中心,而是专门针对机器人末端执行器的轨迹进行优化。通过时间压缩和空间推理剪枝,可以显著减少需要学习的动作序列,从而降低模型对特定任务的依赖性,提高泛化能力。此外,使用稀疏轨迹进行训练,可以减少计算资源的需求,并提高模型的训练效率。

关键设计:NoTVLA的关键设计包括:1) 时间压缩:通过对连续动作序列进行采样,选择关键的动作点,减少需要学习的动作数量。2) 空间推理剪枝:利用空间推理,排除不必要的动作,进一步减少需要学习的动作数量。3) 损失函数:使用交叉熵损失函数来优化模型的动作预测能力。4) 网络结构:采用Transformer结构来建模视觉、语言和动作之间的关系。

🖼️ 关键图片

📊 实验亮点

NoTVLA在多任务评估中取得了显著的性能提升,与基线模型pi0相比,在性能和泛化能力上均有提升,同时计算资源需求降低了一个数量级以上,并且无需腕式摄像头。实验结果表明,NoTVLA能够有效解决VLA模型中的灾难性遗忘问题,并提高机器人在复杂环境中的适应性和泛化能力。

🎯 应用场景

NoTVLA框架可应用于各种机器人操作任务,例如物体抓取、装配、导航等。它能够提高机器人在复杂环境中的适应性和泛化能力,降低对大量训练数据的需求,并支持跨多个机器人平台的统一模型部署。该研究对于推动机器人技术在工业自动化、家庭服务、医疗保健等领域的应用具有重要意义。

📄 摘要(原文)

Vision-Language-Action (VLA) models represent a pivotal advance in embodied intelligence, yet they confront critical barriers to real-world deployment, most notably catastrophic forgetting. This issue stems from their overreliance on continuous action sequences or action chunks, which inadvertently create isolated data silos that disrupt knowledge retention across tasks. To tackle these challenges, we propose the Narrowing of Trajectory VLA (NoTVLA) framework: a novel approach that narrows its focus to sparse trajectories, thereby avoiding the catastrophic forgetting associated with dense trajectory fine-tuning. A key innovation of NoTVLA lies in its trajectory planning strategy: instead of centering on the target object's trajectory, it leverages temporal compression and spatial reasoning pruning specifically for the robot end effector's trajectory. Furthermore, training is conducted using these sparse trajectories rather than dense action trajectories, an optimization that delivers remarkable practical advantages with better performance in zero-shot. In multi-task evaluation scenarios, NoTVLA achieves superior performance and generalization compared to pi0 while operating under two critical constraints: it uses over an order of magnitude less computing power than pi0 and requires no wrist-mounted camera. This design ensures that NoTVLA's operational accuracy closely approximates that of single-task expert models. Crucially, it also preserves the model's inherent language capabilities, enabling zero-shot generalization in specific scenarios, supporting unified model deployment across multiple robot platforms, and fostering a degree of generalization even when perceiving tasks from novel perspectives.