3D-CovDiffusion: 3D-Aware Diffusion Policy for Coverage Path Planning

作者: Chenyuan Chen, Haoran Ding, Ran Ding, Tianyu Liu, Zewen He, Anqing Duan, Dezhen Song, Xiaodan Liang, Yoshihiko Nakamura

分类: cs.RO

发布日期: 2025-10-03

💡 一句话要点

提出3D-CovDiffusion,用于生成高覆盖率的工业表面处理轨迹

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 扩散模型 轨迹生成 覆盖路径规划 机器人喷涂 工业表面处理

📋 核心要点

- 传统轨迹生成方法受限于预定义的函数形式,难以处理复杂任务,泛化性差,需要大量人工调整。

- 3D-CovDiffusion利用扩散模型迭代去噪生成轨迹,通过学习噪声调度和条件机制,保证轨迹平滑并适应任务环境。

- 实验表明,该方法在轨迹连续性、表面覆盖率和泛化性方面均优于现有方法,无需针对特定类别进行模型设计。

📝 摘要(中文)

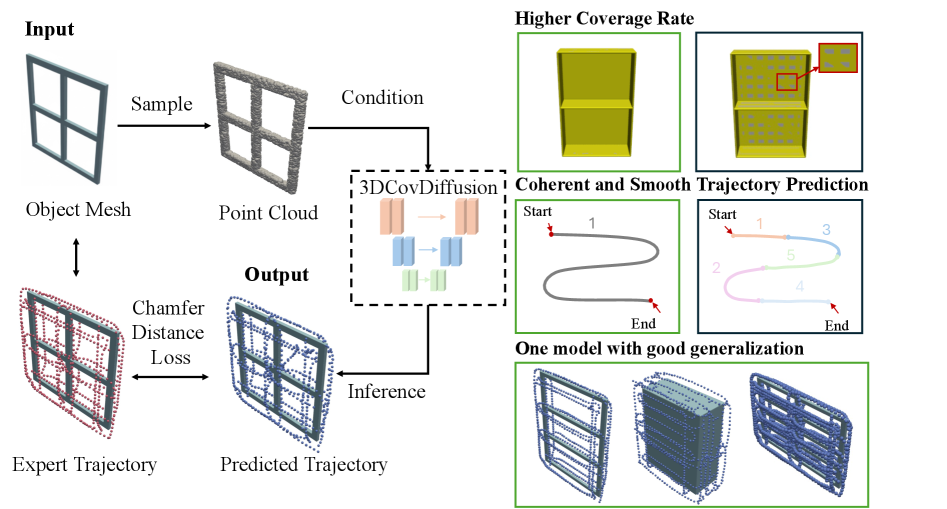

本文提出了一种端到端的框架,即3D-CovDiffusion,用于生成长而平滑的轨迹,明确针对各种工业任务(包括抛光、机器人喷漆和喷涂)中的高表面覆盖率。传统方法受到预定义函数形式的根本限制,难以表示复杂多样的轨迹形状,泛化能力差,需要手动重新设计或进行大量参数调整才能应用于新场景。扩散模型通过精心学习的噪声调度和条件机制迭代地对轨迹进行去噪,不仅确保了平滑和一致的运动,而且灵活地适应任务环境。实验结果表明,该方法提高了轨迹的连续性,保持了较高的覆盖率,并能推广到未见过的形状,为跨工业表面处理任务的统一端到端轨迹学习铺平了道路,无需针对特定类别的模型。与现有方法相比,该方法在逐点Chamfer距离上平均提高了98.2%,平滑度提高了97.0%,同时表面覆盖率提高了61%。

🔬 方法详解

问题定义:论文旨在解决工业表面处理任务中,传统轨迹生成方法难以生成高覆盖率、平滑且泛化性强的轨迹的问题。现有方法通常依赖于预定义的函数形式,这限制了它们表示复杂轨迹的能力,并且在面对新的形状或任务时需要大量的手动调整。

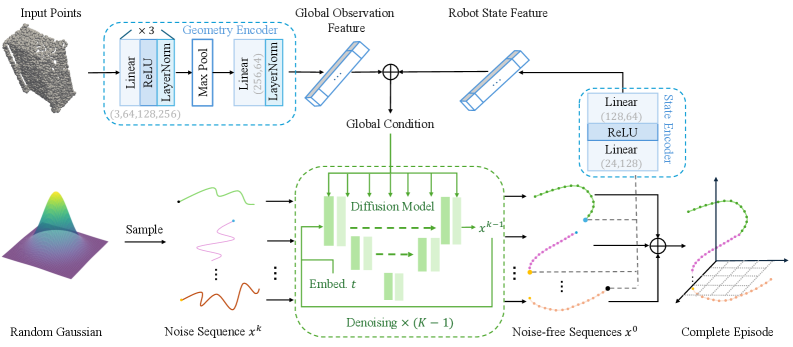

核心思路:论文的核心思路是利用扩散模型强大的生成能力,通过迭代地对轨迹进行去噪,从而生成高质量的轨迹。扩散模型能够学习到数据分布的潜在结构,并且可以通过条件机制来控制生成轨迹的形状和属性,从而实现高覆盖率和良好的泛化性。

技术框架:该方法采用端到端的框架,主要包含以下几个阶段:1)轨迹初始化:使用随机噪声初始化轨迹。2)扩散过程:逐步向轨迹中添加噪声,直到轨迹完全变成噪声。3)逆扩散过程:通过扩散模型逐步去除噪声,并根据任务条件(例如,目标表面的形状)来调整轨迹,最终生成满足要求的轨迹。4)后处理:对生成的轨迹进行平滑处理,以提高轨迹的质量。

关键创新:该方法最重要的技术创新点在于将扩散模型应用于轨迹生成任务,并设计了合适的条件机制,使得生成的轨迹能够满足高覆盖率和良好的泛化性要求。与现有方法相比,该方法不需要预定义轨迹的函数形式,因此能够生成更复杂和多样的轨迹。

关键设计:该方法的关键设计包括:1)噪声调度:设计合适的噪声调度策略,以保证扩散过程的稳定性和逆扩散过程的效率。2)条件机制:使用目标表面的形状作为条件,指导扩散模型生成覆盖目标表面的轨迹。3)损失函数:设计合适的损失函数,例如Chamfer距离和曲率损失,以保证生成的轨迹具有高覆盖率和良好的平滑性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与现有方法相比,该方法在逐点Chamfer距离上平均提高了98.2%,平滑度提高了97.0%,同时表面覆盖率提高了61%。这些数据表明,该方法在轨迹质量和表面覆盖率方面均取得了显著的提升,并且具有良好的泛化能力,能够应用于未见过的形状。

🎯 应用场景

该研究成果可广泛应用于各种工业表面处理任务,例如抛光、机器人喷漆、喷涂等。通过生成高质量的轨迹,可以提高生产效率和产品质量,降低人工成本。此外,该方法还可以应用于其他需要轨迹生成的领域,例如机器人焊接、3D打印等,具有重要的实际应用价值和广阔的应用前景。

📄 摘要(原文)

Diffusion models, as a class of deep generative models, have recently emerged as powerful tools for robot skills by enabling stable training with reliable convergence. In this paper, we present an end-to-end framework for generating long, smooth trajectories that explicitly target high surface coverage across various industrial tasks, including polishing, robotic painting, and spray coating. The conventional methods are always fundamentally constrained by their predefined functional forms, which limit the shapes of the trajectories they can represent and make it difficult to handle complex and diverse tasks. Moreover, their generalization is poor, often requiring manual redesign or extensive parameter tuning when applied to new scenarios. These limitations highlight the need for more expressive generative models, making diffusion-based approaches a compelling choice for trajectory generation. By iteratively denoising trajectories with carefully learned noise schedules and conditioning mechanisms, diffusion models not only ensure smooth and consistent motion but also flexibly adapt to the task context. In experiments, our method improves trajectory continuity, maintains high coverage, and generalizes to unseen shapes, paving the way for unified end-to-end trajectory learning across industrial surface-processing tasks without category-specific models. On average, our approach improves Point-wise Chamfer Distance by 98.2\% and smoothness by 97.0\%, while increasing surface coverage by 61\% compared to prior methods. The link to our code can be found \href{https://anonymous.4open.science/r/spraydiffusion_ral-2FCE/README.md}{here}.