Flow with the Force Field: Learning 3D Compliant Flow Matching Policies from Force and Demonstration-Guided Simulation Data

作者: Tianyu Li, Yihan Li, Zizhe Zhang, Nadia Figueroa

分类: cs.RO, cs.LG

发布日期: 2025-10-03 (更新: 2025-10-22)

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出力场引导的柔顺流匹配策略,解决接触密集型任务中的力控问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人操作 柔顺控制 力反馈 视觉运动策略 模仿学习 流匹配 Sim2Real

📋 核心要点

- 现有视觉运动策略在接触密集型任务中表现不佳,主要原因是忽略了柔顺性和力信息,导致与环境交互时出现问题。

- 该论文提出了一种力场引导的柔顺流匹配策略,通过在模拟环境中生成包含力信息的训练数据,提升策略的泛化能力。

- 实验结果表明,该方法在真实机器人任务中表现出良好的接触维护和适应性,验证了其有效性。

📝 摘要(中文)

近年来,视觉运动策略取得了显著进展,但接触密集型任务仍然面临挑战。需要连续接触的机器人操作任务需要显式地处理柔顺性和力。然而,大多数视觉运动策略忽略了柔顺性,忽视了与现实世界的物理交互的重要性,这通常导致过大的接触力或在不确定性下的脆弱行为。将力信息引入基于视觉的模仿学习可能有助于提高对接触的感知,但也可能需要大量数据才能表现良好。解决数据稀缺问题的一种方法是在模拟中生成数据,但需要计算量大的过程来生成足够好的数据,以避免Sim2Real差距。在这项工作中,我们介绍了一个在模拟中生成力信息数据的框架,该框架由单个人类演示实例化,并展示了与柔顺策略的耦合如何提高从合成数据中学习的视觉运动策略的性能。我们在真实机器人任务上验证了我们的方法,包括非抓取块翻转和双手物体移动,其中学习到的策略表现出可靠的接触维护和对新条件的适应性。

🔬 方法详解

问题定义:现有视觉运动策略在处理接触密集型任务时,往往忽略了力反馈和柔顺性控制,导致机器人与环境交互时产生过大的力,或者在不确定性下表现脆弱。Sim2Real的差距也使得在模拟环境中训练的策略难以直接应用于真实机器人。

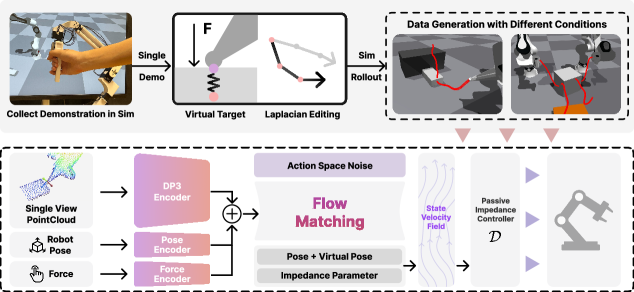

核心思路:该论文的核心思路是利用力场引导的模拟数据来训练一个柔顺的视觉运动策略。通过引入力信息,策略能够更好地感知和响应环境的接触力,从而实现更稳定和可靠的操作。同时,利用流匹配方法学习策略,可以提高策略的泛化能力。

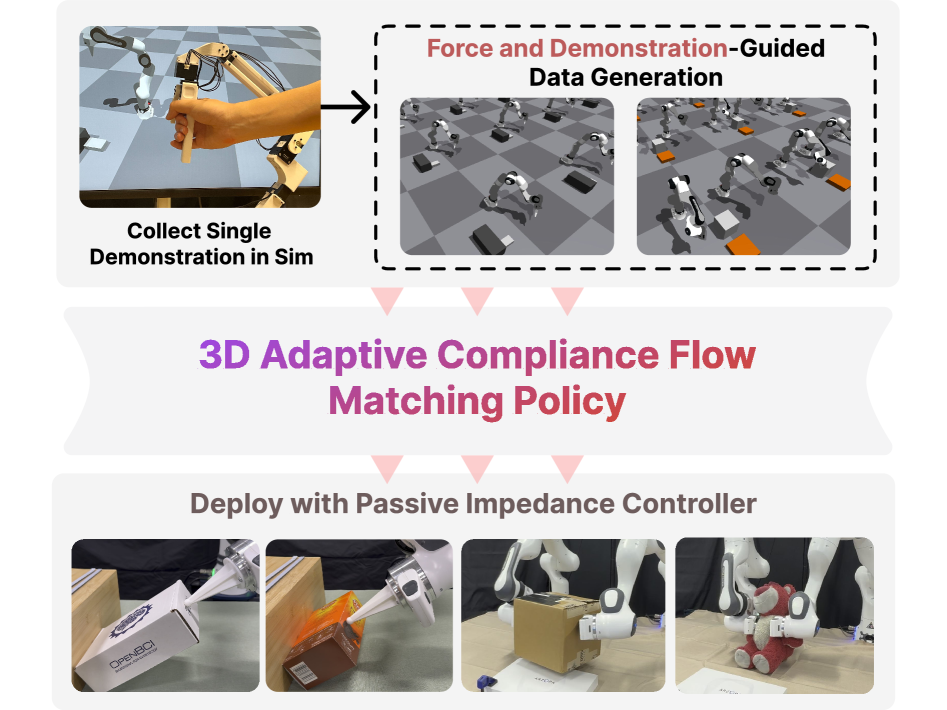

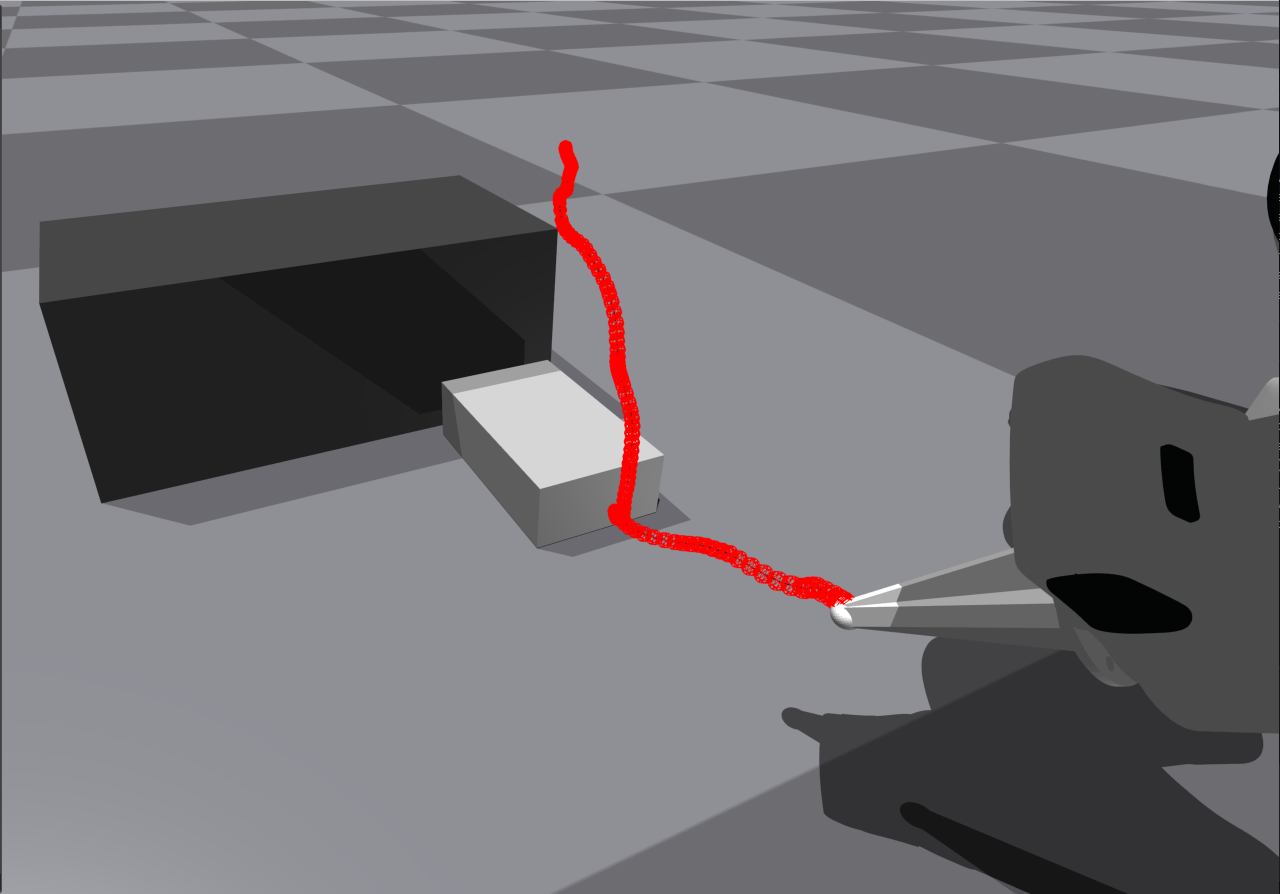

技术框架:该框架主要包含以下几个阶段:1) 通过单个人类演示来初始化模拟环境;2) 利用力场引导的模拟生成包含力信息的训练数据;3) 使用流匹配方法训练一个柔顺的视觉运动策略;4) 将训练好的策略部署到真实机器人上进行验证。其中,力场用于引导模拟中的物体运动,使其更接近真实情况,从而减小Sim2Real差距。

关键创新:该论文的关键创新在于:1) 提出了一种力场引导的模拟数据生成方法,可以有效地生成包含力信息的训练数据;2) 将流匹配方法应用于柔顺视觉运动策略的学习,提高了策略的泛化能力和鲁棒性;3) 验证了在真实机器人任务中,该方法能够实现可靠的接触维护和对新条件的适应性。

关键设计:在力场引导的模拟中,力场的设计需要根据具体的任务进行调整,以保证模拟数据的质量。流匹配方法采用了一种基于神经网络的参数化向量场,通过最小化向量场与真实轨迹之间的差异来学习策略。损失函数包括轨迹损失、力损失和柔顺性损失,以保证策略的准确性和柔顺性。

🖼️ 关键图片

📊 实验亮点

该论文在非抓取块翻转和双手物体移动等真实机器人任务上验证了所提出方法的有效性。实验结果表明,该方法能够实现可靠的接触维护和对新条件的适应性,相比于传统的视觉运动策略,在接触力控制和操作稳定性方面有显著提升。具体性能数据和对比基线在论文中有详细描述。

🎯 应用场景

该研究成果可应用于各种需要精确力控制的机器人操作任务,例如装配、打磨、抛光、医疗手术等。通过学习柔顺的视觉运动策略,机器人可以更好地适应环境变化,提高操作的稳定性和安全性,降低对环境的破坏。

📄 摘要(原文)

While visuomotor policy has made advancements in recent years, contact-rich tasks still remain a challenge. Robotic manipulation tasks that require continuous contact demand explicit handling of compliance and force. However, most visuomotor policies ignore compliance, overlooking the importance of physical interaction with the real world, often leading to excessive contact forces or fragile behavior under uncertainty. Introducing force information into vision-based imitation learning could help improve awareness of contacts, but could also require a lot of data to perform well. One remedy for data scarcity is to generate data in simulation, yet computationally taxing processes are required to generate data good enough not to suffer from the Sim2Real gap. In this work, we introduce a framework for generating force-informed data in simulation, instantiated by a single human demonstration, and show how coupling with a compliant policy improves the performance of a visuomotor policy learned from synthetic data. We validate our approach on real-robot tasks, including non-prehensile block flipping and a bi-manual object moving, where the learned policy exhibits reliable contact maintenance and adaptation to novel conditions. Project Website: https://flow-with-the-force-field.github.io/webpage/