A $1000\times$ Faster LLM-enhanced Algorithm For Path Planning in Large-scale Grid Maps

作者: Junlin Zeng, Xin Zhang, Xiang Zhao, Yan Pan

分类: cs.RO, cs.AI

发布日期: 2025-10-03 (更新: 2025-12-01)

💡 一句话要点

提出iLLM-A*算法,加速大规模栅格地图路径规划超1000倍

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 路径规划 大规模栅格地图 大型语言模型 A*算法 增量学习

📋 核心要点

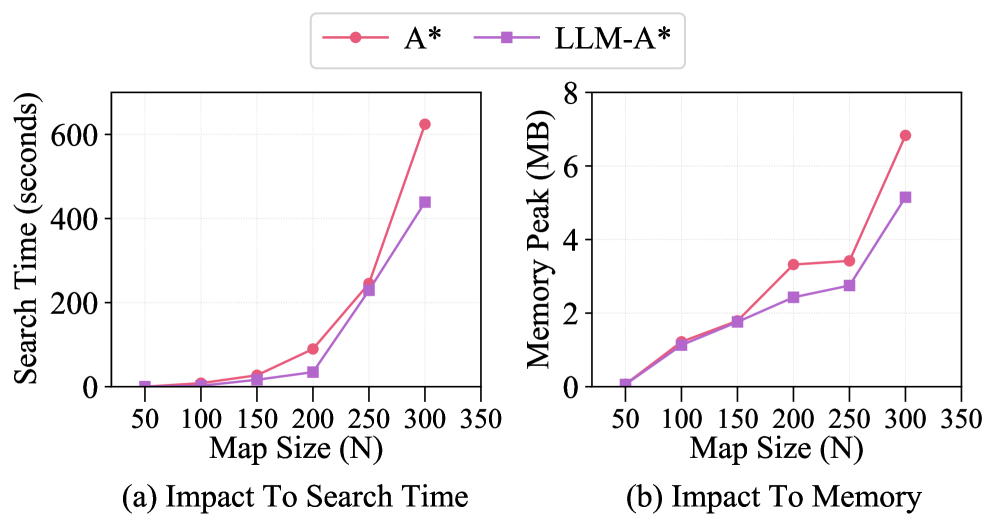

- 现有A*等路径规划算法在大规模栅格地图中面临搜索时间和内存消耗瓶颈。

- iLLM-A通过优化A算法、增量学习LLM和航路点选择机制,提升规划效率。

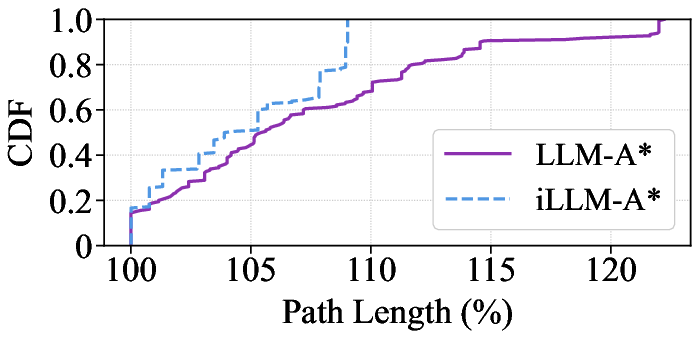

- 实验表明,iLLM-A相比LLM-A,速度提升超1000倍,内存节省达58.6%,路径更优。

📝 摘要(中文)

本文针对大规模栅格地图中的路径规划问题,现有方法如A算法及其变体在高搜索时间和内存消耗方面存在局限性。虽然大型语言模型(LLM)在路径规划中表现出潜力,但仍存在空间幻觉和规划性能不佳的问题。LLM-A算法利用LLM生成一系列航路点,然后使用A算法规划相邻航路点之间的路径,但计算时间仍然很高。为了解决这个问题,我们深入研究了LLM-A算法的瓶颈,并设计了一种创新的LLM增强算法iLLM-A。iLLM-A包括三个精心设计的机制:A算法的优化、用于生成高质量航路点的LLM增量学习方法,以及为A算法选择合适的航路点。综合评估表明,与LLM-A相比,iLLM-A平均加速超过1000倍,最高加速可达2349.5倍,节省高达58.6%的内存成本,并实现了更短的路径长度和更低的路径长度标准差。

🔬 方法详解

问题定义:论文旨在解决大规模栅格地图中路径规划效率低下的问题。现有方法,如A算法及其变体,在大规模地图中搜索时间和内存消耗过高。LLM-A虽然利用LLM生成航路点来辅助规划,但仍然存在计算时间长的痛点。

核心思路:论文的核心思路是优化LLM-A算法,通过改进A算法本身、提升LLM生成航路点的质量以及优化航路点的选择,从而显著降低计算时间和内存消耗。这样设计的目的是充分利用LLM的全局规划能力,同时避免其空间幻觉问题,并减少A*算法的搜索空间。

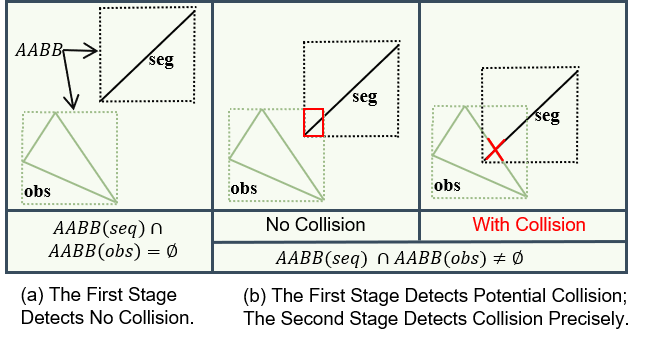

技术框架:iLLM-A算法主要包含三个阶段:1) A算法优化:对A算法进行改进,提高其在局部路径规划中的效率。2) LLM增量学习:利用增量学习方法训练LLM,使其能够生成更高质量的航路点,减少无效搜索。3) 航路点选择:设计一种策略,选择最合适的航路点供A算法使用,进一步缩小搜索范围。

关键创新:iLLM-A的关键创新在于三个机制的协同作用。增量学习的LLM能够生成更准确的航路点,优化的A算法能够更快地在航路点之间找到路径,而航路点选择机制则保证了A算法只在必要的区域进行搜索。与LLM-A相比,iLLM-A不是简单地将LLM作为航路点生成器,而是将其与A算法深度融合,形成一个高效的整体。

关键设计:论文中可能涉及的关键设计包括:LLM增量学习的具体训练方法(例如,使用哪些数据进行训练,如何设计损失函数),航路点选择策略(例如,基于距离、方向、障碍物等因素的评分函数),以及A算法的具体优化方法(例如,使用更高效的启发式函数,或者采用并行搜索策略)。这些细节决定了iLLM-A算法的最终性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,iLLM-A算法在各种栅格地图上实现了显著的性能提升。与LLM-A相比,iLLM-A平均加速超过1000倍,最高加速可达2349.5倍。同时,iLLM-A还节省了高达58.6%的内存成本,并获得了更短的路径长度和更低的路径长度标准差,表明其规划结果更加稳定可靠。

🎯 应用场景

该研究成果可广泛应用于机器人导航、游戏AI、自动驾驶、物流规划等领域。通过显著提升大规模地图的路径规划效率,可以降低计算成本,提高系统响应速度,并为更复杂的任务规划提供支持。未来,该方法有望扩展到三维空间或动态环境,进一步提升其应用价值。

📄 摘要(原文)

Path planning in grid maps, arising from various applications, has garnered significant attention. Existing methods, such as A, Dijkstra, and their variants, work well for small-scale maps but fail to address large-scale ones due to high search time and memory consumption. Recently, Large Language Models (LLMs) have shown remarkable performance in path planning but still suffer from spatial illusion and poor planning performance. Among all the works, LLM-A \cite{meng2024llm} leverages LLM to generate a series of waypoints and then uses A to plan the paths between the neighboring waypoints. In this way, the complete path is constructed. However, LLM-A still suffers from high computational time for large-scale maps. To fill this gap, we conducted a deep investigation into LLM-A and found its bottleneck, resulting in limited performance. Accordingly, we design an innovative LLM-enhanced algorithm, abbr. as iLLM-A. iLLM-A includes 3 carefully designed mechanisms, including the optimization of A, an incremental learning method for LLM to generate high-quality waypoints, and the selection of the appropriate waypoints for A for path planning. Finally, a comprehensive evaluation on various grid maps shows that, compared with LLM-A, iLLM-A* \textbf{1) achieves more than $1000\times$ speedup on average, and up to $2349.5\times$ speedup in the extreme case, 2) saves up to $58.6\%$ of the memory cost, 3) achieves both obviously shorter path length and lower path length standard deviation.}