LangGrasp: Leveraging Fine-Tuned LLMs for Language Interactive Robot Grasping with Ambiguous Instructions

作者: Yunhan Lin, Wenqi Wu, Zhijie Zhang, Huasong Min

分类: cs.RO

发布日期: 2025-10-02

备注: 8 pages, 6 figures

🔗 代码/项目: GITHUB

💡 一句话要点

LangGrasp:利用微调LLM实现语言交互式机器人抓取,解决指令歧义问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人抓取 语言交互 大型语言模型 隐式意图 点云定位

📋 核心要点

- 现有语言驱动的机器人抓取方法难以处理包含隐式意图的歧义指令,限制了其应用。

- LangGrasp框架通过微调LLM,利用其常识理解和环境感知能力,推断指令中的隐式意图。

- 实验结果表明,LangGrasp能准确解决歧义指令,并实现从对象级到零件级的高精度抓取。

📝 摘要(中文)

现有的语言驱动抓取方法难以充分处理包含隐式意图的歧义指令。为了解决这一挑战,我们提出了LangGrasp,一种新颖的语言交互式机器人抓取框架。该框架集成了微调的大型语言模型(LLM),以利用其强大的常识理解和环境感知能力,从而从语言指令中推断出隐式意图,并明确任务需求以及目标操作对象。此外,我们设计的点云定位模块,在2D部分分割的指导下,实现了场景中的局部点云定位,从而将抓取操作从粗粒度的对象级别扩展到细粒度的部分级别操作。实验结果表明,LangGrasp框架能够准确地解决歧义指令中的隐式意图,识别未明确说明但对完成任务至关重要的关键操作和目标信息。此外,它通过整合环境信息动态地选择最佳抓取姿势。这使得从对象级别到部分级别的高精度抓取成为可能,显著提高了机器人在非结构化环境中的适应性和任务执行效率。

🔬 方法详解

问题定义:现有语言驱动的机器人抓取方法在处理带有隐式意图的模糊指令时存在困难。这些方法通常依赖于明确的指令,无法理解指令中未明确表达的常识性知识和操作意图,导致抓取失败或效率低下。

核心思路:LangGrasp的核心思路是利用大型语言模型(LLM)强大的常识推理和环境感知能力,从模糊的语言指令中推断出用户的真实意图。通过对LLM进行微调,使其能够理解指令中的隐含信息,并结合视觉信息,确定需要抓取的对象及其最佳抓取位置。

技术框架:LangGrasp框架主要包含以下几个模块:1) 指令理解模块:使用微调的LLM解析语言指令,提取关键信息,并推断隐含意图。2) 环境感知模块:利用视觉传感器获取环境信息,例如场景的点云数据和图像。3) 点云定位模块:在2D部分分割的指导下,实现场景中的局部点云定位,从而将抓取操作从粗粒度的对象级别扩展到细粒度的部分级别操作。4) 抓取姿态生成模块:根据指令理解和环境感知的结果,生成合适的抓取姿态。5) 抓取执行模块:控制机器人执行抓取动作。

关键创新:LangGrasp的关键创新在于将微调的LLM应用于机器人抓取任务,使其能够理解和处理模糊的语言指令。此外,该框架还引入了基于2D部分分割的点云定位模块,实现了从对象级别到零件级别的精细化抓取。

关键设计:LangGrasp框架的关键设计包括:1) LLM的微调策略,包括使用特定的数据集和损失函数,以提高其在机器人抓取任务中的性能。2) 点云定位模块的实现细节,例如2D部分分割算法的选择和点云配准算法的设计。3) 抓取姿态生成模块的优化目标,例如考虑抓取的稳定性、可达性和避免碰撞等因素。

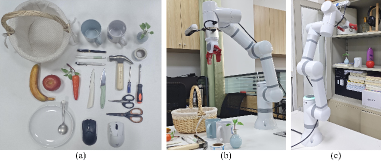

🖼️ 关键图片

📊 实验亮点

实验结果表明,LangGrasp框架能够准确地解决歧义指令中的隐式意图,识别未明确说明但对完成任务至关重要的关键操作和目标信息。此外,它通过整合环境信息动态地选择最佳抓取姿势,实现了从对象级别到部分级别的高精度抓取,显著提高了机器人在非结构化环境中的适应性和任务执行效率。具体性能数据和对比基线信息未知。

🎯 应用场景

LangGrasp具有广泛的应用前景,例如在智能家居中,机器人可以根据用户的口头指令完成各种抓取任务,如递送物品、整理房间等。在工业自动化领域,机器人可以根据操作人员的指令抓取和组装零件,提高生产效率。此外,该技术还可以应用于医疗康复、灾难救援等领域,帮助人们完成各种复杂的任务。

📄 摘要(原文)

The existing language-driven grasping methods struggle to fully handle ambiguous instructions containing implicit intents. To tackle this challenge, we propose LangGrasp, a novel language-interactive robotic grasping framework. The framework integrates fine-tuned large language models (LLMs) to leverage their robust commonsense understanding and environmental perception capabilities, thereby deducing implicit intents from linguistic instructions and clarifying task requirements along with target manipulation objects. Furthermore, our designed point cloud localization module, guided by 2D part segmentation, enables partial point cloud localization in scenes, thereby extending grasping operations from coarse-grained object-level to fine-grained part-level manipulation. Experimental results show that the LangGrasp framework accurately resolves implicit intents in ambiguous instructions, identifying critical operations and target information that are unstated yet essential for task completion. Additionally, it dynamically selects optimal grasping poses by integrating environmental information. This enables high-precision grasping from object-level to part-level manipulation, significantly enhancing the adaptability and task execution efficiency of robots in unstructured environments. More information and code are available here: https://github.com/wu467/LangGrasp.