ActiveUMI: Robotic Manipulation with Active Perception from Robot-Free Human Demonstrations

作者: Qiyuan Zeng, Chengmeng Li, Jude St. John, Zhongyi Zhou, Junjie Wen, Guorui Feng, Yichen Zhu, Yi Xu

分类: cs.RO, cs.CV

发布日期: 2025-10-02

备注: technique report. The website is available at https://activeumi.github.io

💡 一句话要点

ActiveUMI:通过机器人自由的人类演示进行主动感知的机器人操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 机器人操作 主动感知 VR遥操作 模仿学习 双手动操作

📋 核心要点

- 现有机器人操作学习方法难以有效利用真实世界人类演示数据,限制了机器人泛化能力。

- ActiveUMI通过VR遥操作和头部运动捕捉,使机器人学习人类操作中的主动感知策略。

- 实验表明,基于ActiveUMI数据训练的机器人策略在复杂双手动任务中表现出良好的成功率和泛化能力。

📝 摘要(中文)

ActiveUMI是一个数据收集系统框架,旨在将真实场景中的人类演示迁移到能够执行复杂双手动操作的机器人上。ActiveUMI将便携式VR遥操作套件与传感器控制器相结合,通过精确的姿态对齐连接人-机器人运动学。为了确保移动性和数据质量,引入了沉浸式3D模型渲染、独立的穿戴式计算机和高效的校准方法等关键技术。ActiveUMI的核心在于捕捉主动的、以自我为中心的感知。通过记录操作员通过头戴式显示器进行的头部运动,系统学习视觉注意力和操作之间的关键联系。在六项具有挑战性的双手动任务上评估了ActiveUMI。仅使用ActiveUMI数据训练的策略在同分布任务上实现了平均70%的成功率,并表现出强大的泛化能力,在新对象和新环境中测试时仍保持56%的成功率。结果表明,便携式数据收集系统与学习的主动感知相结合,为创建可泛化且高性能的真实世界机器人策略提供了一条有效且可扩展的途径。

🔬 方法详解

问题定义:现有机器人操作学习方法通常依赖于大量的机器人自身数据,或者难以有效地利用人类演示数据。人类演示数据往往包含丰富的主动感知信息,例如操作者会根据任务需求调整视角和关注点,而传统方法难以捕捉和利用这些信息。因此,如何从人类演示中学习到有效的主动感知策略,并将其迁移到机器人上,是一个重要的挑战。

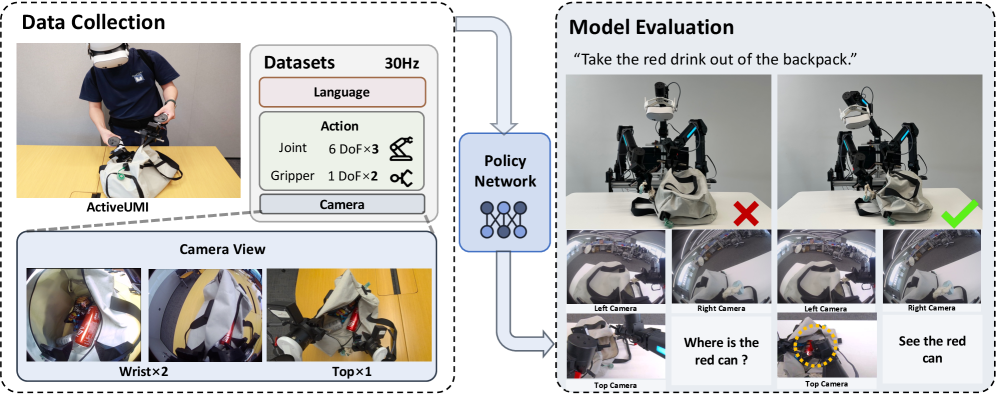

核心思路:ActiveUMI的核心思路是通过VR遥操作系统,将人类操作者的动作和视角信息同步记录下来,并将其作为机器人的训练数据。通过捕捉操作者的头部运动,系统可以学习到视觉注意力和操作之间的关系,从而使机器人能够像人类一样,根据任务需求主动调整视角和关注点。

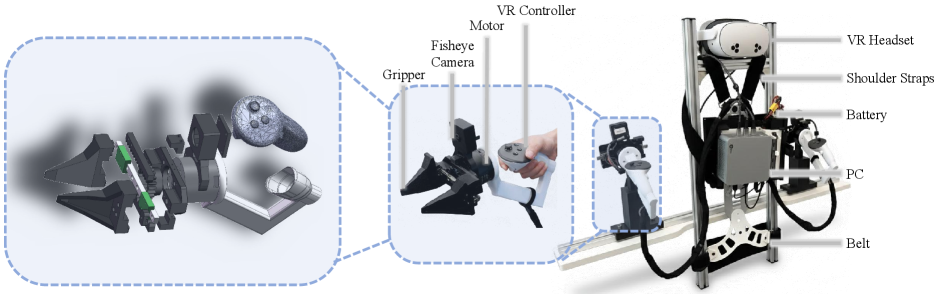

技术框架:ActiveUMI系统主要包含以下几个模块:1) VR遥操作套件:用于捕捉人类操作者的动作和视角信息。2) 传感器控制器:用于精确地控制机器人的末端执行器。3) 穿戴式计算机:用于处理和记录数据。4) 数据处理模块:用于对数据进行校准和处理,生成可用于机器人训练的数据集。整个流程是,人类操作者佩戴VR设备和传感器控制器进行操作演示,系统记录操作者的动作和视角信息,然后将这些数据用于训练机器人的控制策略。

关键创新:ActiveUMI最重要的技术创新点在于其捕捉主动感知的能力。通过记录操作者的头部运动,系统可以学习到视觉注意力和操作之间的关系。这使得机器人能够像人类一样,根据任务需求主动调整视角和关注点,从而提高操作的成功率和泛化能力。与现有方法相比,ActiveUMI能够更有效地利用人类演示数据,学习到更鲁棒和泛化的机器人控制策略。

关键设计:ActiveUMI在数据采集方面,设计了便携式VR遥操作套件,方便在不同场景下进行数据采集。在数据处理方面,采用了高效的校准方法,确保数据的准确性。在机器人控制策略训练方面,可以使用各种强化学习算法,例如PPO、SAC等。具体的参数设置和网络结构需要根据具体的任务进行调整。

🖼️ 关键图片

📊 实验亮点

ActiveUMI在六项具有挑战性的双手动任务上进行了评估,结果表明,仅使用ActiveUMI数据训练的策略在同分布任务上实现了平均70%的成功率。更重要的是,该策略表现出强大的泛化能力,在新对象和新环境中测试时仍保持56%的成功率。这些结果表明,ActiveUMI能够有效地从人类演示中学习到通用的机器人控制策略。

🎯 应用场景

ActiveUMI技术可应用于各种需要复杂双手动操作的机器人任务,例如:家庭服务机器人、工业装配机器人、医疗手术机器人等。通过学习人类的操作经验,机器人可以更好地适应不同的环境和任务,提高操作的效率和安全性。该技术还可以用于远程操作,使人类操作者能够在安全的环境下控制远端的机器人,执行危险或复杂的任务。

📄 摘要(原文)

We present ActiveUMI, a framework for a data collection system that transfers in-the-wild human demonstrations to robots capable of complex bimanual manipulation. ActiveUMI couples a portable VR teleoperation kit with sensorized controllers that mirror the robot's end-effectors, bridging human-robot kinematics via precise pose alignment. To ensure mobility and data quality, we introduce several key techniques, including immersive 3D model rendering, a self-contained wearable computer, and efficient calibration methods. ActiveUMI's defining feature is its capture of active, egocentric perception. By recording an operator's deliberate head movements via a head-mounted display, our system learns the crucial link between visual attention and manipulation. We evaluate ActiveUMI on six challenging bimanual tasks. Policies trained exclusively on ActiveUMI data achieve an average success rate of 70\% on in-distribution tasks and demonstrate strong generalization, retaining a 56\% success rate when tested on novel objects and in new environments. Our results demonstrate that portable data collection systems, when coupled with learned active perception, provide an effective and scalable pathway toward creating generalizable and highly capable real-world robot policies.