Real-time Multi-Plane Segmentation Based on GPU Accelerated High-Resolution 3D Voxel Mapping for Legged Robot Locomotion

作者: Shun Niijima, Ryoichi Tsuzaki, Noriaki Takasugi, Masaya Kinoshita

分类: cs.RO

发布日期: 2025-10-02

备注: 8 pages, 12 figures, This work has been submitted to the IEEE for possible publication. Copyright may be transfered without notice, after which this version may no longer be accessible

💡 一句话要点

提出一种基于GPU加速高分辨率3D体素地图的实时多平面分割方法,用于腿式机器人运动。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 多平面分割 腿式机器人 三维体素地图 GPU加速 实时性

📋 核心要点

- 现有在线平面地图构建方法难以兼顾精度和计算效率,限制了腿式机器人的运动性能。

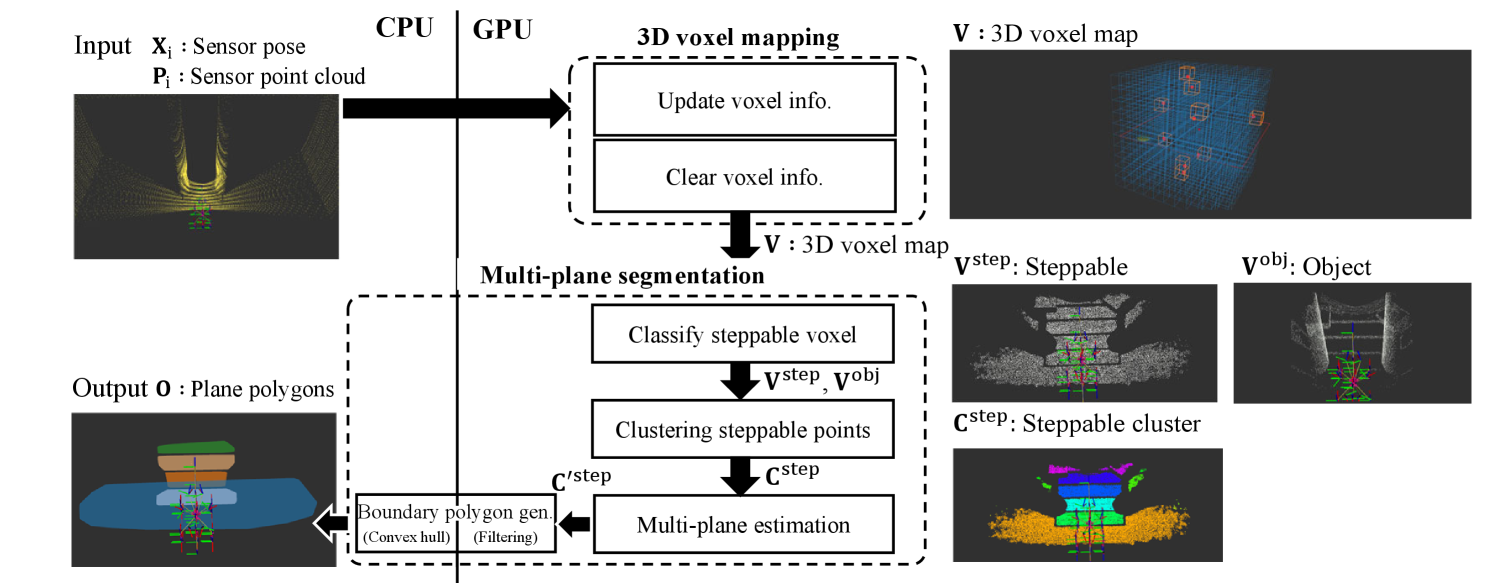

- 该方法结合顶点连通分量标记、RANSAC平面检测和凸包算法,利用GPU加速从高分辨率体素地图中提取平面。

- 实验表明,该方法在0.01米分辨率下能以30Hz以上的速率进行多平面分割,并在腿式机器人上验证了其有效性。

📝 摘要(中文)

本文提出了一种基于GPU加速的高分辨率3D体素地图的实时多平面分割方法,用于腿式机器人运动。现有的在线平面地图构建方法难以平衡精度和计算效率:直接从特定传感器进行深度图像分割存在时间积分不足的问题;基于高度图的方法无法表示像悬垂这样的复杂3D结构;而基于体素的平面分割在实时应用中仍未被探索。为了解决这些限制,我们开发了一种新颖的框架,该框架集成了基于顶点的连通分量标记与基于随机抽样一致性的平面检测和凸包,利用GPU并行计算从高分辨率3D体素地图中累积的点云中快速提取平面区域。实验结果表明,即使在0.01米的 resolution 下,所提出的方法也能以超过30 Hz的更新速率实现快速准确的3D多平面分割,从而使检测到的平面能够实时用于运动任务。此外,我们通过在模拟环境和物理腿式机器人平台上的实验验证了该方法的有效性,证实了在考虑3D平面结构时具有鲁棒的运动性能。

🔬 方法详解

问题定义:论文旨在解决腿式机器人运动过程中,如何实时、准确地进行三维环境多平面分割的问题。现有方法,如直接深度图像分割,缺乏时间一致性;高度图方法无法表示复杂的三维结构(如悬垂);而基于体素的平面分割方法在实时性方面存在挑战,难以满足腿式机器人运动的需要。这些痛点限制了机器人对复杂地形的适应能力和运动规划的效率。

核心思路:论文的核心思路是利用GPU并行计算的优势,结合高分辨率三维体素地图,实现快速、准确的多平面分割。通过将点云数据累积到体素地图中,可以有效地进行噪声过滤和数据融合。然后,利用顶点连通分量标记和RANSAC算法,从体素地图中提取平面信息。这种方法既能保持较高的精度,又能满足实时性的要求。

技术框架:该方法的技术框架主要包括以下几个阶段:1) 使用深度相机或其他传感器获取环境点云数据;2) 将点云数据累积到高分辨率三维体素地图中;3) 利用顶点连通分量标记算法对体素地图进行分割,得到不同的连通区域;4) 对每个连通区域,使用RANSAC算法进行平面拟合,提取平面参数;5) 使用凸包算法对提取的平面进行边界提取;6) 将分割结果用于腿式机器人的运动规划和控制。

关键创新:该方法的关键创新在于将顶点连通分量标记算法与RANSAC算法相结合,并利用GPU进行加速,从而实现了高分辨率三维体素地图上的实时多平面分割。与传统的基于深度图像或高度图的方法相比,该方法能够更好地处理复杂的三维结构,并具有更强的鲁棒性。此外,该方法还充分利用了GPU的并行计算能力,显著提高了计算效率。

关键设计:该方法的一些关键设计包括:1) 使用高分辨率的体素地图(例如0.01米)以保证分割精度;2) 采用基于顶点的连通分量标记算法,以提高分割效率;3) 使用RANSAC算法进行平面拟合,以提高鲁棒性;4) 利用CUDA等GPU编程框架进行并行计算,以实现实时性。具体的参数设置可能需要根据实际应用场景进行调整,例如RANSAC算法的迭代次数、平面拟合的阈值等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法能够在0.01米分辨率下,以超过30Hz的更新速率实现实时多平面分割。在模拟环境和物理腿式机器人平台上的实验验证了该方法的有效性,证实了在考虑3D平面结构时具有鲁棒的运动性能。与现有方法相比,该方法在精度和实时性方面都具有显著优势。

🎯 应用场景

该研究成果可广泛应用于腿式机器人、无人驾驶车辆、增强现实等领域。在腿式机器人领域,该方法可以帮助机器人更好地感知和理解周围环境,从而实现更安全、更高效的运动。在无人驾驶车辆领域,该方法可以用于构建高精度的三维地图,提高车辆的定位和导航精度。在增强现实领域,该方法可以用于实时地对场景进行三维重建,为用户提供更逼真的增强现实体验。

📄 摘要(原文)

This paper proposes a real-time multi-plane segmentation method based on GPU-accelerated high-resolution 3D voxel mapping for legged robot locomotion. Existing online planar mapping approaches struggle to balance accuracy and computational efficiency: direct depth image segmentation from specific sensors suffers from poor temporal integration, height map-based methods cannot represent complex 3D structures like overhangs, and voxel-based plane segmentation remains unexplored for real-time applications. To address these limitations, we develop a novel framework that integrates vertex-based connected component labeling with random sample consensus based plane detection and convex hull, leveraging GPU parallel computing to rapidly extract planar regions from point clouds accumulated in high-resolution 3D voxel maps. Experimental results demonstrate that the proposed method achieves fast and accurate 3D multi-plane segmentation at over 30 Hz update rate even at a resolution of 0.01 m, enabling the detected planes to be utilized in real time for locomotion tasks. Furthermore, we validate the effectiveness of our approach through experiments in both simulated environments and physical legged robot platforms, confirming robust locomotion performance when considering 3D planar structures.